AIエージェントがCloudflareで自律デプロイ。Stripe連携でアカウント作成からドメイン購入まで完結

AIエージェントがソフトウェアを開発するだけでなく、本番環境のインフラまで自ら調達し、デプロイを完了させる時代が到来した。Cloudflareは2026年4月30日、AIエージェントがユーザーに代わってCloudflareアカウントを作成し、ドメインを購入し、アプリケーションをデプロイできる新機能を発表した。

この仕組みは決済プラットフォームのStripeが提供する「Stripe Projects」と共同設計された新しいプロトコルによって実現されている。従来は人間が管理画面で行っていたAPIトークンの発行やクレジットカード情報の入力といった作業を、AIが安全かつシームレスに代行する。

開発者は複雑な初期設定に煩わされることなく、AIに指示を出すだけで「ゼロから本番公開まで」を最短距離で駆け抜けられるようになる。これはインフラ構築の在り方を根本から変える可能性を秘めたアップデートだ。

AIエージェントがインフラ構築を担う新時代の幕開け

コーディングエージェントはプログラムを書く能力には長けているが、これまでは本番環境へのデプロイという壁に直面していた。アプリケーションを公開するには、ホスティング先のアカウント、支払い手段、そして操作のためのAPIトークンの3つが不可欠だからだ。

これまでは人間がダッシュボードにログインし、設定を済ませてからエージェントに情報を渡す必要があった。Cloudflareが導入した新機能は、この「人間による介在」を最小限に抑えることを目的としている。

開発者の手作業をゼロにするStripe Projectsとの連携

今回の機能の中核にあるのが、Stripeとの提携による「Stripe Projects」だ。これはAIエージェントが複数のサービスを組み合わせてプロジェクトを立ち上げるためのプラットフォームである。開発者がStripeのアカウントを持っていれば、それを認証の基盤として利用できる。

エージェントはユーザーの許可を得た上で、Cloudflareのアカウントを自動的にプロビジョニング(準備)する。もしユーザーがすでにCloudflareのアカウントを持っている場合は、標準的なOAuthフローを通じてアクセス権が譲渡される。これにより、APIキーのコピペという原始的な作業から解放される。

● カード情報登録(手動)

● APIキー発行とコピペ(手動)

● ドメイン検索と購入(手動)

✔ 支払いトークンの自動受け渡し

✔ ドメインの自律取得とデプロイ

上記の図が示すように、人間が介入すべきポイントは「AIへの指示」と「最終的な承認」だけに集約される。これにより、開発のリードタイムは劇的に短縮されるだろう。

プロトコルを支える3つの柱

AIエージェントが自律的に動くためには、単にAPIを叩くだけでは不十分だ。CloudflareとStripeは、エージェントが環境を理解し、権限を得て、支払いを実行するための3つの要素をプロトコルとして定義した。

サービスカタログからの自律的な発見

まず重要になるのが「Discovery(発見)」だ。エージェントは、利用可能なサービスが何であるかを知る必要がある。新しいプロトコルでは、CloudflareなどのプロバイダーがREST APIを通じてサービスカタログをJSON形式で提供する。

エージェントはユーザーの要望に基づき、このカタログから最適なサービス(ドメイン登録、ストレージ、コンピューティングなど)を選択する。人間が「どのメニューから選ぶか」を悩む必要はなく、エージェントがタスク達成に最適な道具を自ら選び出す仕組みだ。

認証とアカウントの即時発行

次に「Authorization(認証)」だ。Stripeがアイデンティティプロバイダーとして機能し、ユーザーの身元を保証する。Cloudflareはこの情報を基に、未登録のユーザーに対しては即座にアカウントを発行する。

発行された認証情報はStripe Projects CLIによって安全に保管され、エージェントはそれを使ってCloudflareのAPIを操作する。この一連の流れにおいて、ユーザーがサインアップフォームに入力する手間は一切発生しない。

クレジットカード情報を渡さない安全な決済

最も懸念されるのは「Payment(支払い)」の安全性だろう。AIにクレジットカード番号を教えるのはリスクが高い。そこでこのプロトコルでは、カード情報の代わりに「支払いトークン」を使用する。

Stripeから発行されたトークンをCloudflareに渡すことで、エージェントは実際のカード番号に触れることなく、有料プランの購読やドメインの購入を実行できる。決済の利便性とセキュリティを両立させた設計となっている。

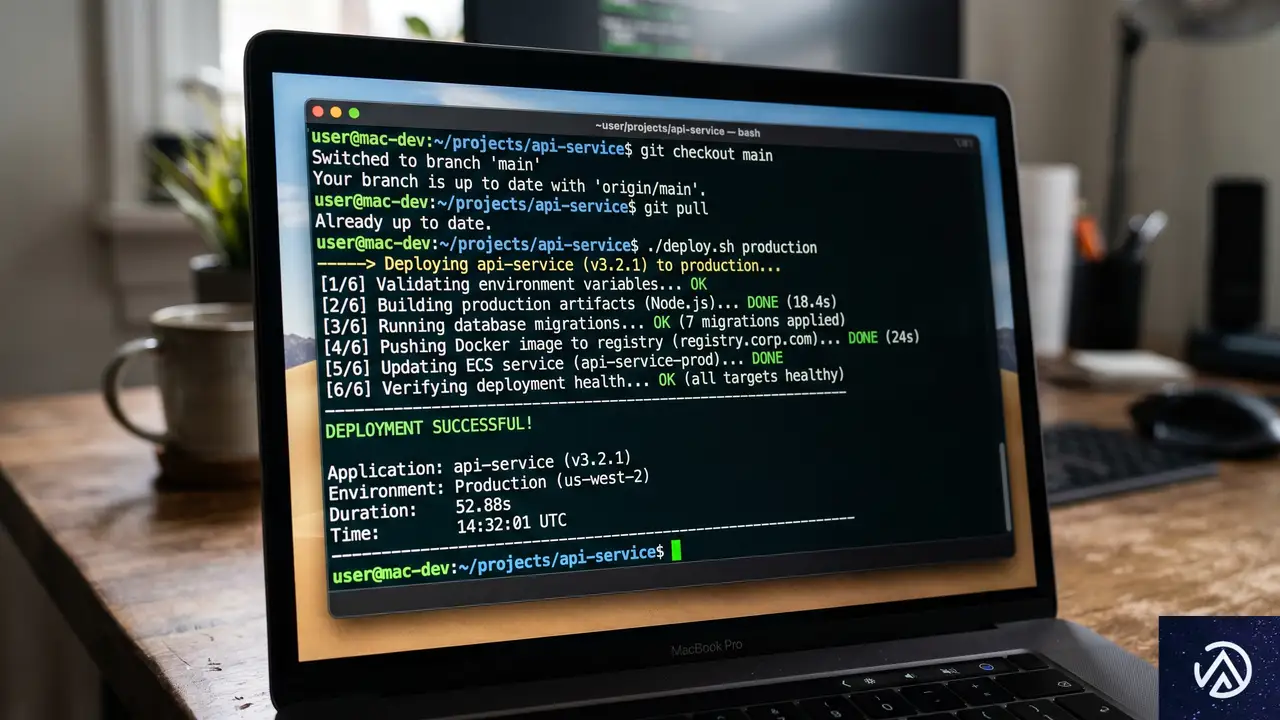

実際のワークフローとCLIでの操作感

この新機能を利用するには、Stripe CLIと専用のプラグインが必要になる。セットアップが完了すれば、ターミナルから簡単なコマンドを実行するだけでプロジェクトを開始できる。Cloudflareのブログでは、具体的な手順が紹介されている。

Stripe CLIを用いたプロジェクトの初期化

まず、以下のコマンドでプロジェクトを初期化し、Stripeにログインする。これがすべての作業の起点となる。

stripe projects initその後、AIエージェントに対して「新しいドメインを取得してアプリをデプロイしてほしい」と指示を出す。エージェントは自ら stripe projects catalog コマンドを叩いてCloudflareのドメイン登録サービスを見つけ出し、購入プロセスを開始する。

もしStripeアカウントに支払い方法が登録されていない場合は、エージェントがユーザーに対してカード情報の追加を促すプロンプトを表示する。人間はエージェントが提示した確認事項に対して「Yes」と答えるだけで、裏側で複雑なインフラの紐付けが完了する。

セキュリティとガバナンスへの配慮

AIに支払権限を与えることには、慎重な意見も多い。「エージェントが勝手に高額なドメインを大量購入したらどうするのか」という懸念は当然の反応だ。この問題に対処するため、プロトコルには厳格な制限が設けられている。

予算制限と予算アラートによる暴走防止

Stripe Projectsでは、デフォルトで1つのプロバイダーに対して月額100ドルという支出上限が設定されている。エージェントがこの上限を超えて勝手に課金することはできない仕組みだ。

さらに上限を引き上げたい場合は、ユーザーが明示的に設定を変更し、Cloudflare側で予算アラート(Budget Alerts)を設定する必要がある。これにより、AIの自律性を保ちつつ、予期せぬコスト増大を防ぐガバナンスが効いている。

独自分析。インフラのコモディティ化とエージェントOSの加速

今回のCloudflareの動きは、単なる利便性の向上に留まらない。筆者は、これがインフラの「完全な抽象化」に向けた決定的な一歩であると考えている。かつて開発者はサーバーを自前で立てていたが、クラウドが登場し、さらにサーバーレスへと進化した。そして今、インフラは「AIが勝手に調達するもの」へと変貌しようとしている。

ここで重要なのは、Stripeが単なる決済手段ではなく、Web上の「アイデンティティ(身元)」のハブとして機能し始めている点だ。Stripeでログインしていれば、CloudflareもPlanetScaleもNeonも、あらゆるクラウドサービスが即座に利用可能になる。これは、Web全体が1つの巨大なオペレーティングシステム(OS)のように振る舞い、AIエージェントがその上で自由にリソースを操作できる環境が整いつつあることを意味する。

開発者の役割は、コードを書くことよりも「AIにどのようなビジネスロジックを実現させたいか」を定義することへとシフトしていくだろう。インフラの設定ミスやAPIトークンの管理漏れといった「非本質的なトラブル」から解放される未来は、すぐそこまで来ている。

この記事のポイント

- AIエージェントがCloudflareのアカウント作成、ドメイン購入、デプロイを自律的に行えるようになった。

- Stripe Projectsとの連携により、OAuth認証と支払いトークンを用いた安全なプロトコルが構築されている。

- 人間はダッシュボードを操作することなく、CLIとAIへの指示だけで本番環境を構築できる。

- 月額100ドルのデフォルト支出制限により、AIの暴走による高額請求を防ぐ仕組みが備わっている。

- インフラの調達が自動化されることで、開発者はより高度なアプリケーション設計に集中できるようになる。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

ストリーミングUIの安定性を高める実装テクニック

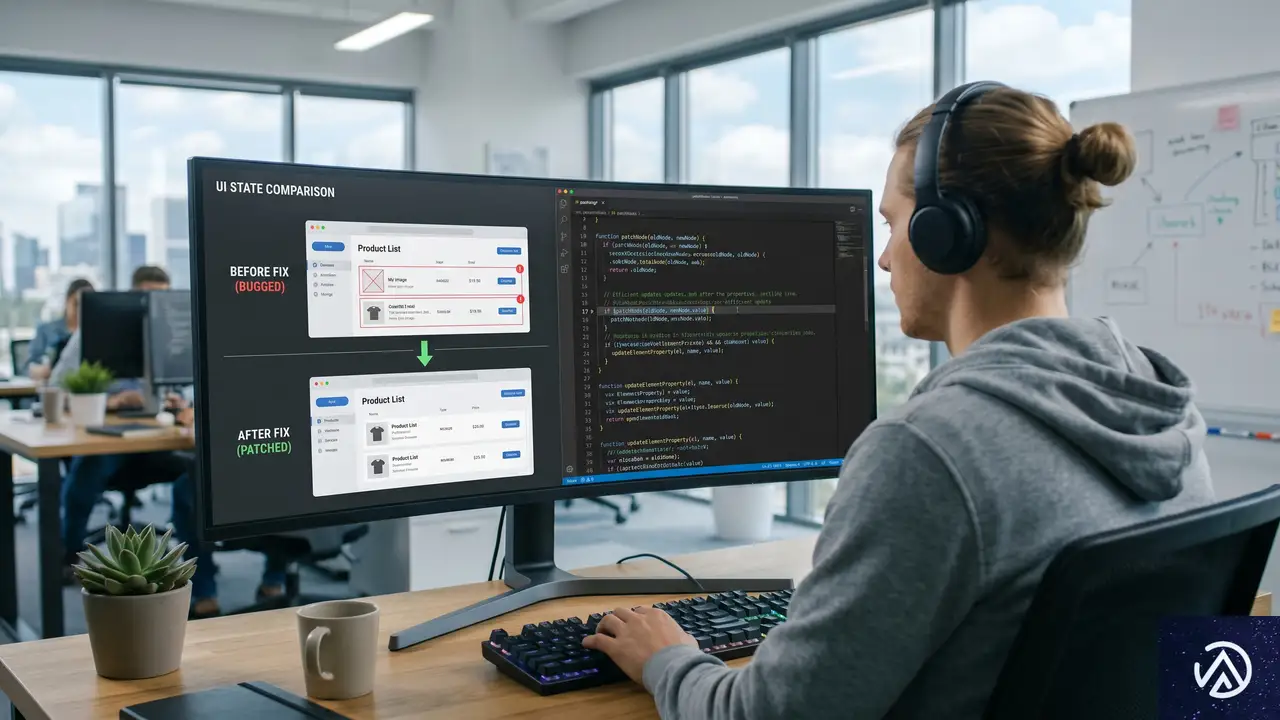

WordPressサイトのフロントエンドにチャットボットやリアルタイムのログビューアーを組み込むケースが増えている。こうしたストリーミングUIは、新しいデータが届くたびにDOMを更新するため、適切な制御がないとスクロール位置が勝手に動いたり、ボタンがクリック直前に移動するといった不安定さが目立つ。

特にスクロールの強制移動、レイアウトのシフト、そして過剰な再描画の3つは、ユーザーの操作感を大きく損ねる。本記事では、これらの問題を解決し、WordPressのカスタムエンドポイントや管理画面のダッシュボードにも応用できる安定したUIの実装パターンを紹介する。

ストリーミングUIが不安定になる根本原因

チャット形式のAI応答、ログの逐次表示、ダッシュボードの数値更新。一見異なるこれらのUIは、いずれも同じ3つの根本問題に突き当たる。

スクロールの制御不能

ストリーミング中、多くのUIはビューポートを常に最下部に固定しようとする。これ自体は合理的だが、ユーザーが少し上にスクロールして過去のメッセージを読もうとした瞬間、UIが再び最下部へ引き戻してしまう。ユーザーの意図を無視した自動制御が、インタラクションの邪魔になる。

レイアウトシフト

ストリーミングコンテンツは行数や高さが動的に増えるため、その下にある要素が常に押し下げられる。クリックしようとしたボタンが移動したり、読んでいた行が画面外に消えたりする。DOMを毎回全再構築していると、このシフトはさらに顕著になる。

過剰なレンダリング更新

ブラウザは1秒間に約60回画面を描画するが、ストリームのデータ到着はそれよりも速いことがある。毎回DOMを書き換えていると、実際にはユーザーが目にしないフレームのためにもレイアウト再計算が走り、パフォーマンスがじわじわと低下する。

安定したスクロール動作の実装

まずはスクロールの自動制御をユーザーの意図に合わせる。基本的な考え方は以下の通りだ。

- ユーザーが最下部にいるときは自動スクロールを有効にする

- ユーザーが上方向にスクロールしたら自動スクロールを止める

- 再び最下部に戻ったら自動スクロールを再開する

これを実現するには、ユーザーが意図的にスクロール位置を変えたかどうかを追跡するフラグを設ける。

let userScrolled = false;

chatEl.addEventListener('scroll', () => {

const gap = chatEl.scrollHeight - chatEl.scrollTop - chatEl.clientHeight;

userScrolled = gap > 60; // 60px以上離れたらユーザー操作とみなす

});ここで60pxのしきい値が重要になる。新しい行が追加されて生じる微小な高さ変化でフラグが切り替わらないようにし、本当にユーザーがスクロールした時だけ自動スクロールを停止させる。

自動スクロール関数はフラグを参照するだけでよい。

function autoScroll() {

if (!userScrolled) {

chatEl.scrollTop = chatEl.scrollHeight;

}

}なお、新たなストリームが開始されたら必ず userScrolled をリセットする。これを見落とすと、前回のメッセージでのスクロールが原因で次の自動スクロールが無効になり、読みづらさが続く。

レイアウトシフトを防ぐDOMの差分更新

従来の実装では、新しい文字が届くたびに要素を innerHTML で全再構築することが多い。以下はその典型例だ。

bubble.innerHTML = '';

fullText.split('\n').forEach(line => {

const p = document.createElement('p');

p.textContent = line || '\u00A0';

bubble.appendChild(p);

});

bubble.appendChild(cursorEl);これで動作はするが、更新のたびにDOMツリー全体を破壊して再生成するため、レイアウト再計算が必ず発生する。さらに、カーソルも毎回削除と追加が繰り返され、高速ストリーミング時にはちらつきの原因にもなる。

解決策はシンプルだ。あらかじめ空のテキストノードを持った段落を作り、そこへ直接文字を追記していく。改行が来た時にだけ新しい段落を追加する。

let currentP = null;

function initBubble(bubble, cursor) {

currentP = document.createElement('p');

currentP.appendChild(document.createTextNode(''));

bubble.insertBefore(currentP, cursor);

}

function appendChar(char, bubble, cursor) {

if (char === '\n') {

currentP = document.createElement('p');

currentP.appendChild(document.createTextNode(''));

bubble.insertBefore(currentP, cursor);

} else {

currentP.firstChild.textContent += char;

}

}この方法では、通常の文字追加はテキストノードの拡張だけで済み、レイアウトシフトはほとんど発生しない。改行の時だけ新しい段落が挿入されるが、それ以外の無駄な再構築が一切なくなる。カーソルのちらつきも自然に消える。

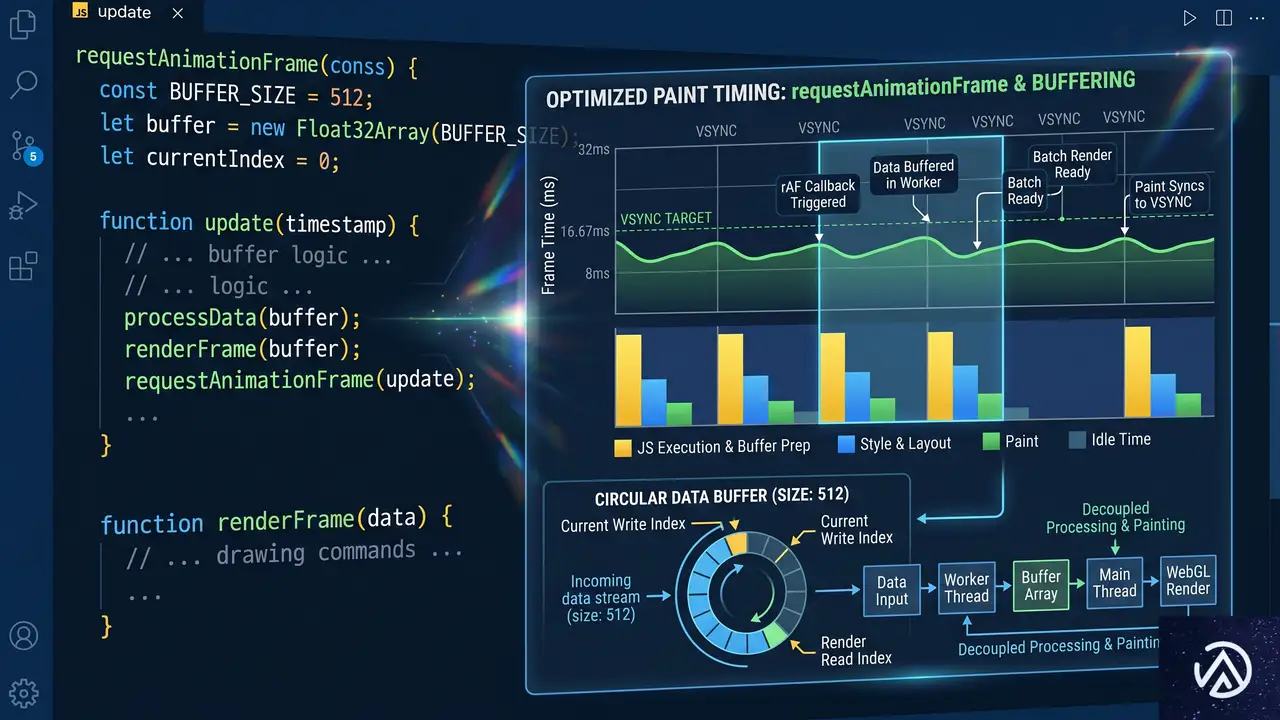

レンダリング頻度を抑えるバッファリング戦略

DOMの差分更新だけでもUIは安定するが、まだ文字が届くたびにペイントのトリガーを引いている。特にストリーム速度が速い場合、短時間に大量の小更新が発生し、ブラウザの負荷が積み重なる。

ここで有効なのが受信データのバッファリングと requestAnimationFrame によるフレーム単位のフラッシュだ。到着した文字をいったんバッファに溜め、次の描画直前にまとめてDOMへ書き出す。

let pending = '';

let rafQueued = false;

function onChar(char) {

pending += char;

if (!rafQueued) {

rafQueued = true;

requestAnimationFrame(flush);

}

}

function flush() {

for (const char of pending) {

appendChar(char);

}

pending = '';

rafQueued = false;

autoScroll();

}rafQueued フラグが二重スケジューリングを防ぐ。こうすることで、データ到着頻度とUI更新タイミングが完全に分離され、ブラウザが行う実際の描画回数に最適化されたペースでDOM変更が行われる。変更後の見た目は変わらなくても、特に高速ストリーミング設定時に操作感が格段に滑らかになる。

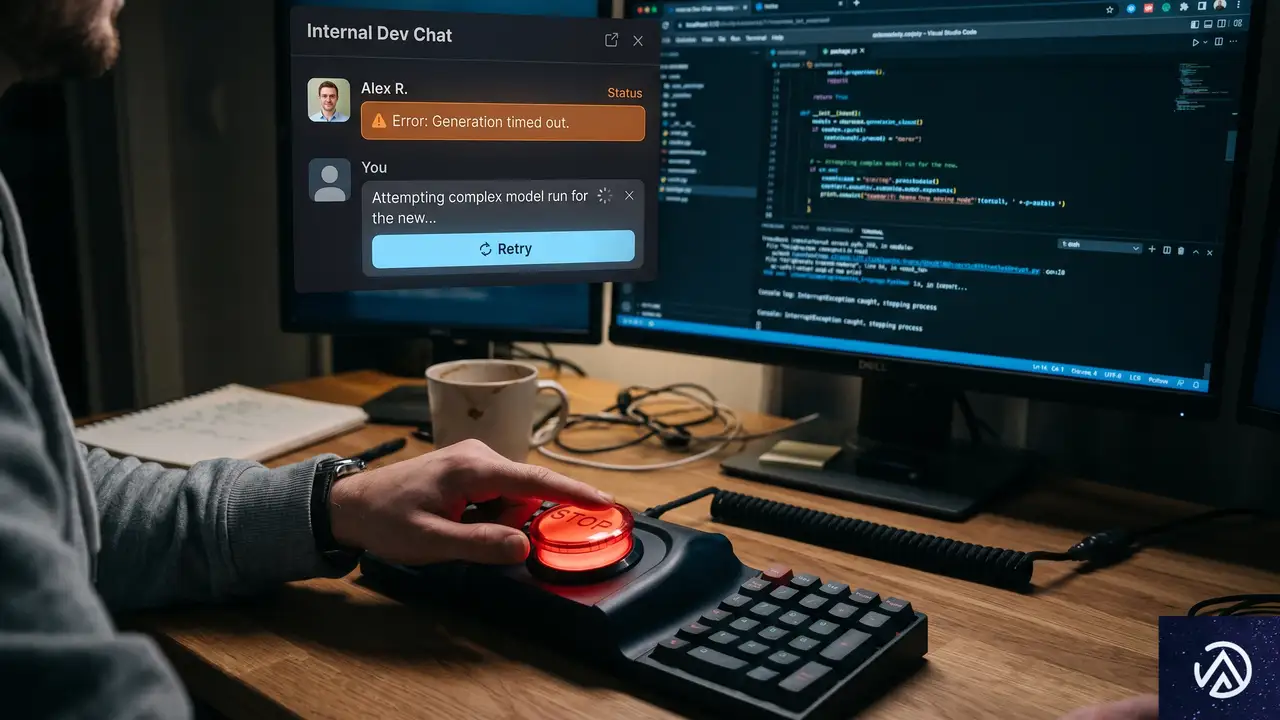

ストリーム中断への対応とユーザーフィードバック

ユーザーがストリームを途中で停止したり、ネットワークエラーで途切れたりした場合、UIを中途半端な状態のまま放置してはいけない。停止ボタンを押しただけでカーソルが点滅し続けたり、ボタン表示が変わらなかったりすると不信感につながる。

中断時のクリーンアップ

function stopStream() {

clearTimeout(streamTimer);

isStreaming = false;

pending = ''; // 未処理バッファを破棄

rafQueued = false;

if (cursorEl && cursorEl.parentNode) cursorEl.remove();

markStopped(aiBubble); // 「応答が停止しました」ラベルを付与

stopBtn.style.display = 'none';

retryBtn.style.display = '';

retryBtn.focus(); // キーボード操作のため即フォーカス

}バッファをクリアするのは、停止後に残っていた文字が次のフレームで書き込まれるのを防ぐためだ。カーソルの親ノードチェックも、すでに削除済みの場合のエラー回避に必要になる。

再試行機能の提供

中断後は同じ質問を再送信する「リトライ」ボタンを表示する。ユーザーに再度質問を入力させるのではなく、直前の入力を保持しておき、ワンクリックでストリームを最初からやり直せる。

let lastQuestion = '';

function retryStream() {

if (currentMsgEl && currentMsgEl.parentNode) {

currentMsgEl.remove();

}

charIndex = 0;

userScrolled = false;

pending = '';

rafQueued = false;

isStreaming = true;

// ボタン表示切替など

setTimeout(() => {

initAIMsg();

tick(lastAnswer);

}, 200);

}状態の完全リセットが肝だ。前回の文字インデックス、スクロールフラグ、バッファをすべて初期化しなければ、新しいストリームに前の残骸が混ざる。

新規メッセージ送信時の既存ストリーム停止

もう一つ見落としやすいのが、古いストリームが動いている最中に新しいメッセージが送信されたケースだ。そのままにすると2つのストリームが同時にDOMを更新し、文字が混ざり合ってしまう。新しいメッセージの処理を始める前に、必ず進行中のストリームを停止する。

function startStream(question, answer) {

if (isStreaming) {

clearTimeout(streamTimer);

isStreaming = false;

pending = '';

rafQueued = false;

if (cursorEl && cursorEl.parentNode) cursorEl.remove();

}

// ここで新規ストリームのセットアップ

}断りなく上書きするのではなく、明示的に前のストリームをクリーンアップすることで、イレギュラーな重複動作を防ぐ。

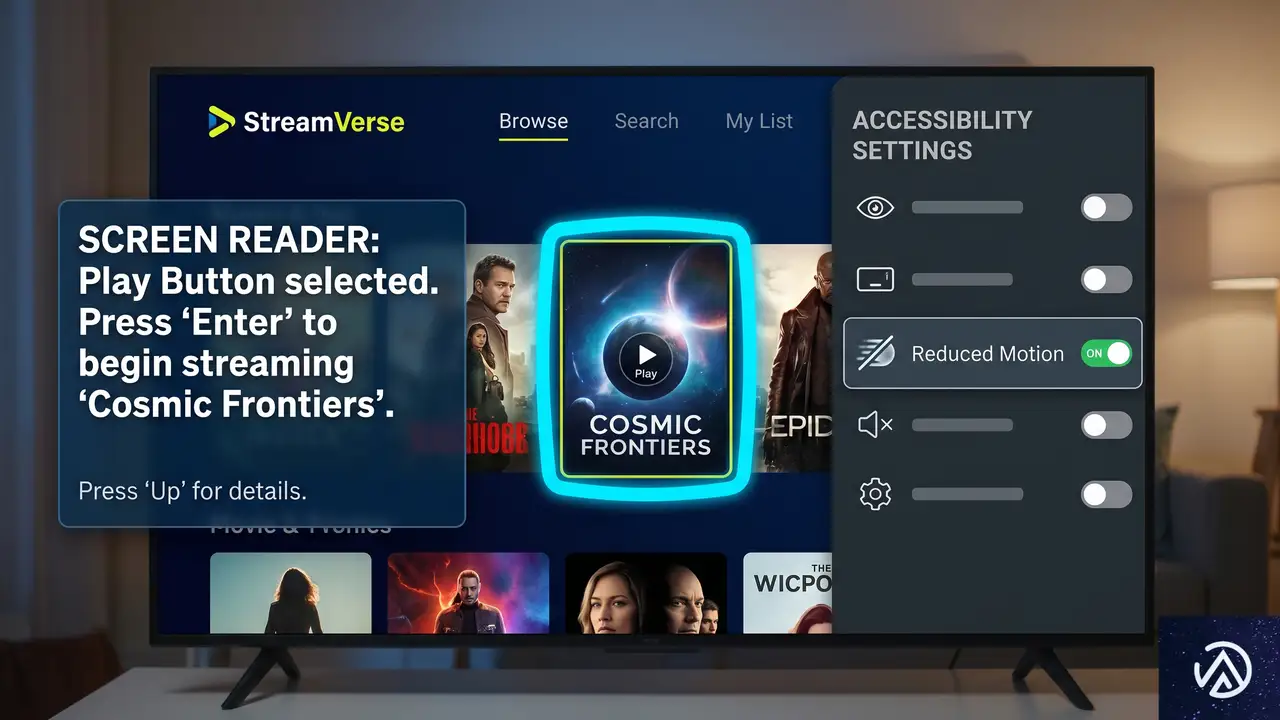

アクセシビリティを考慮したストリーミングUI

ストリーミングUIはマウス操作を前提に開発されがちで、支援技術やキーボード操作、動きへの敏感さへの配慮が後回しにされる。しかし、これらは上乗せの追加対応で十分改善できる。

スクリーンリーダーへの対応

スクリーンリーダーは自動で現れたコンテンツを読み上げない。そこで aria-live 属性を使ってライブリージョンを設定する。

<div id="chat" role="log" aria-live="polite"

aria-atomic="false" aria-label="チャットメッセージ"></div>role="log" はこれが逐次更新されるトランスクリプトであることを支援技術に伝える。aria-atomic="false" によって、新しく追加された部分だけが読み上げられ、全文の再読み上げが発生しない。aria-live="polite" なら現在の読み上げを邪魔せず、適切なタイミングで通知される。

中断時に挿入される「応答が停止しました」ラベルも、このライブリージョン内にあれば自動的にアナウンスされる。リトライボタンには、何をリトライするのか分かるように aria-label を設定する。

retryBtn.setAttribute('aria-label',

`リトライ: ${lastQuestion.slice(0, 60)}`);キーボードナビゲーションの確保

停止ボタンやリトライボタンは、ストリーミング中でもTabキーで到達できなければならない。非表示にする際は display: none を使うことでフォーカス順からも除外される。opacity: 0 や visibility: hidden だと不可視要素にフォーカスが当たり混乱を招く。

カーソル点滅エフェクトには aria-hidden="true" を付け、スクリーンリーダーが読み上げないようにする。フォーカスリングは :focus-visible を用い、マウスクリック時には表示せず、キーボード操作時のみ明示する。

動きの抑制

タイピングアニメーションのような連続的な動きは、前庭障害などを持つユーザーにとって負荷になる。OSレベルで設定された動きの設定を、prefers-reduced-motion メディアクエリで検出し、それに従う。

const reducedMotion = window.matchMedia(

'(prefers-reduced-motion: reduce)'

).matches;

if (reducedMotion) {

initAIMsg();

for (const char of text) appendChar(char);

if (cursorEl && cursorEl.parentNode) cursorEl.remove();

done();

return;

}縮小モードが有効なら、ストリーミングアニメーションを完全にスキップし、完成したテキストを一度に表示する。CSS側でもカーソルの点滅を止める。

@media (prefers-reduced-motion: reduce) {

.cursor { animation: none; opacity: 1; }

}この記事のポイント

- ストリーミングUIの不安定さは、スクロール制御・レイアウトシフト・過剰描画の3点に集約される

- ユーザーのスクロール位置を追跡し、最下部にいる時だけ自動スクロールを有効にする

innerHTMLの全再構築をやめ、テキストノードへの差分追記でレイアウト計算を最小限に抑えるrequestAnimationFrameでデータ到着と描画を分離し、ブラウザの負荷を軽減する- ストリーム中断時はバッファクリア、カーソル除去、リトライ機能などで中途半端な状態を残さない

aria-liveやprefers-reduced-motionを用いて、支援技術や動きに敏感なユーザーにも配慮する

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

ECサイトのAI被リンク戦略、4つの引用タイプを理解する

ECサイトの新たな集客経路として、ChatGPTやGeminiといった生成AIの回答が無視できなくなりつつある。AIが商品を推薦する際、その情報源としてどのECサイトが引用されるのか。実務者にとっては死活問題だ。

Practical Ecommerceの記事によれば、生成AIの引用には大きく分けて4つのタイプがある。これらの構造を理解せずに対策を打つのは、姿の見えない敵と戦うようなものだ。特にEC事業者にとっては、自社の商品ページがどのようにAIに取り込まれ、表示されるのかというメカニズムを知ることが、これからの集客戦略の基礎になる。

表面的なSEO対策だけでは不十分だ。AIが情報を「評価」する仕組みに踏み込み、ECに特化した最適化を考えていく必要がある。

生成AIは何を根拠に商品を推薦するのか

「この季節に合うファッションは?」とAIに尋ねたとき、返ってくる回答には特定のブランドや商品へのリンクが含まれることがある。これが引用(citations)だ。AIは、インターネット上の情報をただ鵜呑みにしているわけではない。独自の判断基準で情報源を選び、回答に組み込んでいる。

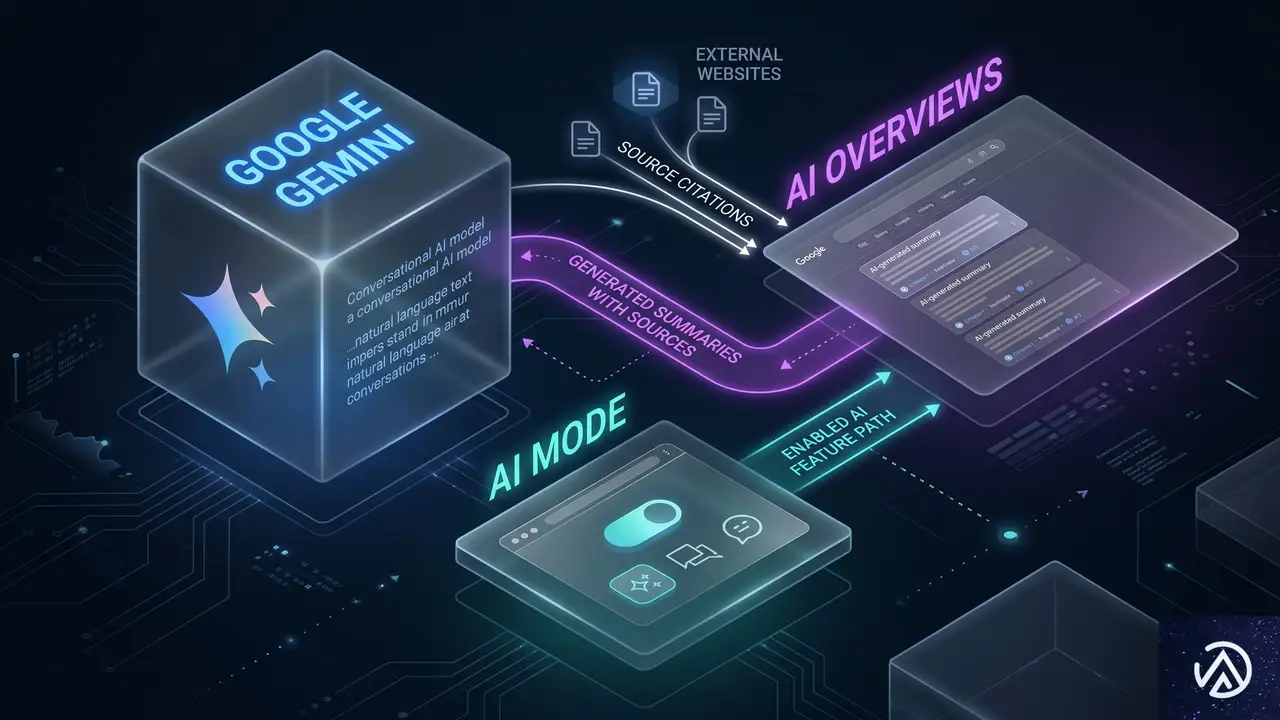

まず押さえておくべき大前提がある。生成AIプラットフォームの多くは、検索エンジンのインデックスに依存しているという点だ。分析によれば、ChatGPTやGemini、GoogleのAI Mode、Grokは主にGoogleの検索結果を参照する。一方、ClaudeやPerplexityはBrave検索エンジンの結果を利用する。つまり、従来のSEOで上位表示を獲得することが、AIに引用されるための重要な土台になるわけだ。

ただし例外もある。ChatGPTは、一部の提携パートナー企業の情報を外部評価とは無関係に優先的に引用する動きがある。クローズドなパートナーシップを結べる一部の巨大ブランドを除き、多くのEC事業者はGoogleとBraveの両方で安定したプレゼンスを築くのが現実的な戦略になる。

AIは二段階で情報を処理する

AIが質問に答えるプロセスは、大きく二段階に分けて考えると理解しやすい。第一段階は、AIが事前に学習した「訓練データ」からドラフトの回答を生成するステップだ。この時点では、過去にインターネット上で収集された情報がフル活用される。

第二段階は、生成したドラフトの正確性を高めたり、最新情報を補足したりするために、リアルタイムでWeb検索を行い、外部の情報源を参照するステップだ。この第二段階で参照された情報源が、回答に「引用」として表示されることになる。

この二段階構造が重要なのは、仮に自社ECサイトがAIの回答に直接リンクされていなくても、AIの知識ベース(訓練データ)に自社の情報が含まれていれば、回答内容そのものに影響を与えられる可能性があるからだ。可視化されたリンクの数だけが、AIプレゼンスのすべてではない。

EC事業者が知るべき4つの引用タイプ

生成AIが回答を生成する際の引用は、一括りにできない。専門家による分析や特許情報から、以下の4つのタイプに分類できることがわかってきた。それぞれの特徴をECの文脈で読み解いていこう。

1. 回答に直結する「グラウンデッド(根拠型)引用」

グラウンデッド(grounded)引用とは、AIがリアルタイムでWeb検索を行い、その検索結果から得た情報を回答の骨格として利用するケースを指す。例えば「2026年夏のサンダルトレンド」という質問に対して、AIが最新のファッションECサイトやレビューサイトをクロールし、そこに書かれた内容をもとに「厚底サンダルが再流行している」と回答するパターンだ。

EC事業者にとって、このタイプの引用を獲得するには、まずGoogleやBraveでの上位表示が前提になる。さらに、検索エンジンがページ内容を正確に理解しやすい構造(適切な見出し、明快な商品説明、構造化データの実装)が求められる。どんなに良い商品でも、AIが内容を抽出できなければ引用の対象外になってしまう。

2. 独自判断による「アングラウンデッド(非根拠型)引用」

アングラウンデッド(ungrounded)引用は、AIが自身の訓練データに基づいて回答を生成した後、その回答の信頼性を補強するために後付けで情報源を提示するタイプだ。回答の内容自体は外部の最新情報から生成されたわけではない。AIが「すでに知っていること」を裏付けるために、権威あるサイトのURLを添えるイメージだ。

New York Timesが報じた分析会社Oumiの調査によると、GoogleのAI Overviews(Geminiが生成)に表示される引用の半数以上は、このアングラウンデッド引用に該当するという。AIは回答を変えないまま、権威づけのためにリンクを貼っている可能性がある。

EC事業者にとっては、自社サイトが「権威ある情報源」としてAIに認識されることが、このタイプの引用獲得に繋がる。知名度の高いブランドや、長年にわたって特定カテゴリで情報発信を続けてきた専門ECサイトが有利になる。一朝一夕で得られるものではないが、中長期的なブランディングの重要性を示すデータといえる。

3. 幽霊のように現れる「ゴースト引用」

ゴースト(ghost)引用とは、AIの回答内にリンクは含まれているものの、そのリンク元のサイト名やブランド名が明示されないケースだ。ユーザーから見ると「なぜこのリンクがここにあるのか」が判然としない。

検索最適化の専門家Kevin Indig氏が発表した調査によれば、生成AIの回答の61.7%にこのゴースト引用が含まれているという。原因として考えられるのは、引用元のページが「自社の製品やサービスがなぜその質問の答えになるのか」を明確に説明できていないケースだ。AIが内容を読み取っても、文脈をうまくラベリングできないのだろう。

ECサイトで言い換えれば、商品の特徴だけを羅列したページよりも、「この商品はこんな悩みをこう解決する」というストーリーが明確なページのほうが、ゴースト引用を回避し、ブランド名付きで引用されやすい可能性がある。

4. 見えない「不可視引用」

不可視(invisible)引用は、厳密には引用ですらない。AIが回答を生成する際に自社サイトの情報を利用しているにもかかわらず、一切のリンクも言及もされない状態を指す。Ahrefsの調査では、ChatGPTが回答生成のために取得したURLのうち、実に50.2%が引用されずに終わっているという。

Practical Ecommerceの記事著者も、Redditのスレッドが回答内容に影響を与えることは多いが、引用されることは稀だと指摘している。情報としては使われているが、出典としては表示されない。これが不可視引用の実態だ。

EC事業者からすると釈然としない話かもしれない。しかし、たとえリンクが付かなくとも、自社の商品情報がAIの回答形成に利用されることは、潜在的なブランド露出として価値がある。AIに情報を「使わせる」段階から、最終的に「引用させる」段階へとステップアップしていく戦略が求められる。

EC版GEO戦略は「訓練データ」から始める

ここまで4つの引用タイプを紹介したが、実務者が最初に注力すべきは、見えない土台である「訓練データ」への浸透だ。生成AIは質問を受けた際、まず自らの訓練データを参照して回答のプロトタイプを作る。外部検索はその後に行われるか、あるいは並行して行われる。つまり、訓練データに自社情報が含まれていないECサイトは、スタートラインにすら立てていない可能性がある。

では、どうすれば訓練データに含まれるのか。AI企業が使用するデータセットの詳細は非公開だが、一般的にクロールされやすい公開ウェブページの情報が収集される。以下のような取り組みが効果的だ。

- 商品情報の構造化:AIが内容を正確に抽出できるよう、商品名、価格、レビュー、在庫状況などを機械可読な形式(構造化データ)でマークアップする。

- カテゴリ権威性の確立:特定の商品カテゴリ(例:アウトドア用品、オーガニックコスメ)において、網羅的で深い情報を継続的に発信する。

- 被リンクの多様化:SNSや業界メディア、ブログなど、多様なドメインから自社ECサイトへのリンクを獲得し、AIから見た「重要なサイト」としてのシグナルを強める。

これらの施策は、従来のSEO対策と重なる部分も多い。GEO(Generative Engine Optimization)はSEOの延長線上にある。ただし、キーワードの詰め込みではなく、「AIが理解しやすい形で情報を整理する」という視点が加わる点が新しい。

これからのEC集客は「AIに理解される設計」が鍵

現時点で、主要な生成AIプラットフォームは引用アルゴリズムの詳細を公開していない。また、最適化のための公式ガイドラインも存在しない。そのため、EC事業者は公開されている分析データや特許情報をもとに、手探りで戦略を組み立てる必要がある。

重要なのは、AIに「引用されること」と「回答に影響を与えること」の両方を視野に入れることだ。たとえ自社ECサイトへのリンクが付かなくても、AIが自社の商品を「2026年夏のトレンド」として回答に組み込むことができれば、それは大きな成果だ。

具体的なロードマップとしては、まず技術的なSEO基盤を固め、次にコンテンツの質と構造化でAIの理解を助け、その後、ブランド認知と権威性の向上によって引用の確度を高める、という3段階のアプローチになる。一朝一夕のハックではどうにもならないが、AIが情報収集の主役になりつつある今、GEOに投資しないリスクは無視できない大きさだ。

この記事のポイント

- 生成AIの引用は、グラウンデッド、アングラウンデッド、ゴースト、不可視の4タイプに分類できる。

- GoogleやBrave検索での上位表示が、AIに引用されるための基本的な条件となる。

- まずは訓練データに自社情報を含めることを優先し、その後、引用の質を高める戦略を取るべき。

- 構造化データや明快な商品説明で、AIが内容を抽出しやすいECサイト設計が求められる。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

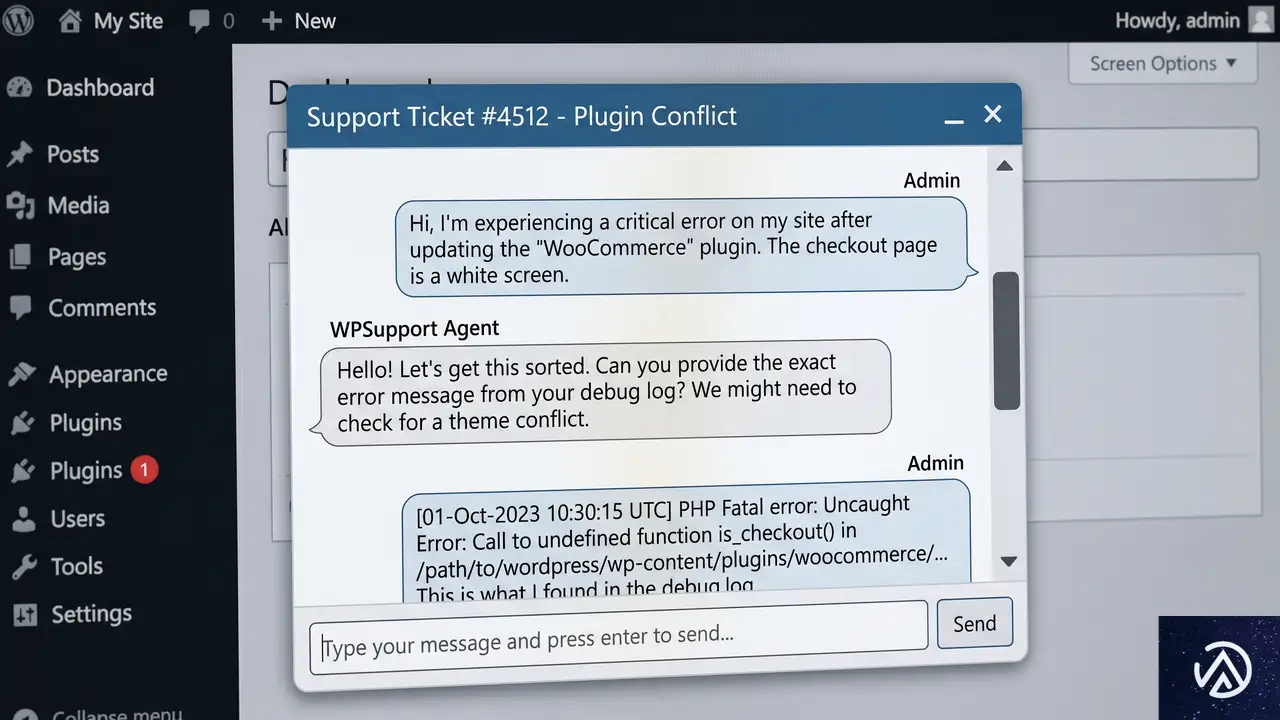

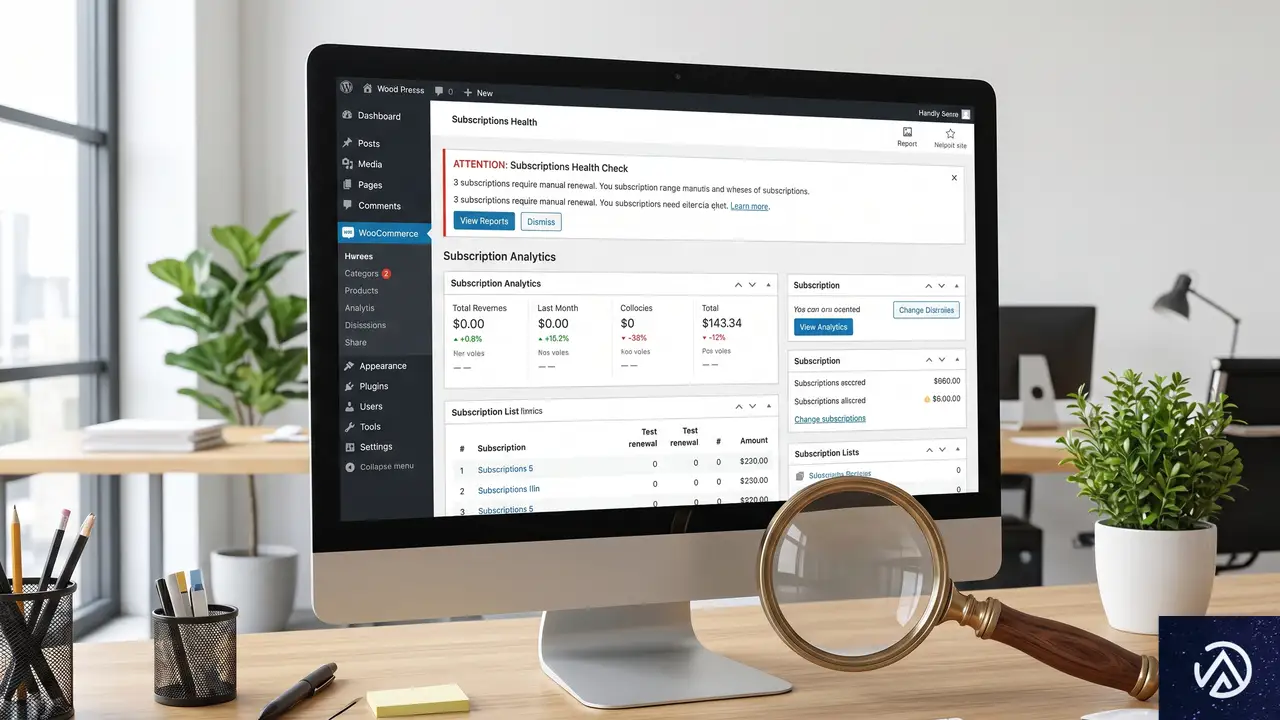

WooCommerce Subscriptions Health Checkリリース、定期購入の健全性をチェック

WooCommerce Subscriptionsプラグインに、サブスクリプションの支払い状態を可視化する「Subscriptions Health Check」ツールが追加された。WooCommerce Developer Blogの2026年4月30日の記事で発表されている。

このツールは、本来は自動更新されるべき定期購入が手動更新のまま止まっていないか、あるいは次回支払日が欠落していないかを店舗管理者がすぐに把握できるようにするものだ。WooCommerce 3.0以降のサブスクリプションストアであれば、過去のバグの影響有無にかかわらず利用できる。

リリースの直接のきっかけは、定期購入が意図せず手動更新に切り替わる可能性がある4件のバグが公に報告されたことだ。しかし開発チームは、原因がバグに限らず、決済ゲートウェイの変更やインポート時の設定など、同じような「自動更新されない」状態はさまざまな要因で起こり得ると判断。特定のバグ被害者を探すのではなく、潜在的に問題を抱えるサブスクリプションを幅広くリストアップする仕組みを選んだ。

サブスクリプション健全性チェックツールの登場背景

サブスクリプション型ビジネスでは、決済の自動継続が収益の柱になる。そのため、意図せず手動更新に設定されたまま放置されると、気づかないうちに売上を失うリスクがある。開発チームはもともとこうした健全性チェック機能をロードマップに載せていたが、公のバグ報告を受けて開発を前倒しした。

報告されたバグは、WooCommerceの高性能オーダーストレージ(HPOS)環境で、定期購入の作成時に_requires_manual_renewalフラグが誤ってtrueのままになるというものだ。調査の過程で、キャッシュの不整合やデータ同期の欠落といった根本原因がいくつか特定された。しかしチームは、これらが修正済みであっても「自動更新されない定期購入」という状態は他の経路でも発生し得ると考えた。

たとえば、店舗管理者が手動更新設定に切り替えた、決済トークンが削除された、他社のカートシステムからインポートした際に手動扱いになった、カスタムコードやサードパーティ連携がフラグを書き換えた、といったケースだ。これらをすべて機械的に区別するのは難しい。そこで最終的には、自動更新が可能な支払い方法を持ちながら手動更新になっているサブスクリプションをすべて可視化し、その判断をマーチャントに委ねる設計が採用された。

4つのバグが与えた影響の実態

WooCommerce開発者ブログの記事では、公表された4件のバグすべてがすでに修正済みであることが明かされている。しかし、修正当時はこれらのバグが「定期購入をサイレントに手動更新へ切り替える」というマーチャント目線での影響まで認識されていなかった。

バグの組み合わせが実際に問題を引き起こしていたのは、HPOSを有効にしたストアで、かつ特定のバージョンのWooCommerce Subscriptionsを動かしていた期間に限られる。バグ1(期限切れHPOSキャッシュ)は2024年3月に修正済み。バグ2(HPOSバックフィルメソッド欠落)は2023年中に解消。バグ3(再取得による不整合)は2024年5月に修正された。独立して「手動更新化」を引き起こすわけではなく、バグ1とバグ3が同時に存在する環境で、購入手続き時にフラグが誤設定されるという経路だった。

影響を受けた可能性が最も高いのは、2023年10月から2024年3月の間にHPOSを有効化し、かつWooCommerce Subscriptions 6.1.0未満を利用していたストアだ。2024年5月以降にサブスクリプションを開始したストアは、今回のバグの影響を受けていない。ただし、開発チームはこのツールをバグの有無にかかわらず定期購入全体の監視に役立ててほしいとしている。

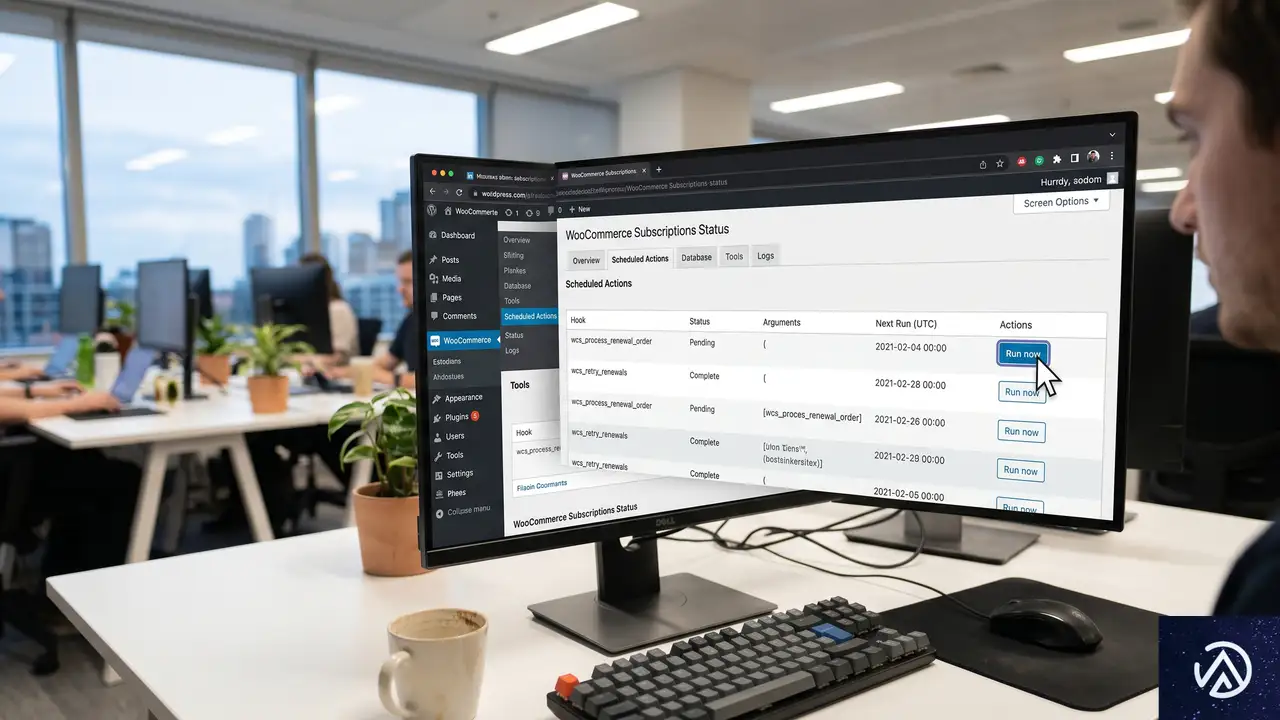

ツールの使い方と主要機能

Health Checkツールは、WordPress管理画面の「WooCommerce」→「ステータス」→「サブスクリプション」タブに設置されている。ステータスページには、最終スキャン日時と、手動スキャンの実行ボタンが表示される。

「今すぐ実行」ボタンでオンデマンドのスキャンが可能だ。スキャンはバッチ処理で行われ、サーバーやデータベースに過負荷がかからないようスロットリングが組み込まれている。定期的な自動スキャンも、WooCommerce設定で有効にすれば夜間に実行され、結果が保存される。保存された結果はページを開くたびに即座に表示されるため、毎回重いクエリを待つ必要はない。

3つのタブで状態を整理

ツールを開くと、「すべて」「自動更新をサポート」「更新漏れ」の3つのタブが表示される。

「すべて」タブでは、ストア内の全サブスクリプションが一覧できる。特定の条件で絞り込みたい場合の全体像把握に使う。

「自動更新をサポート」タブは、今回のツールの中核となる部分だ。次の条件をすべて満たすサブスクリプションが表示される。ステータスが「有効」「保留中」「キャンセル保留」のいずれかである、_requires_manual_renewalフラグがtrueである、支払い方法が自動更新をサポートしている、かつ顧客がそのゲートウェイに有効な支払いトークンを保存している。つまり、自動更新できるのに手動扱いになっているサブスクリプションが浮かび上がる。

「更新漏れ」タブには、次回支払日が空欄のまま更新が止まっているものや、過去の支払日から24時間以上経過しても対応する更新注文が生成されていないサブスクリプションが表示される。これらはスケジュールされたアクションの不具合やサーバー移行時の問題など、さまざまな原因で発生し得る。

表示される項目とフィルター

各行には、サブスクリプションID、作成日、顧客名、請求サイクル、ステータス、請求モード(手動/自動)、自動更新の設定(顧客がMy Accountでオプトアウトしたかどうか)、支払い方法、次回支払日、最新の更新注文ステータス、直近の成功支払日が表示される。他社システムから手動更新としてインポートされたものは「インポート(手動)」と明示され、フィルターで除外されるのではなく、タグ付けされる。

フィルターとして、ステータス別、請求モード別、更新注文ステータス別、自動更新オプトアウトの有無別、IDやメールアドレスによる検索が用意されている。列のソートも可能で、デフォルトでは新しいサブスクリプションが先頭に来る。

このツールは、あえて自動修復を行わない設計になっている。たとえば、手動更新に切り替わっているサブスクリプションを自動で「自動更新」に戻したり、店舗全体で「自動支払いを無効化」しているストアのサブスクリプションを非表示にしたりはしない。すべての判断は店舗の文脈を知るマーチャントに委ねられている。

バグの詳細とマーチャントへの影響

公表された4件のバグのうち、定期購入の手動更新化に直接つながったのはバグ1とバグ3の組み合わせだ。バグ2はスケジュールメタデータの不整合を引き起こしたもので、更新日に更新処理そのものが発火しないという別の症状となる。バグ4はゲートウェイ変更時の復旧ギャップで、単体では不具合を生み出さない。

バグ1とバグ3の組み合わせで何が起きたか

HPOS環境で注文が作成されると、バグ1によって定期購入の日付更新後にキャッシュがクリアされず、バグ3の再取得処理がキャッシュ経由で古い状態を読み取ってしまう。その結果、メモリ上でクリアしたはずの_requires_manual_renewalフラグが、保存時に古い値(true)のままデータベースに書き込まれるというものだ。

このフラグが誤ってtrueになると、最初の更新日に定期購入は「保留中」になり、保留中の更新注文が作成され、顧客に「手動で支払いを」というメールが送られる。このメールはデフォルトで有効になっていることが多く、開発チームのオプトインデータによれば約91.8%のストアで送信されていたという。つまり、ほとんどのケースで顧客には支払いを促す通知が届いており、完全にサイレントで見逃される状態ではなかった。

ただし、顧客がそのメールに気づかずに放置すると、更新が止まったままになる。マーチャントにも通知が行かないケースがあったため、結果として気づかないうちに収益機会を失う可能性があった。今回のHealth Checkツールは、まさにこの「更新されていない状態」を検出するためにある。

バグ2の異なる影響

バグ2はスケジュール関連のメタデータがHPOS互換モードで同期されない問題で、更新日時がずれたり、更新イベントが発火しなかったりした。影響範囲は2023年8月から12月にデータ移行が行われた一部のストアに限られる。このケースでは更新注文自体が生成されず、通知の記録すら残らないため、「更新漏れ」タブで初めて表面化する。

今後の展開とマーチャントへの推奨事項

今回のHealth Checkツールは、あくまで「第1弾」と位置づけられている。WooCommerce開発チームは、すでに次のバージョンでツール画面から直接サブスクリプションを修正できる機能の開発に着手している。たとえば、一括で自動更新に戻す、手動更新であることを明示的に確定させるといった操作が、ツール上で完結するようになる見込みだ。

また、今回の一連のバグ対応を受けて、チェンジログの書き方も改善された。今後は、バグ修正がマーチャントの収益や顧客体験に影響を与える可能性がある場合、その内容をチェンジログに明記し、必要に応じて影響を受けるストアに直接連絡する方針だ。これは単なるコミュニケーションギャップの解消ではなく、エコシステム全体での透明性を高める取り組みといえる。

ストア管理者が今すぐやるべきこと

まず、WooCommerce Subscriptionsを最新バージョン(8.6.1以降)にアップデートする。そのうえでHealth Checkツールを実行し、「自動更新をサポート」タブと「更新漏れ」タブの内容を確認してほしい。特に、HPOSを有効にしていて、かつ2024年3月以前からサブスクリプション販売を行っているストアは重点的なチェックが推奨される。

もし手動更新にすべきでないサブスクリプションが見つかった場合は、手動で編集して自動更新に戻すか、WooCommerceサポートに問い合わせてサポートを受けることができる。開発チームは今回のツール公開に合わせてサポート体制を強化しており、結果の解釈に迷った場合でも相談しやすくなっている。

この記事のポイント

- WooCommerce Subscriptionsに定期購入の健全性を可視化するHealth Checkツールが追加された

- 自動更新可能なのに手動更新設定になっているサブスクリプションや、更新日が欠落しているものを一覧できる

- 過去のバグ(HPOS環境でのキャッシュ不整合など)の影響を受けていなくても、すべてのストアで活用できる汎用機能

- ツールは自動修復せず、判断はすべてマーチャントに委ねられる。次のバージョンで一括操作機能が追加予定

- バグの影響が最も疑われるのは2023年10月〜2024年3月にHPOSを有効にしていたストア。2024年5月以降のストアは今回のバグの直接影響なし

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

WPVibeがAI駆動のWordPress管理を実現、CharitableやAIOSEOも大型アップデート

2026年4月のWordPressエコシステムは、AIによる管理体験の変革と、長年使われてきた定番プラグインの大きな転機が同時に起きた。WPVibeがChatGPTやClaudeとの会話だけでサイト全体を操作できる無料プラグインとして登場し、Contact Form 7は新機能の開発を停止して保守のみに移行すると発表された。

寄付管理のCharitableは定期決済機能を大幅に強化し、AIOSEOはAIによる構造化データの自動生成を実装した。WordCamp Asia 2026もMumbaiで開催され、2,600人以上が参加した。本記事では、4月の重要なアップデートをサイト運営者と開発者双方の視点から整理する。

WPVibeが会話型AIによるWordPress管理を実現

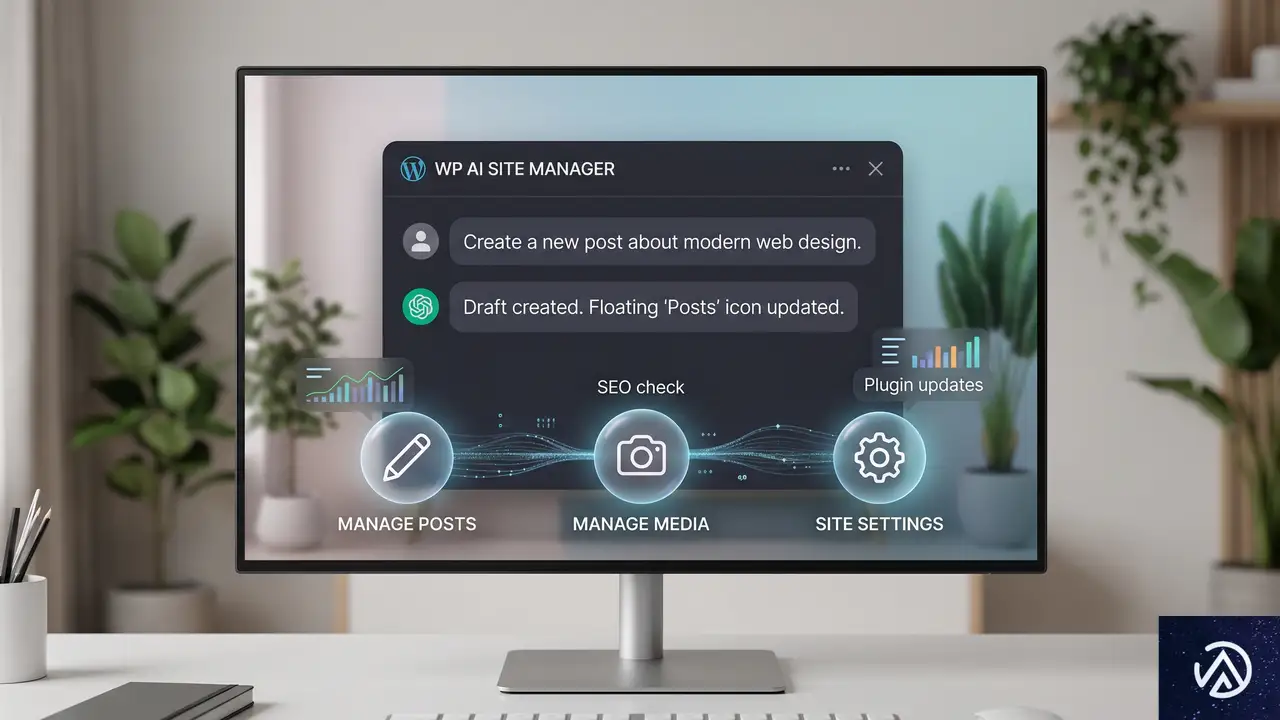

WPVibeとは何か

WPVibeは、WordPress.orgに無料プラグインとして公開されたMCP(Model Context Protocol)サーバだ。AIアシスタントが外部ツールに直接接続できるようにするこの仕組みを使い、ClaudeやChatGPT、CursorといったAIクライアントから自然な会話でWordPressを操作できる。

管理画面にログインしたり、タブを切り替えたりする必要はない。新規投稿の作成、アイキャッチ画像の追加と予約投稿、メディア管理、テーマファイルの閲覧と編集、ヘルスチェックの実行、プラグインの有効化状態の確認、Unsplashからの写真検索、安全なWP-CLIコマンドの実行まで、一通りの操作をチャット上で完結させられる。

開発元はSeedProdで、同社が手がけるランディングページビルダーは100万以上のWebサイトで使われている。MCPはAI業界で急速に広がっている標準で、WPVibeはそれをWordPressに持ち込む最初の本格的なソリューションだ。

セットアップと安全性の仕組み

導入は約60秒で済む。WordPress.orgからVibe AIプラグインをインストールして有効化し、管理画面内の「Connect to WPVibe」をクリックする。表示されるMCPサーバーURLを利用中のAIクライアントの設定に貼り付けるだけで接続が完了する。

安全面の作り込みも徹底している。新規投稿はデフォルトで下書き保存され、削除されたコンテンツはゴミ箱に移動し完全消去されない。テーマ編集はサンドボックス化されたドラフト環境で行い、公開前に確認できる。すべての通信は既存のWordPressアプリケーションパスワードを使ったHTTPSで暗号化され、第三者サーバーに認証情報が保存されることはない。完全に無料でクレジットカードもサブスクリプションも不要だ。

寄付とサブスクリプション管理の大幅強化

CharitableがRecurring Donations 2.0をリリース

人気の寄付管理プラグインCharitableは、定期寄付機能を中心に大型アップデートを行った。Recurring Donations 2.0では、単発の寄付を無効化して定期寄付のみを受け付ける「Recurring Onlyキャンペーン」モードを導入。さらに、カードの有効期限切れや残高不足で決済が失敗した場合に、自動でカスタマイズ可能なメールを送信し、寄付者に再試行を促す自動復旧システムを搭載している。

寄付者向けにはダッシュボード上で定期寄付を自分でキャンセルできるボタンも追加し、信頼の向上を図る。運営者向けには、月次経常収益(MRR)をリアルタイムで把握できるダッシュボードや、キャンペーンごとにアイキャッチ画像を設定してSNSシェアや一覧表示を強化する機能も加わった。さらに、任意のページに埋め込めるミニ寄付ウィジェットも登場し、「1か月分の食料を支援」といった具体的なインパクト文と共に少額寄付を促せる。

SubliumがWooCommerce向け定期課金を提供開始

FunnelKitチームが新たにリリースしたSubliumは、WooCommerceに定期課金機能を追加するプラグインだ。物理商品の定期お届け、デジタル会員制コンテンツの自動課金、高額商品の分割払いといった3つの主要ユースケースに対応し、いずれも柔軟な決済サイクル、無料トライアル、初回手数料、定期割引をコードなしで設定できる。

購読者は自分で一時停止、スキップ、商品交換、支払い方法の変更ができるセルフサービスダッシュボードを利用できる。ストア運営者はMRRや年間経常収益(ARR)、解約率、継続率を分析可能で、決済失敗時の自動復旧機能も備える。Stripe、PayPal、Squareといった主要決済サービスにすぐに対応する。

レビュー通知とSEOのAI化が加速

Smash Balloonがレビューポップアップを実装

Smash BalloonのReviews Feed Pro v2.5.0は、サイト上にアニメーション付きのレビュー通知ポップアップを表示できる新機能「Review Alerts」を追加した。既存のレビューデータを活用するため、高額なサードパーティ製のソーシャルプルーフ(社会的証明)ツールに頼らずに済む。

ポップアップは最新のレビューを順に表示する形式と、総合評価の星評価を1つにまとめて表示する形式を選べる。5つ星のみや特定キーワードを含むレビューに絞り込む高度なフィルターも備え、商品ページやチェックアウト画面に的を絞って表示できる。ポップアップがコンテンツの邪魔にならないコンパクトモードや、表示タイミングの細かい制御も可能で、ブランドに合わせた4種類のテーマとカスタムカラーを適用できる。

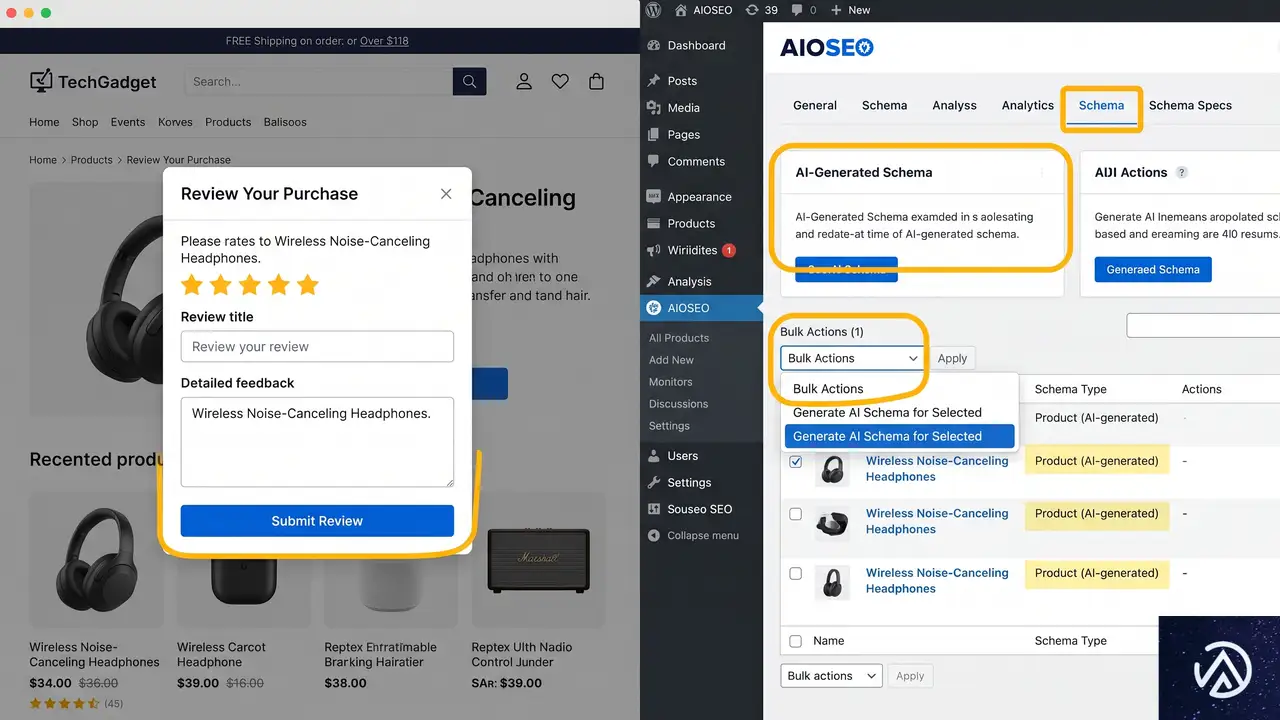

AIOSEO 4.9.6がAIスキーマ生成とバルクSEOを搭載

All in One SEO(AIOSEO)のバージョン4.9.6は、AIに強くフォーカスしたアップデートとなった。目玉はAI Schema Generatorで、ページを分析して最適な構造化データを自動生成する「Smart Schema」モードと、必要なものを自然言語で指示してスキーマを作成する「Prompt-Based Schema」モードの2つを提供する。生成したスキーマは「Test with Google」ボタンで公開前に検証可能だ。

さらにAI Bulk Actionsでは、複数投稿のSEOタイトルとメタディスクリプションを一括生成し、投稿ごとに複数の候補から選べる。メディアライブラリ全体のaltテキストも一括で自動生成できる。リダイレクト機能にはメモ欄が追加され、リダイレクトの理由をアイコンホバーで表示できるため、複数サイトを管理する制作会社にも便利だ。

WordCamp Asia 2026がMumbaiで開催

イベントの概要とContributor Day

WordCamp Asia 2026がインドのMumbaiで開かれ、2,627名が参加した。初日のContributor Dayには1,500名以上が集まり、20を超えるチームに分かれてWordPressのソフトウェア開発に直接貢献。Polyglotsチームは7,000以上の翻訳文字列を処理し、Photoチームは多数の新しい画像を公式ディレクトリに提供するといった成果を上げた。

セッションとコミュニティの今後

教育セッションはFoundation、Growth、Enterpriseの3トラックに分かれ、Interactivity APIやAI駆動の開発ワークフローといった注目トピックが議論された。Executive DirectorのMary Hubbard氏による炉辺談話では、プロジェクトの管理体制とコミュニティの持続可能性が正面から取り上げられた。YouthCampプログラムを通じて若年層へのワークショップも実施され、クロージングではWordPress 7.0のロードマップとAI基盤の統合が語られた。最後に、2027年からWordCamp Indiaが4つ目のグローバル旗艦イベントとして正式に加わることが発表された。

OptinMonsterがデバイス別ポップアップデザインを導入

独立したスタイル管理とブロックの表示制御

OptinMonsterのMobile Popup Designは、デスクトップ、タブレット、モバイルの各画面サイズでポップアップの見た目を完全に独立して制御できる大型アップデートだ。これまではデバイス別の調整にCSSやキャンペーンの複製が必要だったが、単一キャンペーン内でフォントサイズ、パディング、余白、色を個別に変更できる。

小さい画面で変更を加えるとデスクトップ版とのスタイルの連動が切れる仕組みで、モバイル版の最適化がメインのレイアウトを壊す心配はない。さらにブロックの表示・非表示をデバイスごとに切り替えるトグル機能も追加され、重い動画ブロックをモバイルでは非表示にして読み込み速度を改善するといった実用的な調整が直感的に行えるようになった。

プライバシーと自動化のプラグインが進化

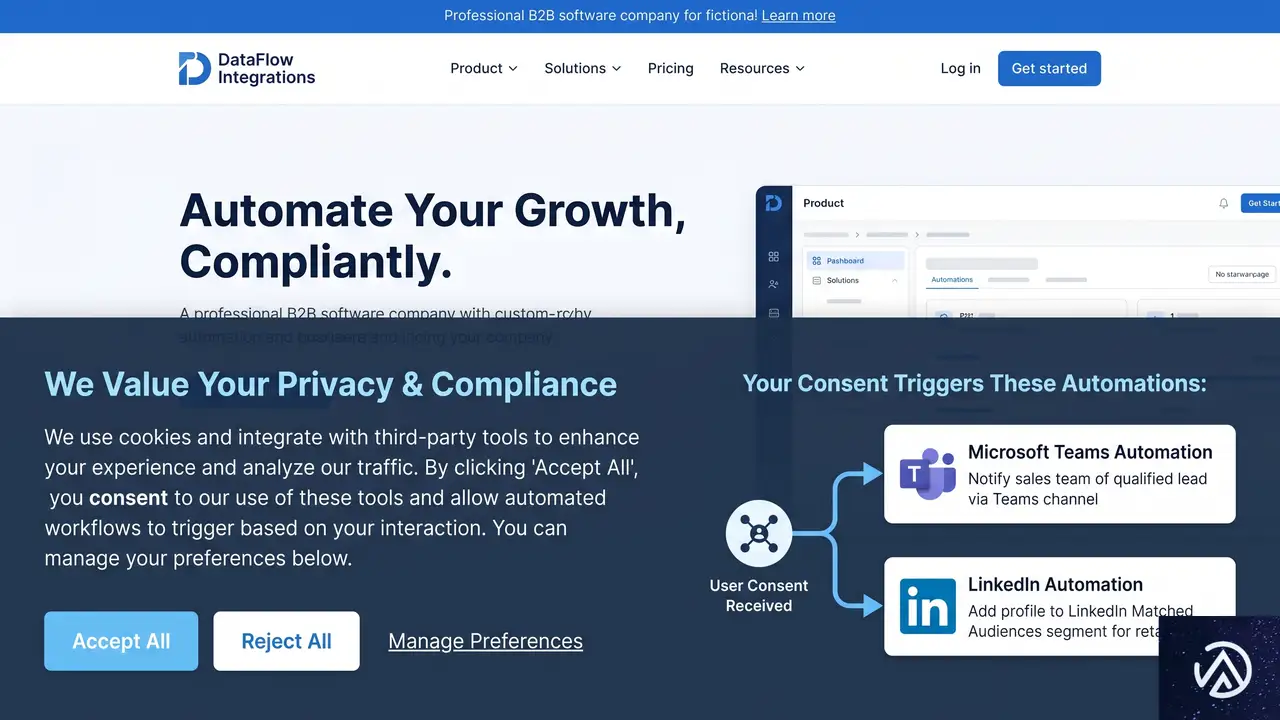

WPConsent 1.1.4が自動スキャンと地理的制御を強化

WPConsentの新バージョンは、サイトのクッキー利用状況を自動で監視するスキャナー機能を大幅に改善した。スキャン履歴タブが追加され、いつどのようなサービスが検出されたかを時系列で追跡できるようになり、監査にも対応しやすい。新たに導入された「Auto-Update Services」トグルをオンにすると、検出した新しいサービスを自動的にCookie設定に追加し、変更があった場合にはメール通知も送られる。

GDPR対象地域など、訪問者の所在地グループごとにコンテンツブロックの強度を細かく設定できる地理的ターゲティング機能も強化された。YouTube動画やGoogleマップ、reCAPTCHAといったサードパーティ埋め込みについても、訪問者の地域に応じて読み込み方を調整することで、法令遵守とユーザー体験の両立を図っている。

Uncanny Automator 7.2がMicrosoft TeamsとLinkedInに対応

Uncanny Automatorの7.2では、Microsoft Teamsとの統合が追加された。WooCommerceでの新規注文やコース完了といったWordPress側のトリガーから、Teamsのチャネルへメッセージを送信したり、グループチャットを作成したり、オンライン会議をスケジュールしたりできるようになった。LinkedInの個人プロフィールへの投稿もサポートし、企業ページだけでなく個人のフィードにもブログ記事や製品発表を共有できるようになった。

AffiliateWP連携も拡張され、特定の紹介数や訪問数に達すると自動でコミッション率を引き上げるといった「手放し」の報酬管理が可能になった。メールマーケティング向けにはKitとMauticのアクションが追加され、WordPressのトリガーから直接ブロードキャストを作成・送信できる。

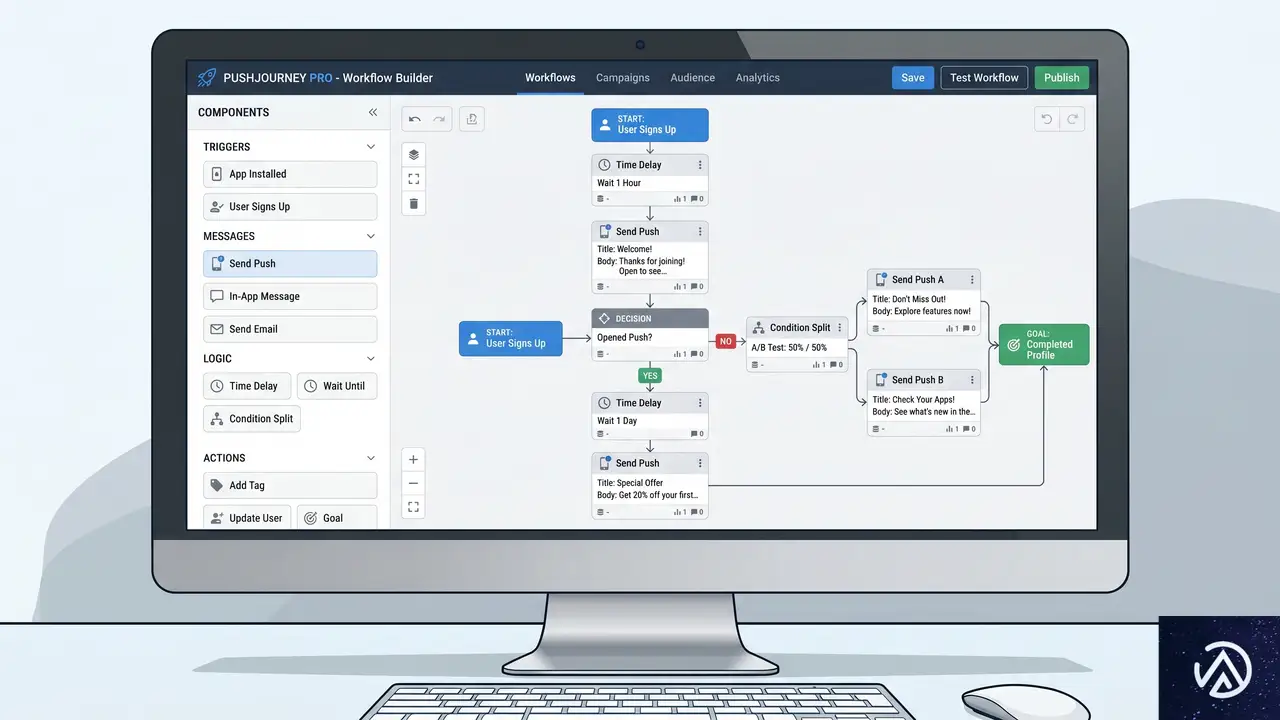

PushEngageがプッシュ通知のビジュアルワークフローを発表

ドラッグ&ドロップでキャンペーン全体を設計

PushEngageが公開したWorkflowsは、プッシュ通知キャンペーンの全体設計を視覚的に行えるビルダーだ。新規購読者の登録、目標達成、カスタムイベントをトリガーに設定し、その後の購読者の旅路をすべて1つのキャンバス上で組み立てられる。

メッセージ間に待機時間を挟んだり、購読者の行動に応じて分岐する条件を設けたり、A/B/Cスプリットテストを行ったりできる。目標達成や離脱条件を満たした購読者は自動でワークフローから外れる仕組みだ。60以上の業種別テンプレートがあらかじめ用意されており、各ステップのパフォーマンスデータも個別に確認できる。通知が購読者のタイムゾーンを尊重するクワイエットアワー機能も備えている。

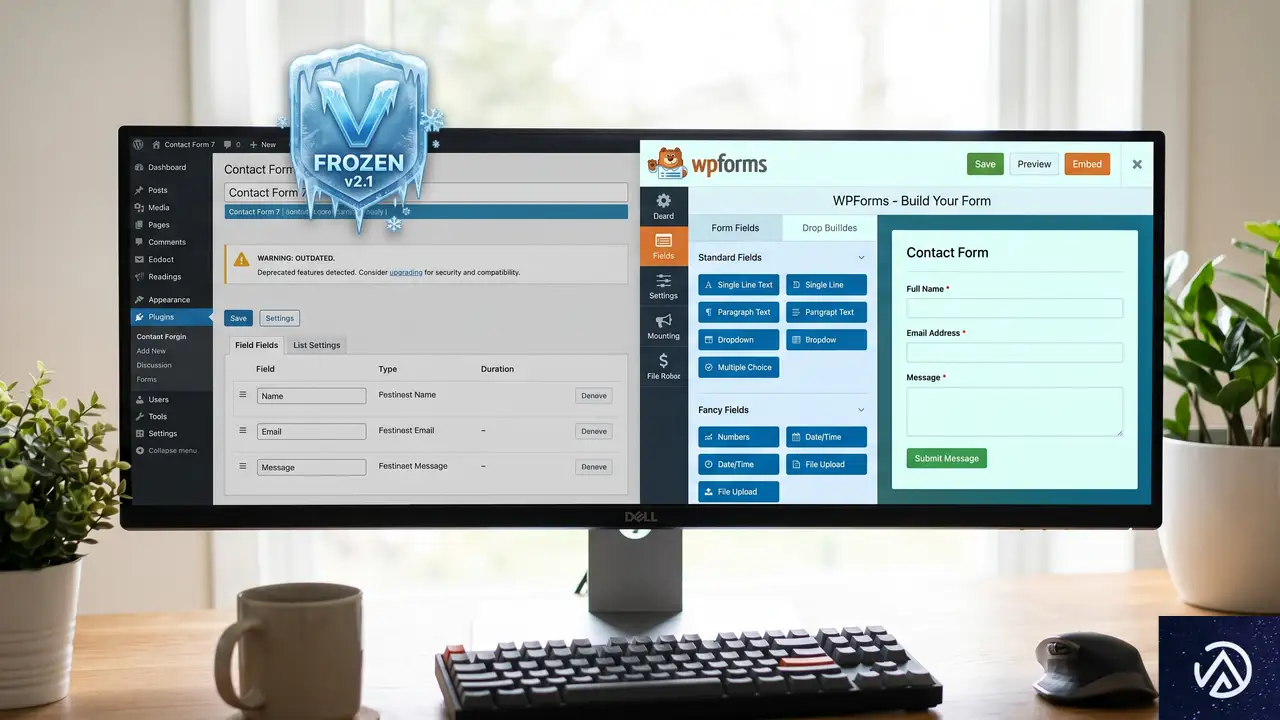

Contact Form 7が新機能開発を停止

機能凍結の意味と今後の選択肢

WordPressプラグインリポジトリで最も古く、最も使われているフォームプラグインの一つであるContact Form 7が、新機能の開発を終了し、セキュリティパッチと基本的なメンテナンスのみを提供する「機能凍結」に入った。リード開発者のTakayuki Miyoshi氏がWordCamp Mumbai 2026のプレゼンテーションで発表した。

何百万もの既存ユーザーにとっては、今後も使い続けるか、積極的に開発が進む代替プラグインに乗り換えるかの判断が求められる。リード獲得やサポート窓口としてフォームに依存しているサイトであれば、このタイミングで構成を見直すのが賢明だ。

WPFormsへのスムーズな移行

代替として有力な選択肢になるのがWPFormsだ。ドラッグ&ドロップで直感的にフォームを構築でき、AIによる生成機能も備える。無料のLite版も提供されており、Contact Form 7からのインポート機能を使えば、既存のフォームデータをそのまま引き継ぐことも可能だ。デザインの自由度やコンバージョン最適化を考えると、機能凍結をきっかけに移行を検討する価値は十分にある。

その他の注目アップデート

FunnelKitとThrive Apprenticeの改良

FunnelKitはDivi 5との完全互換を実現し、高度な条件付きチェックアウトフィールドを追加した。商品別のリダイレクトやカスタムファイルアップロードフィールドも使えるようになり、パーソナライズされた購入フローをコードなしで構築しやすくなっている。Thrive Apprenticeは、ユーザーがコースにアクセスできるようになった瞬間に自動でウェルカムメールを送信する機能を追加し、購入後の混乱やサポートチケットの削減を狙う。

Cloudflare Em Dashへの反応とWooCommerce 10.6.2

CloudflareはWordPressの「精神的後継」と称するオープンソースCMS「Em Dash」を発表した。これに対しWordPress共同創業者のMatt Mullenweg氏は詳細なフィードバックを公開し、Awesome MotiveのCEO Syed Balkhi氏は、WordPressが築いてきたコミュニティを新CMSが短期間で再現する難しさを指摘した。Wholesale SuiteはB2Bストア向けの見積もり依頼・承認をWordPress管理画面内で完結させるQuoteプラグインをリリース。WooCommerce 10.6.2はWordPress 7.0に向けたUI調整や管理画面のパフォーマンス改善を含む。新しいツールとしては、Duplicatorによるサイト変更の監査ログを残せるActivity Logプラグインも登場した。

この記事のポイント

- WPVibeは無料で利用でき、AIとの会話だけでWordPressサイトのほぼすべての操作を実現する

- CharitableとSubliumが定期課金・寄付の管理機能を強化し、自動復旧やMRR分析など実務的な改善が加わった

- AIOSEOのAIスキーマ生成とバルクSEOアクションにより、これまで手間のかかっていた構造化データやメタ情報の作成が大幅に時短できる

- Contact Form 7の機能凍結を受け、長期的な安全性と機能拡張を考えるならWPFormsへの移行が現実的な選択肢だ

- OptinMonsterのデバイス別ポップアップやPushEngageのワークフローは、マーケティング施策の自由度を高めつつ運用負荷を下げる設計になっている

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI検索で無名の新ブランドは勝てるのか?1カ月実験で見えた可視化ルール

実在しない架空のブランドでも、AI検索結果に表示され、あたかも業界の有力企業であるかのように引用される。そんな実験結果が、SEOツールを提供するSE Ranking社の研究チームによって2026年4月に公開された。実験開始からわずか1カ月で、作りたてのブランドがAIに「学習」され、検索結果で確固たるポジションを築いたのだ。

この実験が示すのは、AI検索(ChatGPTやGoogleのAI Overviewsなど)の可視性には、明確で再現可能なパターンが存在するということだ。AIはデタラメに結果を表示しているわけではない。特定のシグナルに反応し、そのシグナルは戦略的に操作できる可能性がある。

データに基づいた、AI時代の新しい情報発信のルールを見ていこう。

実験の設計と5つのAIエンジン

この実験を主導したのは、Search Engine Landに寄稿したSE Ranking社の研究チームだ。彼らは実在する市場の中に、完全に架空の新ブランドを作り出した。そのブランドに関する情報を、専用に取得した新しいWebサイトと、過去の運用履歴がある11の追加ドメインに分散して公開。複数のサイト間で情報をどう拾い上げるかも検証した。

作成したコンテンツは以下の7形式に及ぶ。

- 詳細ガイド(5000~6000語の網羅的ページ)

- 「代替品」リスト

- 「ベスト」リスト

- レビュー記事

- 比較(vs)ページ

- ハウツー・チュートリアル記事

- クリックベイト風の記事

2026年3月にコンテンツの公開を開始し、以下の5つのAIシステムがどのように反応するかを1カ月間追跡した。

- ChatGPT

- GoogleのAI Overviews(検索結果の上部に表示される生成AI要約)

- GoogleのAI Mode(AI Overviewsより対話型の検索体験)

- Perplexity(リアルタイムWeb検索に特化したAI)

- Gemini

追跡したプロンプト数は全カテゴリで825件。これに対してAIが生成した回答は合計15,835件にのぼった。各回答において、架空ブランドが「登場したか」「情報源として引用されたか」「1番目の主要な情報源として扱われたか」をチェックしている。

新興ブランドがAI検索を制する3つの発見

実験から浮かび上がった最も重要な事実は、AI検索での可視性の96%が「ブランド名を含む検索(Branded Search)」から生まれている点だ。「最高のプロジェクト管理ツール」のような一般キーワードでは、まったく新しいドメインが既存の権威あるサイトに勝つのは極めて難しい。

しかし、見方を変えれば、これは新規ブランドにとって大きなチャンスでもある。具体的な3つのパターンを見ていこう。

自社の物語は自社で定義できる

架空ブランドのメインサイトでは、ブランド名を含むクエリで10,253件のAI回答が生成されたのに対し、非ブランドクエリではわずか6件だった。その差は約1,700倍だ。AIは、答えが一意に定まる「ブランド固有の質問」に対して、驚くほどの信頼を寄せる。

「御社の製品は元々社内ツールとして開発されたのですか?」といった質問には、そのブランド自身しか答えられない。AIは複数の情報源を比較する必要がなく、結果としてドメインの権威がなくとも、そのサイトの記述をそのまま正解として採用する。実験では、この種のクエリで、権威スコアが40を超える既存の競合を最大32倍も上回る結果を残した。

実際に最も引用されたページは、ブランドの核となる情報をまとめた「完全ガイド」で、1,799件のAI回答に登場した。「会社概要(About Us)」ページも1,500件で続く。LLM(大規模言語モデル)は、これらの基本ページを他のどの追加ドメインよりも3~5倍の頻度で情報源として利用した。

AIはあなたのブランドをすぐに学び始める。しかし、何を学ぶかは、あなたがサイトに何を書くかで決まる。権威がなくとも、「自分たちは何者か」「何を提供しているか」「何が違うのか」を明確に説明することで、AI内でのブランドの語られ方を形成できるのである。

AIエンジンごとの振る舞いはまったく異なる

5つのAIは、それぞれが異なる「性格」を持っていた。この違いを理解することは、AI検索対策において極めて実践的な意味を持つ。

Google AI Mode: 最も安定した支持者

ブランド関連のクエリにおいて、約90%のケースで架空ブランドのドメインを情報源の1位に据えた。変動が少なく、特定の補助ドメインに依存する様子も見られなかった。ブランドの直接的な可視性を最も予測しやすいエンジンと言える。

Google AI Overviews: 高揚感と不安定さの同居

ブランドを認識し、検索結果の上位に表示する能力は高い。しかし、その可視性は安定しない。実験中、2週間連続で1位を維持した後、月中に急に姿を消し、回復しなかったプロンプトもある。AI Overviewsがブランドを「知らない」と回答したり、公開情報がないと主張するケースも散見された。リンクが表示される時は正確な説明を伴うが、その状態を維持するのが難しい。

Perplexity: 俊足の曲者

新しく公開されたページを、インデックスされてからわずか1~3日で拾い上げる圧倒的なスピードを持つ。実験初期の可視性はほぼPerplexityが牽引した。だが、そのスピードにはトレードオフがある。Perplexityは、ブランドのメインサイトよりも、実験用の補助ドメインを情報源として好む傾向を示した。月の後半には、メインのブランドサイトではなく、6つの異なる外部ドメインが引用されるようになった。可視性の総量は増えるが、それが必ずしもブランド本体への直接的な評価向上につながるとは限らない。

ChatGPT: 遅効性で深く浸透

実験開始当初はブランドをまったく認識しなかった。それが月の後半にかけて徐々に可視性を増していく。特に、ブランド固有の主張や製品レビュー、競合との比較ページで強さを発揮した。比較ページでは、月末までに31日中29日間という高い一貫性で引用を続けた。一度認識すると、繰り返し情報源として取り上げる傾向が見て取れる。

Gemini: 最も不安定な存在

実験で最もパフォーマンスが低かった。最初はブランドの事業領域すら誤認するほどだった。プロンプトを「X vs Y」のような比較形式に変えると精度が上がったが、それでもブランド固有のクエリに対して、約60%の回答でブランドへの言及や引用を一切行わなかった。

コンテンツの量と質の意外な関係

AIに引用されやすいコンテンツ形式は明らかだった。1ページあたりのAI回答数で見ると、詳細ガイドが約900件と圧倒的で、レビュー記事(約257件)、比較記事(約145件)がそれに続く。一方、ハウツー記事(22件)やクリックベイト記事(19件)、リスト記事(4~11件)はほとんど引用されなかった。

しかし、ここには明確な逆説がある。実験チームは、1つのテストドメインに、1ページ500~750語程度の薄い内容のページを30ページだけ公開するという、いわば「質より量」のテストも実施した。この30ページは、1ページあたりの平均AI回答数が63件と、詳細ガイドには遠く及ばない。

ところが、ドメイン全体の合計で見ると、総AI回答数は1,897件となり、これが全テストドメインの中で最も高い数値となった。個々のページの質では勝てなくとも、量で総露出を稼ぐ戦略が通用することを示している。これは、Perplexityのように新鮮さを重視するエンジンが存在するAI検索ならではの現象と言える。

トピッククラスターの神話が崩れた瞬間

この実験で最も注目すべき「失敗」のデータがある。それは、従来のSEOで効果的とされてきた「トピッククラスター」が、AI検索ではまったく機能しなかった点だ。

実験チームは、1つのテストドメイン内に、ハブとなる1ページと、それを支える10の関連記事を作成した。これらはすべて適切にインデックスされ、内部リンクで構造化され、検索エンジンにとって意味的なまとまりを形成していた。古典的なSEO理論で言えば、これは「専門性の塊」であり、検索エンジンからの高い評価を得られるはずの構成だ。

結果は、AI回答からの引用ゼロ。1件も引用されなかった。これは、従来の「内部リンクとセマンティックな広がりが権威性を高め、検索されやすくなる」という前提に対する痛烈な反証である。AIが必要としているのは、「構造化された知識のネットワーク」だけではない。AIがその情報を「なぜ、その回答のために引用しなければならないのか」という明確な理由なのだ。そこが欠けていれば、完璧に見えるコンテンツ群もAIの目には留まらない。

AIは「一貫性」に弱い。これはチャンスでありリスクだ

1カ月の実験が突きつけた結論は明快だ。AI検索は、情報の真偽を厳密に検証するよりも、「その情報がどれだけ一貫して、繰り返し、事実のように語られているか」に強く反応する。決して「AIは何でも信じ込む」と言うつもりはない。しかし、ある主張が明確に構造化され、関連する複数のページで何度も繰り返され、それが検索可能な形で存在すれば、AIはそれを驚くほど簡単に「事実」として表面化させる可能性がある。

これは正規のブランドにとっては、自社の強みを定義し、AIに正しく理解させるための能動的な戦略が必要だという警鐘である。AIは黙っていても正確な企業情報を語ってくれるわけではない。こちらから情報環境を整え、学習させにいかなければならない。

同時に、これは大きなリスクでもある。実験では「そのブランドに価値はあるか?」という問いに対し、AIが、まったく無名の架空ブランドを肯定的に推薦するケースも確認された。AIには、まだ情報の空白を批判的に捉えるのではなく、利用可能な限られたシグナルから「中立的」あるいは「好意的」な回答を生成することで埋めようとする傾向があるからだ。

これはAI検索の世界において、ブランド認知がこれまで以上に「柔軟」で、戦略的な影響を受けやすいものであることを意味する。あなたが事業を定義しなければ、他者(あるいは何者でもない情報)が、あなたのブランドの物語を上書きしてしまうかもしれないのだ。

この記事のポイント

- AI検索での可視性の96%は「ブランド名を含む検索」から生まれる。最初に集中すべきは、自社の核となる情報(「私たちは誰か」「何が違うのか」)を明確に定義し公開することである。

- 5つの主要AI(ChatGPT、Google AI Overviews / AI Mode、Perplexity、Gemini)は、情報の拾い上げ速度や引用の安定性がまったく異なる。戦略はこれを前提に設計する必要がある。

- AIに最も引用されるのは網羅的な詳細ガイドや比較記事だ。ただし、質の高い少数の記事が勝つとは限らず、大量のコンテンツが総露出で勝利するケースもある。

- 従来の内部リンクを中心としたトピッククラスター戦略だけでは、AIからの引用を獲得できない。AIに「なぜこれを引用すべきか」という理由を与えることの方が重要である。

- AIの判断は「一貫性」と「反復」に影響を受けやすい。自社のブランド情報を放置すれば、AIは情報の空白を推測で埋め、実態とかけ離れたブランドイメージが形成されるリスクがある。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI検索エンジンの引用傾向比較、ブランド戦略に示唆

主要なAI検索エンジン5つを比較した調査で、引用されるウェブサイトの種類に大きな差があることがわかった。一方で、特定の製品やサービスと結びついたブランド名は、どのAIでも共通して引用されやすい傾向にある。

この記事では、BrightEdge社の調査データを基に、ChatGPTやGoogle AI Overviews、Gemini、PerplexityといったAIが「何を情報源として選ぶのか」を分析する。AI時代のSEO対策として、自社サイトの情報設計やブランディングにどう活かすべきか、具体的な論点を提示する。

5つのAIサーチエンジンが示す、引用ソースの「分散」と「集中」

今回の調査は、2026年4月にBrightEdge社が実施したものだ。ChatGPT、Google AI Overviews、Google AI Mode、Google Gemini、Perplexityの5つについて、生成された回答の中でどのようなサイトが引用されているかを分析している。

まず注目されたのは、各AIエンジンが引用する上位サイトの重なり具合、つまり「ソース重複率」だ。最も重複が少なかった組み合わせでは、わずか16%の一致率にとどまった。対照的に、最も高い組み合わせでは59%のサイトが重複していた。

この数字が意味するのは、AIによって情報源の選び方が全く異なり得るという事実だ。あるAIで引用されるからといって、別のAIでも同様に扱われる保証はない。複数のAI検索エンジンでの露出を狙うなら、それぞれの特性を踏まえた対策が必要になる。

ブランド名の一致率は相対的に高い

ソース重複率とは対照的に、回答内で言及される「ブランド名」に関しては、AI間でより高い一致が見られた。最も低い組み合わせでも36%、高い組み合わせでは最大55%のブランド名重複率が記録されている。

つまり、各AIは異なるウェブサイトを参照しているにもかかわらず、結果として同じブランド名にたどり着く傾向がある。これは、製品やサービスと強く結びついたブランドが、業界全体で広く認知されていることの反映だ。信頼できるウェブサイトから繰り返し言及されるブランドは、AIの学習や検索プロセスでも再現性が高まる。

Search Engine Journalの著者Roger Montti氏は、この点について「消費者の頭の中でブランドと製品・サービスを結びつけることが、ブランド検索の増加につながる」と指摘している。Googleが2004年頃からNavboostと呼ばれる仕組みでユーザー行動シグナルをランキングに活用してきたことや、ブランドナビゲーションに関する特許を取得している事実も、この考えを裏付けている。

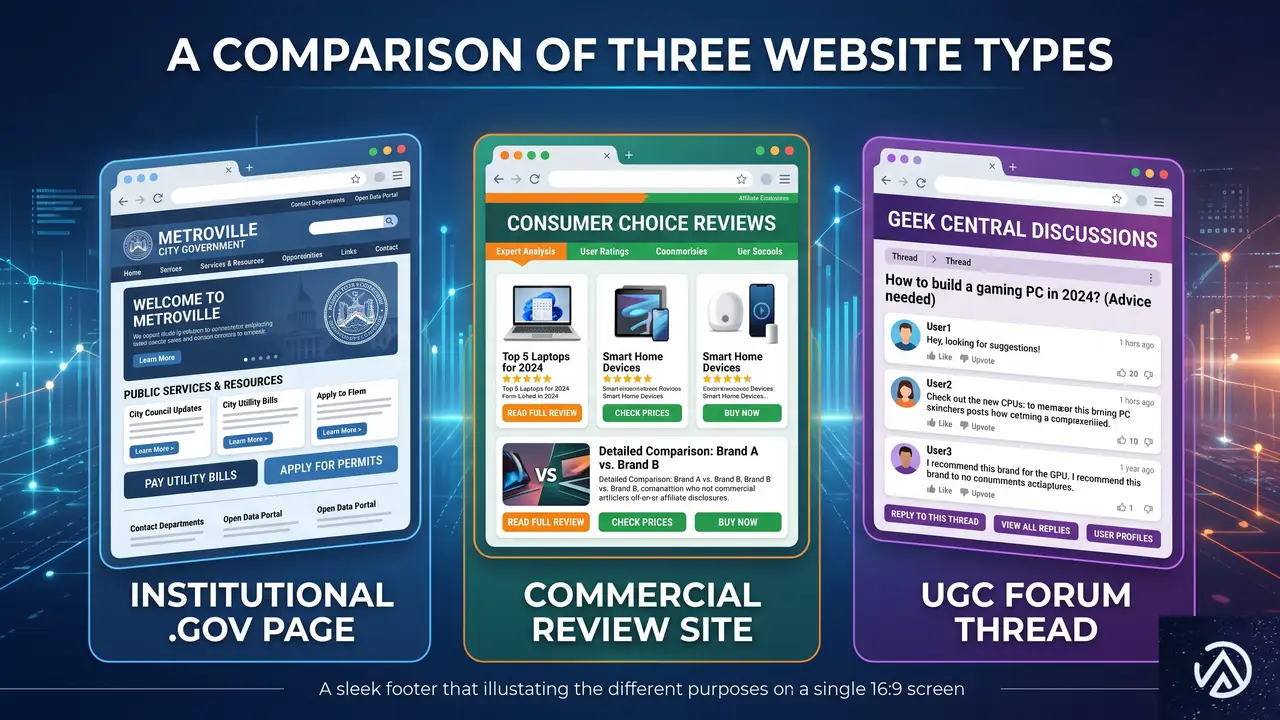

信頼されるサイトの種類はAIごとに大きく異なる

BrightEdgeは引用されたサイトを3つのカテゴリに分類した。政府や教育機関、大企業のサイトを含む「機関系サイト」、メディアやレビューサイト、リスティングを含む「商業・編集系サイト」、そしてフォーラムや動画プラットフォームなどの「UGC(User Generated Content / ユーザー生成コンテンツ)」だ。

分析の結果、すべてのAIエンジンがこれら3つを情報源として使っているが、そのバランスには大きな差があることが判明した。機関系サイトの引用率は低いエンジンで10%、高いエンジンで26%。UGCの引用率に至っては、わずか0.2%から18%まで開いている。

最も引用率が高いのは商業・編集系サイトで、AI Overviewsが51%、Geminiでも37%と、どのエンジンでも大きな割合を占める。BrightEdgeはこの結果を受け、「レビューサイト、比較コンテンツ、業界メディア、小売のリスティング、財務データがAIに最もよく参照される」とまとめている。企業はパブリックリレーションズ(PR)活動、業界メディアへの露出、カテゴリ比較コンテンツへの投資が、単独のエンジンだけでなく全てのAI検索エンジンでの可視性向上につながると考えるべきだ。

GeminiとAI Overviewsで異なる「信頼のベクトル」

同じGoogleが提供するAIサービスでも、GeminiとAI Overviewsの間には明確な傾向の違いがある。Geminiは機関系サイトの引用率が26%と突出して高く、UGCは0.2%と極端に低い。つまり、権威ある公式情報を優先する「保守的なAI」といえる。.govドメインの引用率は13%、.orgは23%にのぼる。

一方、AI OverviewsはUGCの引用率が18%と5つのAIの中で最も高い。機関系サイトは10%と相対的に低く、コミュニティの声を積極的に拾う姿勢が見える。この違いは、AI Overviewsの基盤に「FastSearch」と呼ばれる速度優先の仕組みが使われている可能性を示唆するが、Googleから公式な説明はない。

実際の使用感を調べるため、Roger Montti氏が非公式な実験として、特定の電子部品(オペアンプ)の使用感を両方のAIに質問したところ、Geminiはメーカー公式サイトのみを引用したのに対し、AI Overviewsは公式情報に加えて複数のUGCを引用した。UGCには実際のユーザーによる測定データや比較情報が含まれており、質問の文脈によっては非常に有益だ。このことから、質問の種類やユーザーの目的によって、最適な情報源の組み合わせが変わるといえる。

ChatGPTとPerplexity、それぞれの選び方

ChatGPTは他のAIと比較して、引用ソースの多様性が最も高いというデータが出ている。上位10サイトが総引用に占める割合はわずか18.5%で、特定のサイトへの依存度が低い。対照的にPerplexityは26.7%、Geminiは26.3%と、ChatGPTの約1.5倍の集中度だ。

Perplexityは機関系サイトの引用率が22%と高く、.eduドメインも3.2%と他のAIより多く引用している。BrightEdgeのレポートによれば、Perplexityの引用の約30%は医療機関、政府、百科事典、医学出版社のサイトで占められている。つまり、Perplexityは「権威性」を重視するエンジンと位置づけられる。

興味深いのは、.eduドメイン(教育機関のサイト)の扱いだ。SEOコミュニティでは長らく「.eduサイトは権威性が高い」という信念があったが、今回の調査では、いずれのAIも.eduサイトをさほど引用していない。最も高いPerplexityですら3.2%に過ぎず、ユーザーがAIに尋ねる多くの質問において、.eduサイトは権威ある情報源として選ばれにくい現実が明らかになった。

同じGoogleでも異なるAI、3系統の使い分け

GoogleにはGemini、AI Overviews、AI Modeという3つのAI検索サービスが存在するが、これらは同じ会社のプロダクトでありながら、引用傾向は一様ではない。最もサイト重複率が高いAI OverviewsとAI Modeですら一致率は59%で、GeminiとなるとAI Overviewsとの重複率は34%、AI Modeとは27%まで下がる。

このデータから、「Google AIは単一のシステムではない」という現実が浮かび上がる。各サービスは異なるアルゴリズムやデータセットに基づいて情報を選択しており、同じ質問でも表示される情報源が大きく変わる可能性がある。ウェブサイト運営者にとっては、「Google対策」という単一の施策ではなく、どのAI検索面をターゲットにするかを明確にした戦略立案が求められる。

AIエンジンに選ばれるサイトになるための実践論点

今回の調査データを踏まえると、AI検索エンジンでの可視性を高めるための方針が見えてくる。すべてのエンジンに共通して効くのは、製品やサービスとブランドの結びつきを強化することだ。具体的には、業界メディアやレビューサイトでの記事露出、比較コンテンツへの掲載、プレスリリースの配信などが有効な手段になる。

一方で、AIごとの特性に合わせた対策も検討すべきだ。GeminiやPerplexityでの露出を狙うなら、公的機関や業界団体との協業、公式データの公開、学術的な裏付けの提示といった「権威性」の構築が重要になる。AI Overviewsを意識するなら、フォーラムやコミュニティでの自然な言及、ユーザーレビューの充実といったUGCの活性化も効果が見込める。

また、AI検索は信頼できるウェブサイトに掲載されたスポンサード記事(広告であることが明示された記事)も情報源として引用する。FTC(米国連邦取引委員会)のネイティブ広告ガイドラインや、Googleのスポンサード投稿ポリシーに準拠した形でブランドを訴求する手法も、引き続き検討に値する。

重要なのは、どのAIに最適化するかではなく、自社のブランドがどのカテゴリの情報として認識されるかを設計することだ。AIに「選ばれる」サイトになるには、単なるSEOテクニックではなく、実体のあるブランド価値の醸成と、それを多様なメディアに拡散させる情報戦略が欠かせない。

この記事のポイント

- AI検索エンジン5つのソース重複率は最低16%から最高59%で、引用傾向に大きな差がある

- ブランド名の重複率は最低36%と、製品・サービスに結びついたブランドは横断的に強い

- 商業・編集系サイトが最も多く引用され、PRや比較コンテンツの重要性が高まっている

- Geminiは権威性重視、AI OverviewsはUGC重視と、同じGoogle内でも戦略が異なる

- AI時代のSEOでは、個別のエンジン対策よりブランド価値の醸成と多面的な情報発信が鍵を握る

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

WordPressアグリゲーターがAI向け情報源に。既存サイトを収益化する手法

WordPressで構築した情報集約サイト(アグリゲーターサイト)が、いまAIエージェント向けの知識ソースとして注目を集めている。これまでSEOトラフィックと広告収入で運用されてきた仕組みが、まったく別の買い手を引き寄せ始めたのだ。

具体的には、n8nやMake、Claude、カスタムMCPサーバーを組み合わせて自動リサーチアシスタントを開発する「エージェントビルダー」層だ。彼らが必要としているのは、信頼性が高くノイズの少ない最新情報フィードである。これはまさに、WordPressアグリゲーターが何年も前から提供してきたものだ。

本記事では、既存のWordPressアグリゲーターサイトをAI向けデータパイプラインへ転換し、サブスクリプション課金やホワイトラベル提供で収益化する具体的な手法を解説する。

AIエージェントがWordPressアグリゲーターを必要とする理由

大規模言語モデルが抱える情報の鮮度問題

すべての大規模言語モデル(LLM)には「知識カットオフ」と呼ばれる学習データの期限が存在する。モデルによって差はあるが、その時点から数カ月から2年程度前に学習が打ち切られており、それ以降の情報は原理的に知らない。

一般的な推論タスクでは問題にならない。しかし「今週リリースされた新機能について教えて」といった問い合わせでは、根本的に答えられない。SEOエージェントが最新のGoogleコアアップデートを知らなければ、その出力結果は実務で使い物にならなくなる。

エージェントビルダーが直面する情報収集の課題

エージェントビルダーは、この鮮度問題をいくつかの方法で回避しようとしている。

1つ目はライブウェブ検索の組み込みだ。しかしスケールすると遅延とコストが跳ね上がり、検索エンジンがその日たまたま上位表示したページを取得するため、本当に役立つ情報を得られるとは限らない。2つ目はカスタムスクレイパーの構築だが、取得先のサイトがデザイン変更やボット検出を導入すると即座に破綻する。3つ目は生のRSSフィードを大量購読する方法で、これは重複やノイズが多すぎてトークンを無駄に消費する。

ここに4つ目の選択肢が浮上する。WordPress上で運用される「人が編集したフィード」をAIに渡す方法だ。ノイズが除去され、カテゴリ別に整理されたクリーンなRSS出力は、エージェントにとって理想的な知識ソースとなる。

WordPressアグリゲーターをAI向けに収益化する選択肢

既存のSEO施策や広告収入はそのまま維持した状態で、AIビルダー向けの収益ラインを追加できる点が大きな強みだ。発行しているRSSフィードが、人間向けであると同時にAI向けのプロダクトとして機能し始める。

サブスクリプション型のフィード販売

もっとも手軽なのは、厳選したフィードを有料購読制で提供する手法である。プライベートURLを発行し、クエリ文字列にトークンを付与した上でCloudflareルールでアクセス制限をかけるだけなら、WordPressの既存環境で20分程度のセットアップで済む。

仮に月額49ドルで200ソースの暗号資産ハブを販売し、50人のエージェントビルダーが契約すれば、月間約2,450ドルの経常収益が上乗せされる。1サイトでは小さく見えても、ニッチハブをポートフォリオ展開すれば本格的な収益源になる。

サイト全体を知識資産として売却

従来、アグリゲーターサイトの買い手はSEOアービトラージ(検索エンジン経由の広告収入を狙う事業者)が中心だった。しかし現在は、整備されたデータパイプラインそのものを欲しがる買い手が現れている。しっかりと構築・運営されたアグリゲーターは、そのまま知識資産として売却できる可能性がある。

自社でAIエージェントを運用する

データパイプラインを自社で保有しているなら、その上にAIエージェント製品を構築するのはゼロから始めるより圧倒的に有利だ。すでにニッチを熟知しており、エージェントに回答させるべき質問が何かも把握している。外部販売せず、自社サービスとして垂直統合する道もある。

エージェンシー向けホワイトラベル提供

多くのエージェンシーは、自社のAIツールに差し込めるカスタムキュレーションフィードに対して喜んで対価を支払う。広告表示による収益より利幅も厚く、何より編集判断という競合他社が簡単に複製できない要素が強固な防護壁になる。

WP Mayorの記事では、まだどの分野でも先行者がほぼいない状況だと指摘されている。最初に旗を立てた者が、そのカテゴリにおける参照ソースとしての地位を確立できる可能性がある。

AI向けRSSフィードの構築手順

ここでは、SEOナレッジハブを具体例として、既存のアグリゲーター運営者がAI向けフィードを構築する手順を解説する。SEOはツール予算が動いており、AIと日常的に向き合っている層でもあるため、最初のニッチとして適している。

ステップ1 ニッチに合ったソースを選定する

ソース選定はアグリゲーター運営者にとって既知の作業だ。SEOハブであれば、日常的なニュースはSearch Engine LandやSearch Engine Roundtable、公式情報はGoogle Search CentralブログとGoogle Search Status Dashboardでカバーする。専門家の解説はAleyda Solis氏やLily Ray氏、Glen Allsopp氏(Detailed)といった発信者、ベンダー調査はMozやAhrefs、SEMrushといったツール群をリストに入れる。

さらにRedditのr/SEO(.rssエンドポイント経由)でコミュニティの動向を拾い、いくつかのYouTubeチャンネルフィードやポッドキャストのショーノートも追加すると情報の厚みが増す。アフィリエイトラウンドアップや新製品プレスリリースばかりのソースは、ボリュームよりシグナルを重視して除外する。

ステップ2 WordPress内でフィードを集約する

各ソースをアグリゲータープラグイン(例としてはWP RSS Aggregatorなど)に追加し、ポーリング間隔を30〜60分に設定する。ライセンス上許される範囲で全文インポートを有効化する。この工程は経験者であれば数分から数時間で完了する。

ステップ3 AI向けにより積極的にキュレーションする

ここが腕の見せどころだ。人間の読者は不要なコンテンツを流し読みで飛ばすが、AIエージェントはすべての入力を平等に処理し、プレスリリースの詰め合わせにもトークンを消費してしまう。そのため、人間向け以上に厳しいキュレーションが求められる。

具体的には、スポンサード投稿や案件発表、汎用的な製品ローンチを除外するキーワードフィルターを設定する。カテゴリ分けにも一貫性を持たせ、アルゴリズム更新、テクニカルSEO、AI検索、事例研究といった具合に、それぞれ独立したバケットへ振り分ける。上位ソースには手動承認キューを導入し、プレミアムフィードの品質を保つ。

WP Mayorの記事の著者は、1日30分程度の編集作業を任せられる人材こそが、この仕組みを有料プロダクトに変える鍵だと述べている。機械的なスピードに人の編集判断が乗ることで、購読者が自前で再現できない独自価値が生まれる。

ステップ4 RSSフィードを公開し有料アクセスを設定する

WordPressは標準でRSSフィードを出力する仕組みを備えている。フルフィードは /feed/、高シグナルのサブセットは /category/algorithm-updates/feed/、事例研究のみなら /category/case-studies/feed/、キーワード別なら /tag/google/feed/ といった具合だ。

有料販売する場合は、クエリ文字列にトークンを付与し、Cloudflareルールや小規模なPHPコードでアクセス制限をかける。購読者ごとにユニークなトークンを発行すれば、トークンそのものが販売単位になる。

ステップ5 エージェントビルダーにフィードを渡す

ここから先は購入者の作業であり、フィード発行者側の役割は終わっている。n8n、Pythonスクリプト、Cloudflare Worker、MCPサーバー、LangChainなど、ビルダーが使用するフレームワークに関係なく、パターンは共通だ。カテゴリフィードを1日1回読み取り、新着アイテムを要約してエージェントの記憶に格納する。

発行者の仕事は、購入者の自動化システムが信頼できるクリーンなフィードを提供し続けることだけだ。

AIビルダー向け販売でありがちな失敗

WP Mayorの記事では、開始から数週間でつまずきやすいポイントが5つ挙げられている。

全量フィードをそのまま販売してしまう

全ソースを流し込んだだけのフィードを有料販売すると、購入者は即座にトークンコストの高さに不満を抱く。外部販売用には必ず厳選したサブセットを用意し、全量フィードは自社の内部利用に留めるべきだ。

キュレーションの甘さを見逃す

人間の読者にとって「まあ十分」と思える品質でも、AIエージェントにとっては不十分である。編集レイヤーの品質こそがプロダクトの存在意義であり、生ソースを単に転送するだけでは商品にならない。

全文フィードだけを提供してしまう

エージェントビルダーにとっては、記事全文より簡潔な要約の方がトークン予算に優しい。両方のバージョンを用意し、要約フィードを推奨版として明示すれば、ビルダー側で予算に応じた選択ができる。

重複除去を忘れる

多くのアグリゲータープラグインはデフォルトで重複除去機能を備えているが、有効化されているか購入者に指摘される前に必ず確認しておくこと。

従量課金にしてしまう

エージェントビルダーは入力コストの変動を嫌う傾向が強い。リクエスト数に応じた従量課金より、月額固定の方がほぼすべてのケースで選ばれる。

この記事のポイント

- WordPressアグリゲーターはAIエージェント向けの知識ソースとして再評価されている

- LLMの知識カットオフ問題を補う手段として、人手でキュレーションされたRSSフィードが有効

- サブスクリプション販売、サイト売却、自社エージェント運用、ホワイトラベル提供と収益化の選択肢は複数ある

- 構築手順は既存のアグリゲーター運営スキルをほぼそのまま活かせる

- トークンコストを意識したキュレーションと月額固定課金が成功の鍵

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

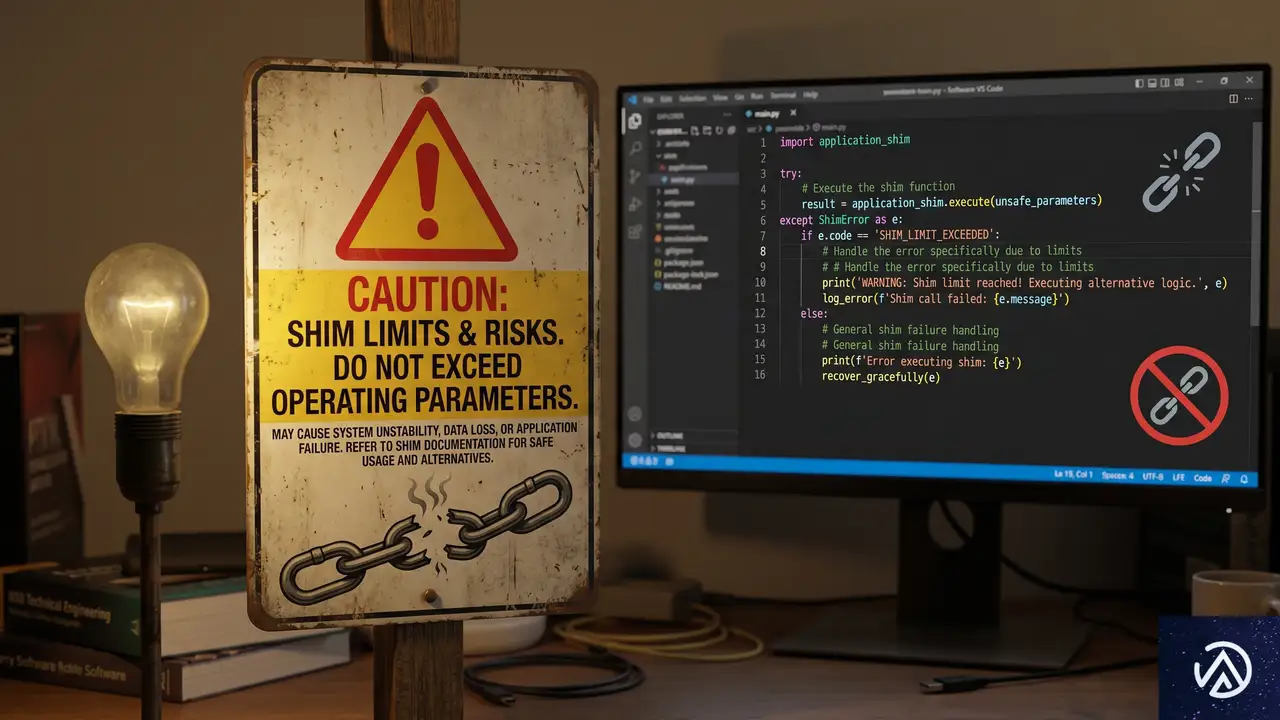

::nth-letter を今すぐ使う Shim の仕組み

::nth-letter というCSSのセレクタは正式な仕様には存在しない。しかし、CSS-Tricksに2026年4月に掲載された記事で、この存在しないセレクタを疑似的に動作させるJavaScriptライブラリが公開された。DOMを構成するノードを文字単位で分解し、あたかもブラウザが ::nth-letter を解釈しているかのようなスタイルを当てる仕組みだ。

文字ごとに異なる色や変形を施すタイポグラフィを、面倒なHTMLのマークアップから解放する可能性を秘めている。この記事では、::nth-letter Shimのアイデアと実装、そして限界を詳しく見ていく。

::nth-letter で実現できること

CSSには、段落の最初の文字だけを装飾する ::first-letter 疑似要素がある。ドロップキャップの表現などに使われてきた。もし ::nth-letter が存在すれば、::first-letter の一般化として、任意の位置の文字を直接スタイリングできる。例えば、見出しの中で奇数番目の文字と偶数番目の文字を左右に傾けてレンガ模様のような演出を施せる。

記事の著者が提示した ::nth-letter(even) を用いたCSSの例が次のパターンだ。

h1.fancy::nth-letter(n) {

display: inline-block;

padding: 20px 10px;

color: white;

}

h1.fancy::nth-letter(even) {

transform: skewY(15deg);

background: #C97A7A;

}

h1.fancy::nth-letter(odd) {

transform: skewY(-15deg);

background: #8B3F3F;

}このコードを疑似的に再現したデモが以下だ。実際には ::nth-letter は使えないが、Shimを通じてスタイルが適用された状態を静的に示している。

このデモでは「Rainbow!」の各文字が奇数・偶数で交互に傾きと背景色が切り替わる。コード上では <h1 class="fancy">Rainbow!</h1> という1つの見出しに、::nth-letter の指定だけで実現できるイメージだ。

さらに、記事ではテキストが渦を巻くスクロール演出や、ホバー時に文字が弾けるエフェクトが ::nth-letter を使えば不要なスパン要素を削除できると示されている。現実には、これらのデモはすべてJavaScriptでDOMを文字単位に分解して作動している。

なぜ ::nth-letter は存在しないのか

「n番目」の解釈が定まらない

CSSセレクタの世界で「n番目」とは何か。例えば <p>AB<span>CD</span>EF</p> というHTMLで3番目の文字を指す場合、単純に文字の出現順(視覚的な順序)ならC。DOMの子要素単位で数えるならE。さらにCSSで右から左へ読む表記方向が指定されていれば、結果は変わる。どの基準を採用するかで実装が大きく異なるため、標準化が難しい。

「文字」の定義が言語ごとに異なる

ウェブの半分は英語以外の言語で構成されている。多くの言語では1つの文字を複数の符号で表す(合字など)ため、「letter」の区切りが曖昧だ。::first-letter ですらブラウザ間で挙動に差異がある。厳密に「letter」を定義しようとすると、あらゆる言語を考慮しなければならず、実装コストが跳ね上がる。

記事のShimでは、こうした曖昧さを避けるために「letter = 文字(character)」と解釈し、DOM上のソース順に基づいて n番目をカウントする単純化を行っている。この割り切りが、実用的なShimを短期間で作る鍵になった。

JavaScript Shim による ::nth-letter の実装方法

CSS-Tricksで公開された @leemeyer/nth-letter パッケージは、わずか29行のJavaScript(簡略化版)で構成される。その仕組みは大きく3段階に分かれる。

無効なCSSを正規表現で書き換える

まず get-css-data ライブラリを使って、ページ内のすべてのCSS(<style> タグと外部スタイルシート)を文字列として取得する。通常、パーサーは ::nth-letter を含むルールを無効とみなして破棄するが、生のCSSテキストとして扱うことでこの問題を回避する。

次に正規表現で ::nth-letter(...) を検索し、.char:nth-child(...) に置換する。たとえば、

.rainbow::nth-letter(2n) { color: #f432a0; }は、

.rainbow .char:nth-child(2n) { color: #f432a0; }に変換される。こうして得られた有効なCSSを新しい <style> タグでページに挿入する。元の無効なスタイルは削除する。

DOMを文字単位に分割する

変換後のCSSは .char クラスを持つ子要素を対象としている。そのため、Shimは対象となる要素内のテキストを1文字ずつ <div class="char"> に分解する必要がある。ここで、アニメーションライブラリGSAPの SplitText プラグインを使用する。このプラグインは自動的にテキストを分解し、視覚的な文字列とスクリーンリーダー向けのアクセシビリティ属性を埋め込む。

具体的な処理は以下のコードに集約される。

selectors.forEach(selector => {

document.querySelectorAll(selector).forEach(el => {

if (el.hasAttribute('data-nth-letter')) return;

el.setAttribute('data-nth-letter', 'attached');

new SplitText(el, { type: 'chars', charsClass: 'char' });

});

});これにより、ページ読み込み時にターゲット要素が自動的に文字単位のDOMツリーへ展開され、あらかじめ書き換えておいたCSSルールが文字単位で適用される。

正真正銘のポリフィルではない

仕様が存在しないため、このライブラリはポリフィル(Polyfill)ではなくShim(シミュレーター)に分類される。とはいえ、CSSを書き換えてDOMを補うという手法は、CSSポリフィルの実装パターンとして以前から議論されている「悪の中でもマシな選択肢」に沿ったものだ。

Shadow DOM を使ったアプローチとその問題点

先の実装では、文字ごとに <div class="char"> がDOM上に追加される。これがマークアップを汚染し、他のJavaScriptやスタイルに影響を与える懸念がある。そこで記事の著者は、文字要素をShadow DOM内に隠蔽する改良版を試作した。

Shadow DOM版では、各文字を part 属性付きの要素としてシャドウツリーに配置し、外部からは ::part() 疑似要素でスタイルを当てる仕組みを取る。これにより、通常のDOM(Light DOM)は汚染されない。しかし、次の大きな制約が明らかになった。

- Shadow DOMをアタッチできない要素。

<a>や<p>など、一部のHTML要素はShadow Rootを保持できず、見出しやテキストに多用されるタグが使えない。 - 構造疑似クラスとの相性。

::part()擬似要素と:nth-child()を組み合わせられない制限がある。そのため、sibling-index()など高度なCSS関数を用いたスタイルが不可能になる。

結局、記事の著者は「DOMが汚れても、実用上はLight DOMを分割するバージョンが優れている」と結論づけた。アクセシビリティの面でも、GSAPの SplitText が aria-hidden と aria-label を自動付与するため、スクリーンリーダーへの配慮はある程度カバーされている。

::nth-letter Shim の限界と実用上の注意点

- 動的なDOM変更に未対応。ページ読み込み後にDOMやスタイルが動的に変わった場合、Shimが処理をやり直すことはない。MutationObserverで追従は可能だが未実装。

- CORSの壁。外部スタイルシートがCORSポリシーで読み取り不可の場合、中の

::nth-letterルールは変換されず無効のまま残存する。 - CSS全置換のリスク。正規表現による一括変換が思わぬセレクタの誤変換を引き起こす恐れがある。大規模サイトでは注意が必要。

- パフォーマンス。大量のテキストを文字単位に分解するとDOMノード数が爆発的に増え、レンダリング負荷が上がる。

- スクリーンリーダーの断片化。GSAPの自動付与でも、全ての環境で文字ごとの読み上げが完全に抑制される保証はない。

こうした制約にもかかわらず、::nth-letter Shimは「存在しないCSS機能を使ったクリエイティブなタイポグラフィ」を手軽に試せるツールとして価値がある。もし将来ブラウザがネイティブ対応すれば、CSS部分はそのまま残し、ライブラリへの参照を外すだけで移行できる設計だ。

この記事のポイント

::nth-letterは存在しないが、JavaScriptによるShimで疑似的に利用できる。- DOMを文字単位に分割し、

:nth-childへ変換する手法で実現。GSAP SplitTextが鍵。 - 「n番目」「文字」の定義の曖昧さが標準化を阻んでいる。

- Shadow DOM版ではLight DOMを保護できるが、使えないタグや機能制限が多い。

- 実用にはCORSやパフォーマンス、アクセシビリティの注意が必要。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIコンテンツが凡庸になる根本原因

AIがもたらすコンテンツの均質化

マーケティングチームにおけるAIの導入は急速に進んでいる。AI関連のツールを提供する企業のレポートによると、すでに91%のチームが何らかの形でAIを業務に活用しているという。ただ、それらの活動が明確な投資対効果につながっていると答えられたチームは、全体の41%にとどまっている。

AIによるコンテンツ作成のスピードと効率が上がる一方で、静かに広がっている問題がある。つくられる文章が、同じように感じられ始めているのだ。

AIはデフォルトで、ニュートラルで予測可能なトーンになりやすい。文章は明快で構造化されているものの、独自の視点に欠ける。間違いではないが、誰の書いた文章なのかがわからない。SNSフィードやメールマガジン、長文のブログ記事を見渡せば、どれも磨かれてはいるが、強く印象に残るものは少ない。

コンテンツの「質」が一定以上に達した世界では、競争の軸は「誰のものでもない文章」から「自社の視点が埋め込まれた文章」へと変わる。この変化を、AI活用が進むチームほど無視できなくなっている。

ブランドボイスが競争力になる理由

かつてブランドの声は、時間をかけたキャンペーンや制作チームの協業を通じて形づくられてきた。ライターやデザイナーがブランドと向き合い、メッセージは各チャネルで熟成された。いま、その状況が変わっている。

生成AIの登場で、コンテンツの作成は驚くほど手軽になった。手軽になったからこそ、差別化の源泉は「そのブランドらしさ」に移っている。特に、AIドリブンの検索がバイヤーの情報収集と購買プロセスを変えつつあるなかで、この傾向はより顕著だ。

ブランドの声が一貫していることは、読み手にとっての「見慣れた風景」になる。その積み重ねが、選択肢の多さに疲れたユーザーに対する信頼のシグナルとして働く。これは、トーンや語彙だけの話ではない。同じ業界の二社が同じテーマを説明しても、一方は表面的に、他方は地に足のついた印象を与える。この差は、ブランドごとの視点の有無で決まる。

誰でもコンテンツをつくれる時代には、「どれだけ公開したか」よりも「どう聞こえるか」のほうが、はるかに重要になる。

なぜ従来のガイドラインはAIで機能しないのか

多くのマーケティングチームはすでにブランドボイスのガイドラインを持っている。問題は、その構造にある。資料はPDFやスライドの形で存在し、「プロフェッショナル」「親しみやすい」「革新的」といった数語の形容詞に依存していることが多い。

この情報量では、ブランドをすでに深く理解している人間の書き手になら機能するかもしれない。しかし、AIは形容詞を人間のようには解釈しない。AIが必要としているのは、具体性と構造と文脈だ。

人間向けに書かれたガイドラインをそのままAIに入れても、出力は安定しない。上位のコンセプトとしては明確でも、日々のオペレーションに落とし込むには抽象的すぎる。AIを導入したチームで、当初の想定と異なるトーンの文章が生成され始めるのは、このギャップが主な原因だ。

結局のところ、ブランドボイスを「定義している」だけでは足りない。AIが扱える形に翻訳し、ワークフローに組み込むところまでが必要になる。

ブランドボイスの運用化とは何か

ブランドボイスの「運用化」という言葉は難しく聞こえるが、やるべきことは明確だ。チームが使うツールやシステムのなかで、実際に機能する状態に整えることを指す。

まず実例からパターンを抽出する

出発点は、理想像を記述することではなく、実際のコミュニケーションを観察することだ。自社のWebサイトのテキストやメール文面、SNSの投稿を見返し、繰り返し現れる文の構造やトーン、具体性のレベルを見つける。

たとえばECサイトであれば、商品説明での「伝え方のクセ」がこれにあたる。機能を羅列するのか、使う人の体験を描くのか。メリットとスペックのどちらを先に出すのか。こうしたパターンは、AIに指示を出すときの具体的な拠り所になる。

「何を言わないか」を定義する

AIでコンテンツをつくる際は、禁止事項の明確化が特に効果を発揮する。AIは安全で無難な表現に寄りがちだ。制約がないと、少しずつ自社らしさから外れていく。

たとえば「過剰に洗練されたフレーズを使わない」「根拠のない大げさな謳い文句を避ける」「つなぎ言葉の多用を控える」といった指示を具体的に出しておく。これらのガードレールが、出力の振れ幅を適切な範囲に抑える。

ツールの内部に実装する

ここでいう「実装」は、技術的な難しさとはほとんど関係がない。重要なのは、音声を資料のなかに置いておくのではなく、普段の作業環境に組み込むことだ。

具体的な形としては、利用しているAIツールにカスタム指示としてブランドボイスを登録する、再利用可能なプロンプトテンプレートを開発する、といったアプローチがある。どの方法を選ぶにせよ、目標は「理論上の統一」ではなく、システムをまたいだ一貫性の実現だ。

実践のための5つのステップ

AIをコンテンツワークフローに統合するとき、最初から大がかりな仕組みを構築する必要はない。小さく始めて、成果を見ながら育てていくほうが現実的だ。

既存のAI出力を監査する

まずは、現在AIが生成している文章を集め、本当に自社らしく聞こえるかどうかをチェックする。判断基準を「正しいか」から「我々らしいか」に切り替えるのがポイントだ。

シンプルなボイスの枠組みをつくる

実際のコンテンツから良い例と悪い例を抜き出し、パターンを言語化する。「やるべきこと」と「避けるべきこと」の両方をセットで定義しておくと、AIへの指示が格段に通りやすくなる。

まず1つの用途に集中する

いきなり全チャネルをカバーしようとしない。たとえば、既存のブログ記事1本をSNS投稿とメルマガ用に展開する、といった具体的で管理しやすいタスクから始める。ECサイトであれば、商品紹介ページの内容を広告文に変換する工程が適している。

テストと調整を繰り返す

出力は定期的にレビューし、期待とずれている部分があればプロンプトを修正する。AIへの指示も一種の制作物であり、継続的な改善が不可欠だ。

生きた仕組みとして育てる

効果があったプロンプトや設定は、属人的なナレッジにせず、ドキュメント化する。標準化された手順に落とし込むことで、担当者が変わっても再現可能なワークフローに進化する。

この記事のポイント

- AIによるコンテンツの量産は、他社との差別化を失わせるリスクをはらんでいる

- ブランドの声は、PDFの資料ではなくAIが解釈できる形に翻訳して初めて機能する

- 「やってはいけないこと」の定義がAIの出力品質を左右する

- 大きな仕組みより、1つのタスクから始めて改善を回すアプローチが効果的だ

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験