Agentic AIのUX設計:不透明なブラックボックスを解消し信頼を築く手法

自律的にタスクを遂行する「Agentic AI(エージェンティックAI)」の普及により、ウェブサイト運営や業務効率化のあり方が劇的に変わりつつある。しかし、AIに複雑な指示を出した後、結果が出るまでの数十秒から数分間、システムが何をしているのか全く見えないという状況は、ユーザーに強い不安を与える。この「ブラックボックス化」は、AIツールの活用を阻む大きな壁となっている。

多くの開発現場では、この不安を解消するために「情報を一切隠してシンプルにする(ブラックボックス)」か、あるいは「全てのログを垂れ流す(データダンプ)」という極端な二択に陥りがちだ。しかし、Smashing Magazineの記事によれば、どちらのアプローチもユーザー体験を損なう原因になるという。ブラックボックスはユーザーを無力感に陥らせ、データダンプは情報の洪水によって通知疲れを引き起こすからだ。

本稿では、AIの内部プロセスを適切に可視化し、ユーザーとの信頼関係を築くための「意思決定ノード・オーディット(監査)」という手法を詳しく解説する。AIが「なぜその結論に至ったのか」を適切なタイミングで提示することで、WordPressサイトの自動管理や高度なデータ解析ツールにおいて、納得感のあるユーザー体験を実現できるはずだ。

AIの「透明性の瞬間」を特定する重要性

AIが自律的に動く際、ユーザーが最も不安を感じるのは「正しく動いているのか」「自分の意図を誤解していないか」という点だ。この不安を解消するには、AIの動作中に適切な情報を提示する「透明性の瞬間(Transparency Moments)」を設ける必要がある。

ブラックボックスとデータダンプの罠

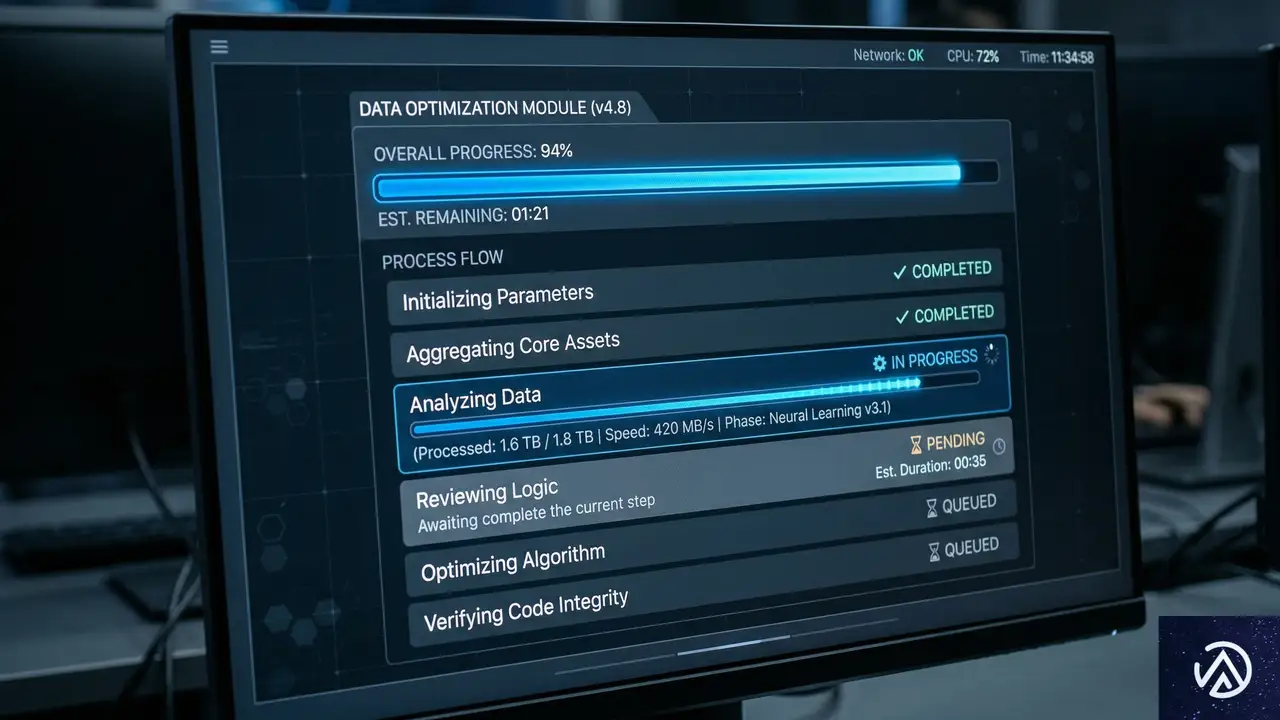

例えば、車の事故状況を解析して保険金額を算出するAIを考えてみよう。ユーザーが写真をアップロードした後、「計算中」という表示のまま1分間待たされるのは典型的なブラックボックスの状態だ。ユーザーは「警察の報告書は読み込まれたのか?」「写真の傷は正しく認識されたのか?」と疑心暗鬼になる。

一方で、AIが裏側で実行しているAPIコールやサーバーの応答ログを全て画面に表示するのは、単なる情報の押し付けに過ぎない。専門的すぎる情報はユーザーを混乱させ、本当に重要な判断ポイントを見失わせてしまう。必要なのは、情報の量ではなく「質」と「タイミング」の最適化だ。

信頼を構築するインターフェースの役割

適切な透明性が確保されると、待機時間は「不安な時間」から「価値が生成されている時間」へと変化する。AIが「損傷写真を500件の事例と比較中」「法的判例に基づき報告書を分析中」といった具体的なステップを明示することで、ユーザーはAIが高度な専門業務を自分のために遂行していることを実感できる。これは、単なる進捗バー以上の心理的効果をもたらす。

意思決定ノード・オーディットの進め方

AIのプロセスを可視化するためには、まずシステムが内部でどのような「選択」を行っているかを把握しなければならない。そのためのワークフローが「意思決定ノード・オーディット」だ。

AIが「推論」するポイントを可視化する

従来のプログラムは「AならばB」という確定的なルールで動くが、AIは「おそらくAだろう」という確率(プロバビリティ)に基づいて判断を下す。この「確実ではない判断」が行われる瞬間こそが、ユーザーに説明が必要な「意思決定ノード」となる。

オーディットの手順は以下の通りだ。まず、エンジニアやデザイナー、ドメインエキスパートが一同に集まり、AIの全工程をホワイトボードに書き出す。次に、AIが複数の選択肢から一つを選んだり、自信度(コンフィデンススコア)に基づいて推論を行ったりしている箇所を特定する。これらのポイントが、透明性を高めるべき候補となる。

保険金請求AIの改善事例

前述した保険金請求AIの事例では、オーディットの結果、AIが「画像解析」「テキストレビュー」「ポリシー照合」という3つの大きな確率的ステップを踏んでいることが判明した。改善前のインターフェースはこれらを一括りにしていたが、改善後は「損傷写真を解析中:車両衝撃プロフィールと比較しています」といった具合に、ステップごとに具体的なメッセージを表示するように変更された。これにより、ユーザーの信頼度は大幅に向上したという。

抽象的な進捗表示を具体的な業務内容に置き換えることで、ユーザーはAIの専門的な働きを理解できるようになる。

インパクト/リスク・マトリックスによる情報の選別

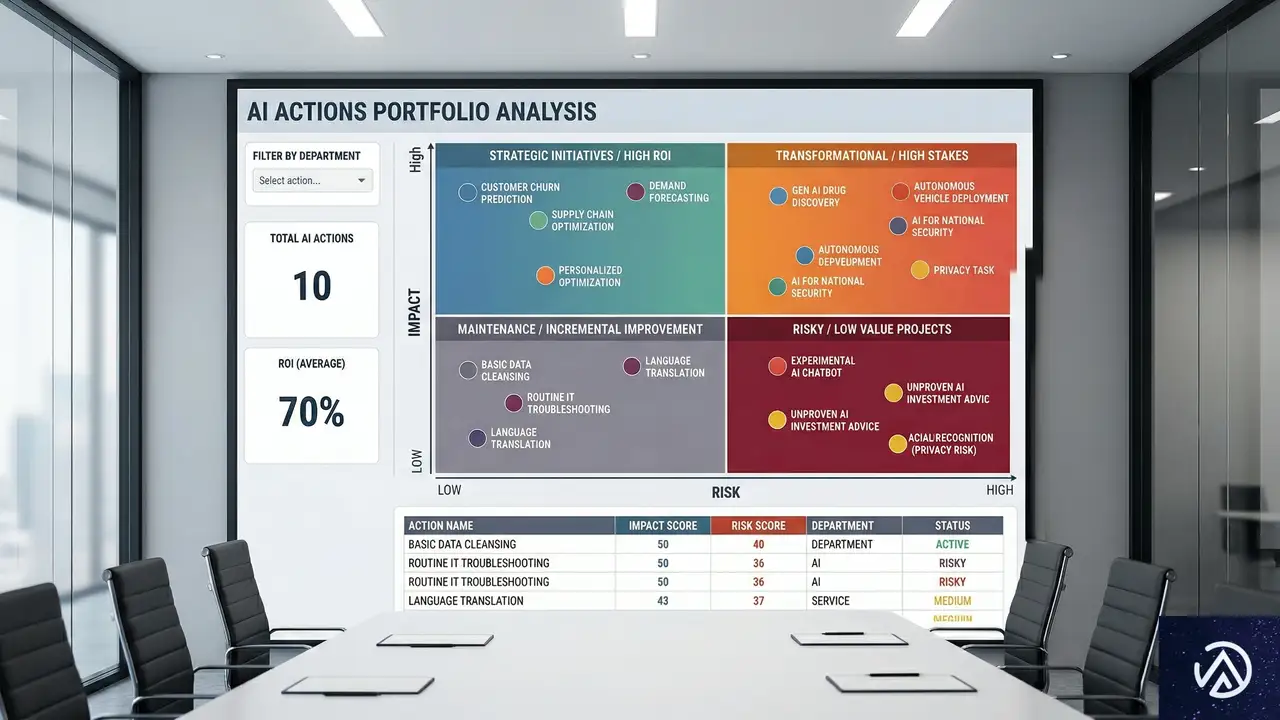

オーディットで抽出された全てのノードを表示する必要はない。情報の出しすぎはユーザーを疲れさせる。提示すべき情報を絞り込むために「インパクト/リスク・マトリックス」を活用する。

提示すべき情報の境界線

情報の選別基準は「その判断がユーザーに与える影響の大きさ」と「取り返しのつかなさ(非可逆性)」だ。例えば、一時ファイルの名称変更といった低リスクな処理は、わざわざ通知する必要はない。一方で、銀行ローンの拒否や高額な株式トレードの実行など、高リスクかつ取り返しがつかない処理は、最大限の透明性が求められる。

Smashing Magazineの著者によれば、高リスクな判断を行う前には「意図のプレビュー(Intent Preview)」を表示し、ユーザーの明示的な許可を求めるべきだという。これにより、AIが勝手に重大なミスを犯すリスクを軽減できる。

可逆性に基づいたデザインパターンの選択

判断ミスを後から修正できる(可逆的である)場合は、AIに自律的な実行を任せつつ、実行後に「アクション監査(Action Audit)」と「取り消し(Undo)」の機能を提供すればよい。例えば、メールの自動アーカイブやファイルの整理などがこれに該当する。重要なのは、何でもかんでもユーザーに確認を求めるのではなく、リスクに応じて「事前確認」か「事後通知」かを使い分けることだ。

リスクと可逆性を軸に整理することで、ユーザーの作業効率を落とさずに安全性を確保できる。

「Wait, Why?(えっ、なぜ?)」テストによる検証

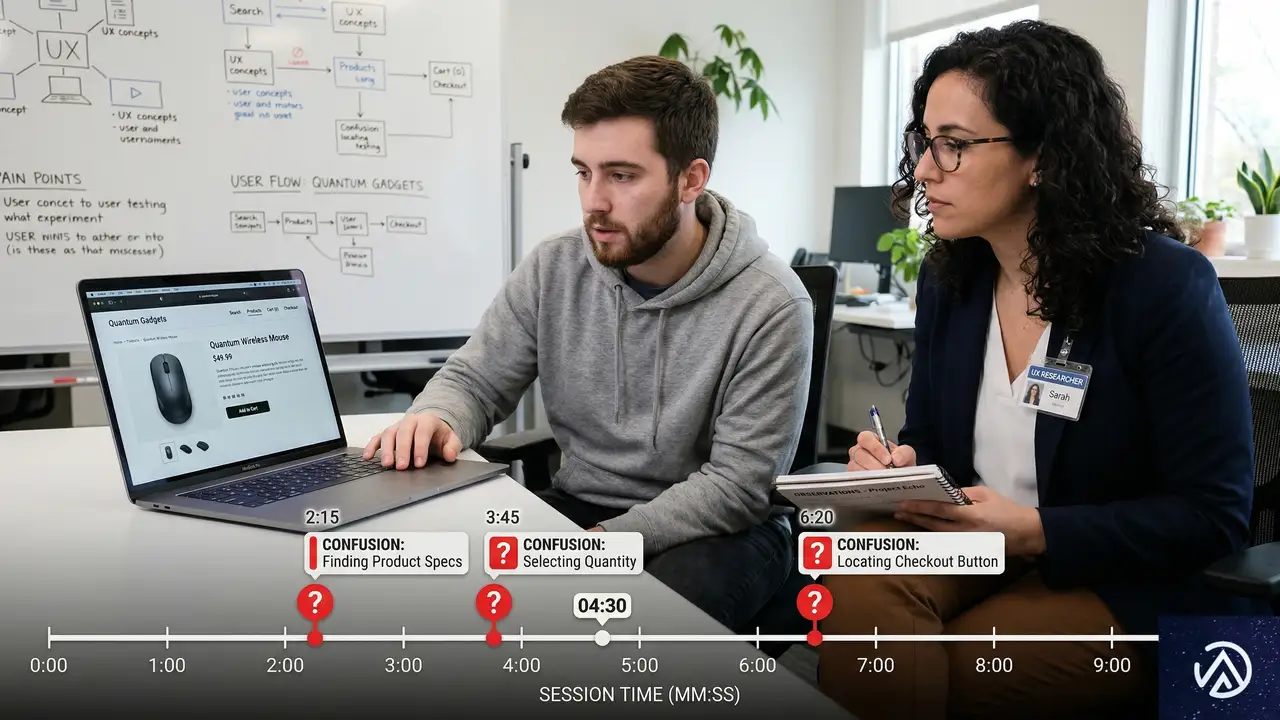

設計した透明性が適切かどうかを検証するには、ユーザーの実際の反応を観察する必要がある。そのための手法が「Wait, Why?(待って、なぜ?)」テストだ。

ユーザーの不安が生まれるタイミングを特定する

このテストでは、ユーザーにAIツールを使ってもらい、思考を全て口に出してもらう(思考発話法)。ユーザーが「あれ、今何してるの?」「止まってる?」「なぜこうなったの?」と疑問を口にした瞬間を記録する。そのタイミングこそが、透明性が不足している箇所だ。

例えば、医療予約アシスタントのテストでは、画面が4秒間静止した際にユーザーが不安を感じることがわかった。この4秒間を「あなたのカレンダーを確認中」と「医師のスケジュールと同期中」という2つのステップに分割して表示するようにしたところ、ユーザーの不安レベルは劇的に低下したという。技術的な処理時間は同じでも、情報の伝え方一つでユーザーの受け取り方は大きく変わるのだ。

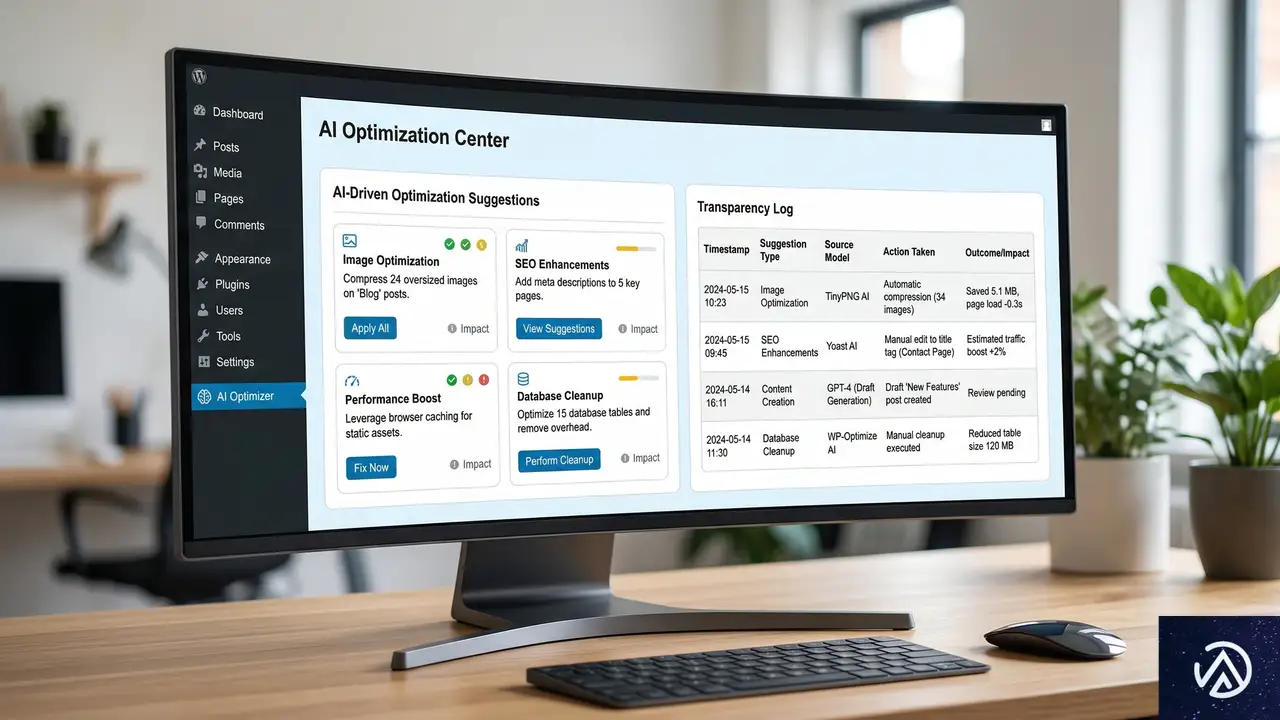

WordPressサイト運営におけるAgentic AI活用の展望

WordPressの世界でも、Agentic AIの活用は急速に進んでいる。例えば、記事の自動リライト、SEO最適化、セキュリティ脆弱性の自動パッチ適用、表示速度の最適化などが挙げられる。これらの処理はサイトの根幹に関わるため、本稿で解説した透明性の設計が極めて重要になる。

自動最適化プラグインへの応用

もしAIプラグインが「サイトの読み込み速度を改善しました」とだけ表示し、裏側で勝手にCSSやJavaScriptを大幅に削除していたらどうだろうか。表示が崩れた際、管理者は何が原因か分からずパニックになるだろう。これを防ぐには、「どのファイルをどのように最適化したか」というアクション監査のログを残し、ワンクリックで元の状態に戻せる設計が必要だ。

独自の分析:透明性が「AIアレルギー」を払拭する

多くのサイト運営者がAI導入をためらう理由は、AIが「何をするか分からない」という恐怖心にある。しかし、意思決定プロセスが可視化され、コントロール権がユーザーにあることが保証されれば、AIは「得体の知れない魔法」から「信頼できる有能な助手」へと変わる。透明性は単なるUIのデザイン要素ではなく、AIという新しい技術を社会に定着させるための「信頼のインフラ」と言えるだろう。

この記事のポイント

- Agentic AIの設計では、情報を隠しすぎる「ブラックボックス」と出しすぎる「データダンプ」の両方を避けるべきだ。

- 「意思決定ノード・オーディット」を実施し、AIが確率に基づいて推論を行うポイントを特定することが透明性への第一歩となる。

- インパクト/リスク・マトリックスを活用し、高リスクな処理には「事前承認」、低リスクな処理には「事後通知」を使い分ける。

- 「Wait, Why?」テストを通じて、ユーザーが不安を感じる空白の時間を特定し、具体的なプロセス説明で埋めることが重要だ。

- 透明性の確保は、AIに対するユーザーの信頼を築き、高度な自動化ツールを実務に定着させるための鍵となる。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験