企業のAI活用に潜む「ガバナンスの溝」を埋める。リスク管理と導入フレームワークの要諦

AIガバナンスの構築は、もはや「将来取り組むべき課題」ではない。多くの組織において、管理者のあずかり知らぬところでAI活用が進んでいるからだ。現場の従業員が独自の判断でツールを使い始めている現状を、まずは直視しなければならない。

MarTechの寄稿者であるConstance Chen氏によると、AIがすでに組織内で使われているという前提に立つことが重要だという。許可の有無にかかわらず、業務効率化のためにAIは浸透している。問題は「使われているかどうか」ではなく、「安全かつ適切に使われているか」という点に集約される。

適切なプロトコルがない状態では、ブランドの信頼性やプライバシー、成果物の品質にどのようなリスクが生じているかを把握できない。本記事では、組織が直面しているAIガバナンスのギャップを埋め、実用的なフレームワークを構築するための手順を解説する。

現場で進む「シャドーAI」の実態を把握する

AIガバナンスを構築する第一歩は、現状を正しく理解することだ。多くのリーダーが陥る罠は、公式に導入していないからリスクはないと誤認することである。実際には、従業員が個人のアカウントでChatGPTやClaudeなどのLLM(大規模言語モデル)を利用しているケースは少なくない。

まずは利用状況の棚卸しから始める

チーム内でどのようなAIツールが使われているか、実態調査を行う必要がある。これには匿名アンケートなどが有効だ。具体的には、日常業務で最も頻繁に使用しているLLMの種類や、特定の業務に特化したAIエージェントの有無を確認する。現場の声を聞くことで、どの業務にAIのニーズがあるのかが浮き彫りになる。

従業員の習熟度とニーズを可視化する

AIに対する従業員の心理的ハードルも重要な指標だ。積極的に活用している層もいれば、抵抗感を持っている層もいるだろう。また、十分なガイダンスがないまま「手探り」で使っている状況であれば、それは誤用によるリスクが高い状態を示唆している。これらの情報を収集することで、次に策定すべきガイドラインの解像度が高まる。

放置すればブランド崩壊も。AI利用に潜む4つの主要リスク

特に規制の厳しい業界や、顧客の信頼が生命線となるEC業界において、無秩序なAI利用は深刻な事態を招きかねない。Constance Chen氏は、明確なガバナンス方針がない場合に直面するリスクをいくつか挙げている。これらは単なる技術的な問題ではなく、法的・経営的なリスクに直結するものだ。

データの学習利用による情報漏洩

最も警戒すべきは、機密情報や顧客の個人情報がAIモデルの学習データに取り込まれることだ。無料版のチャットツールなどは、入力されたデータをモデルの精度向上のために再利用する場合がある。一度学習されてしまえば、その情報を完全に取り消すことは極めて困難であり、プライバシー侵害の責任を問われる可能性がある。

セキュリティ審査と法的権利の放棄

IT部門やセキュリティチームの審査を経ていないツール(シャドーAI)は、脆弱性の温床となる。また、AIプラットフォームの利用規約を十分に確認せずに同意することで、入力データに対する権利をプラットフォーム側に与えてしまうリスクもある。さらに、会話履歴がサーバーに保持され、万が一のデータ漏洩時に証拠として差し押さえられる対象になる可能性も否定できない。

承認済みツールの選定と利用基準の明確化

すべてのAIツールが一律に危険なわけではない。リスクの度合いは、そのツールがデータをどのように扱うかによって大きく異なる。組織として「どのツールなら使ってよいか」を明示することが、混乱を防ぐ最短ルートとなる。

エンタープライズ向けと無料版の明確な区別

一般的に、法人向けのエンタープライズ契約を結んだAIツールは、データのプライバシー保護が保証されている。一方で、個人向けの無料プランはデータ利用に関する制限が緩いことが多い。どのツールがコンプライアンスやセキュリティ基準を満たしているかを精査し、公式に許可するリストを作成すべきだ。これにより、従業員は安心して業務にAIを取り入れることができる。

ユースケースに応じた段階的な承認プロセス

すべての業務で同じツールを使う必要はない。日常的な壁打ちやアイデア出しに使うツールと、顧客データを含む高度な分析に使うツールでは、求められる安全基準が異なる。特定のユースケースにのみ限定して許可するツールや、いかなる場合も使用を禁止するプラットフォームを定義することが求められる。承認の責任部署を明確にすることも、運用の形骸化を防ぐポイントだ。

データ保護のための具体的なガードレール構築

明確なガイドラインがなければ、従業員は自分の基準で「安全かどうか」を判断してしまう。この主観的な判断こそが、データ侵害の引き金となる。組織として客観的かつ具体的なガードレール(防護柵)を設置する必要がある。

入力禁止情報のリスト化と匿名化の徹底

プロンプト(AIへの指示文)に含めてはいけない情報のカテゴリーを具体的に指定しよう。PII(個人特定情報)、社内秘の文書、クライアントの財務情報などがその代表例だ。また、AIでデータを分析する前に、個人を特定できる要素を削除する「匿名化」の手順をルール化することも有効である。GDPR(欧州一般データ保護規則)などの国際的な規制を意識した設計が望ましい。

現場が迷わないための「1枚のインフォグラフィック」

50ページにも及ぶ難解なポリシー文書を読み込む従業員は少ない。重要なのは、日常業務の中で瞬時に判断できる簡潔さだ。例えば、「この情報は入力OKか?」をフローチャート形式でまとめた1枚のインフォグラフィックを作成する。視覚的に理解しやすい資料を提供することで、ガードレールの実効性は飛躍的に高まる。

※データの匿名化を徹底することで、情報漏洩のリスクを最小限に抑えることができる。

上記のデモのように、具体的な「やって良いこと」と「ダメなこと」を対比させることで、現場の判断ミスを減らすことが可能だ。

品質の劣化を防ぐためのQA(品質保証)体制

AIガバナンスで見落とされがちなのが、出力結果の「品質」に関するリスクだ。AIを使えば大量のコンテンツを短時間で生成できるが、人間の監視が不十分だと、ブランドイメージにそぐわない低品質な成果物が世に出てしまう。これが積み重なると、ステークホルダーからの信頼を失うことにつながる。

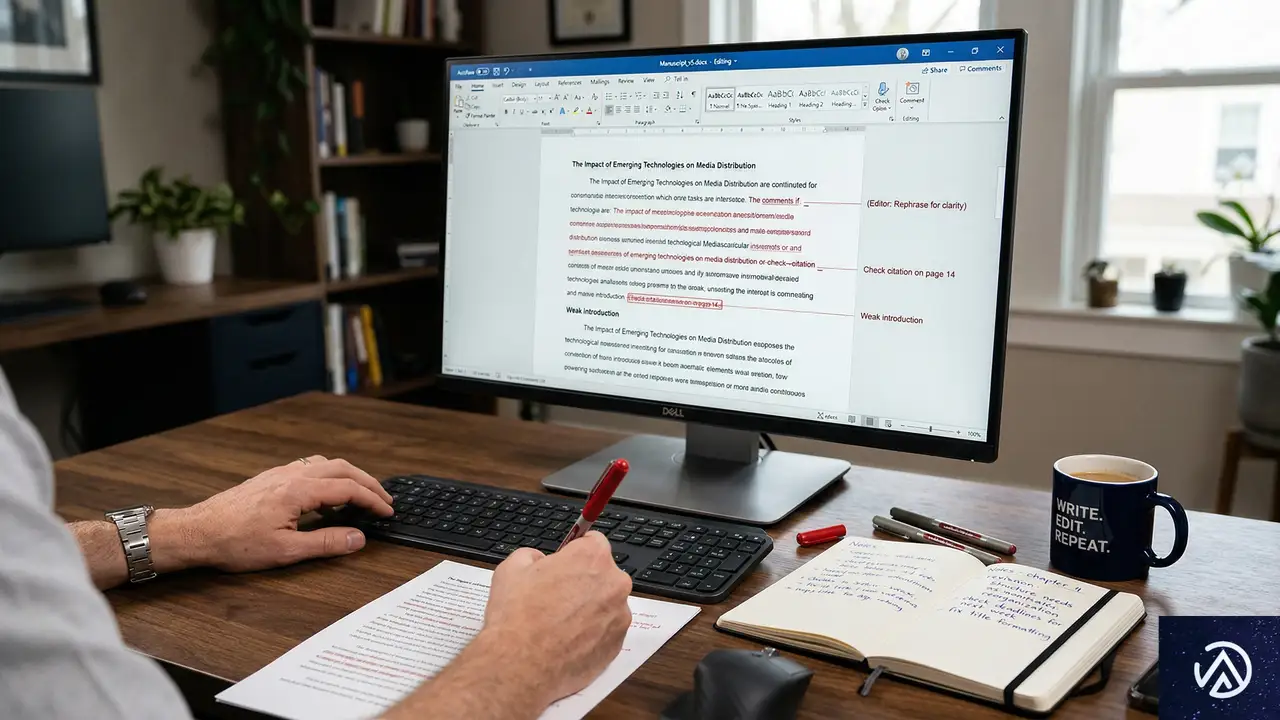

AI生成コンテンツのレビューフローを定義する

生成されたコンテンツをそのまま公開するのではなく、必ず人間の目を通すQAプロセスを組み込むべきだ。情報の正確性、ブランドトーン(口調や雰囲気)との合致、そして不適切な表現が含まれていないかをチェックする。すべてのコンテンツに同じ熱量のレビューを行うのは非効率なため、重要度に応じて「入念な編集が必要なもの」と「軽微な確認で済むもの」に分類するとよい。

最終責任の所在を明確にする

「AIが間違えたから仕方ない」という言い訳は通用しない。AIを利用して作成された成果物であっても、その品質に対する最終的な責任は人間が負うべきだ。誰が最終的な承認権限(サインオフ)を持つのかを明確にし、品質問題が発生した際の対応フローをあらかじめ決めておくことが、無責任なAI利用を抑制する力となる。

ECサイト運営におけるAIガバナンスの重要性

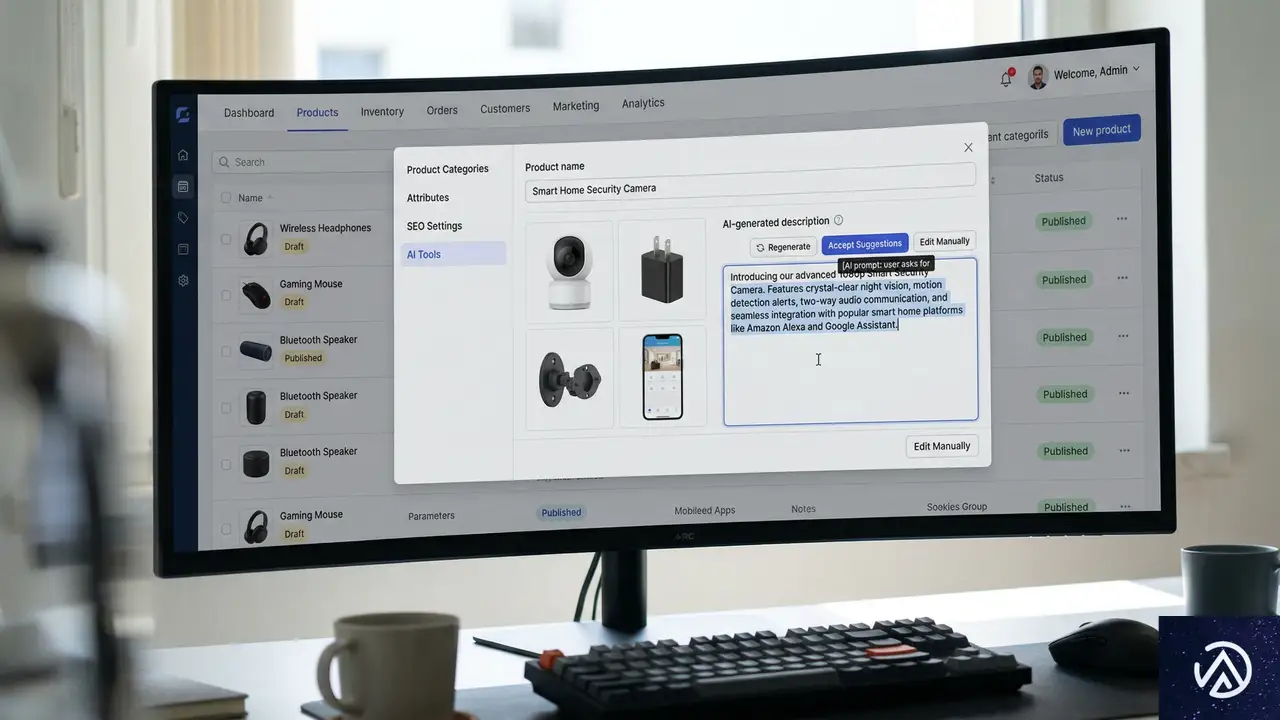

ECサイト、特にWooCommerceなどのプラットフォームを活用している場合、AIの活用範囲は多岐にわたる。商品説明文の自動生成、カスタマーサポートのチャットボット、購入履歴に基づくレコメンドなどがその例だ。しかし、これらはすべて「顧客データ」や「ブランドの顔」に関わる領域である。

商品データの正確性とPL法のリスク

AIが生成した商品説明文に事実と異なるスペックや効能が含まれていた場合、景品表示法違反や製造物責任(PL法)に関わる問題に発展する恐れがある。AIは時に、もっともらしい嘘(ハルシネーション)をつく。EC運営において、スペック情報の最終確認を自動化に頼り切るのは極めて危険だと言わざるを得ない。

WooCommerceプラグインによる外部連携の罠

WooCommerceにはAI機能を付加する多くのプラグインが存在するが、それらがデータをどの外部サーバーに送信し、どのように処理しているかを把握している運営者は少ない。安易な導入は、バックドア(裏口)を作ることと同義になりかねない。プラグインを導入する際は、開発元の信頼性やデータ処理方針を厳格に審査するガバナンスが不可欠だ。

この記事のポイント

- AIはすでに現場で使われているという前提に立ち、まずは利用実態の棚卸しを行うことが急務である。

- 無料版AIツールへの機密情報入力は、データの学習利用による情報漏洩リスクを最大化させる。

- 承認済みツールのリスト化と、ユースケースに応じた段階的な利用基準を明確にすることが混乱を防ぐ。

- 難解なポリシーよりも、1枚のインフォグラフィックのような「現場が即座に判断できる」ガイドラインが有効。

- AI生成物の品質に対する最終責任は人間が負うべきであり、公開前のQAプロセスを必ず組み込む。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験