Google検索結果の「続きを読む」リンク表示を増やす3つの法則!robots.txtドキュメント拡充と最新SEO動向

Googleが検索結果の表示をより詳細にする「続きを読む(Read more)」ディープリンクのベストプラクティスを公開した。これは検索結果のスニペット内に、ページ内の特定セクションへ直接ジャンプできるリンクを表示させるための指針だ。これまで経験則で語られてきた部分が、公式ドキュメントによって明確化された形となる。

あわせて、robots.txtのドキュメント拡充や、EUでのAIチャットボットに対するデータ共有規制、さらには検索画面上でタスクを完結させる新機能についても動きがある。2026年4月の最新情報を踏まえ、Webサイト運営者が今取り組むべき構造改革について解説する。

これらのアップデートは単なる表示の変化ではなく、Googleが「AIエージェントにとって読みやすい構造」をWebサイトに求めていることの表れだ。サイトの構造が古いままでは、検索結果での露出機会を大きく損なう可能性がある。技術的な背景とともに、具体的な対策を確認していこう。

Google検索のディープリンク表示を増やす3つの鉄則

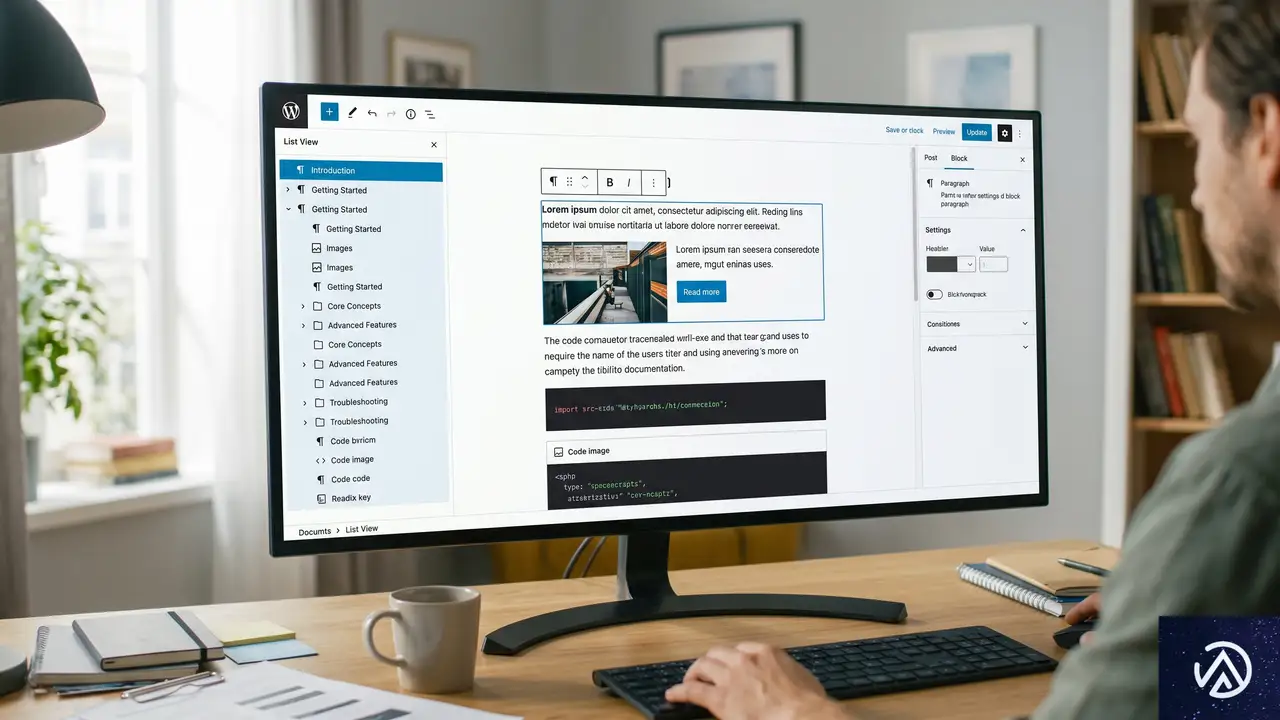

Googleは検索結果のスニペット(説明文)の下に表示される「続きを読む」リンクについて、その出現率を高めるための具体的な方法を明らかにした。ディープリンクとは、ページ全体ではなくページ内の特定の章や節に直接ユーザーを誘導するリンクのことだ。これが表示されると、検索結果の占有面積が増え、クリック率の向上が期待できる。

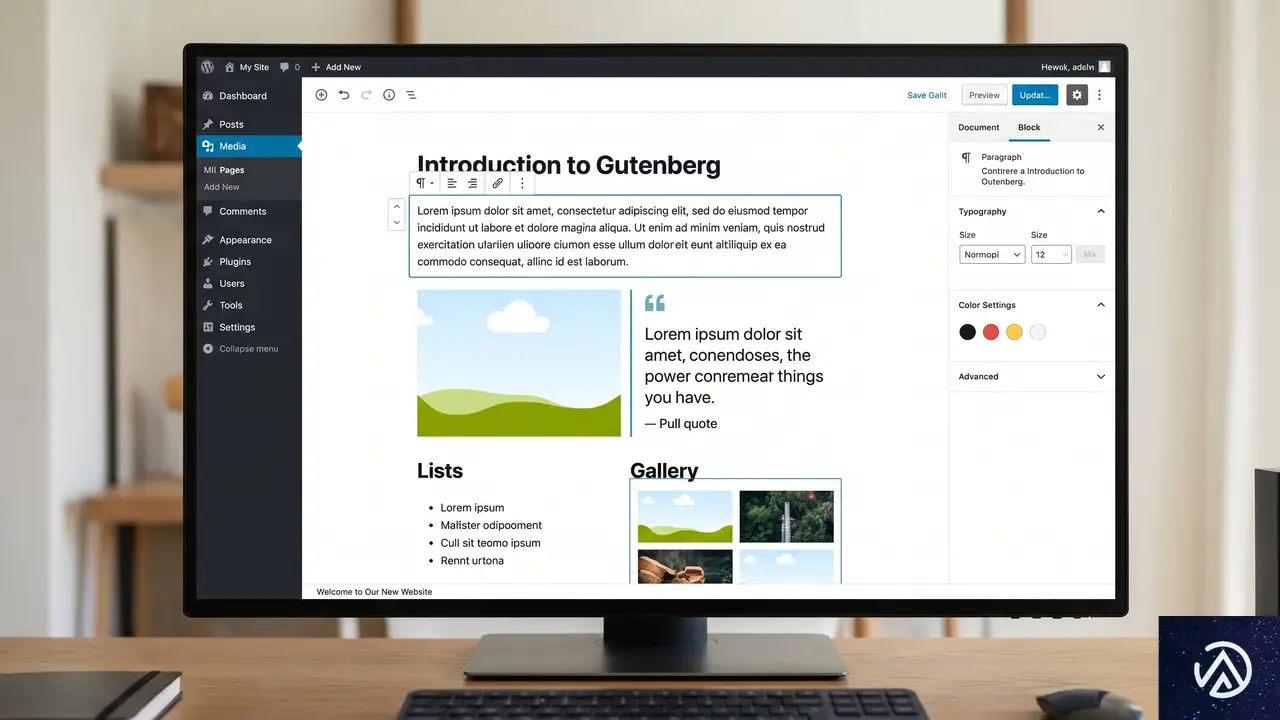

コンテンツはページ読み込み時に即座に表示させる

最も重要なポイントは、ユーザーがページを開いた瞬間にコンテンツが人間にとって可視化されていることだ。クリックしないと中身が見えない「折りたたみ式(アコーディオン)」や「タブ切り替え」の中に重要な情報を隠している場合、ディープリンクとして採用される確率は下がる。Googleは、ユーザーの操作なしにレンダリングされる情報を優先して評価している。

これは「隠れたテキスト」がインデックスされないという意味ではないが、検索結果の拡張機能(リッチスニペットやディープリンク)においては、露出の優先度が低くなることを示唆している。特にモバイルユーザー向けに情報をコンパクトにまとめようとして、重要な見出しや本文をアコーディオン内に閉じ込める設計には注意が必要だ。

H2やH3の見出しタグを適切に活用する

ディープリンクのリンク先となるセクションには、必ず <h2> や <h3> といった見出しタグを使用する必要がある。Googleのシステムは、これらの見出しをページの構造的な区切りとして認識し、リンクのアンカー(目的地)として利用するからだ。

また、検索結果に表示されるスニペットのテキストと、実際のページ内の見出しや本文の内容が一致していることも条件となる。見出しが画像だけで構成されていたり、装飾目的で <div> タグにスタイルを当てただけの「見出し風」のデザインになっていたりすると、Googleはそこをセクションの開始点として正しく認識できない。

UIデザインのBeforeとAfter比較

ディープリンクが表示されにくい構造(タブ・アコーディオン)と、表示されやすい構造(フラットな見出し構成)を比較してみよう。以下のデモは、コンテンツの露出度による構造の違いを視覚化したものだ。

このデモのように、すべての主要コンテンツがページロード時に露出している構成の方が、Googleは各セクションをディープリンクとして採用しやすくなる。ユーザーの利便性を損なわない範囲で、情報の「隠しすぎ」を避けることが重要だ。

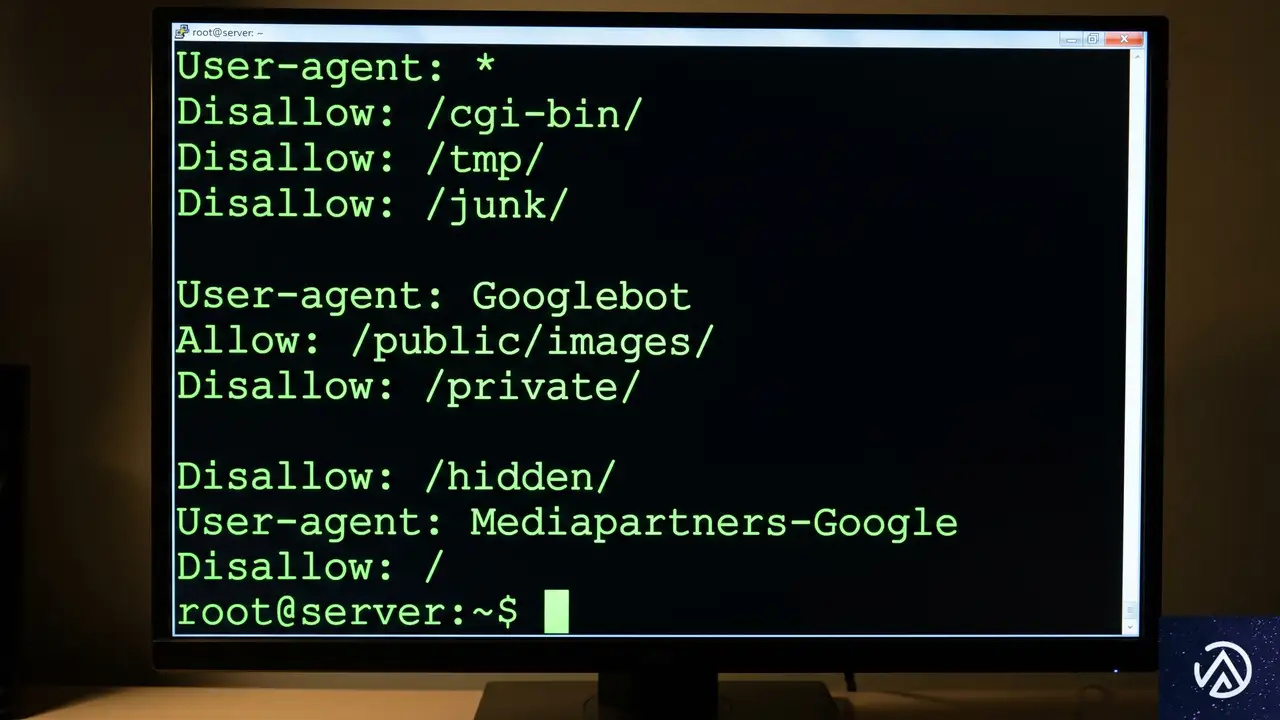

robots.txtの公式ドキュメント拡充とスペルミスへの寛容さ

GoogleのGary Illyes(ゲイリー・イリェーシュ)氏とMartin Splitt(マーティン・スプリット)氏は、ポッドキャスト「Search Off the Record」にて、robots.txtに関する新たなプロジェクトについて語った。Googleは現在、HTTP Archiveのデータを分析し、実際に世界中のサイトで使用されているrobots.txtの記述パターンを調査している。

非サポートルールの明文化

robots.txtには、Googleが公式にサポートしていない独自の命令(ディレクティブ)が記述されているケースが多々ある。例えば、クロールの頻度を指定する Crawl-delay や、特定の条件下でのみ適用されるカスタムルールなどだ。Googleは今回の分析に基づき、よく使われているが実際にはGoogleが無視している「非サポートルール」のトップ10から15をドキュメントに追加する予定だ。

これにより、Webサイト運営者は「自分が設定しているルールがGoogleに効いているのか」を正確に判断できるようになる。もしGoogleがサポートしていないルールに頼ってクロール制御を行っている場合、それは期待通りに機能していない可能性が高い。公式ドキュメントが更新された際には、自サイトのrobots.txtを改めて監査する必要があるだろう。

記述ミスの自動補完が進む可能性

さらに興味深い点として、Googleのrobots.txtパーサー(解析機)が、記述のスペルミスをより柔軟に受け入れるようになる可能性が示唆された。例えば disallow を dissallow と書き間違えた場合でも、Googleがそれを意図通りの命令として解釈してくれるようになるかもしれない。

ただし、これはあくまで「Googleが親切に解釈してくれる」という話であり、ミスを放置してよいという意味ではない。他の検索エンジン(Bingなど)が同様の寛容さを持っているとは限らないからだ。robots.txtはサイトの立ち入り禁止区域を指定する「地図」のようなものだ。記述ミスがあれば、検索エンジンにインデックスさせたくないページが公開されてしまうリスクがある。基本的には、標準的なスペルを厳守すべきだ。

EUのデータ共有規制がAIチャットボットに波及

欧州委員会(EC)は、デジタル市場法(DMA)に基づき、Googleに対して検索データを競合他社と共有するよう求める予備的な見解を示した。この規制の対象には、従来の検索エンジンだけでなく、特定の条件を満たす「AIチャットボット」も含まれる見通しだ。

AIチャットボットが「検索エンジン」として定義される日

これまでSEO業界では、Googleのような検索エンジンと、ChatGPTやPerplexityのようなAIチャットボットを別物として扱ってきた。しかし、EUの規制当局は「オンライン検索エンジン」の定義を広げ、AIチャットボットもその範疇に含める動きを見せている。これが確定すれば、Googleが持つ膨大なランキングデータやクリックデータが、競合するAIサービスに提供されることになる。

この変化は、EU圏内での検索市場の流動性を高める可能性がある。Googleのデータを活用して精度を高めたAIチャットボットが普及すれば、ユーザーの検索行動はさらに分散するだろう。Webサイト運営者にとっては、Googleだけでなく「AIチャットボットからどう参照されるか」という視点が、法規制の面からも裏付けられた重要な課題となる。

匿名化された検索シグナルの行方

共有されるデータは匿名化されるものの、ランキング、クエリ、クリック、閲覧データといった核心的な情報が含まれる。これにより、新興のAI検索サービスが「どのコンテンツがユーザーに支持されているか」をより正確に把握できるようになる。日本国内のサイトであっても、EUからのアクセスがある場合は、これらのデータ共有の影響を間接的に受けることになるだろう。

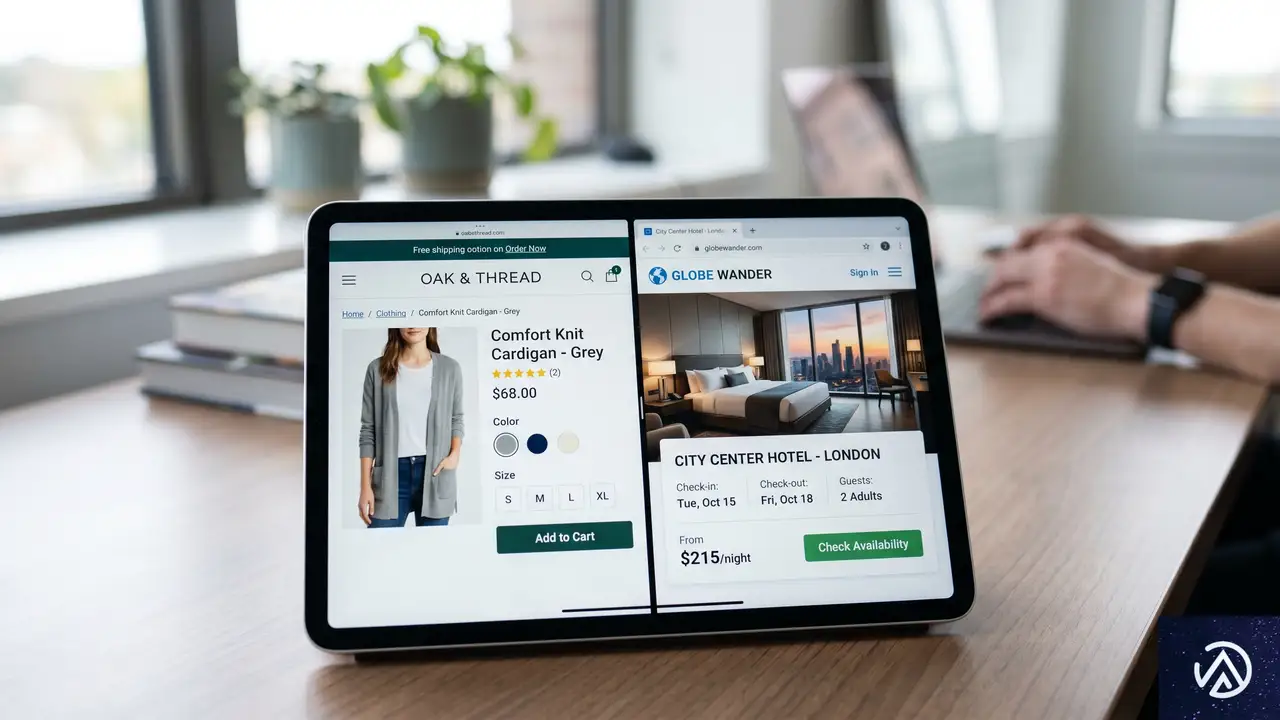

検索結果でタスクを完結させる新機能の追加

Googleは検索結果画面(SERP)上で直接ユーザーの目的を達成させる「タスクベース」の機能を強化している。その一環として、特定のホテルの価格下落を追跡できるトグルスイッチが導入された。これは、ユーザーがホテル予約サイトへ移動することなく、Google内で価格監視を開始できる機能だ。

Webサイトへの流入機会が「Google内」に吸収される

これまで、価格下落通知は旅行予約サイトや比較サイトが提供する主要なサービスの一つだった。Googleがこの機能を検索結果に直接組み込むことで、ユーザーが各サイトを再訪する動機が減少する可能性がある。GoogleのSundar Pichai(サンダー・ピチャイ)CEOが語っていた「エージェントとしての検索」が、着実に具現化していると言える。

この変化への対策として、ホテルなどのサービス事業者はGoogleビジネスプロフィールの情報を最新に保ち、Googleのフィードに対して正確なデータを提供し続ける必要がある。検索結果が単なる「リンク集」から「実行プラットフォーム」へと進化する中で、プラットフォームとのデータ連携の重要性はかつてないほど高まっている。

AIエージェントの起動ボタン

また、Googleの「AIモード」から直接AIエージェントを起動し、複雑なタスクを委任できる機能もテストされている。例えば「旅行の計画を立てて予約まで進める」といった一連の動作を、AIが代行する仕組みだ。この際、AIがどのWebサイトの情報をソース(情報源)として採用するかは、前述した「ディープリンクのベストプラクティス」のような構造化された情報の有無に左右される。

AIエージェントは、人間と同じようにWebページを「読み」に行く。その際、Javascriptの実行や複雑なクリック操作を必要とするページよりも、シンプルで見出し構造が明確なページを好む。検索がタスク完結型になればなるほど、Webサイトは「人間が見る場所」であると同時に「AIがデータを取得するAPI」のような役割を求められるようになるのだ。

この記事のポイント

- 「続きを読む」リンクを表示させるには、コンテンツをアコーディオンやタブに隠さず、ページロード時に露出させることが重要だ。

- 適切な見出しタグ(H2、H3)を使用し、検索スニペットとページ内容の整合性を保つことで、ディープリンクの採用率が高まる。

- robots.txtの公式ドキュメントが拡充され、Googleがサポートしていないルールの実態が明確になるため、定期的な記述の監査が推奨される。

- EUの規制によりAIチャットボットが「検索エンジン」として扱われ始め、Googleの検索データが競合AIに共有される道が開かれつつある。

- Google検索は「情報を探す場所」から「タスクを完結させる場所」へ進化しており、WebサイトにはAIエージェントが読み取りやすい構造が求められている。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Googleへのスパム報告に新ルール。個人情報を含むと処理されない理由

Googleがスパム報告に関する公式ドキュメントを更新し、報告プロセスにおける重要な変更を明らかにした。今後、報告内容に個人を特定できる情報が含まれている場合、Googleはその報告に基づいた調査や対処を行わない方針だ。

この変更は、スパムサイトに対して「手動対策(マニュアルアクション)」が実施される際、報告内容の一部がサイト所有者に共有される仕組みに起因している。Googleはプライバシー保護と法規制への対応を優先し、不適切な情報を含む報告をあらかじめ排除する決断を下した。

SEO担当者やサイト運営者にとって、この変更は単なる手続きの修正ではない。悪質なサイトを排除するための正当な報告が無効化されるリスクを避けるため、報告の作法を再確認する必要がある。

Googleスパム報告の仕様変更。個人情報の記載が「無効」に

Googleは検索結果の品質を維持するため、ユーザーからのスパム報告を受け付けている。しかし、2026年4月に更新されたドキュメントによれば、報告フォームの自由記述欄に個人情報が含まれている場合、その報告は処理されなくなった。これは、報告者が意図せず自身の身元を相手に明かしてしまうリスクを防ぐための措置だ。

なぜ個人情報が含まれると処理されないのか

最大の理由は、Googleがスパムサイトの所有者に送る通知の仕組みにある。Googleが報告に基づいて手動対策を下した場合、その根拠となった情報をサイト所有者に伝えることがある。この際、報告者が記述したテキストがそのまま引用される可能性があるためだ。

もし報告文の中に、報告者の名前や会社名、あるいは特定のサイト運営者であることを示唆する情報が含まれていれば、スパムサイト側に報告者の正体が筒抜けになってしまう。Googleはこのような事態を避けるため、個人情報が含まれる報告自体を「破棄」するというルールを明文化した。

ドキュメントから削除された「匿名性」の記述

以前のドキュメントでは、自由記述欄に個人情報を書かない限り、報告は匿名に保たれるという主旨の記述があった。しかし、今回の更新でこの文言は削除された。代わりに「法規制を遵守するため、手動対策の文脈を理解させる目的で、提出されたテキストをサイト所有者に送信しなければならない」という強い表現が追加されている。

これは、Googleが報告者の匿名性を保証する努力をするのではなく、報告者自身に「特定される情報を一切書かないこと」を義務付けたことを意味する。ルールを守らない報告は、どれほど証拠が揃っていても無視されることになるため、注意が必要だ。

手動対策通知の仕組みと報告者が負うべきリスク

手動対策(マニュアルアクション)とは、Googleの担当者が目視でサイトを確認し、ガイドライン違反と判断した場合に検索順位を下げたり、インデックスから削除したりする処置を指す。このプロセスにおいて、ユーザーからの報告は重要な判断材料の一つとなる。

報告内容がそのまま相手に届くという事実

Googleが違反サイトの運営者に送る通知には、どのような違反があったのかを説明するテキストが含まれる。このテキストに、報告者がフォームに記入した内容が「原文のまま」転載されるケースがある。これは、違反者が自サイトのどこに問題があるのかを正確に把握させ、修正を促すための透明性を確保する目的で行われる。

しかし、この透明性が報告者にとってはリスクとなる。例えば「私のサイトの画像を盗用している」といった文言で報告すれば、相手は即座に報告者が誰であるかを特定できる。このような情報の流出は、報告者への逆恨みやさらなる攻撃を招く恐れがある。

情報の流れを視覚化する

スパム報告がどのように処理され、どの段階で情報が共有されるのかを整理しておくことは重要だ。以下のデモは、不適切な報告と適切な報告で情報の伝わり方がどう変わるかを示している。

このデモのように、自分を特定する情報を削ぎ落とし、客観的な事実のみを伝えることが、報告を有効にするための鉄則だ。

プライバシー保護と透明性のジレンマ。Googleの狙い

Googleがなぜこのような厳しいルールを設けたのか。その背景には、欧州のGDPR(一般データ保護規則)をはじめとする、世界的なプライバシー保護規制の強化がある。個人データの取り扱いには極めて慎重な対応が求められており、検索エンジンも例外ではない。

法規制への対応とユーザー保護の両立

GDPRなどの法規制下では、データの主体(この場合はサイト所有者)は、自分に関するどのような情報が収集され、誰から提供されたのかを知る権利を持つ場合がある。Googleが「報告文を相手に送る」としているのは、こうした法的要求に応えるための苦肉の策とも言える。

一方で、報告者の身の安全を守る必要もある。そこでGoogleが導き出した答えが、「個人情報が含まれる報告は最初から受け取らない(処理しない)」というフィルタリングだ。これにより、法的義務を果たしつつ、報告者が不用意に特定される事態を未然に防いでいる。

「質の高い報告」を求めるGoogleの姿勢

今回の変更は、スパム報告の「質」を向上させる狙いもあると考えられる。感情的な訴えや個人的な利害関係を排除し、アルゴリズムやガイドラインに照らして何が違反なのかを論理的に説明する報告を、Googleは求めている。

報告が無効化される条件を明確にすることで、Google側の処理コストも削減される。明らかにガイドラインを理解していない報告や、嫌がらせ目的の報告を、情報の形式だけで自動的に弾くことができるからだ。

効果的なスパム報告を行うための実践的なアドバイス

スパムサイトによって検索順位を下げられたり、コンテンツを盗用されたりした場合、冷静に報告を行うのは難しい。しかし、確実にGoogleに対処してもらうためには、以下のポイントを意識してフォームを記入する必要がある。

匿名性を保ちつつ証拠を提示するコツ

まず、一人称(私、弊社など)や固有名詞を避けることだ。例えば「私のサイトのこの記事がコピーされた」と書くのではなく、「該当URLのコンテンツは、別のドメイン(URLを提示)のオリジナルコンテンツを無断で複製している」といった書き方にする。

次に、違反の種類を具体的に指摘することだ。単に「スパムだ」と主張するのではなく、「隠しテキストが使用されている」「リンクプログラムに参加している」「クローキングが行われている」など、Googleのスパムポリシーに基づいた用語を使うと、担当者の理解が早まる。

報告文のチェックリスト

送信ボタンを押す前に、以下の項目が含まれていないか確認しよう。一つでも当てはまる場合は、処理されない可能性が高い。

- 自分の氏名や会社名、部署名

- 自分のメールアドレスや電話番号

- 自分が管理しているサイトのドメイン名(証拠として必要な場合を除く)

- 相手を非難する感情的な言葉

- 過去のやり取りや個人的なトラブルの経緯

独自の分析。SEO担当者が今後意識すべき報告の作法

今回のGoogleの対応は、SEO業界における「スパム報告」の立ち位置を大きく変える可能性がある。これまでは「困った時の神頼み」のような側面もあったが、今後はより専門的で客観的な「証拠提出」の場へと変わっていくだろう。

競合への嫌がらせ対策としての側面

この新ルールは、競合サイトを陥れるための「虚偽の報告」に対する牽制にもなる。報告内容が相手に公開される可能性がある以上、安易な嘘や根拠のない誹謗中傷は、報告者自身の首を絞めることになるからだ。Googleは情報の透明性を高めることで、報告システム自体の健全性を保とうとしている。

AI時代におけるスパム報告の価値

AIによって生成された低品質なコンテンツが急増する中、Googleのアルゴリズムだけですべてを検知するのは難しくなっている。人間の目による「これはスパムだ」というフィードバックの価値はむしろ高まっていると言えるだろう。

だからこそ、私たちは「正しい報告の作法」を身につけるべきだ。適切な形式で、個人情報を排除し、事実に基づいた報告を行うことは、検索エンジンのエコシステムを守るための貢献にもなる。今回の仕様変更を機に、社内での報告フローやテンプレートを見直してみるのも良いだろう。

この記事のポイント

- Googleへのスパム報告に個人情報が含まれている場合、調査は行われず破棄される。

- 手動対策が実施される際、報告文がそのままサイト所有者に共有されるリスクがあるためだ。

- 報告文には自分の名前や会社名を入れず、客観的な事実と違反箇所のみを記述する。

- この変更は、プライバシー保護規制への対応と報告システムの健全化を目的としている。

- 正当な報告を有効にするため、送信前のセルフチェックがこれまで以上に重要となる。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI検索でブランドが消える?「没個性税」を回避する最新SEO戦略

AIは検索の仕組みを変えるだけでなく、どのブランドを「無視するか」を決定する審判になりつつある。従来の検索エンジン最適化(SEO)が通用しなくなる中で、企業は自社の存在がAIによって消し去られるリスクに直面している。

Adobe Summitにおいて、SemrushのCMO(最高マーケティング責任者)であるAndrew Warden氏は、ブランドの可視性が根本から変化したと指摘した。AIシステムが情報をフィルタリングする過程で、特徴のないブランドは組織的に排除される可能性があるという。

本記事では、Warden氏が提唱する「Bland Tax(没個性税)」という概念を中心に、AI検索時代に生き残るためのブランド戦略を深掘りする。AIに選ばれ、ユーザーに届くための新しいルールを理解することが、これからのマーケティングの成否を分けるだろう。

AIが情報のゲートキーパーになるエージェント時代の到来

現在、検索行動のデータには明らかな変化が現れている。Google検索の約60%が、Webサイトへのクリックを伴わずに終了しているという。これは、ユーザーが検索結果画面でAIが生成した回答を読み、そのまま満足して離脱していることを意味する。

GoogleのAI Overviews(AIオーバービュー)やChatGPT、Perplexityといったツールは、もはや単なる検索ツールではない。これらは「新しいゲートキーパー」として機能し、ユーザーと情報の間に立って、どの情報を提示し、どのブランドを紹介するかを選別している。

検索行動の変化とクリックゼロの現実

ユーザーは以前のように複数のサイトを巡回して情報を比較検討する手間をかけなくなっている。対話型のインターフェース内で質問を重ね、解決策を絞り込んでいく「エージェント型」の利用が一般的になりつつある。この環境下では、AIの回答に含まれないブランドは、ユーザーの視界から完全に消滅してしまう。

LLMユーザーのコンバージョン率は4倍高い

一方で、クリック数が減ることは必ずしも悪いことばかりではない。Warden氏は、大規模言語モデル(LLM)を利用している消費者は、従来の検索のみを利用するユーザーに比べて、コンバージョン率が少なくとも4倍高いというデータを提示している。AIを通じて情報を探しているユーザーは、より具体的で強い購入意図を持っているため、AIに選ばれることの価値は極めて高い。

● サイトA ● サイトB ● サイトC

■ 選ばれたブランドのみが表示される

この図は、検索体験が「分散」から「集約」へと変化している様子を示している。AIが情報を統合するため、選ばれなかった情報は存在しないも同然となる。

没個性なブランドを襲うBland Tax(没個性税)の正体

Warden氏が提唱する最も重要な概念が「Bland Tax(没個性税)」だ。これは、特徴のない平凡なコンテンツを発信し続けるブランドが支払うことになる、目に見えないペナルティを指す。AIは現在、平凡な内容(Blandness)を無視するように学習を進めているという。

「平均的であること」や「ジェネリックであること」は、AI検索の世界では「透明であること」と同義だ。どこにでもあるような情報を発信しているブランドは、AIによって他の情報とひとまとめに要約され、ブランド名が引用されることすらなくなる。

平均的なコンテンツはAIに吸収される

AIは複数のソースから似たような情報を集め、1つの簡潔な回答を作成する。この際、独自の見解や新しい事実が含まれていないコンテンツは、AIの知識の一部として吸収されるだけで、出典として明記される価値がないと判断される。これが、ブランドアイデンティティが消去されるプロセスだ。

ブランド名が消え、AIの学習データにされるリスク

独自の価値を提供できないブランドのコンテンツは、AIを賢くするための「無料のトレーニング場」に成り下がってしまう。情報の提供元としての認知を得られないまま、コンテンツだけがAIの回答精度を高めるために消費される。これはマーケティング投資として極めて効率が悪い状態だといえる。

AIに選ばれるための発見可能性と権威性

AI検索時代において、ブランドの可視性は「発見可能性(Discoverability)」と「権威性(Authority)」の掛け合わせで決まる。Warden氏は、この両方が不可欠であると強調している。どちらか一方が欠けても、AIの回答に食い込むことはできない。

「発見可能性」とは、AIがそのブランドの情報を技術的に見つけられるかどうかを指す。そして「権威性」とは、AIがそのブランドを信頼し、回答に含める価値があると判断するかどうかを指す。この2つを高い次元で両立させることが、新時代のSEO戦略の核心だ。

基礎としてのSEOはAIの教本になる

SEOは死んだという極端な意見もあるが、Warden氏はこれを明確に否定している。むしろ、SEOはこれまで以上に基礎的な役割を担うようになっている。現在のSEOは人間に見せるためだけのものではなく、AIに対する「トレーニングマニュアル」としての側面が強まっているからだ。

以下の要素が欠けているブランドは、AIの会話から完全に排除されるリスクがある。

- クローラビリティ(AIが情報を収集できるか)

- インデクサビリティ(情報がデータベースに登録されるか)

- 構造化データ(情報の意味をAIが正しく理解できるか)

- 権威シグナル(信頼に足る情報源か)

エンティティ権威を確立するブランド需要

AIは「エンティティ(実体)」とその関係性を地図のようにマッピングして理解している。AIに特定のトピックの権威として認識されるためには、ブランドそのものに対する需要、つまり「指名検索」が重要になる。人々がそのブランドを探していなければ、AIもまたそのブランドを探そうとはしないからだ。

独自の価値を証明する3つの重要シグナル

Warden氏は、ブランドがAIにフィルタリングされず、優先的に表示されるために必要な3つの具体的なシグナルを挙げている。これらは、AIが「この情報は特別だ」と判断するための基準となるものだ。

単に記事を量産するのではなく、これらのシグナルを意識したコンテンツ制作が求められる。独自性(オリジナリティ)を担保することで、AIの回答における可視性は30%から40%向上する可能性があるという。

1. 情報の密度とオリジナリティ

AIは「新しい事実」を引用することを好む。既存の情報の焼き直しではなく、以下のような要素を含むコンテンツが評価される。

- 独自の調査データや統計

- 自社だけが持つ一次情報

- 専門家による独自の視点や分析

- 具体的な成功事例や失敗談

2. シグナルの整合性と合意

AIは自社サイトの情報だけでなく、ネット上のあらゆる場所にある「他者の声」を参照している。Redditでの議論、YouTubeのレビュー、SNSでの言及、メディアでの報道などが、ブランドの信頼性を裏付ける「合意シグナル」となる。これらの情報が矛盾している場合、AIはそのブランドを「信頼できない」とフラグ立てする恐れがある。

3. エンティティの関連付け

特定のキーワードだけでなく、トピック全体においてブランドがどのように位置づけられているかが問われる。関連するコミュニティでの会話に参加し、専門的なメディアで取り上げられることで、AIの知識グラフ内でのブランドの結びつきを強化できる。

これらの要素が組み合わさることで、AIは「このブランドは引用する価値がある」と確信する。単一の施策ではなく、多角的なシグナルの構築が必要だ。

組織全体で取り組む可視性の再定義

AI検索への対応を難しくしている要因の1つは、組織の断絶にあるとWarden氏は指摘している。多くの企業では、SEOチーム、広報(PR)チーム、ブランドチーム、広告チームが個別に動いており、情報の整合性が取れていないケースが多い。

しかし、AIはこれらすべてのチャネルからデータを吸い上げている。SEOチームがどれほど最適化しても、PRチームが発信するメッセージが異なっていたり、SNSでの評判が悪かったりすれば、AIはそのブランドを高く評価しない。可視性はもはや特定のチームの問題ではなく、組織全体で取り組むべき課題だ。

トラフィックから関連性への評価軸シフト

従来の評価指標も通用しなくなっている。検索順位は安定しているのにトラフィックが減る、という現象が多くのサイトで起きている。これはAIが回答を肩代わりしているためだ。一方で、リード(見込み客)の質や数は向上している場合もある。

マーケターは「何回のクリックを得たか」という指標から、「AIの回答においてどれほど関連性の高い存在として扱われているか」という指標へと視点を移す必要がある。トラフィックはもはや、ブランドの成功を測る唯一の代理指標ではなくなっている。

アルゴリズムはもはや味方ではない

かつてのSEOは、Googleのアルゴリズムを理解し、それに合わせることで「順位」を競うゲームだった。しかし、今のAIは「何が有意義か」を判断する究極の裁定者となっている。アルゴリズムを攻略するハック(手法)よりも、リアルな世界での信頼と独自の価値を積み上げることこそが、最大の防御であり攻撃となる。

この記事のポイント

- AIは平凡なコンテンツを無視する「没個性税(Bland Tax)」を課し始めている

- AI検索時代はトラフィックが減る一方で、コンバージョン率が4倍高まる可能性がある

- SEOはAIにブランドの情報を教えるための「トレーニングマニュアル」として機能する

- 独自の調査データ、外部評価の整合性、専門的な権威性がAIに選ばれる鍵となる

- 可視性の向上には、SEO・PR・ブランドの各チームが連携した一貫した戦略が不可欠だ

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

MicrosoftがAI Maxを発表!AIエージェントが主役の「Agentic Web」時代に備える新広告ツールとは

Microsoftが「エージェンティック・ウェブ(Agentic Web)」という新しい時代の到来を見据えた、次世代の広告ツール群を発表した。これは人間だけでなく、AIエージェントがネット上の情報を探索し、意思決定や購買を代行する世界を想定したものだ。

2026年4月、Microsoft Advertisingは「AI Max」を含む一連のアップデートを公開した。これには広告配信の最適化だけでなく、AIによるブランドの露出状況を可視化する分析ツールや、AIが直接決済まで完結させるための新しいプロトコルが含まれている。

従来の「検索してクリックする」というユーザー行動が、AIによる「最適な選択と実行」へと置き換わりつつある。企業にとって、この変化は単なる広告手法の変更ではなく、Web上での存在意義を再定義する重要な転換点となるはずだ。

エージェンティック・ウェブの到来とAIエージェントの役割

エージェンティック・ウェブとは、AIエージェントがユーザーの代わりにタスクを遂行するWeb環境を指す。これまでのWebは、人間がブラウザを開き、検索エンジンにキーワードを入力して、表示されたリンク先を一つずつ確認する場所だった。

しかしAIエージェントの普及により、このプロセスが劇的に変化している。ユーザーは「週末の旅行プランを立てて、予算に合うホテルを予約しておいて」とAIに頼むだけで済むようになる。AIは複数のサイトを巡回し、価格や評価を比較し、最終的な選択までを行う。

クリックから「選択」へのパラダイムシフト

これまでの広告ビジネスは「クリック」を指標にしてきた。ユーザーを自社サイトへ誘導し、そこでコンバージョンを狙うのが一般的だ。しかし、AIエージェントが情報を集約して回答する場合、ユーザーは必ずしも元のサイトを訪問する必要がなくなる。

ここで重要になるのが、AIに「選ばれる」ことだ。AIがユーザーに提示する回答の中に、自社の製品やサービスが適切に含まれているか。そして、AIがその情報を信頼できると判断しているか。この「選択の最適化」が、次世代のマーケティングの中心となる。

このデモは、Web利用の構造がどのように変化しているかを視覚化したものだ。ユーザーの行動が簡略化される一方で、AIが裏側で行う処理の重要性が増していることがわかる。

AI MaxとOffer Highlightsの仕組み

Microsoftが導入した「AI Max for Search」は、AI環境に特化した新しいキャンペーン形式だ。これは従来の検索広告を拡張し、CopilotやBingのAIチャット回答内など、AIが生成するあらゆるインターフェースに広告を最適化して配信する。

AI Maxの特徴は、クエリのマッチング精度が大幅に向上している点だ。ユーザーがAIと対話する中で、文脈を深く理解し、最も関連性の高いタイミングで広告を表示する。これにより、単なるキーワード一致を超えた、意図に基づいたリーチが可能になる。

会話の中に溶け込むOffer Highlights

もう一つの注目機能が「Offer Highlights」だ。これはAIとの会話の中で、製品の主要なセールスポイントを直接提示する広告フォーマットである。例えば「送料無料」や「期間限定の割引」といった情報が、AIの回答の一部として自然に組み込まれる。

AIチャットを利用しているユーザーは、情報を素早く得たいと考えている。別サイトに移動して詳細を確認させるのではなく、会話の流れの中でメリットを伝えることで、離脱を防ぎながら購買意欲を高めることができる。これは「AI時代のリスティング広告」とも呼べる進化だ。

AI Visibilityによる露出状況の可視化

新しい時代において、自社がAIにどのように認識されているかを知ることは極めて重要だ。そこでMicrosoftは、ウェブ分析ツール「Microsoft Clarity」に「AI Visibility」という新機能を搭載した。これはAIの回答内で自社ブランドがどのように表示されているかを分析するツールだ。

AI Visibilityでは、どのコンテンツがAIに引用されたか、どのキーワードで自社が推奨されたかを詳しく追跡できる。また、競合他社がAIの回答内でどのような位置を占めているかを比較することも可能だ。これは従来のSEOにおける検索順位チェックの、AI回答版と言えるだろう。

引用元としての信頼性を高める

AIは回答を生成する際、信頼できるソースを引用する。Clarityの新しいレポートを使えば、自社のどのページがAIにとって「引用しやすい」と判断されているかが明確になる。データ構造が整理されているか、主張が明確かといった要素が、AIによる露出度に直結するのだ。

このイメージ図は、AI Visibilityが提供するインサイトを簡略化したものだ。自社サイトのどの部分がAIに評価され、引用されているかを把握することで、次にとるべき施策が明確になる。

Universal Commerce Protocolと直接購入

AIエージェントが「買い物」を代行するためには、商品データがAIにとって読み取りやすい形式である必要がある。Microsoftは「Microsoft Merchant Center」において「Universal Commerce Protocol」のサポートを開始した。これはAIエージェントが製品を発見し、取引を円滑に行うための標準規格だ。

このプロトコルに準拠することで、AIは商品の価格、在庫、仕様だけでなく、配送条件や返品ポリシーまでを正確に把握できるようになる。AIエージェントがユーザーの代理人として「最も条件の良い商品」を選ぶ際、このデータ構造化が勝敗を分けることになる。

Copilot Checkoutで摩擦のない購買体験を

さらにMicrosoftは、Copilot内で直接決済を完結させる「Copilot Checkout」の強化も進めている。ユーザーがAIとの対話で商品を決めた後、外部サイトへ移動することなく、その場で注文を確定できる仕組みだ。

発見から購入までの摩擦(フリクション)を最小限に抑えることで、コンバージョン率は飛躍的に向上すると期待されている。企業側は自社サイトへの流入を失うことになるが、その代わりに「AIエージェント経由の売上」という新しいチャネルを確保することになる。

独自分析:SEOからAIO(AI最適化)への戦略的転換

Microsoftの今回の発表は、Webマーケティングの軸足が「人間向けのSEO」から「AI向けのAIO(AI Optimization)」へ移りつつあることを示唆している。AIエージェントに選ばれるためには、単にキーワードを散りばめるだけでは不十分だ。

AIOにおいて最も重要になるのは、情報の「正確性」と「構造化」である。AIは不確かな情報を嫌う。出典が明確で、構造化データ(Schema.orgなど)によって意味が厳密に定義された情報は、AIに採用される確率が高まる。また、自然言語によるターゲット設定ツールの登場により、広告主は「誰に」届けたいかをより直感的に指定できるようになる。

中小企業が今から準備すべきこと

この変化は、リソースの限られた中小企業にとってもチャンスだ。巨大な広告予算がなくても、特定のニッチな分野で「最もAIに信頼される情報源」になれば、AIエージェントを通じて多くのユーザーにリーチできる可能性がある。

まずは、自社サイトの情報を整理し、AIが理解しやすい形に整えることから始めよう。具体的には、製品のスペックをテーブル形式で明記する、独自の調査データを公開する、といった「AIが引用したくなるコンテンツ」の作成が有効だ。AIエージェントという新しい「顧客」とどう付き合うかが、今後の成長を左右するだろう。

この記事のポイント

- MicrosoftがAIエージェント時代を見据えた広告ツール「AI Max」を発表した

- エージェンティック・ウェブでは、AIがユーザーの代わりに情報を探し、意思決定を行う

- 「AI Visibility」により、自社ブランドがAIの回答にどう露出しているか分析可能になった

- 「Universal Commerce Protocol」により、AIエージェントが直接購入を代行する仕組みが整いつつある

- これからのマーケティングは、検索順位だけでなく「AIに選ばれるための最適化(AIO)」が重要になる

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI時代のSEOで検索エンジンが信頼する3要素——権威性・鮮度・独自性の新基準

検索エンジンの評価基準が根本から変わった。従来のSEO対策だけでは通用しない時代が来ている。

Search Engine Journalの記事によると、AI駆動の検索システムは権威性・鮮度・独自性の3要素を重視する。これらの要素が連動して、コンテンツが検索結果に表示されるか、AI生成回答に引用されるかを決める。

この変化を理解しないと、どんなにキーワードを最適化しても、どんなにバックリンクを増やしても、成果は上がらない。AIが信頼するコンテンツを作るための新たな基準を解説する。

検索エンジンの評価システムが変わった

かつての検索エンジンは定期的なアルゴリズム更新で評価基準を調整していた。コアアップデートが発表され、順位が変動し、業界がパターンを分析して対策を練る。このサイクルは予測可能だった。

しかし今は違う。AI駆動の検索システムは常に学習し、評価基準を微調整している。Search Engine Journalの記事では、この状態を「連続的な調整」と表現する。アルゴリズムの更新のように見える現象の多くは、実際にはAIモデルの継続的な最適化の結果だ。

従来の「ランキング」から「評価」への移行

従来のSEOはページ単位のランキングを競うものだった。バックリンクや関連性、技術的な最適化が評価基準となり、ページ全体が1つの単位として扱われた。

AI駆動の検索では、ページ全体のランキングに加えて「情報の抽出と合成」という第2の層が加わった。検索エンジンは複数のソースから情報を抜き出し、再構成して回答を生成する。この変化により、競争の単位がページ全体から「情報の断片」へと移行している。

具体的には、コンテンツ内の各セクション、各段落、各リストがAI生成回答に引用される候補となる。ページが検索結果に表示されるかどうかだけでなく、ページ内のどの部分がAIによって利用されるかが重要になった。

信頼の評価が「継続的」になった

信頼性の評価も変化した。かつての信頼性は、権威性のシグナル、コンテンツ品質、技術的な健全性を組み合わせた「スコア」のようなものだった。一度高い評価を得れば、しばらくは維持できた。

現在の信頼性評価は「確率」のように振る舞う。継続的に評価され、再計算され、新しいデータに基づいて強化される。一度得た信頼を保持するのではなく、繰り返し獲得し続ける必要がある。

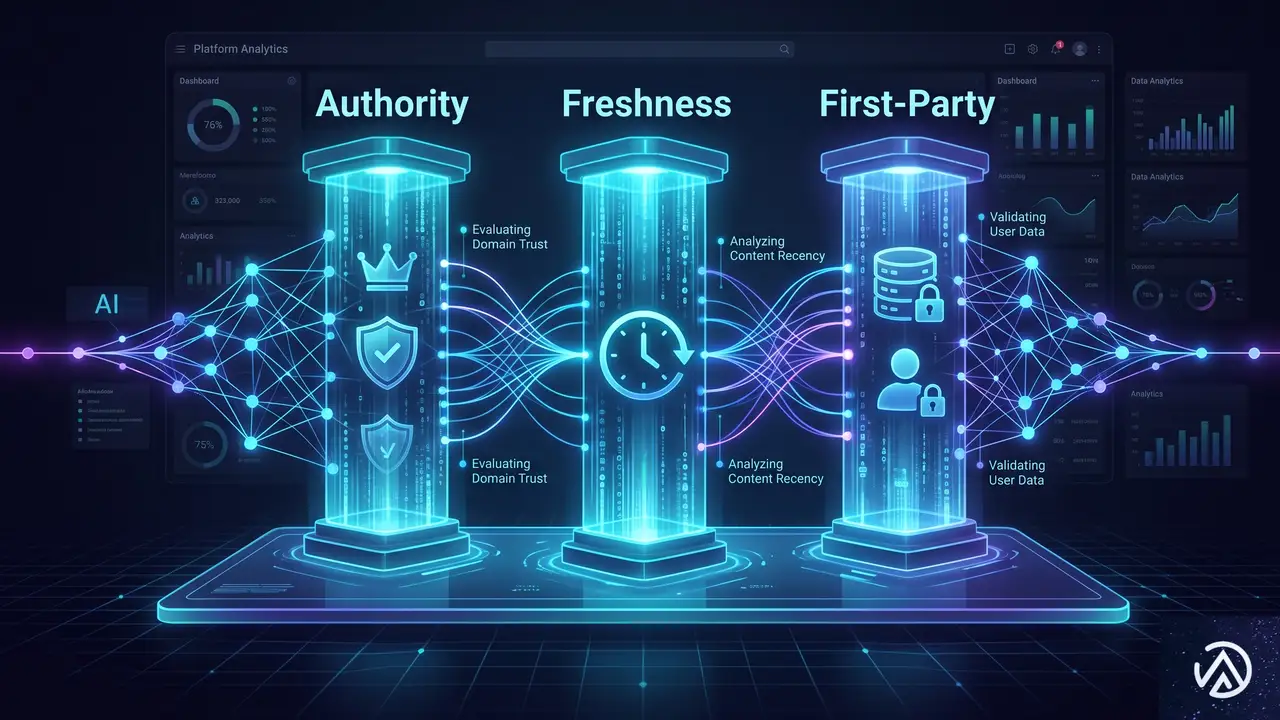

AIが信頼する3つの要素

AI駆動の検索システムが信頼性を判断する際、特に重視する要素が3つある。権威性、鮮度、独自性のシグナルだ。それぞれが異なる役割を果たし、コンテンツが検索結果に表示されるか、AI回答に引用されるかを決める。

権威性——評価の入り口

権威性は常に重要だったが、その役割が変化した。AI駆動のシステムでは、権威性は「フィルター」として機能する。コンテンツが評価の対象になるかどうかを最初に決める要素だ。

すべての情報源が平等に扱われるわけではない。検索エンジンは認識しているエンティティ(ブランド、著者、ドメイン)を優先する。これらのエンティティは、ウェブ全体で一貫した専門性と可視性を示している必要がある。

バックリンクの数だけが権威性の指標ではなくなった。エンティティレベルの権威性を証明するには、以下の要素が重要になる。

- 他の権威あるサイトでの言及

- 一貫した著者性とトピックへの集中

- 特定の分野でのブランド認知

- 構造化された知識システムへの組み込み

Search Engine Journalの記事では、これらのシグナルが「エンティティ重力」を作り出すと説明する。存在感が強ければ強いほど、コンテンツが情報抽出の候補セットに含まれやすくなる。

重要なのは、権威性が可視性を保証するわけではないことだ。権威性は「資格」を保証する。権威性がなければ、コンテンツがよく書かれ、よく構成され、技術的に健全であっても、無視される可能性がある。

鮮度——継続的な関連性の証明

鮮度の概念も進化した。あるいは「分化した」と言う方が正確かもしれない。

かつては、すべての種類のコンテンツが鮮度の恩恵を受けた。新しいコンテンツは、特に時間に敏感なクエリに対して一時的なブーストを得られた。

現在、この従来型の鮮度はニュースメディアのような時間に敏感な発信者にしか利益をもたらさない。それ以外の発信者にとって、鮮度は「いつ公開されたか」ではなく「維持されているか」が重要になる。

AI駆動のシステムは、継続的な関連性を示す情報源を優先する。具体的には以下の要素だ。

- 定期的に更新されるコンテンツ

- 明確なタイムスタンプと改訂履歴

- 時間の経過とともに重要なトピックが強化されていること

- 現在の情報と文脈との整合性

古くなったコンテンツはリスクを生む。情報がまだ正確かどうかをシステムが判断できない場合、合成された回答に含まれる可能性が低くなる。

鮮度は、この意味で信頼強化のループになる。コンテンツを更新することは、継続的な専門性を示すシグナルだ。不確実性を減らし、含まれる可能性を高める。

独自性——確かな情報源の証明

3つ目の大きな変化は、独自性のシグナルの重要性が劇的に高まったことだ。AIシステムは情報を合成するように設計されているが、依然としてソース素材に依存している。その素材の品質は、出力の品質に直接影響する。

その結果、システムはリサイクルされた要約ではなく、オリジナルで検証可能な入力を表すコンテンツを重視する。独自性のシグナルには以下が含まれる。

- 独自の調査とデータ

- 独自の洞察と分析

- 直接的な製品やサービス情報

- 直接的な経験と専門知識

これらのシグナルは曖昧さを減らす。明確な情報源を提供し、帰属が容易で、複製が難しい。

これが「大量コンテンツ」モデルが近年苦戦している理由の1つだ。派生コンテンツの大量生産は、新しい情報をほとんど提供しない。価値を増やすことなくノイズを増やすだけだ。

AIシステムはより多くのコンテンツを探しているのではなく、より良い入力を探している。コンテンツが何か独自のものを追加しない限り、選択される可能性は低い。

見落とされがちな第4の要素——使いやすさ

権威性が評価の対象にし、鮮度が関連性を保ち、独自性が信頼性を確立する。しかし、コンテンツが利用できなければ、これらの要素はすべて無意味になる。ここで多くのサイトが失敗している。

ページがよくランキングしていても、AI生成回答に存在しないことがある。その場合、問題はランキングではなく「抽出のしやすさ」にあることがほとんどだ。

AIシステムは人間のようにページを読まない。探索的にナビゲートし、解釈し、合成することはない。抽出しやすいものを取得し、次に進む。

この環境でうまく機能するコンテンツには、いくつかの特徴がある。

- 明確で説明的な見出し

- 論理的な階層構造(H1、H2、H3)

- 段落ごとに1つの主要なアイデア

- 直接的で断定的な表現

- 適切な箇条書きと表

- 重要なポイントは早い段階で紹介(埋もれさせない)

これは文章スタイルの問題ではない。摩擦を減らす問題だ。

システムが回答を分離するためにコンテンツを再解釈する必要がある場合、利用される可能性は低くなる。文やリストを直接引き抜ける場合、含まれる可能性は高くなる。この意味で、構造は見た目の問題ではなく、機能的な問題だ。

- キーワード調査

- メタタグ最適化

- コンテンツ作成

- バックリンク構築

このデモは、同じ内容でも構造化の違いでAIによる抽出のしやすさが変わることを示している。左側は情報が段落内に埋もれており、AIが特定の情報を抽出するには文章全体を解析する必要がある。右側は見出しと箇条書きで明確に構造化されており、AIが「SEOの主要手法」という見出しの下のリストを直接取得できる。

「良いSEO」だけでは不十分な理由

多くのチームが直面しているのは、以下のようなパターンだ。検索順位は良好で、トラフィックも安定しているが、AI生成回答には存在しない。

最初の直感はランキングの問題を探すことだ。それで問題が解決しないと、キーワードの再最適化、より多くのバックリンク構築、より多くのコンテンツ公開に移行する。これらは真の問題に対処しない解決策だ。

ランキングは検索結果に表示されるかどうかを決める。情報抽出は回答に利用されるかどうかを決める。これらは同じシステムではない。ページが従来のSEO指標でうまく機能していても、AIシステムにとってきれいで抽出可能なセグメントを提供できないことがある。

その場合、より明確な構造やより強い権威性を持つ競合他社が、たとえ順位が低くても引用される可能性が高くなる。これは矛盾ではなく、評価の変化だ。

この比較図は、評価基準の変化を視覚化している。左側の従来型SEOでは、バックリンクやキーワードなどの要素が検索結果での表示位置(ランキング)につながる。右側のAI時代の評価では、権威性や鮮度などの要素が、検索結果での表示に加えてAI生成回答への引用有無にも影響する。評価基準が追加され、複雑化した。

実践的な対策——4つのアクションプラン

これらの変化に対する実践的な対策は明確だ。実行は簡単ではないが、方向性ははっきりしている。

1. アップデートを孤立したイベントとして扱うのをやめる

アルゴリズムのアップデートは、連続的なシステムの出力に過ぎない。短期的な変動に対応するよりも、長期的な方向性に向けて最適化する方が効果的だ。

Search Engine Journalの記事では、信号の半減期が短くなったと指摘する。6ヶ月前に有効だった手法が今も重要かもしれないが、定期的ではなく継続的に再評価されている。

2. エンティティレベルでの権威性への投資

自社サイトを超えた認知を構築する。どこで、どのように言及されるかは、何を公開するかと同じくらい重要だ。

PR、パートナーシップ、思想のリーダーシップ、ブランドの存在感などのエンティティ構築努力は、SEOから切り離せなくなった。これらはランキングだけでなく、情報抽出の候補に含まれるかどうかにも影響する。

3. コンテンツの継続的なメンテナンス

鮮度は一度きりのシグナルではない。関連性の継続的な実証だ。重要なコンテンツを維持する。すべてを常に書き直す必要はないが、重要な情報が最新であることを確認する。

4. 独自性のある価値を優先する

独自の洞察、データ、専門知識は、派生コンテンツよりも耐久性がある。AIシステムはより多くのコンテンツを求めているのではなく、より良い入力を求めている。

5. 使いやすさのために構造化する

コンテンツを読みやすくするだけでなく、抽出しやすくする。明確な見出し、論理的な階層、直接的な表現を採用する。AIが情報を簡単に引き抜けるように設計する。

この記事のポイント

- AI駆動の検索システムは権威性・鮮度・独自性の3要素を重視する

- 権威性は評価の「入り口」であり、これがないとコンテンツは考慮されない

- 鮮度は「いつ公開されたか」ではなく「維持されているか」が重要になった

- 独自性のある情報(調査・データ・洞察)がAIに高く評価される

- コンテンツ構造は「見た目」ではなく「抽出のしやすさ」のために重要

- 従来のSEO対策だけではAI生成回答への引用は獲得できない

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIエージェントに最適化されたWebサイトとは?Cloudflareが提唱するAgent Readinessスコアの全容

Webサイトのあり方が、人間がブラウザで閲覧するものから、AIエージェントが自律的に情報を収集し処理するものへと劇的に変化している。かつてWebサイトが検索エンジンに最適化(SEO)されたように、これからはAIエージェントが理解しやすい形に最適化される必要がある。

Cloudflare(クラウドフレア)は、自社サイトがどの程度AIエージェントに対応できているかを測定するツール「isitagentready.com」を公開した。これは、AIがサイトをクロールし、内容を理解し、さらには決済まで行える状態にあるかを数値化する指標である。

現在、インターネット上の主要な20万ドメインを調査した結果、AIエージェントへの最適化が進んでいるサイトは極めて少ないことが判明した。しかし、これは早期に対応することで、競合他社よりもAIによる情報提供やサービス利用の面で優位に立てる可能性があることを示唆している。

AIエージェント向けのWeb最適化指標であるAgent Readinessとは

Agent Readiness(エージェント・レディネス)は、WebサイトがAIエージェントという新しい「訪問者」をどれだけ歓迎し、効率的に情報を渡せるかを示す新しい概念である。Cloudflareが提供を開始した「isitagentready.com」では、URLを入力するだけで、そのサイトの対応状況をスコア化できる。

このスコアは、単に「AIを拒否していないか」を確認するだけのものではない。AIがサイト内を迷わずに移動できるか、情報を処理する際のコスト(トークン数)を削減できているか、そしてAIが自律的にアクションを起こせるかといった多角的な視点で評価される。

評価を構成する4つの主要な軸

Agent Readinessスコアは、主に以下の4つのカテゴリに基づいて算出される。それぞれの要素は、AIエージェントがサイトを訪れた際の「体験」を向上させるために不可欠なものだ。

- ディスカバリー(発見しやすさ):AIがサイトの構造を即座に把握し、必要なページへたどり着けるか

- コンテンツの最適化:AIが理解しやすい形式(Markdownなど)でデータを提供しているか

- 制御とセキュリティ:AIの行動範囲を適切に制限し、信頼できるAIかどうかを認証できるか

- インタラクション(相互作用):AIがAPIを介してツールを操作したり、決済を行ったりできるか

Cloudflare Radarの調査によれば、現在インターネット上の主要なサイトの約78%が「robots.txt」を設置しているが、そのほとんどは従来の検索エンジン向けに書かれたものである。AIエージェントに特化した設定を行っているサイトは、まだ全体の数パーセントに過ぎない。

AIエージェントに情報を届けるための新規格と実装方法

AIエージェントがWebサイトを巡回する際、最大の障壁となるのが「HTMLの複雑さ」である。人間向けの装飾や広告が含まれるHTMLは、AIにとってノイズが多く、処理に多くのトークンを消費させる。これを解決するための新しい標準規格が登場している。

llms.txtによる「AI専用のお品書き」の提供

「llms.txt」は、Webサイトのルートディレクトリに配置するプレーンテキストファイルである。これは、AI(大規模言語モデル)に対して、サイトの概要や重要なコンテンツへのリンクをリスト化した「読書リスト」のような役割を果たす。サイトマップをAIが読みやすい言葉で書き直したものと考えると分かりやすい。

# サイト名

> サイトの短い説明文

## 主要ドキュメント

- [導入ガイド](https://example.com/docs/intro.md)

- [APIリファレンス](https://example.com/docs/api.md)このファイルを設置することで、AIは数千ページあるサイトの中から、どのページを優先的に読むべきかを瞬時に判断できる。これにより、AIエージェントの回答精度が向上し、ユーザーが求める情報にたどり着くまでの時間が短縮される。

Markdownコンテンツ・ネゴシエーションによる軽量化

コンテンツ・ネゴシエーションとは、クライアント(訪問者)の要望に合わせて、サーバーが最適な形式のデータを返す仕組みである。AIエージェントがHTTPヘッダーに Accept: text/markdown を含めてリクエストを送った際、サーバーがHTMLではなくMarkdown形式を返すように設定することが推奨されている。

HTMLからMarkdownへの切り替えは、AIが消費するトークン数を最大で80%削減できるというデータがある。トークンの削減は、AIの処理速度を上げ、運用コストを下げることに直結する。以下のデモは、HTMLとMarkdownでどれほど情報の密度が異なるかを視覚化したものである。

投稿日:2026年4月17日

# 最新ニュース

WebサイトのAI最適化が始まりました。

[詳細](https://example.com/news/1)

このデモのように、AIにとっては構造化されたテキストのみの方が扱いやすく、誤認のリスクも低い。Cloudflareでは、URLの末尾に /index.md を付与することで、動的にMarkdownを返す仕組みを推奨している。

AIエージェントの制御とセキュリティの新基準

すべてのAIエージェントにサイトを解放するのが正解とは限らない。コンテンツの無断学習を拒否したい、あるいは特定の信頼できるエージェントにのみアクセスを許可したいというニーズがある。これに対応するための規格が「Content-Signal」と「Web Bot Auth」である。

Content-Signalによる詳細な意思表示

従来の robots.txt では、アクセスを許可するか拒否するかという二択しかできなかった。新しい「Content-Signal」ディレクティブを使うと、AIによる学習(ai-train)、推論への利用(ai-input)、検索結果への表示(search)を個別に制御できる。

User-agent: *

Content-Signal: ai-train=no, search=yes, ai-input=yes例えば、上記の記述では「AIの学習には使わせないが、AIがユーザーの質問に答える際の参考資料(RAG)としての利用や、検索結果への掲載は許可する」という柔軟な設定が可能になる。これにより、著作権を守りつつ、AIを介したトラフィックを確保できる。

Web Bot Authによるエージェントの身元確認

悪意のあるボットがAIエージェントを装ってアクセスしてくるリスクに対し、「Web Bot Auth」という認証規格が提案されている。これは、エージェントがリクエストにデジタル署名を付与し、サイト側がその署名を公開鍵で検証する仕組みである。

これにより、サイト運営者は「このアクセスは確かにOpenAIの公式エージェントからのものだ」と確信を持ってアクセスを許可できるようになる。匿名のスクレイパーと、正当なAIサービスを明確に区別するための重要なインフラとなるだろう。

自律的なアクションを可能にするAPIと決済の統合

AIエージェントの真の価値は、情報の閲覧だけでなく、ユーザーの代わりに「行動」することにある。買い物、予約、データの処理といったタスクをAIが自律的にこなすためには、WebサイトがAI向けの「窓口」を備えていなければならない。

MCP(Model Context Protocol)の活用

MCPは、AIモデルが外部のデータソースやツールと接続するためのオープン標準である。サイト側が「MCPサーバー」を用意し、その機能(ツール)を記述した「サーバーカード」を /.well-known/mcp/server-card.json に配置することで、AIはどのような操作が可能かを理解できる。

例えば、ドキュメント検索ツールや在庫確認ツールをMCP経由で公開すれば、AIエージェントは自らそのツールを呼び出し、ユーザーの複雑な要求に応えることができるようになる。これは、AIが「サイトを読む」段階から「サイトを使う」段階への進化を意味する。

HTTP 402によるマシン間決済の復活

AIエージェントが有料の情報を取得したり、商品を購入したりする場合、人間向けのクレジットカード入力画面は機能しない。そこで注目されているのが、長らく使われてこなかったHTTPステータスコード「402 Payment Required」の活用である。

「x402」と呼ばれるこの新しい決済フローでは、AIがリクエストを送ると、サーバーが402エラーとともに「支払い条件」を機械読み取り可能な形式で返す。エージェントはその条件に従って決済を行い、再度リクエストを送ることでコンテンツを取得できる。人間を介さない、マシン間の経済圏を支える技術である。

Cloudflare ドキュメントに見るAI最適化の実践事例

Cloudflareは自社の開発者向けドキュメントにおいて、これらの規格をいち早く導入している。その結果、AIエージェントによる回答速度が66%向上し、消費トークン数が31%削減されたという。具体的にどのような工夫がなされているのかを見てみよう。

URL書き換えによる動的なMarkdown提供

Cloudflareは、既存のHTMLページをわざわざMarkdownで書き直すのではなく、エッジコンピューティング(Cloudflare Rules)を活用して動的に変換している。URLの末尾に /index.md を付けると、オリジナルのHTMLからタグを取り除き、Markdownとして配信する仕組みだ。

これにより、メンテナンスコストを増やすことなく、人間向けとAI向けのコンテンツを両立させている。また、大規模なサイトでは llms.txt が巨大になりすぎるため、ディレクトリごとに分割した llms.txt を用意し、ルートからそれらをリンクする階層構造を採用している。

古い情報をAIに学習させないためのリダイレクト

Webサイトには、歴史的な理由で残されている古いドキュメント(非推奨のツールなど)が存在する。人間は「非推奨」という警告バナーを見て判断できるが、AIクローラーはテキストをそのまま飲み込んでしまい、古い情報をユーザーに教えてしまうことがある。

Cloudflareでは、AI学習用クローラーを識別し、古いページから最新のページへと強制的にリダイレクトさせる処理を行っている。これにより、AIが常に最新かつ正確な情報のみを学習するように制御している。これは、AI時代の新しいコンテンツ管理の形と言えるだろう。

独自の分析:Webサイトは「読むもの」から「使われるもの」へ

Agent Readinessの普及は、Webサイトの設計思想を根本から変える可能性がある。これまでのWebデザインは、いかに人間の視線を誘導し、クリックさせるかという「UI/UX」が中心だった。しかし、AIエージェントが主役となる世界では、いかに機械が迷わず、低コストで目的を達成できるかという「DX(Developer Experience)ならぬAX(Agent Experience)」が重要になる。

特に注目すべきは、AIエージェントが「ブラウザ」を介さずに直接サーバーと対話するようになる点だ。これは、Webサイトが「情報の展示場」から「プログラム可能なインターフェース」へと進化することを意味している。APIが公開されていない小規模なサイトでも、llms.txt やMarkdown配信を導入することで、AIという強力な力を味方につけることができる。

今後、Googleなどの検索エンジンも、Agent Readinessスコアが高いサイトを「AIフレンドリーな良質なソース」として優遇する可能性がある。SEOの次のステージとして、この「AI最適化」への取り組みは、企業のデジタル戦略において避けて通れない課題となるだろう。

この記事のポイント

- Agent Readinessスコアの登場:WebサイトがAIエージェントにどれだけ最適化されているかを測定する新しい指標が公開された

- llms.txtとMarkdownの重要性:AI専用の案内図(llms.txt)と軽量なデータ形式(Markdown)が、AIの回答精度向上とコスト削減に直結する

- 詳細なアクセス制御:Content-Signalにより、学習は拒否しつつ検索や推論への利用を許可するなど、柔軟な意思表示が可能になる

- マシン間経済の加速:MCPによるツールの公開や、x402による自動決済など、AIが自律的にアクションを起こすためのインフラが整いつつある

- 早期対応のメリット:現状では対応サイトが少ないため、今すぐ対策を始めることでAI経由のトラフィックや利便性において大きなアドバンテージを得られる

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

SEOの成果を最大化するホスティングの役割とbrightonSEO 2026の展望

SEO(検索エンジン最適化)において、多くの担当者はコンテンツの質やバックリンクの獲得、キーワード選定に膨大な時間を費やす。しかし、それらの努力を支える「土台」であるホスティング環境が軽視されるケースは少なくない。

2026年4月30日から5月1日にかけて、英国ブライトンで開催される世界最大級の検索会議「brightonSEO 2026」に、ホスティングプロバイダーのKinstaがスポンサーとして参加する。今回のイベントでは、SEOの成果を左右するインフラの重要性が改めて議論される見通しだ。

サーバーの応答速度や安定性が、どのように検索順位やユーザー体験に影響を与えるのか。本記事では、brightonSEO 2026の概要とともに、最新のSEO戦略におけるホスティングの役割を技術的な視点から詳しく解説する。

SEOにおけるホスティングの決定的な役割

SEOチームがコントロールできる要素は多いが、ランキングに直接影響を与えるアルゴリズムのすべてを制御できるわけではない。その中で、ホスティング環境はサイトのパフォーマンス、可用性、そしてクローラーに対する親和性を決定づける重要な基盤となる。

サイトスピードと検索順位の相関

Googleをはじめとする検索エンジンは、ページの読み込み速度をランキング要因の一つとして明示している。特にモバイル検索においては、数秒の遅延が直帰率の劇的な上昇を招き、検索順位の低下に直結する。高速なサーバー環境は、TTFB(Time to First Byte / サーバーがリクエストを受けてから最初の1バイトを返すまでの時間)を短縮し、ページ全体の表示速度を底上げする。

TTFBは、DNSの解決速度、サーバーの処理能力、データベースの最適化状態によって左右される。共有サーバーのようなリソースが制限された環境では、他サイトの負荷に影響を受けてTTFBが悪化することが多いが、マネージドホスティングや専用リソースを持つ環境では、安定した高速レスポンスが期待できる。

サーバーの安定性とインデックスへの影響

サイトが頻繁にダウンしたり、サーバーエラー(5xx系)を返したりする場合、検索エンジンのクローラーはサイトの信頼性が低いと判断する。これが継続すると、インデックスから削除されたり、クローラーの巡回頻度が下げられたりするリスクがある。SEOの成果を維持するためには、99.9%以上の高い稼働率(アップタイム)を保証するインフラが不可欠だ。

以下のデモは、サーバーの応答速度(TTFB)の差が、ユーザーがコンテンツを目にするまでの時間にどのような影響を与えるかを視覚化したものだ。

このデモが示すように、インフラの性能差はページの表示開始タイミングに決定的な差を生む。SEOチームがどれだけ画像を軽量化しても、サーバーの初動が遅ければその効果は半減してしまう。

コアウェブバイタルとインフラの最適化

Googleが重要視するCWV(Core Web Vitals / コアウェブバイタル)は、ユーザー体験を数値化した指標だ。これらは単なるフロントエンドの最適化だけでなく、背後のサーバー性能とも密接に関わっている。

LCPを改善するエッジコンピューティング

LCP(Largest Contentful Paint / 最大視覚コンテンツの表示時間)は、ページ内の最も大きな要素(メイン画像や見出し)が表示されるまでの時間を測定する。これを改善するためには、静的資産だけでなく動的なHTMLドキュメントそのものをユーザーに近い場所から配信する必要がある。

CDN(Content Delivery Network)を活用し、エッジサーバーでキャッシュを保持することで、物理的な距離による遅延を解消できる。最近の高性能なホスティングでは、エッジキャッシュを標準搭載し、世界中どこからアクセスしても瞬時にページを表示できる仕組みを整えている。

CLSとインフラの安定性

CLS(Cumulative Layout Shift / 累積レイアウトシフト)は、読み込み中の意図しないレイアウトのズレを測定する。一見するとCSSの問題に見えるが、広告スクリプトや外部リソースの読み込みがサーバーの遅延によって不安定になると、ブラウザがレンダリングのタイミングを測れず、結果としてCLSが悪化することがある。

安定した高帯域幅を持つネットワークインフラは、リソースの並行読み込みをスムーズにし、ブラウザが予測通りにページを組み立てるのを助ける。HTTP/3のような最新プロトコルのサポートも、多重化されたリソース転送を効率化し、ユーザー体験の向上に寄与する。

クローラーの効率を高めるサーバー戦略

SEOにおいて「見落とされがちだが重要」なのが、クローラーに対する最適化だ。検索エンジンのボットがサイトを巡回する際、サーバーの応答が遅かったりエラーが多かったりすると、クローラーはそのサイトの巡回を切り上げてしまう。

クロールバジェットの最適化

クロールバジェットとは、検索エンジンが特定のサイトに対して割り当てる「巡回リソースの総量」のことだ。大規模なサイトや更新頻度の高いサイトでは、このバジェットをいかに効率よく消費させるかが重要になる。

サーバーが高速に応答すれば、同じ時間内にクローラーはより多くのページを巡回できる。結果として、新しい記事のインデックスが早まったり、既存記事の修正が検索結果に素早く反映されたりするメリットが生まれる。インフラの性能向上は、サイト全体の「鮮度」を保つための必須条件といえる。

最新技術によるクロール効率の向上

最近のホスティング環境では、クローラーからのリクエストを識別し、リソース消費を最適化する機能が提供されている。例えば、不要なボットのアクセスを遮断しつつ、Googlebotなどの重要なクローラーには優先的にリソースを割り当てる設定が可能だ。これにより、サイトの負荷を抑えつつSEO効果を最大化できる。

以下の図は、SEO施策のレイヤー構造を示したものである。インフラがすべての施策の土台になっていることがわかるだろう。

(速度・可用性・セキュリティ・クロール効率)

brightonSEO 2026とKinstaの取り組み

2026年4月30日から5月1日に開催される「brightonSEO 2026」は、SEO業界の最前線に立つ専門家が集結するイベントだ。Kinstaはこのイベントのスポンサーとして、SEOにおけるホスティングの役割を再定義しようとしている。

イベントでの主要テーマ

brightonSEOでは、コンテンツ制作やリンクビルディングだけでなく、テクニカルSEOの重要性が毎年強調される。2026年の開催では、AIによる検索体験の変化(SGEなど)や、より高度なユーザー体験の数値化が焦点になると予想される。Kinstaのブース(#29)では、これらの変化に対応するためのインフラ構成について、専門チームによる相談が行われる予定だ。

Kinstaチームとの交流

当日は、KinstaのパートナーシップマネージャーであるMarcel Bootsman氏や、SEOチームリードのAntonio Tinoco氏をはじめとする専門家が参加する。彼らは、ホスティングがいかにコアウェブバイタルを支え、大規模サイトのクロール効率を改善するかについて、具体的な事例を交えて解説するだろう。オレンジ色のTシャツを着たスタッフが、サイトの成長を支える強固な基盤作りのヒントを提供してくれるはずだ。

2026年以降のSEOとインフラ戦略の展望

AI検索エンジンが台頭する2026年において、SEOの定義は「検索結果の1位を取ること」から「AIによって信頼できるソースとして選ばれること」へと広がりつつある。

AIクローラーへの対応

AI検索エンジンは、従来のGooglebotよりも頻繁かつ詳細にサイトをスキャンすることがある。また、情報の正確性だけでなく、情報の「取得のしやすさ」も評価の対象になる可能性が高い。高速で安定したサーバーは、AIクローラーに対しても「信頼できる高品質なサイト」というシグナルを送ることになる。

ユーザー体験の絶対化

SEOのテクニックが高度化する一方で、最終的な評価を下すのは「人間」である。ページが瞬時に開き、ストレスなく操作できることは、どんなコンテンツよりも先にユーザーが感じる価値だ。インフラへの投資は、単なるSEO対策を超えた「ブランド体験」の向上に直結する。

Kinstaのチームは、ホスティングがSEOに与える影響は今後さらに拡大すると見ている。サイトの成長に合わせて柔軟にスケールでき、かつ高度なセキュリティとパフォーマンスを維持できる環境こそが、2026年以降のデジタル戦略の勝敗を分けるだろう。

この記事のポイント

- ホスティングはSEOの「土台」であり、速度・安定性・クロール効率に直結する。

- TTFB(サーバー応答時間)の短縮は、すべてのフロントエンド最適化の前提条件となる。

- コアウェブバイタルの改善には、エッジキャッシュなどのインフラ技術の活用が不可欠だ。

- brightonSEO 2026では、インフラがSEOの成果をいかに最大化するかが議論される。

- AI検索時代において、高速で安定したサイト基盤は「信頼性」の重要な指標となる。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIが買い物をする時代へ!エージェント・コマース(Agentic Commerce)の仕組みと対応策

ネット通販における「決済ページ」という概念が消えようとしている。これまで30年間、オンラインで物を買うには名前や住所、クレジットカード番号をフォームに入力するのが当たり前だった。しかし、AIエージェントがユーザーの代わりに商品を探し、そのまま購入まで完了させる「エージェント・コマース」が急速に現実のものとなっている。

2025年から2026年にかけて、Stripe、OpenAI、Shopify、Googleといったテック巨人が相次いで新しい決済プロトコルを発表した。これにより、チェックアウトは「Webページ」で行う作業から、システム間で完結する「プロトコル」へと進化を遂げている。もはや人間がフォームを埋める必要はない。

この変化は、Web制作やECサイト運営に携わる者にとって無視できないパラダイムシフトだ。AIエージェントに自社の商品を見つけてもらい、スムーズに決済してもらうためには、サイトの構造そのものを「マシン・リーダブル(機械が理解可能)」に変えていく必要がある。本記事では、最新の業界動向と技術仕様を基に、エージェント・コマースの全貌を解説する。

決済は「ページ」から「プロトコル」へ進化する

1994年に世界で初めてオンライン決済が行われて以来、ECの歴史は「摩擦の解消」の歴史だった。物理的な店舗に行く手間を省き、価格比較の手間を省き、レコメンド機能によって探す手間を省いてきた。エージェント・コマースは、その進化の最終段階といえる。ユーザーが「これを買っておいて」とAIに頼むだけで、決済まで完了するからだ。

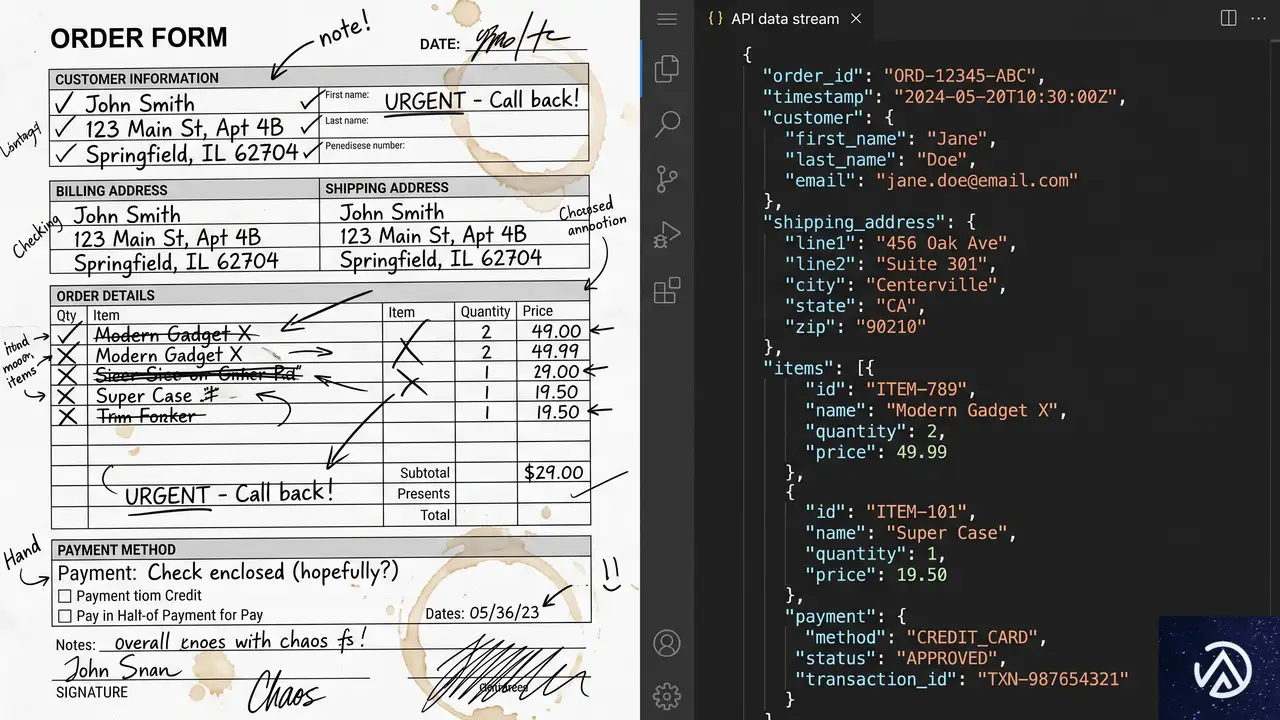

30年続いた「フォーム入力」の終焉

従来のECサイトでは、売り手がチェックアウト体験を設計していた。ボタンの色やフォームの配置を工夫し、いかにカゴ落ちを防ぐかがコンバージョン率向上の鍵だった。しかし、エージェント・コマースでは、チェックアウトのインターフェースを作るのはAIエージェント側だ。ChatGPTなどのAIが、チャット画面の中で商品情報と購入ボタンを提示する。ユーザーがそこで承認すれば、裏側でAPIが呼び出され、決済が完了する。

売り手側の仕事は、魅力的なページを作ることではなく、構造化された商品データを提供し、注文を処理するAPIエンドポイントを用意することにシフトする。Stripeの情報によれば、コマースの課題はユーザー体験(UX)の問題からプロトコルの問題へと変化しているという。つまり、見た目の美しさよりも、機械がいかに正確にデータを読み取れるかが重要になるのだ。

AIエージェントが購入を代行する仕組み

AIエージェントによる購入は、人間がブラウザを操作するのとは全く異なるプロセスを辿る。エージェントはサイトの視覚的なデザインを無視し、テキストデータやメタデータ、APIを通じて情報を取得する。決済時には、ユーザーがあらかじめAIプラットフォームに登録しておいた支払い情報が使われる。売り手側のサイトにユーザーが直接クレジットカード情報を入力することはない。

このデモは、購入プロセスの構造的な変化を視覚化したものだ。人間が介在するステップが大幅に短縮されていることがわかる。

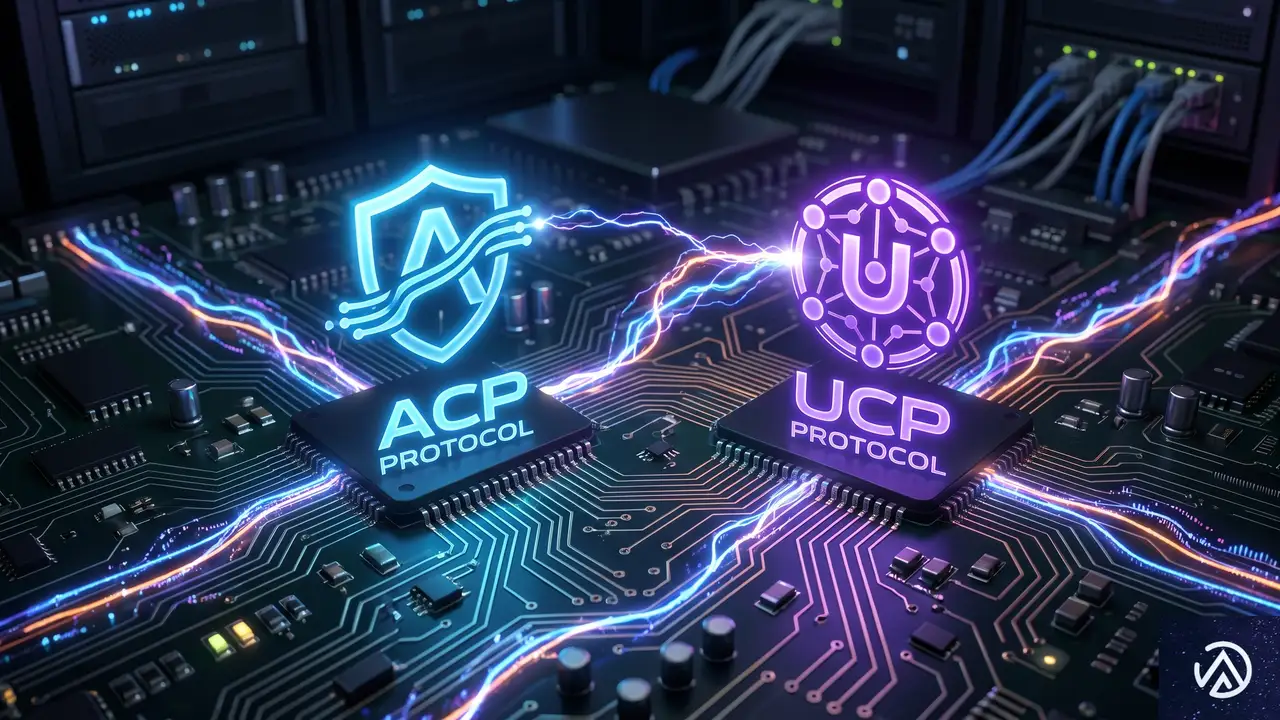

二大勢力が競う「エージェント・コマース」の標準規格

現在、この新しい市場を支配しようと、二つの大きなプロトコルが標準化を競っている。一つはOpenAIとStripeが主導する「ACP」、もう一つはGoogleとShopifyが主導する「UCP」だ。これらは対立するものではなく、補完し合う関係にあるが、それぞれの設計思想には違いがある。

StripeとOpenAIによる「ACP」

ACP(Agentic Commerce Protocol / エージェント・コマース・プロトコル)は、2025年9月に発表されたオープン標準だ。主にChatGPT内での「インスタント・チェックアウト」を実現するために設計されている。ACPは、AIエージェント、売り手、支払いサービスプロバイダーの三者が通信するための4つのAPIエンドポイントを定義している。

具体的には、カートの作成、情報の更新、決済の完了、そしてキャンセルの4段階だ。売り手は自社のシステムをこれらのエンドポイントに対応させるだけで、ChatGPTを通じて商品を販売できるようになる。Stripeはこの導入を容易にするために「Agentic Commerce Suite」を提供しており、既存のStripeユーザーであれば最小限のコードで対応が可能だ。すでにWalmartやInstacartといった大手がこの仕組みを導入し、ChatGPT経由での販売を開始している。

ShopifyとGoogleによる「UCP」

UCP(Universal Commerce Protocol / ユニバーサル・コマース・プロトコル)は、2026年1月にGoogleとShopifyが発表した。ACPが決済フローに特化しているのに対し、UCPは商品の発見から購入後のサポートまで、コマース体験の全工程をカバーすることを目指している。その構造はインターネットの基本プロトコルであるTCP/IPをモデルにしており、非常に拡張性が高い。

UCPの特徴は、サイトの特定の場所に設置された「/.well-known/ucp」というエンドポイントを通じて、AIエージェントがそのサイトの販売能力を自動的に認識できる点にある。Google検索やShopifyのプラットフォームと深く統合されており、多くのEC事業者が意識せずともAIエージェントに対応できる環境を整えようとしている。MastercardやVisaといったカードネットワークもUCPへの支持を表明しており、より広範なエコシステムを形成している。

「人がいない決済」を支えるセキュリティ技術

エージェント・コマースにおける最大の課題はセキュリティだ。クレジットカードの持ち主がその場にいない「Person-not-present(本人が不在の決済)」において、どうやって不正を防ぎ、信頼を担保するのか。これまでの「カード番号とCVVを知っていれば本人とみなす」という前提は、AIの時代には通用しない。

Shared Payment Tokens(共有支払いトークン)の役割

この問題に対するStripeの回答が「Shared Payment Tokens(SPT)」だ。これは、AIプラットフォームが発行する、特定の取引専用の使い捨てトークンである。ユーザーがChatGPTで「購入」を承認すると、ChatGPTは特定の売り手、特定の金額、特定の有効期限に限定されたトークンを発行する。売り手はこのトークンを使ってStripeに決済を依頼する。

この仕組みの優れた点は、売り手にもAIエージェントにも、ユーザーの本物のクレジットカード情報が渡らないことだ。万が一データが漏洩しても、そのトークンは他の場所では使えない。また、Googleが推進するAP2プロトコルでは、デジタル署名を用いてユーザーの同意を厳密に検証する仕組みが導入されている。これにより、AIが勝手に高額な買い物をするといったリスクを技術的に排除している。

クレジットカード各社の「Trusted Agent」対応

VisaやMastercardといったカードネットワークも、AI時代に合わせた新しい枠組みを構築している。Visaが発表した「Trusted Agent Protocol」は、正規のAIエージェントと悪意のあるボットを識別するためのフレームワークだ。従来の不正検知システムは、マウスの動きやタイピングの癖といった「人間らしい振る舞い」を指標にしていたが、AIエージェントにはそれが存在しない。

そのため、新しいシステムでは、AIエージェントの身元を暗号学的に証明し、そのエージェントがユーザーから正当な権限を与えられているかを確認することに主眼が置かれている。Stripeの調査によれば、消費者の88%がAIによるなりすまし詐欺を懸念しているが、こうした堅牢なインフラが整備されることで、徐々に信頼が醸成されていくとの見方がある。

自社の商品を「AIに売る」ための具体策

エージェント・コマースの波に乗るために、ECサイトの運営者は今何をするべきか。最新のプロトコルに対応することも重要だが、その基礎となるのは「データ」の質だ。AIエージェントがサイトを訪れた際、迷うことなく商品を理解し、推奨できるように準備しておく必要がある。

マシン・リーダブルな商品データの整備

AIエージェントはプログラムによってカタログを解析する。そのため、曖昧な表現や、画像の中にだけ書かれた情報は理解できない。例えば、商品タイトルを「青いシャツ」とするのではなく、「メンズ オーガニックコットン クルーネック Tシャツ、ネイビー」のように具体的かつ詳細に記述することが求められる。素材、寸法、お手入れ方法、用途といった情報を、すべてテキストデータとして網羅しておくことが重要だ。

また、価格や在庫状況がリアルタイムで正確であることも欠かせない。AIエージェントが「在庫あり」と判断してユーザーに提案したのに、いざ決済しようとしたら「在庫切れ」だったという体験は、エージェントからの信頼を失う原因になる。AIは信頼性の高いソースを優先的に選ぶ傾向があるため、正確な情報提供はSEOならぬ「AI-SEO」の根幹となる。

構造化データ(Schema.org)の重要性

プロトコルへの直接的な統合が難しい場合でも、構造化データのマークアップは今すぐ実行できる強力な対策だ。Schema.orgの Product スキーマを使い、名前、説明、画像、SKU、ブランドなどの情報を正しくタグ付けする。さらに、その中に Offer スキーマをネストさせ、価格、通貨、在庫状況、販売者を明記する。

BingでSchema.orgの立ち上げに携わったDuane Forrester氏によれば、一貫した構造化データを提供し続けることで、AIシステムの中に「マシン・コンフォート・バイアス(機械的な安心感による偏り)」が生まれるという。つまり、AIが「このサイトの情報は常に正確で読み取りやすい」と学習すれば、競合他社よりも優先的に引用・推奨されるようになる可能性があるのだ。

- 商品タイトルを具体的かつ詳細にする

- 素材、サイズ、用途をテキストで網羅する

- Schema.org(Product/Offer)を全商品に適用する

- 在庫と価格をリアルタイムで同期する

- 画像に適切なaltテキスト(代替テキスト)を付与する

このリストにある項目は、従来のSEO対策とも共通する部分が多いが、AIエージェントを意識する場合は「より厳密な正確性」が求められる点に注意が必要だ。

独自の分析:AI SEOがECの勝敗を分ける

エージェント・コマースの普及に伴い、EC業界には「選択の均質化」という新たなリスクが浮上している。コロンビア大学とイェール大学の共同研究によれば、現在のAIショッピングエージェントは、少数の特定商品に需要を集中させる傾向があるという。人間のように検索結果の2ページ目や3ページ目まで丹念に探すことはせず、アルゴリズムが「最適」と判断したトップ数件だけが選ばれる「勝者総取り」の構図が強まるのだ。

これは、中小規模のブランドにとっては大きな脅威であると同時に、チャンスでもある。巨大な広告予算がなくても、AIが理解しやすい高品質なデータを提供し、特定のニッチなニーズに対して「最も正確な回答」を提示できれば、AIエージェントに選ばれる可能性が高まるからだ。これからのEC戦略は、人間の感性に訴えるデザインと、機械の論理に応えるデータの両立が不可欠になる。

また、今後は「AIエージェント向けの広告」という概念も登場するだろう。しかし、Anthropic(Claudeの開発元)のように、広告やスポンサーリンクを一切排除したクリーンなコマース体験を標榜するプラットフォームも存在する。売り手としては、特定のプラットフォームに依存するのではなく、ACPやUCPといったオープンな標準規格に対応し、どこからでも「見つけられ、買える」状態を作っておくことが、長期的な生存戦略となるはずだ。

この記事のポイント

- 決済は「ページ」から「プロトコル」へ移行し、人間によるフォーム入力が不要になる

- StripeとOpenAIの「ACP」、ShopifyとGoogleの「UCP」という二大規格が標準化を競っている

- 「共有支払いトークン(SPT)」などの技術により、本人が不在でも安全な決済が可能になる

- ECサイトは、詳細なテキストデータとSchema.orgの導入により、AIに選ばれる準備をすべきだ

- AIエージェントによる「選択の均質化」が進むため、正確な情報の提供が生き残りの鍵となる

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

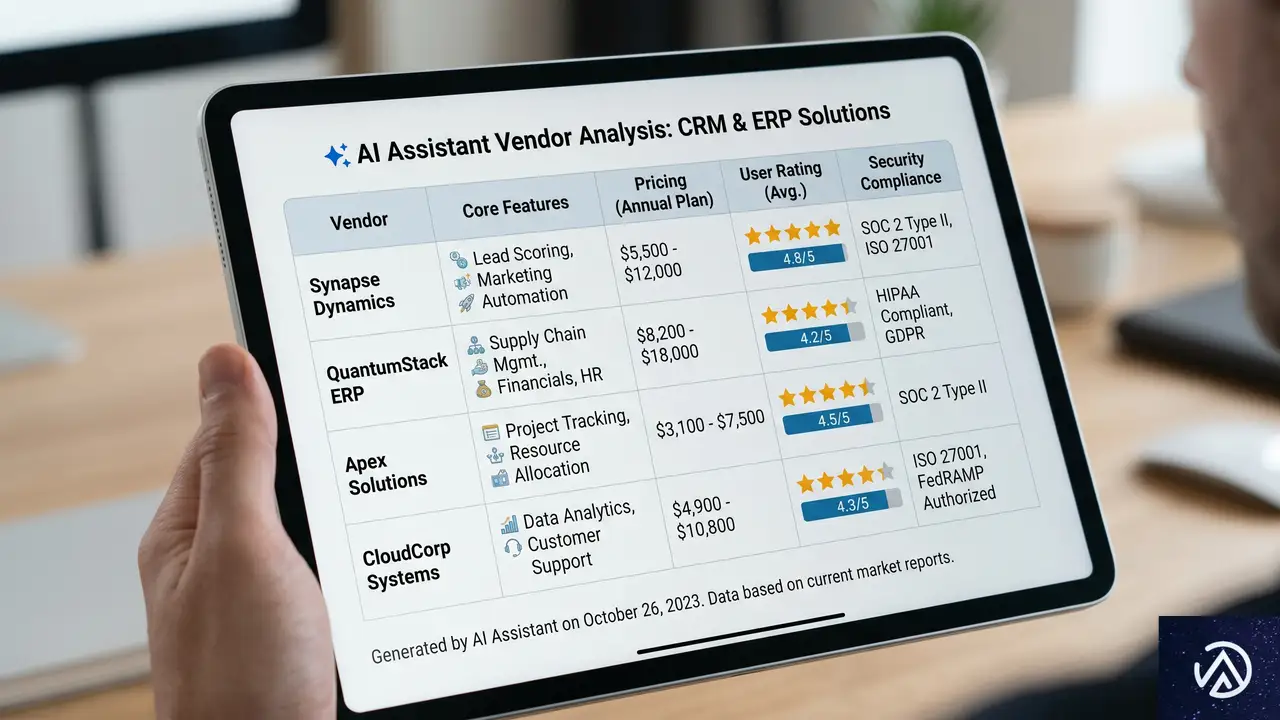

B2B購買の主戦場はAIチャットボットへ。ショートリスト入りを勝ち取るための新戦略

B2Bビジネスにおける顧客の購買行動が、今まさに劇的な転換点を迎えている。これまではGoogleなどの検索エンジンで情報を探し、複数のウェブサイトを比較検討するのが一般的だった。しかし、最新の調査によれば、多くの購買者がそのプロセスをAIチャットボットに委ね始めていることが明らかになった。

米G2が発表した最新レポートによると、B2Bソフトウェアの購買層のうち71%が、調査の過程でAIチャットボットを利用している。さらに驚くべきことに、51%の購買者が「Googleよりも先にAIチャットボットで調査を開始する」と回答している。これは、従来のSEO(検索エンジン最適化)戦略だけでは、もはや顧客の視界に入ることすら難しくなっていることを示唆している。

本記事では、AIが購買決定の「門番」となる新たな市場環境において、企業がどのように視認性を確保すべきかを解説する。クリックを奪い合う時代から、AIに選ばれる「回答」を勝ち取る時代へのシフト。その具体的な対策と、B2Bマーケティングの未来像を深掘りしていく。

AIチャットボットがB2B購買の「門番」になる日

かつてB2Bの購買担当者は、検索結果の1ページ目に表示される企業を一つずつクリックし、資料をダウンロードして比較表を作成していた。しかし、この「手作業」によるリサーチは、AIの登場によって過去のものになりつつある。AIチャットボットは膨大な情報を瞬時に要約し、ユーザーに最適な推奨リストを提示してくれるからだ。

検索の起点がGoogleからAIへシフト

G2のレポート「The Answer Economy(回答経済)」によれば、AIチャットボットは今や、購買候補のリスト(ショートリスト)に影響を与える最大の情報源となっている。その影響度は54%に達し、ソフトウェアレビューサイト(43%)やベンダーの自社サイト(36%)を大きく上回っている。

これは、購買者が自社サイトを訪れる「前」に、すでにAIによって選別が行われていることを意味する。AIに推奨されなければ、どれほど優れた製品を持ち、美しいウェブサイトを運営していても、検討の土台にすら乗ることができない。視認性の定義が「検索順位」から「AIの回答に含まれること」へと根本的に変わったのだ。

「回答経済」がもたらす情報の要約と効率化

なぜこれほど急速にAIへの移行が進んでいるのか。その理由は圧倒的な「生産性」にある。調査によれば、53%の購買者が「従来の検索よりもAI検索の方がリサーチの生産性が高い」と感じている。7ヶ月前の調査ではこの数値は36%だったため、短期間でAIの有用性が広く認知されたことがわかる。

AIは単にリンクを表示するのではなく、複数のベンダーの強みと弱みを比較し、特定のニーズに合致するかどうかを数秒で判断してくれる。この「情報の統合(シンセシス)」こそが、多忙なB2B購買担当者がAIを支持する最大の理由だ。もはやユーザーは「どこを見ればいいか」を求めているのではなく、「どれが正解か」を求めているのである。

購買プロセスを激変させる「AIショートリスト」の正体

B2Bマーケティングにおいて「ショートリスト」とは、最終的な選定候補として残った数社のリストを指す。従来、このリストに残るためには、数週間にわたるリサーチと営業担当者との接触が必要だった。しかし今、このプロセスが「ワンショット」で完了しようとしている。

ウェブサイト訪問前に勝負が決まる現実

AIチャットボットを利用するユーザーの多くは、一つのプロンプト(指示文)で推奨ベンダーのリストを出力させる。この時点で、AIが把握していない企業や、AIにとって特徴が不明確な企業は排除される。マーケターがアクセス解析で「直帰率」や「滞在時間」を気にする前に、すでに勝負はついているのだ。

G2の調査では、85%の購買者が「AIに引用されたベンダーに対して、より高い評価を抱く」と回答している。AIによる推奨は、単なる情報の提示ではなく、強力な「お墨付き」として機能している。逆に言えば、AIの回答から漏れることは、信頼性の欠如とみなされるリスクすら孕んでいる。

比較検討の自動化と「ワンショット」の意思決定

購買行動の変化を視覚的に理解するために、従来の検索とAI検索のフローを比較してみよう。従来のフローが「拡散(多くのサイトを見る)」から「収束(絞り込む)」という長いプロセスを辿るのに対し、AI検索は最初から「収束した回答」を提示する。

↓ 10件以上のサイトを訪問

2. 情報収集・手動比較

↓ 数日かけてスプレッドシート作成

3. ショートリスト作成

「〇〇の課題を解決する最適なツールを3つ挙げて」

↓ 数秒で回答生成

2. AIによる推奨リスト(即時ショートリスト化)

↓ 特定のサイトのみ確認

3. 問い合わせ・選定

このフローの変化により、ベンダー側は「自社サイトへ誘導した後の説得」に注力するだけでなく、「AIが回答を生成するための材料」をいかにネット上に配置するかに戦略をシフトさせる必要がある。

マーケターが直面する「クリック」から「回答」への転換

これまでのSEOは、特定のキーワードで上位に表示させ、ユーザーにクリックしてもらうことがゴールだった。しかし、AI時代の新たな最適化指標は「回答の占有率」や「推奨の正確性」へと移り変わる。これをAEO(Answer Engine Optimization / 回答エンジン最適化)と呼ぶ動きもある。

順位よりも「正しく理解されること」の重要性

AIはウェブ上のあらゆる情報を学習し、それらを組み合わせて回答を作る。ここで重要なのは、AIがあなたの製品を「正しくカテゴリー分け」し、「独自の強みを把握」しているかどうかだ。もしAIがあなたの製品を誤解していれば、的外れな比較結果を提示されたり、そもそも推奨から外されたりする。

G2の調査では、69%の購買者が「AIの回答によって、当初予想していたのとは別のベンダーを選んだ」と回答している。これは、AIによる情報提示が購買者の先入観を覆すほどの影響力を持っていることを示している。マーケターは、AIが自社製品をどのように記述しているかを定期的にチェックし、誤った認識があればそれを正すための情報発信を行わなければならない。

第三者評価とレビューがAIの推奨を左右する

AIは自社サイトの主張よりも、第三者による客観的な情報を重視する傾向がある。特に、G2のようなレビューサイト、SNSでの評判、専門メディアの記事などは、AIにとって信頼性の高い「学習データ」となる。

AIに選ばれるためには、自社サイトのコンテンツ制作と同じくらい、外部プラットフォームでの存在感を高めることが不可欠だ。良質なレビューを蓄積し、業界の標準的なカテゴリーにおいて明確な評価を確立することが、AIのショートリストに残るための最短ルートとなる。

EC・B2Bサイト運営者が今すぐ取り組むべきAI最適化戦略

では、具体的にどのような対策を講じるべきか。特にWooCommerceなどを利用してB2B向けのECサイトを運営している場合、製品データの構造化と情報の透明性が鍵を握る。

構造化データと明確なカテゴリー定義の徹底

AI(クローラー)がサイトの内容を理解する手助けをするのが、Schema.orgなどの構造化データだ。単にテキストで「高性能なサーバーです」と書くのではなく、価格、スペック、在庫状況、ユーザー評価などを機械可読な形式で提供することが重要だ。

AIは曖昧な表現を嫌う。例えば「多機能なERP」という表現よりも、「中小規模の製造業に特化した、在庫管理と原価計算に強みを持つERP」というように、ターゲットと提供価値を具体的に記述することで、AIは適切なクエリに対してあなたの製品をマッチングしやすくなる。

独自性と信頼性を担保するコンテンツ設計

AIは「一般的で平均的な情報」をまとめるのは得意だが、独自の洞察や最新の事例については、元の情報源に頼らざるを得ない。自社サイトでしか得られない一次情報(独自の調査レポート、詳細な導入事例、技術的な解説など)を公開し続けることは、AI時代においても強力な武器となる。

以下のデモは、AIがウェブサイトから情報を抽出する際、どのような「構造」を読み取っているかを視覚化したものだ。人間が見るデザインの裏側で、いかにデータが整理されているかがAIの理解度を左右する。

“category”: “在庫管理システム”,

“target_industry”: “製造業”,

“price_model”: “サブスクリプション”,

“unique_selling_point”: “リアルタイム原価計算”

※このデモは、AIがウェブページの情報をどのようにデータとして整理し、推奨の判断材料にしているかの概念を視覚化したイメージである。

独自の分析:AI時代のB2Bブランディングとは

AIが購買のショートリストを作る時代において、皮肉にも最も重要になるのは「人間味のあるブランド」だ。AIは論理的で客観的な比較は得意だが、企業のビジョンや信頼感、文化といった「数値化しにくい価値」を完全に代替することはできない。

AIによって提示された3社のうち、最終的にどこを選ぶか。その段階では、やはり直接ウェブサイトを訪れ、事例を読み、担当者の熱量を感じ取ることになる。つまり、AI対策(AEO)は「検討の土台に乗るため」の手段であり、最終的な「成約」を勝ち取るのは、依然としてブランドの物語や顧客体験(CX)であるという点に留意すべきだ。

また、AIは「世の中の平均的な評価」を反映しやすいため、ニッチな分野で圧倒的なNo.1を目指す戦略がこれまで以上に有効になる。広く浅い情報発信ではなく、特定の課題に対して「この問題ならこの会社」とAIに断言させるほどの専門性を磨くことが、これからのB2B生き残り戦略となるだろう。

この記事のポイント

- B2B購買層の51%がGoogleより先にAIチャットボットでリサーチを開始している

- AIはショートリスト(購入候補)作成において、ベンダー公式サイト以上の影響力を持つ

- 視認性の定義が「検索順位」から「AIの回答に引用されること」へと変化した

- AIに選ばれるためには、構造化データ、第三者レビュー、明確な独自性が不可欠である

- AIは効率的な絞り込みを行うが、最終的な選定にはブランドへの信頼感が決定打となる

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

生成AIの普及率は3年で53%に到達。PCやネットを超える速度がSEOに与える衝撃

スタンフォード大学の人間中心人工知能研究所(HAI)が、最新の調査報告書「2026 AI Index Report」を公開した。このレポートは400ページを超え、技術的パフォーマンスから投資状況、労働市場への影響まで多岐にわたるデータを網羅している。

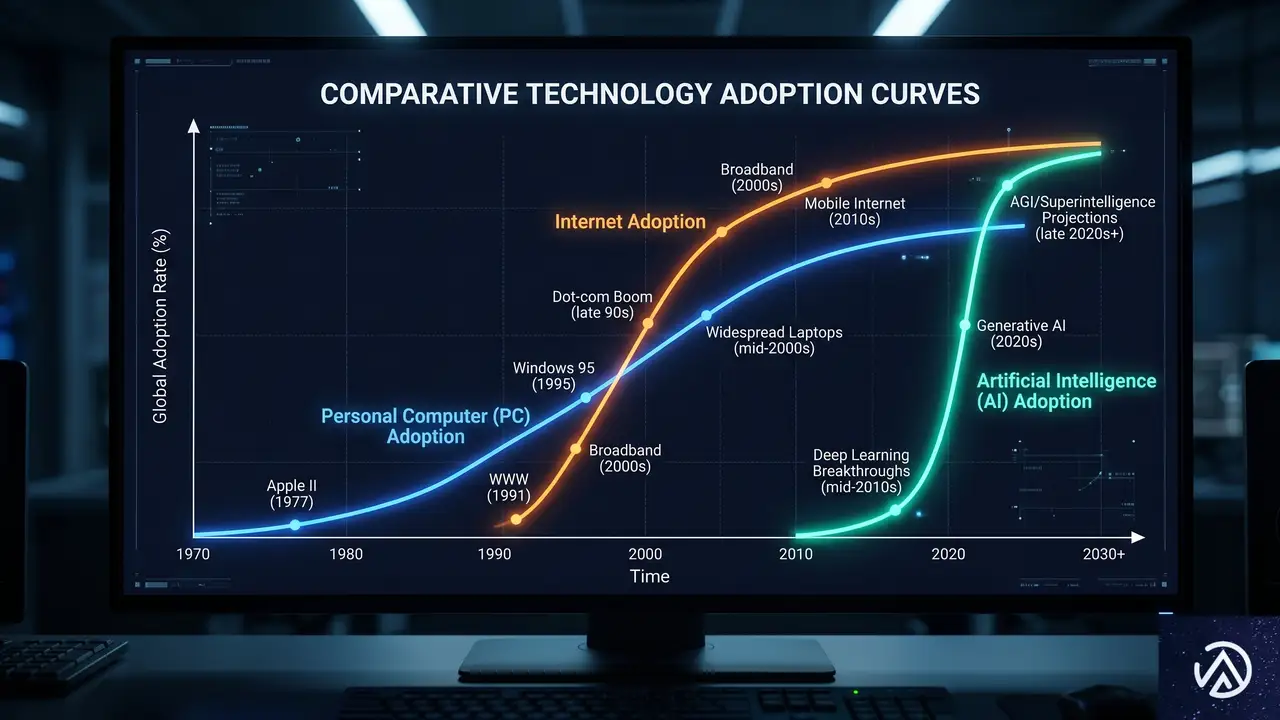

報告書の中で最も大きな反響を呼んでいるのが、生成AIの普及スピードだ。ChatGPTのリリースからわずか3年で、世界人口の53%が生成AIを採用するに至った。これは、かつてのパーソナルコンピュータ(PC)やインターネットが辿った普及速度を大きく上回る数字である。

検索エンジン最適化(SEO)に携わる実務者にとって、この急速な変化は無視できない。ユーザーの検索行動が根本から塗り替えられつつある現状において、データの背後にある真実を理解することが、これからの戦略を左右するだろう。

生成AIの普及速度はPC・インターネットを凌駕

生成AIの普及は、過去のどの技術革新よりも速い。レポートによれば、主要なテクノロジーが一般に浸透するまでの期間を比較した際、生成AIの立ち上がりは際立っている。1981年のIBM PC登場や1995年のインターネット商用化と比較しても、普及曲線は急峻だ。

なぜこれほどまでに速いのか

この爆発的な普及には、先行したインフラの存在が大きく寄与している。ハーバード大学のデビッド・デミング氏は、AIが既存のPCやインターネットの上に構築されたツールであることを理由に挙げている。ユーザーは新しいハードウェアを購入する必要がなく、すでに手元にあるスマートフォンやPCから即座にアクセスできたためだ。

水道や電気が通っている家に、新しい蛇口を取り付けるような手軽さが、53%という驚異的な数字を支えている。インフラ整備の時間を飛び越えて、アプリケーションとしての利便性だけが先行して広がった結果といえる。

「普及」の定義と実態の差

ただし、この53%という数字を鵜呑みにするのは注意が必要だ。レポートでは、一度でもChatGPTなどのツールを試したユーザーも「採用者」としてカウントされている可能性がある。毎日8時間フル活用している専門家と、一度だけ挨拶を入力してみただけのユーザーが同列に扱われている側面がある。

また、国によっても普及率には大きな開きがある。スタンフォードのデータでは米国の普及率を28%としているが、セントルイス連邦準備銀行の調査では54%と、倍近い開きが出ている。これは調査の質問順序や定義の微妙な違いによるものだ。SEO担当者は、数字の大きさに圧倒されるのではなく、ユーザーが「どれほど深く、どのような文脈で」AIを使っているのかを注視すべきである。

能力の「ギザギザのフロンティア」と検索の不安定さ

AIの能力向上は目覚ましいが、その進化は均一ではない。レポートでは「ギザギザのフロンティア(Jagged Frontier)」という概念を用いて、AIの得意不得意が極端に分かれている現状を説明している。

高度な知性と単純なミスが同居する現状

最新のAIモデルは、博士レベルの科学問題や数学の難問で人間を凌駕するスコアを叩き出す。しかしその一方で、アナログ時計の針を正しく読み取るという単純なタスクにおいて、正解率が10%を切るようなケースも報告されている。複雑な推論は得意だが、直感的な視覚理解や多段階の計画立案には依然として課題が残っているのだ。

この「能力のムラ」は、検索体験にも直結している。特定の専門的な質問には驚くほど正確な回答を返す一方で、日常的な事実関係の確認で突拍子もない間違い(ハルシネーション)を犯す。AI Index運営委員会のレイ・ペロー氏は、ベンチマークテストの結果が必ずしも実世界の業務での信頼性を保証するものではないと警鐘を鳴らしている。

AI検索結果の不確実性をどう捉えるか

SEOの現場では、Googleの「AI Overviews(AIによる概要)」や「AI Mode」の挙動がクエリによって大きく変動することが確認されている。Ahrefsの調査によれば、同じクエリであってもAI OverviewsとAI Modeが参照するURLの重複率はわずか13%に過ぎない。システムごとに異なる情報源を選択しており、その基準は依然として不透明だ。

Googleのロビー・スタイン氏は、ユーザーが反応を示さない場合、AIによる回答を意図的に抑制していることを認めている。つまり、AI検索の表示は固定されたものではなく、ユーザーのエンゲージメントに応じて動的に変化する不安定なものだ。私たちは、特定のキーワードで「AIに選ばれる」ことの難しさと、その持続性の低さを認識しなければならない。

※既存の情報を要約しただけで、具体的な戦略や独自性がない。

※実体験と具体的な数字に基づき、AIには真似できない価値を提供している。

このデモは、AIによる一般的な要約と、人間が提供すべき独自情報の違いを視覚化したものだ。

低下する透明性とブラックボックス化するSEO

SEO業界にとって最も懸念すべきデータの一つが、AIモデルの「透明性の低下」だ。レポートによれば、主要なAIモデルの透明性指数は、1年間で58から40へと急落した。モデルが高度になればなるほど、その中身が隠される傾向にある。

公開されないトレーニングデータ

Google、Anthropic、OpenAIといった主要プレイヤーは、最新モデルのトレーニングデータセットのサイズや、トレーニングに要した期間の開示を停止している。2025年にリリースされた著名なAIモデル95個のうち、トレーニングコードを公開したのはわずか15個にとどまる。

これは、検索エンジンのアルゴリズムがかつてないほど「ブラックボックス化」していることを意味する。どのようなコンテンツが評価され、なぜそのURLが引用されたのかという根拠を、プラットフォーム側が説明しなくなっているのだ。最適化のヒントが減り、推測に頼らざるを得ない領域が増えている。

「説明できない」アルゴリズムへの対策

透明性が失われる中で、SEO担当者が取るべき道は「アルゴリズムのハック」から「ユーザー価値の構築」へのシフトだ。レポート内では、AIに対する一般市民の信頼が低下していることも示されている。特に米国の公的機関によるAI規制能力への信頼度は31%と低い。

プラットフォームが詳細を明かさない以上、私たちは「AIが何を好むか」ではなく、「ユーザーが何を信頼するか」に立ち返る必要がある。AIによる回答が不透明で説明責任を果たせないからこそ、発信者の顔が見え、根拠が明示されたコンテンツの価値が相対的に高まっていく。透明性の欠如を、自サイトの透明性向上で補う戦略が求められる。

労働市場の変化と「独自の価値」の再定義

AIの普及は、コンテンツ制作の現場にも直接的な影響を及ぼしている。レポートが指摘する労働市場の変化は、Web制作やSEOに携わるチームの構成にも示唆を与えている。

若手エンジニアの雇用減少が示唆するもの

22歳から25歳のソフトウェアデベロッパーの雇用が、2024年以降で約20%減少したというデータがある。一方で、経験豊富なシニア層の雇用数は維持、あるいは増加傾向にある。これは、AIが「ジュニアレベルの定型業務」を代替し始めている可能性を示唆している。

SEOやライティングの分野でも同様のことがいえる。既存の情報を整理し、無難な構成で記事を書くといったエントリーレベルの仕事は、AIによって急速に置き換えられている。20%の雇用減少という数字は、単なる不況の影響だけでなく、業務プロセスの構造的な変化を反映していると見るべきだ。

AIに代替されない「ゴールデン・ナレッジ」

こうした状況下で提唱されているのが、シェリー・ウォルシュ氏らが言及する「ゴールデン・ナレッジ(黄金の知識)」という概念だ。これは、AIのトレーニングデータには含まれていない、独自の調査データや実体験、深い洞察に基づくコンテンツを指す。

スタンフォードのレポートが示す「AIの普及」と「能力のムラ」は、この戦略の正しさを裏付けている。AIは広く普及したが、その回答は依然として不安定で、深みに欠ける。AIがどれほど速く情報を要約しても、その元となる「新しい事実」を作り出すことはできない。一次情報の発信者としての地位を確立することが、AI時代を生き抜くための構造的なアドバンテージとなる。

2026年以降のSEO戦略(独自の分析)

スタンフォードのレポートから読み解ける未来は、AIと共存しつつ、その「隙間」を埋める戦略の重要性だ。AI Overviewsが月間15億人のユーザーにリーチし、AI Modeが日常化する中で、従来の「検索順位」という指標だけでは不十分になっている。

まず、モニタリングの単位を細分化する必要がある。AIの能力が「ギザギザ」である以上、カテゴリー単位の分析では実態を見誤る。特定のクエリでは正確な回答が出るが、少し表現を変えるだけでハルシネーションが起きる。この不安定さを逆手に取り、AIが正しく答えられない「複雑で多面的な問い」に対して、人間が最高の回答を用意しておくべきだ。

次に、検索コンソールなどのツールに頼りすぎない姿勢も重要だ。現在のツールでは、AI Overviews経由のトラフィックと通常の検索トラフィックを明確に分離して把握することが難しい。不透明なプラットフォームに依存するリスクを分散するためにも、SNSやメールマガジンといった、ユーザーと直接つながる「脱検索エンジン」のチャネル強化を並行して進めるべきだろう。

最後に、AIの普及速度を脅威ではなく「機会」として捉え直したい。53%の人がAIを使うということは、それだけ多くの人が「迅速な回答」を求めている証拠だ。しかし、迅速さと正確さは必ずしも両立しない。人々がAIの回答に物足りなさを感じたとき、真っ先に参照される「信頼の拠点」になれるかどうかが、2026年以降の勝負を分けることになる。

この記事のポイント

- 生成AIはChatGPT登場から3年で53%の普及率に達し、PCやネットを凌駕する速度で浸透している。

- AIの能力は「ギザギザのフロンティア」と呼ばれ、高度な推論と初歩的なミスの同居が検索結果の不安定さを招いている。

- AIモデルの透明性は低下しており、トレーニングデータやアルゴリズムのブラックボックス化が加速している。

- 労働市場では若手の定型業務がAIに代替され始めており、SEOでも「独自の一次情報」の価値が相対的に高まっている。

- 今後のSEOは、AIが苦手とする領域を特定し、ユーザーとの直接的な信頼関係を構築する戦略への転換が不可欠だ。

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験