サイト内検索の「パラドックス」を解消する——Googleに負けないUX設計術とIAの重要性

現代のWebサイトにおいて、成功の鍵はコンテンツの量ではない。ユーザーが目的の情報を「いかに早く見つけられるか」という「ファインダビリティ(見つけやすさ)」にある。しかし、皮肉なことに、データやツールが進化している今、多くのサイト内検索がユーザーの期待を裏切り続けている。

ユーザーがサイト内で目的のページを探せないとき、彼らはサイト独自のナビゲーションを学習しようとはしない。代わりに検索ボックスへ向かうが、そこでも失敗すれば、彼らはサイトを離脱してGoogleへ戻ってしまう。そして「site:サイトURL [検索語句]」と入力するか、最悪の場合は競合他社のサイトへ流れていく。

これを「サイト内検索のパラドックス」と呼ぶ。数兆ドル規模のグローバル検索エンジンが、わずか数百、数千ページのローカルサイト内を探すよりも使い勝手が良いという逆転現象だ。この記事では、なぜ「巨大な検索エンジン」が勝ち、私たちのサイト内検索が負けるのか、その構造的な理由と改善策を解説する。

構文税(Syntax Tax)がユーザーを遠ざける理由

サイト内検索が失敗する最大の原因は、元記事の著者が「構文税(Syntax Tax)」と呼ぶ概念にある。これは、ユーザーがデータベースに登録されている正確な文字列を推測しなければならないという、認知的な負荷のことだ。

文字列(String)ではなく概念(Thing)で捉える

調査によれば、Webサイトにアクセスしたユーザーの約50%が、真っ先に検索バーを利用するという。例えば、家具サイトでユーザーが「ソファ(Sofa)」と検索した際、サイト側が「カウチ(Couch)」というカテゴリー名しか持っていなかったらどうなるか。検索結果が0件であれば、ユーザーは「類義語を試そう」とは考えず、「このサイトには欲しいものがない」と判断して立ち去る。

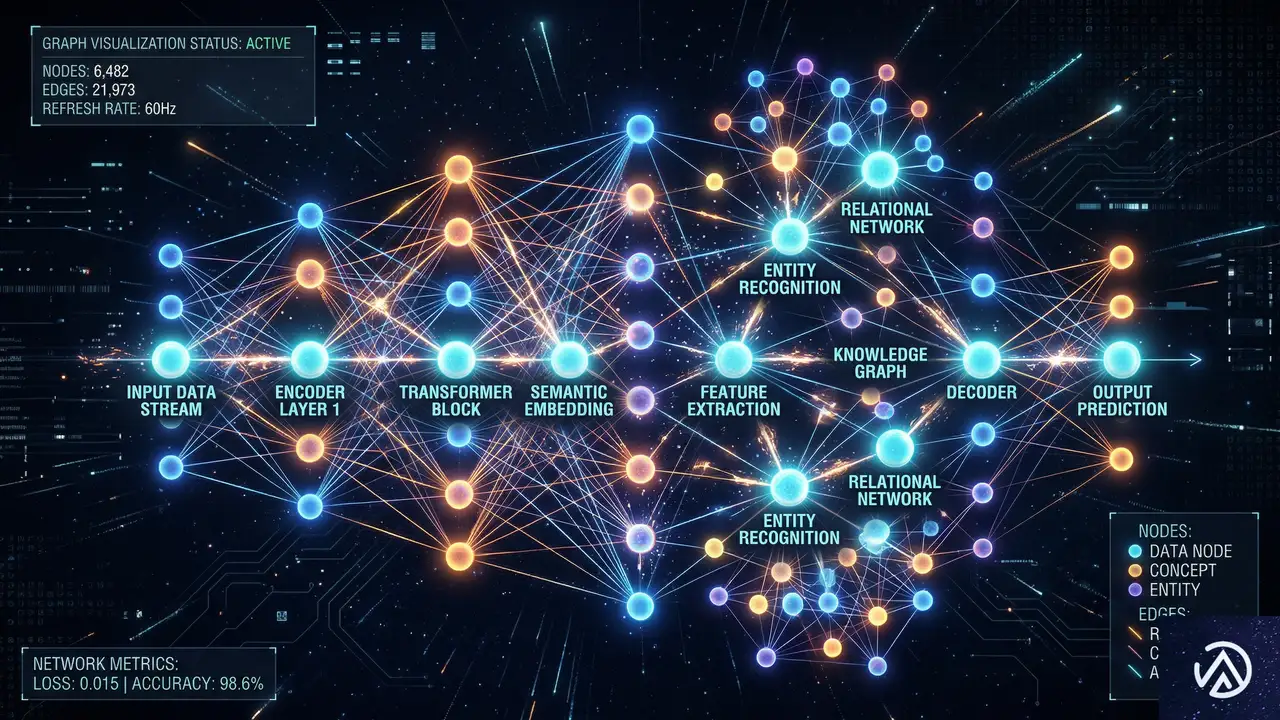

これは情報設計(IA:Information Architecture)の敗北だ。IAとは、情報を整理・分類し、ユーザーが迷わず目的に辿り着けるようにする設計図のことである。従来のシステムは「文字列(文字の並び)」の一致だけを見ていたが、ユーザーが求めているのは「概念(その言葉が指し示すもの)」との一致だ。ユーザーに特定の語彙(ブランド用語など)を強いることは、ユーザーに「脳の税金」を払わせているのと同じだと言える。

41%のECサイトが基本的な検索に対応できていない

Baymard Instituteのデータによれば、ECサイトの41%が記号や略語を含む基本的な検索クエリに対応できていない。単数形と複数形の違い(例:「靴」と「靴下」ではなく、「Shoe」と「Shoes」)を区別できないシステムは、ユーザーに人間らしい曖昧さを許容せず、機械に合わせた入力を要求している。この「不寛容さ」が、ユーザーの離脱を招く直接的な原因となっている。

なぜGoogleは「文脈」を理解できるのか

Googleの検索が圧倒的に使いやすいのは、単にサーバーが強力だからではない。検索を技術的なユーティリティとしてではなく、高度なIAの課題として捉えているからだ。

ステミングとレマタイゼーション

Googleは「ステミング(語幹抽出)」や「レマタイゼーション(補題化)」といった技術を駆使している。これらは、単語の語尾が変化しても、その根本的な意味(辞書の見出し語)を特定する技術だ。例えば「running」と「ran」が、どちらも「run(走る)」という意図に基づいていることを認識する。

多くのサイト内検索は、これらの文脈に対して「盲目」だ。「Running Shoe」と「Running Shoes」を全く別の実体として扱う。もしあなたのサイトの検索機能が、単純なスペルミスや複数形を処理できないのであれば、ユーザーに対して「人間であることへの罰金」を課しているも同然だと著者は指摘している。

「おそらく」を許容するインターフェースの設計

従来のIAは、ページがあるカテゴリーに「属しているか、いないか」という二進法で考えがちだった。しかし、現代の検索に求められるのは「確信度(Confidence Level)」に基づいた確率論的なアプローチだ。100%の正解がない場合でも、関連性が高いと思われる選択肢を提示する柔軟性が求められる。

「0件ヒット」というデッドエンドをなくすUXデザイン

検索を利用するユーザーは、利用しないユーザーに比べてコンバージョン率が2〜3倍高いというデータがある。しかし、検索結果が貧弱であれば、80%のユーザーがサイトを去る。デザイナーが設計すべきは、「結果あり」と「結果なし」の2つの状態だけではない。その中間にある「もしかして(Did you mean?)」の状態だ。

メタデータを活用した「曖昧検索」の実装

冷淡に「0件の結果が見つかりました」と表示するのではなく、保有しているメタデータ(情報の属性データ)を駆使して、「『電子機器』にはありませんでしたが、『アクセサリー』に3件の候補があります」といった提案を行うべきだ。これにより、ユーザーの探索フローを途切れさせずに済む。

以下に、理想的な検索UIの概念を視覚化したデモを示す。検索結果が完全一致しない場合でも、関連するカテゴリーや人気商品を提案することで、ユーザーを次の行動へ導く設計だ。

もしかしてこちらをお探しですか?

人気のカテゴリーから探す:

このデモは、検索キーワードがデータベースと一致しなかった際に、代替案を提示するUIの概念を視覚化したイメージだ。※実際の動作にはバックエンドの検索エンジンとの連携が必要となる。

サイト内検索を改善する4ステップの監査フレームワーク

Googleにユーザーを奪われないためには、検索機能を「一度設定して終わり」のツールではなく、常に改善し続ける「生きている製品」として扱う必要がある。元記事の著者が提唱する、検索体験を最適化するための4つのフェーズを紹介する。

フェーズ1:ゼロ件ヒットの監査

過去90日間の検索ログを抽出し、結果が0件だったクエリを分析する。これらは以下の3つのバケツに分類できる。

- 真の欠落: ユーザーが求めているが、サイトに存在しないコンテンツ。コンテンツ戦略の見直しが必要だ。

- 類義語の欠落: コンテンツはあるが、ユーザーの言葉と一致していない(例:「ソファ」と「カウチ」)。

- 形式の欠落: ユーザーは「動画」や「PDF」を探しているが、テキストしかインデックスされていない。

フェーズ2:検索意図(インテント)のマッピング

上位50個のクエリを分析し、それらが「ナビゲーショナル(特定のページを探している)」「インフォメーショナル(方法を知りたい)」「トランザクショナル(特定の製品を買いたい)」のどれに該当するかを分類する。ナビゲーショナルな検索(例:「ログイン」)であれば、検索結果一覧を飛ばして直接そのページへリンクさせるなどの工夫が有効だ。

フェーズ3:曖昧一致(ファジーマッチ)のテスト

意図的にスペルミスや単数・複数形、表記揺れ(例:「カラー」と「色」)で検索してみる。これで結果が出ない場合、検索エンジンに「ステミング」のサポートが欠けている。これはエンジニアリングチームに改善を求めるべき技術的要件となる。

フェーズ4:スコープとフィルタリングのUX

結果ページに表示されるフィルターが、検索内容に即しているかを確認する。「靴」と検索したなら「サイズ」や「色」のフィルターが必要であり、サイト全体の汎用的なフィルターを表示し続けるのは不適切だ。

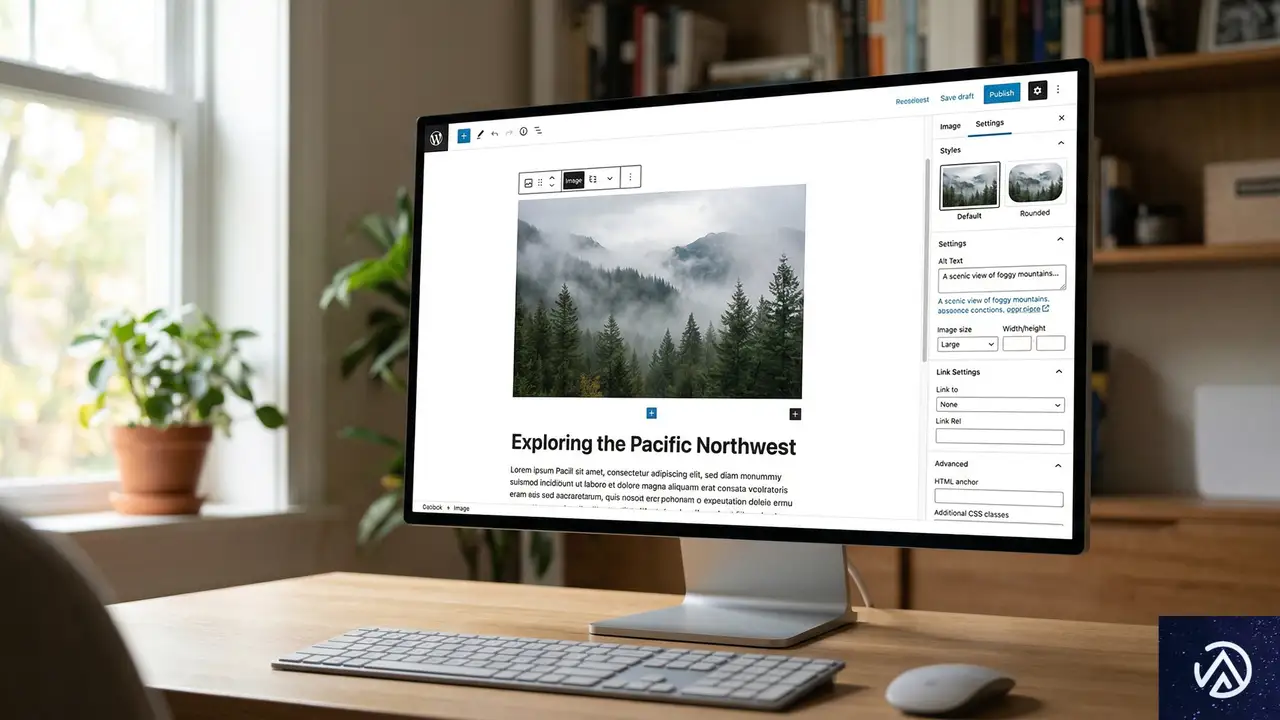

WordPressでの検索体験を向上させる具体策

WordPressのデフォルト検索は、残念ながら非常にシンプルだ。投稿タイトルや本文にキーワードが含まれているかを調べるだけで、これまで述べてきたような「文脈の理解」や「類義語の対応」はほとんど行われない。しかし、いくつかの戦略を組み合わせることで、Googleに頼らない強力な検索機能を構築できる。

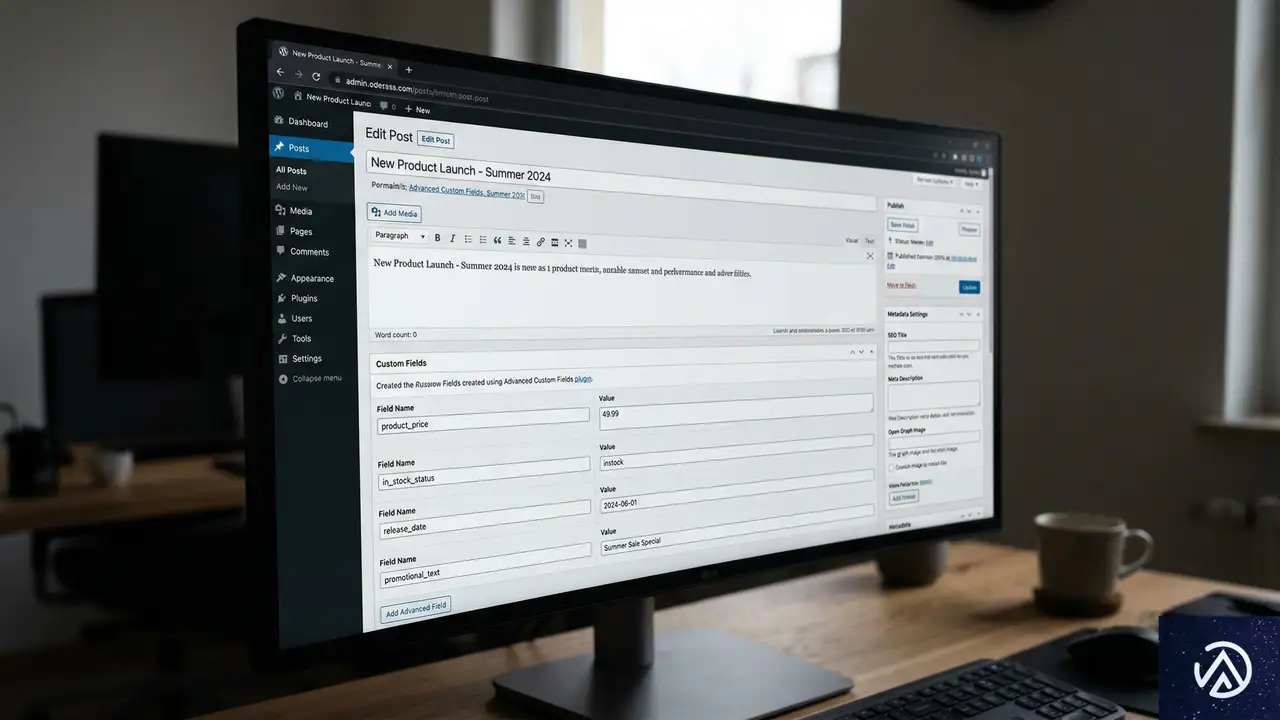

構造化されたメタデータの整備

検索エンジンの性能は、与えられた「地図」の精度に依存する。ある企業では、5,000件の技術文書のタイトルがすべて社内の管理番号(例:DOC-9928-X)だったため、検索が機能していなかった。これを人間が理解できる「インストールガイド」などの名称にマッピングし直し、メタデータとして付与したところ、検索ページからの離脱率が40%減少したという。WordPressであれば、カスタムフィールドを活用して、ユーザーが検索しそうな別名やキーワードをあらかじめ登録しておくことが重要だ。

「司書」ではなく「コンシェルジュ」になる

司書は本が棚のどこにあるかを正確に教える。しかし、コンシェルジュはユーザーが何を達成したいかを聞き、推奨事項を提示する。検索バーのオートコンプリート(自動補完)機能を使って、単に単語を補完するだけでなく、「注文を追跡する」といった「意図(アクション)」を提案するように設計すべきだ。

また、大学のサイトなどでよく見かける「Googleカスタム検索」の導入は、安易な解決策に見えるが、ビジネスにおいてはリスクも伴う。ユーザーを外部のアルゴリズムに委ねることになり、競合の広告が表示されたり、サイト独自の製品プロモーションができなくなったりするからだ。自社でコントロール可能な検索体験を構築することこそが、長期的な信頼につながる。

この記事のポイント

- 構文税を廃止する: ユーザーに正確なキーワードを推測させる負荷(構文税)を減らし、類義語や曖昧な表現を許容するシステムを構築する。

- IAは検索の燃料である: 検索エンジンの性能を上げる前に、メタデータの整理や人間中心のタクソノミー(分類学)を整備する。

- デッドエンドを作らない: 検索結果が0件の場合でも、関連カテゴリーや人気コンテンツを提案し、ユーザーの探索を止めない。

- 定期的なログ監査: 検索ログから「ユーザーが求めているが届いていない情報」を特定し、サイトのナビゲーションやコンテンツを改善する。

- 速度は信頼: 検索結果の表示が1秒を超えるとユーザーはGoogleへ逃げる。パフォーマンスの最適化はUXの基本である。

出典

- Smashing Magazine “The Site-Search Paradox: Why The Big Box Always Wins”(2026年3月26日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

2026年、AIを実用的に活用するWordPress SEOプラグイン7選

2026年現在、多くのWordPress SEOプラグインがAI機能を謳っている。しかし実際には、メタディスクリプションを生成するボタンを1つ追加しただけのものも少なくない。元記事の著者は、本当に実用的なAI機能を持つプラグインだけを選別した。

この記事では、AIが実際に意味のある作業を行っている7つのプラグインを紹介する。各プラグインのAI機能の内容、価格、適したユーザータイプを具体的に解説する。プラグイン選びの判断材料として活用できる。

AI機能の実用性を基準に選別

SEOプラグイン市場では、ほぼすべての製品がAI機能を宣伝文句にしている。元記事の著者によれば、OpenAIのGPT-2の時代から技術的に可能だった単純なメタディスクリプション生成を「AI搭載」と称するケースが多いという。

本当の違いは、競合コンテンツの分析、内部リンク構造のマッピング、AIクローラーへの対応といった高度な機能にある。著者は、API呼び出しでタイトルタグを生成するだけのプラグインと、実際の分析・最適化を行うプラグインを明確に区別している。

このリストは、AIが実際に作業を行っているプラグインだけを対象としている。紹介順はランキングではなく、機能の特徴に基づく分類だ。なお、複数のSEOプラグインを同時に有効化することは推奨されない。競合や重複スキーマの発生、ダッシュボードの混乱を招く。

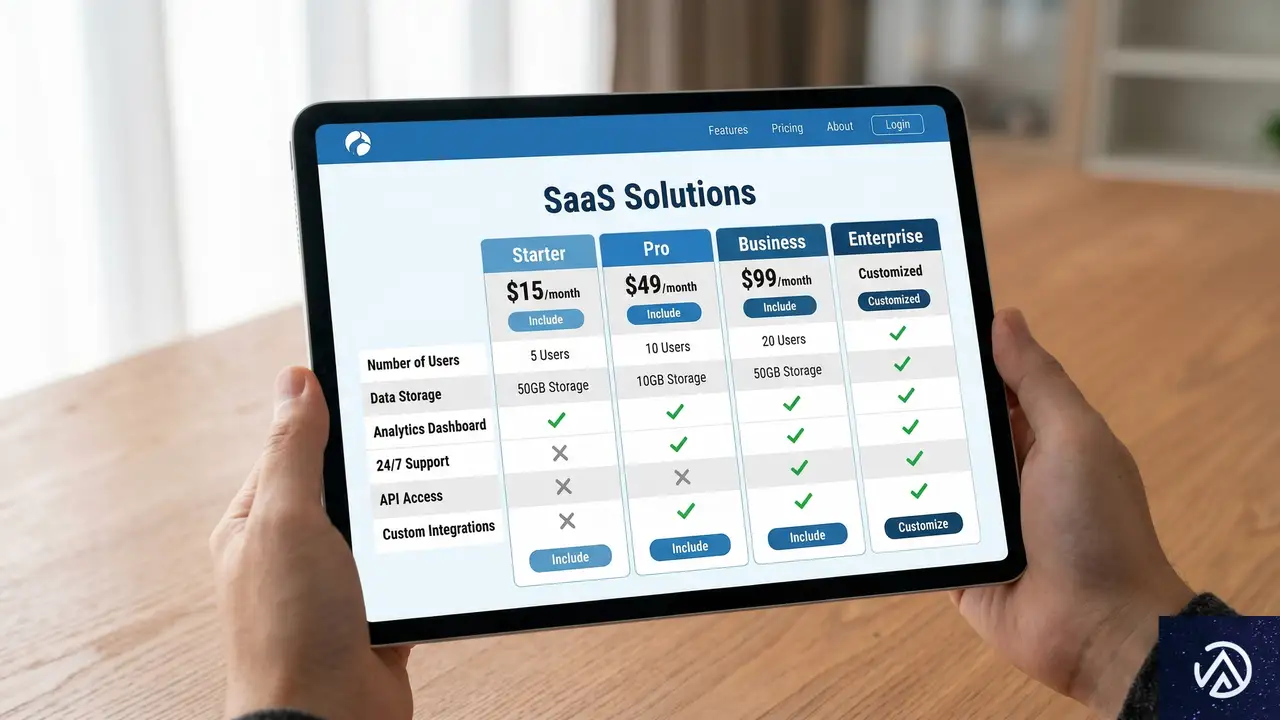

フルスイートSEOプラグイン5選

フルスイートSEOプラグインは、サイトのSEOを総合的に管理するためのツールだ。メタデータの設定、スキーママークアップ、サイトマップ生成、検索コンソール連携などの基本機能に加え、AIを活用した高度な機能を提供する。

Yoast SEO Premium

Yoast SEOは1000万以上のWordPressサイトで利用されている。この普及率は大きなアドバンテージだ。ほぼすべてのチュートリアル、テーマ、サードパーティ統合がYoastを前提に開発されている。

無料版では基本機能のみだが、有料のPremium版ではAI機能が利用できる。AI Generateはエディター内でタイトルとメタディスクリプションを生成する。AI Optimizeは現在ベータ版で、手動チェックリストなしに具体的なページ改善点を指摘する。

可読性分析は、すべての執筆者がSEO専門家ではないチームにおいて、品質の最低ラインを維持するのに役立つ。Premium版に含まれるGoogle Docsアドオンは、WordPress外で下書きを作成するチームにとって実用的な差別化要素だ。

年間118.80ドル(1サイトあたり)と、このリストの中で最も高価な選択肢となる。AI機能はRank MathのContent AIと比べて浅いと評価されている。それでもYoastは、執筆プロセスにSEOガイダンスを織り込みたい出版社や、1000万インストールという実績の安定性を重視するユーザーに支持されている。

All in One SEO (AIOSEO)

AIOSEOはYoast対Rank Mathの議論の中で見過ごされがちだが、それは誤りだ。このプラグインの最大の特徴は、E-E-A-T(経験・専門性・権威性・信頼性)オーサーブロフィール機能を備えている点にある。

E-E-A-TはGoogleがコンテンツの信頼性を評価する際の重要な指標だ。複数の寄稿者がいるメディアや、健康、金融、法律など信頼性が厳しく審査される分野で運営する場合、この機能はメタディスクリプション最適化とは次元の異なる重要性を持つ。

SEO Revisionsも他にはない機能だ。ページごとのSEO変更をすべて追跡し、どの変更が効果的だったかを確認できる。SEOのバージョン管理と言える。AI機能としては、コンテンツ生成、AIによるタイトル・メタディスクリプション・FAQ・キーポイント生成があり、プランに応じて段階的なクレジットが提供される。

SEOPress

SEOPressはフランスの独立企業によって開発されている。ダッシュボードに広告やアップセルバナーがなく、1サイトあたり年間49ドルから利用できる。無制限サイトプランでも年間149ドルだ。Yoastはサイトごとに課金し、Rank Mathのエージェンシープランは年間約800ドルかかる。エージェンシーにとっての価値提案は明らかだ。

AI機能の動作が他社と異なる。SEOPressは独自のクレジットシステムではなく、ユーザー自身のAPIキーと連携する。OpenAI、DeepSeek、Claude、Gemini、Mistralなど複数のAIプロバイダーをサポートしている。ユーザーはプロバイダーに直接支払い、サブスクリプション層に縛られた使用制限がない。

AIはメタディスクリプションとタイトルタグを生成し、ページごとの最適化スコアを提供する。AIの範囲はRank MathやAIOSEOより限定的だが、サイトマップ、スキーマ、パンくずリスト、リダイレクト、WooCommerceサポート、検索コンソール連携など中核機能は堅実にカバーしている。

Rank Math

Rank Mathの無料版は、多くの競合製品の有料版よりも充実している。投稿ごとの無制限キーワード最適化、リダイレクトマネージャー、404モニタリング、GA4連携、ダッシュボード内のGoogle検索コンソールデータ、18種類の事前定義スキーマタイプがすべて無料で利用できる。

Pro版では、Content AIがターゲットキーワードに対する競合ページを分析する。文字数、見出し、エンティティ、キーワード配置に関する具体的な推奨事項を返す。実際にランキングしているページを読み解き、自分のページに不足している要素を指摘する機能だ。

2026年に追加されたAI検索トラッカーは、AI検索エンジンがコンテンツをどのように参照しているかを表示する。他のプラグインにはまだない機能だ。ただし、Content AIはSEOプラグインとは別のサブスクリプションが必要な点に注意が必要だ。

Rank Mathには評判上の問題がある。具体的な苦情として、Content AIの無料トライアルが明確なオプトインなしにチェックアウトにバンドルされ、ユーザーが意識的に選択していない年間サブスクリプションに自動登録されるケースが報告されている。データ収集やプラグインの起源に関する長年の懸念もある。

Prime SEO

他の4つのプラグインは主にGoogleの従来型クローラー向けの最適化を行っている。Prime SEOも同様の機能を持つが、AIシステムがコンテンツを発見・理解・引用する方法に特化して設計されている点が異なる。

特筆すべき機能はAIクローラー管理だ。GPTBot、ClaudeBot、PerplexityBot、Google-Extendedを含む16種類のボットを個別に許可、ブロック、トレーニングアクセス制限できる。他のプラグインにはない機能だ。

LLMs.txtジェネレーターは、AIクローラーに対してサイトの内容を伝える構造化ファイルを作成する。検索エンジンスパイダー向けのサイトマップに相当するAIシステム向けのマップと言える。AI Visibility Scoreは、コンテンツがAIに対応しているかを15項目で監査する。

従来のSEO基本機能も充実している。スキーマ生成、メタ最適化、フォーカスキーワード、Open Graph、サイトマップ、リダイレクト、404モニターをカバーする。Yoast、Rank Math、AIOSEO、SEOPressからのワンクリック移行機能を備え、現在のプラグインを置き換えるように設計されている。

SEOプラグインと併用すべき追加ツール

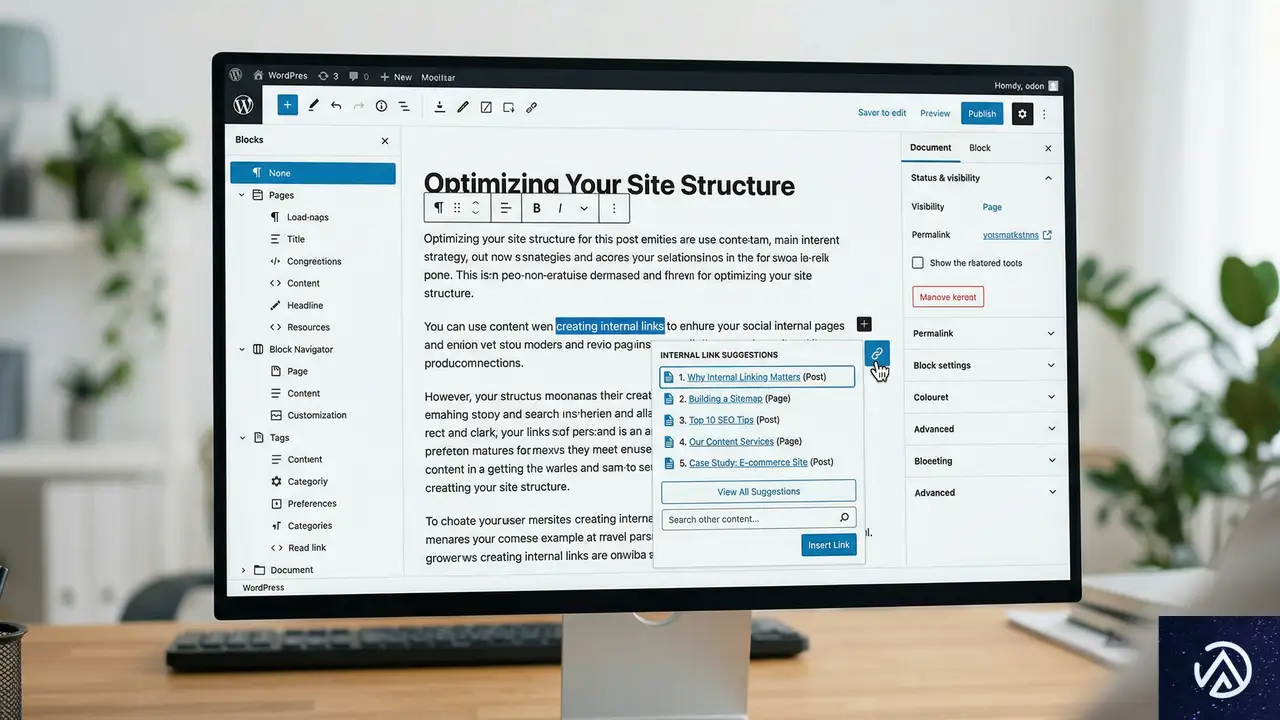

フルスイートプラグインはすべて何らかの形で内部リンク提案機能を含んでいるが、コンテンツの多いサイトにとって十分な性能を持つものはない。この分野では、専用ツールがオールインワン製品を一貫して上回る。

Link Whisper

内部リンクは、誰もが重要だと知りながらほとんど誰も一貫して実行しないSEOタスクの1つだ。50投稿のサイトでは管理可能だが、500投稿のサイトでは孤立コンテンツが至る所に発生し、手動で監査する現実的な方法はない。

Link WhisperのAIはコンテンツライブラリをスキャンし、トピックの関係性と意味的関連性を理解する。執筆中にWordPressエディター内で直接リンク機会を表示する。リンクは自動挿入ではなく、各提案を承認する方式だ。

トピカルクラスタリング機能はコンテンツを関連するサイロにマッピングする。孤立ページレポートは、内部リンクがゼロの投稿を表示する。コンテンツの多いサイトで最も一般的な構造的問題の1つだ。

50投稿以上のサイトでは、コストに対して不釣り合いな時間を節約できる。ただし、コンテンツが明確に分化しているサイトで最も効果を発揮する。狭いニッチブログでは提案が繰り返しになる可能性がある。

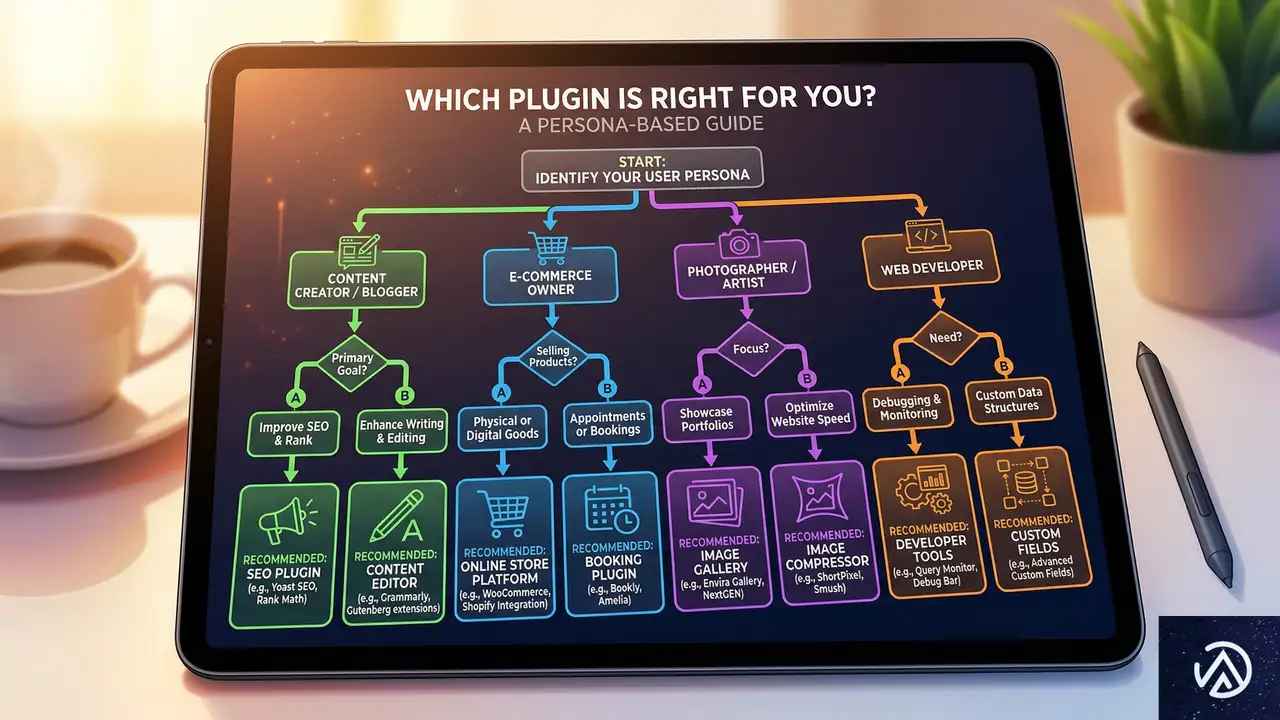

プラグイン選択の実践的ガイド

7つのプラグインリストは複雑に見えるが、選択は実際よりも単純だ。まず自分に最も合ったユースケースから始める。

個人ブロガーや小規模サイト運営者は、Rank Math無料版から始める。コンテンツライブラリが大きくなり手動リンクが非現実的になったらLink Whisperを追加する。AI検索可視性がニッチにとって重要な場合は、Prime SEOをフルスイートプラグインとして検討する。

複数の寄稿者がいるメディアは、E-E-A-TオーサーブロフィールとSEO RevisionsのためにAIOSEOを選択する。大規模な内部リンクにはLink Whisperを追加する。

クライアントサイトを管理するエージェンシーは、無制限サイトで年間149ドルのSEOPress Proを検討する。コンテンツの多いインストールにはLink Whisperを追加する。

AI検索可視性に焦点を当てたコンテンツ運営は、Prime SEOを基盤とする。クローラー管理とLLMs.txt機能は、この特定の目標において他社をリードする。

これらのツールのAI機能は、コンテンツ自体が最適化する価値がある場合にのみ有用だ。よく書かれた記事は、平凡なメタディスクリプションでも、薄いAI最適化記事を常に上回る。これらのツールは良いSEOを加速するが、製造はしない。

この記事のポイント

- AI機能を謳うSEOプラグインは多いが、実用的な機能を持つものは限られる

- Yoast SEO Premiumは最大のインストール基盤を持ち、執筆プロセス統合に強い

- AIOSEOはE-E-A-TオーサーブロフィールとSEO変更履歴管理が特徴

- SEOPressはエージェンシー向けのコスト効率に優れる

- Rank Mathは最も充実した無料版を提供するが、サブスクリプション構造に注意が必要

- Prime SEOはAI検索エンジン向け最適化に特化している

- 大規模サイトの内部リンクにはLink Whisperの併用が効果的

出典

- WP Mayor「7 WordPress SEO Plugins That Actually Use AI in 2026」(2026年3月24日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google AI Overviewsで流入42%減の衝撃。SEO業界の新たな生存戦略と「構造的競争力」

Googleが2024年5月にAI Overviews(AIO)を導入して以来、Webメディアのトラフィック構造は劇的な変化を遂げている。かつては予測可能だった検索流入が、AIによる回答の直接提示によって急速に失われつつある。パブリッシャーの中には、わずか1年半でオーガニックトラフィックの4割以上を失ったケースも報告されている。

Define Media Groupが米国の主要パブリッシャーを対象に行った調査によれば、AIO導入前の四半期平均クリック数は17億回と安定していた。しかし、2024年の導入直後に16%減少し、2025年5月の機能拡大を経て、同年第4四半期にはベースラインから42%もの減少を記録した。これは、特定のサイトだけでなく、出版業界全体に及ぶ構造的な危機を示唆している。

この変化は、20年間にわたってWebの経済を支えてきた「コンテンツを提供し、Googleがトラフィックを送る」という互恵関係の終焉を意味する。本記事では、Search Engine Journalに掲載されたペドロ・ディアス氏の寄稿を基に、SEO業界が直面している現状と、今後目指すべき「構造的競争力」という新しいフレームワークについて詳しく解説する。

AI Overviewsがもたらした「トラフィック42%減」の衝撃

検索エンジンの役割が「サイトへの案内役」から「回答の提供者」へと変わったことで、パブリッシャーの収益モデルが根底から揺らいでいる。Googleが検索結果の最上部でユーザーの疑問を完結させてしまうため、サイトへのクリックが発生しにくくなっているからだ。

パブリッシャーを襲うかつてない流入減のデータ

元記事の著者は、Define Media Groupが保有する大規模なポートフォリオのデータを引用している。それによると、AIO導入前の安定した流入数は、2025年末までに42%減少した。これは、ビジネスモデルの前提が崩れるほどのインパクトである。パブリッシャーは広告収入でコンテンツ制作費を賄っているが、流入が半減すれば、そのサイクルは維持できない。

崩壊する「コンテンツとトラフィック」の互恵関係

これまでGoogleとパブリッシャーの間には、暗黙の了解があった。Googleはコンテンツをクロールして検索インデックスを作り、その見返りにユーザーをサイトへ送る。この「トラフィックのバーター(物ブツ交換)」がWebのエンジンだった。しかし、AIOはこのループを断ち切る。Googleはコンテンツから情報を抽出し、自らのプラットフォーム上で回答を生成する。ユーザーは満足するが、パブリッシャーには何も残らない。

Googleの検索製品担当副社長であるロビー・スタイン氏は、当初のAIモデルには「リンクを貼る」という動作がデフォルトで備わっておらず、後からエンジニアリングによって追加する必要があったと述べている。つまり、AIシステムの本質は「情報の吸収」であり、外部への送客は後付けの機能に過ぎないという事実を浮き彫りにしている。

業界の第一反応:新しい「可視性」を測るツールの台頭

トラフィックが減少する中で、SEO業界は新たな測定指標を求めて動き出した。LLM(大規模言語モデル)の回答内に自社ブランドがどの程度出現するかを追跡するツールが次々と登場している。

LLM内での表示回数は本当に「勝利」の指標か

「プロンプトトラッキング」や「LLM可視性ダッシュボード」といった新しいカテゴリーのツールは、AIの回答に自社ブランドが何回登場したかを数値化する。しかし、ディアス氏はこの傾向を批判的に見ている。これらのツールが示す「ブランド出現率73%」といった数字は、特定のプロンプトに対する一時的な結果をカウントしただけであり、従来の「検索順位」のような再現性のある指標ではないからだ。

ダッシュボードが売るのは「安心」という名の幻影

AIモデルの出力プロセスは開発者ですら完全に説明できない「ブラックボックス」である。それにもかかわらず、SaaSツールが確信を持って数値を提示することに、著者は強い不信感を示している。これらのツールは、現状を把握できない不安に駆られたマーケターに対し、安心感を与えるための「気休め」として機能している側面があるとの指摘だ。数字が上下しても、それが実際の収益(コンバージョン)に結びついている保証はない。

本質的な解決策としての「構造的競争力」フレームワーク

インターフェースの数値に一喜一憂するのではなく、より根本的な「競争力」に焦点を当てるべきだという議論が注目されている。著名なSEO戦略家であるジョノ・アルダーソン氏が提唱するフレームワークがその代表例だ。

ジョノ・アルダーソン氏が提唱する6つの次元

アルダーソン氏は、SEOを「検索結果の表示をいじる作業」から「ブランドの競争力を高める作業」へと再定義すべきだと主張している。彼が提唱する構造的競争力には、以下の6つの次元が含まれる。

- 体験の完全性(Experience Integrity):サイトの使いやすさやUXの質

- 物理的利用可能性(Physical Availability):サービスや製品が実際に手に入るか

- 精神的利用可能性(Mental Availability):ユーザーが特定のカテゴリーで最初に思い浮かべるブランドか

- 独自性(Distinctiveness):他社と明確に区別できる特徴があるか

- 評判(Reputation):長年の活動を通じて得られた信頼

- 商業的証明(Commercial Proof):実際に売れている、選ばれているという実績

「インターフェース」ではなく「ブランドの力」を測る

AIシステムは、Web上の膨大なシグナルを集約してブランドを評価する。特定のページが最適化されているかどうかよりも、ブランドそのものが市場でどう評価されているかが重要になる。「可視性」はインプットではなく、これらの競争力を高めた結果として得られるアウトプット(出力)に過ぎないという考え方だ。これはSEOの役割を、技術的な調整からマーケティング戦略の核心へと押し上げるものである。

理想と現実のギャップ:時間軸の致命的な不一致

「構造的競争力」を高めるというアプローチは論理的に正しいが、実務上の大きな課題がある。それは、結果が出るまでにかかる時間だ。

ブランド構築には年単位、トラフィック減少は数ヶ月

精神的利用可能性(ブランド認知)を高めたり、評判を確立したりするには、年単位の継続的な投資が必要になる。一方で、AI Overviewsによるトラフィックの激減は、四半期単位という非常に短いスパンで進行している。流入が4割減り、資金繰りが悪化しているパブリッシャーに対し、「数年かけてブランド力を高めましょう」と助言するのは、家が燃えている最中に「将来のために防火性能の高い壁材を検討しましょう」と言うようなものだ。

SEO担当者に求められる役割の劇的な変化

今後、SEO担当者が生き残るためには、2つの道のどちらかを選ぶ必要がある。一つは、組織の政治を乗り越えてプロダクトやブランド戦略に深く関与する「戦略的リーダー」への転換だ。もう一つは、ブランドの競争力を検索エンジンやAIが正しく理解できるように整える「テクニカル・インフラの専門家」としての純化である。どちらにせよ、これまでの「記事を書いてリンクを集める」だけのSEOは通用しなくなっている。

生き残るコンテンツと吸収されるコンテンツの境界線

すべてのコンテンツが等しくダメージを受けているわけではない。Define Media Groupのデータによれば、コンテンツの性質によってAIの影響に明確な差が出ている。

速報ニュースは生き残り、エバーグリーンはAIの「餌」になる

最新のニュースや速報(Breaking News)に関しては、Googleのあらゆる面でトラフィックが103%増加している。AIは進行中の出来事を要約するのが苦手であり、ユーザーも最新の一次情報を求めるため、依然としてクリックが発生しやすい。一方、ハウツー記事や解説記事といった「エバーグリーン(不変的)」なコンテンツは40%減少した。これらはAIが最も得意とする分野であり、検索結果画面で回答が完結してしまうため、サイトへ訪問する必要がなくなるからだ。

検索結果の変化:AIO導入による表示の比較

AI Overviewsが導入される前と後で、検索結果画面がどのように変化したのか、その概念を視覚的に整理する。以前はリスト形式でサイトが並んでいたが、現在はAIによる回答が画面の大部分を占拠している。

※このデモは、AI Overviews導入による検索結果画面のレイアウト変化を視覚化したイメージである。AIの回答が「ゼロクリック検索」を誘発し、従来のオーガニック枠を押し下げている様子を示している。

独自の分析:SEOは「チャネル戦略」から「ビジネス戦略」へ

今回のトラフィック減少は、SEOという職種の定義を根本から変える分岐点になると筆者は考える。これまでは「Googleからいかに効率よくアクセスを引いてくるか」という、一つの集客チャネルの最適化技術としてSEOが捉えられてきた。しかし、その蛇口をGoogleが閉め始めた今、チャネルの最適化だけでは限界がある。

今後のSEO担当者が持つべき視点

これからのSEO担当者に必要なのは、技術的なタグの調整力ではなく、「そのビジネスがなぜ市場で選ばれるのか」というビジネスモデルへの深い理解だ。GoogleがAIを通じて「信頼できるブランド」を優先して紹介するようになるなら、SEOの仕事は「信頼されるための証拠(エビデンス)をWeb上に散りばめること」にシフトするだろう。これは広報(PR)やブランディングの領域に限りなく近い。

また、トラフィックの減少を前提とした収益構造の再構築も不可欠だ。検索流入に依存した広告モデルから、SNSやニュースレターを通じた「直接的な顧客関係」の構築、あるいはコンテンツそのものを有料化するサブスクリプションモデルへの転換が、多くのパブリッシャーにとって不可避な課題となるだろう。SEOはもはや独立した技術ではなく、経営戦略の一部として統合されるべき段階に来ている。

この記事のポイント

- トラフィックの大幅減少:Google AI Overviewsの拡大により、米国の主要パブリッシャーで最大42%の検索流入減が記録された。

- エバーグリーンコンテンツの危機:ハウツーや解説記事などの不変的な内容はAIに吸収されやすく、ニュースなどの速報記事は比較的影響が少ない。

- 構造的競争力への転換:単なる順位対策ではなく、ブランドの評判や独自性といった「競争力」そのものを高める戦略が重要視されている。

- 測定指標の混乱:LLM内の表示回数を追跡するツールが登場しているが、それらは必ずしも収益に直結する確実な指標ではない。

- SEOの役割の変化:技術的な最適化から、ブランド戦略やビジネスモデルの構築に関わる、より広範な役割へと進化が求められている。

出典

- Search Engine Journal「Half Your Traffic Left. The SEO Industry Sent Thoughts and Frameworks」(2026年3月25日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIに選ばれるコンテンツの条件とは?ChatGPTの引用元分析から見えたSEOの新常識

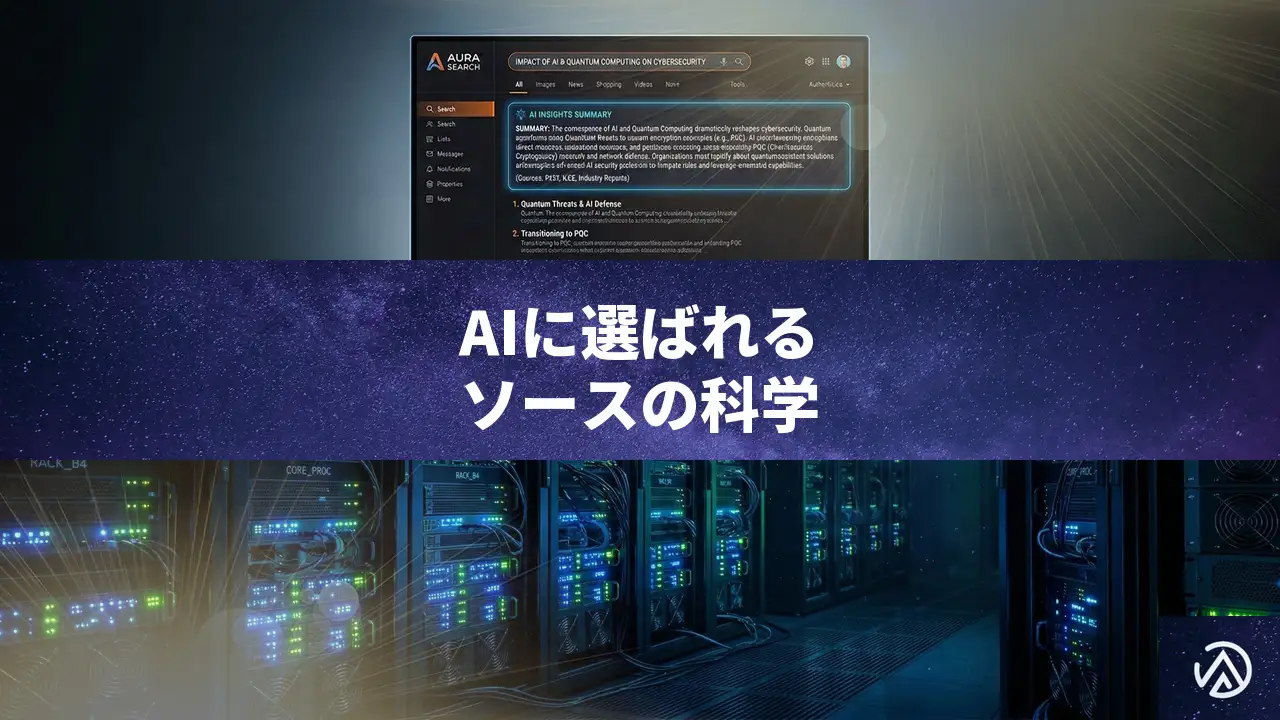

ChatGPTなどの生成AIが回答の根拠としてどのウェブサイトを引用するかは、もはや偶然の産物ではない。最新の調査によれば、特定のトピックにおいて引用されるドメインの約67%は、わずか30個程度の主要サイトに集中しているという実態が明らかになった。

このデータは、120万件に及ぶChatGPTの回答を分析した結果に基づくものだ。従来のGoogle検索におけるSEO(検索エンジン最適化)とは異なる、AI時代の情報収集アルゴリズムが透けて見える内容となっている。

検索の主役が従来のリスト形式からAIによる要約へと移り変わる中で、自社のコンテンツがAIに「信頼できるソース」として選ばれるための条件を理解することは、今後のWebマーケティングにおいて死活問題となるだろう。本記事では、AIがソースを選ぶ基準とその背後にある「科学」について詳しく解説していく。

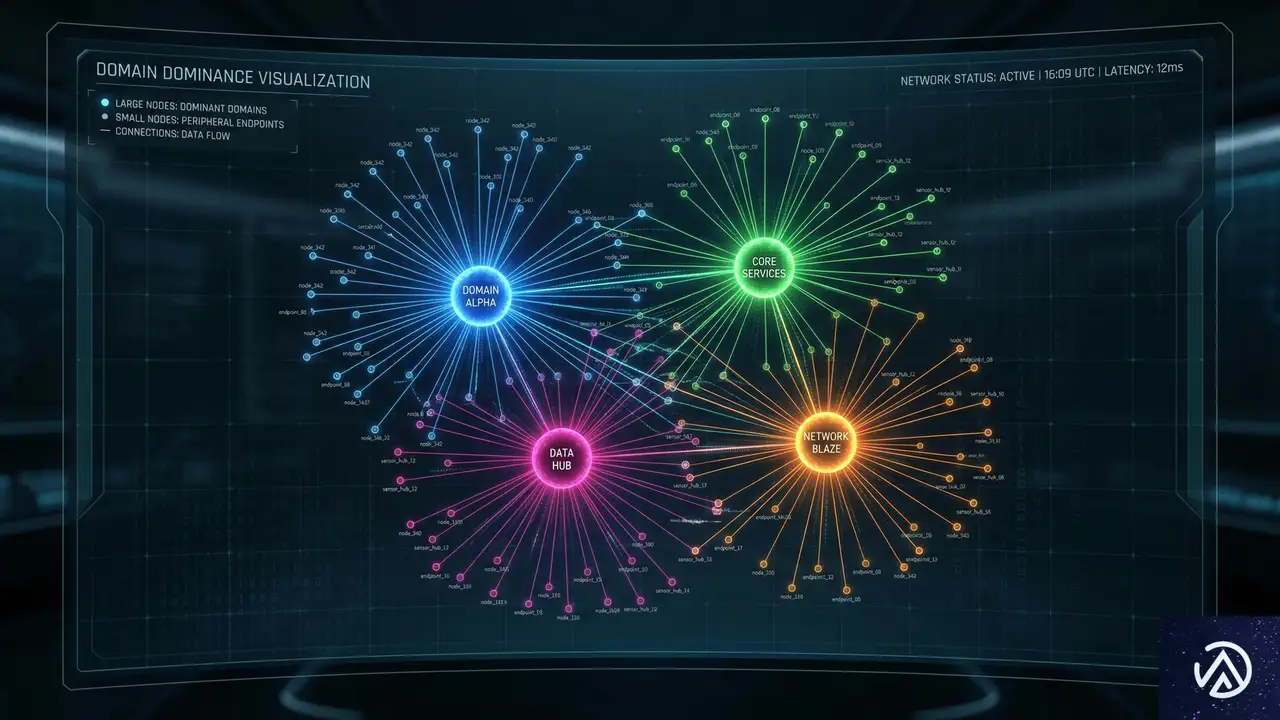

AIに選ばれるドメインの法則:上位30サイトがシェアの67%を独占

従来のGoogle検索は「勝者総取り」のゲームと言われてきた。検索結果の1位がクリックの大部分をさらっていくからだ。ChatGPTのようなAIの回答においても、この傾向はさらに極端な形で現れている。特定のトピックについて、わずか30のドメインが引用全体の3分の2を占めているという事実は、AIが参照する「信頼の枠」が非常に狭いことを示唆している。

業界ごとに異なる「独占率」の実態

記事によれば、この引用の集中度は業界(バーティカル)によって大きく異なる。例えば「教育」分野は非常に独占が進んでおり、上位10%のドメインが引用全体の約60%を占めている。これは、教育コンテンツにおいては特定の公的機関や大規模な専門サイトが圧倒的な信頼を得ているためだと考えられる。

一方で「ヘルスケア(医療)」分野は、引用が数百のドメインに分散している。医療情報は多岐にわたり、特定の症状や法規制、アプリの活用など、ニッチな領域ごとに異なる専門サイトが引用されるためだ。これは、新しく参入するサイトにとってもAIに引用されるチャンスが残されている「開かれた市場」であることを意味している。

「網羅性」がドメイン権威性を上回る瞬間

興味深いのは、単にドメイン全体の評価が高い(ドメイン権威性が強い)サイトが選ばれるわけではないという点だ。著者のケビン・インディグ氏は、特定の1ページが100種類以上の異なる質問(プロンプト)に対して引用されている事例を挙げている。これは、AIが「サイト全体」よりも「そのページがどれだけ多くの関連する問いに答えているか」を重視している証拠だ。

たとえ有名な大企業のサイトであっても、情報が断片的であればAIには選ばれにくい。逆に、1つのページで「とは何か」「選び方」「価格」「比較」といったトピックを網羅しているページは、AIにとって効率的な情報源となり、多くの引用を獲得することになる。

引用獲得の鍵は「文字数」にあり?1万文字の壁と業界別の最適解

SEOの世界では長らく「コンテンツの長さと順位の相関」が議論されてきたが、AIによる引用においても文字数は重要な指標となる。分析結果によると、ページのテキスト量が増えるほど引用される確率は高まり、特に5,000文字から10,000文字(英語圏のデータでは文字数ベース)のレンジで引用率が急増する傾向が見られた。

1万文字を超えると引用率が2倍に跳ね上がる理由

調査データでは、20,000文字(キャラクター数)を超えるページは、500文字未満のページに比べて約4倍の引用を獲得している。これは、AIが複雑な回答を生成する際に、詳細なデータや背景知識が含まれている「厚みのあるコンテンツ」を好んで参照するためだ。LLM(大規模言語モデル)は、文脈を理解するために十分な情報を必要とするため、情報密度の低い薄いコンテンツは無視される傾向にある。

金融やSaaSで見られる「例外」のページ構成

ただし、文字数が多ければ良いというわけではない。業界によっては「短く、正確な情報」が好まれるケースもある。例えば「金融」分野では、10,000文字を超えるような長大な記事よりも、5,000文字程度のコンパクトな記事の方が引用率が高いという逆転現象が起きている。

金融情報の読者は、具体的な利率や規制の要約、比較表などの「即座に使えるデータ」を求めている。AIもそれを理解しており、冗長な解説よりも、データが整理された信頼性の高い要約ページを優先して引用する傾向がある。自分のターゲットとする業界が「網羅的な解説」を求めているのか、それとも「正確なデータの提示」を求めているのかを見極める必要がある。

1枚のページで複数の問いに答える「エバーグリーン戦略」

AI検索における戦略として、著者は「引用の広さ(Breadth)」という概念を提唱している。これは、1つのURLがどれだけ多様な質問に対して引用されたかを示す指標だ。多くのサイトが特定の1つの質問にしか答えられない「使い捨ての回答源」になっている一方で、少数の「エバーグリーン(常緑)なページ」が圧倒的な引用数を稼いでいる。

引用URLの約6割は「一度きり」の使い捨て

分析によると、AIに引用されたURLの約67%は、わずか1種類のプロンプトに対してしか表示されていない。つまり、ほとんどのページは特定のニッチな問いに対する「一発屋」で終わっている。これでは、AI検索からの継続的なトラフィックは期待できない。

複数の意図をカバーする比較・ガイド記事の価値

上位5%に食い込む「エバーグリーンなページ」には共通の構造がある。それは、「2025年最新版:〇〇ツールの比較」といったカテゴリーレベルのガイド形式だ。こうしたページは、「〇〇とは何か」「おすすめはどれか」「価格はいくらか」といった、ユーザーが抱く一連の疑問(クエリクラス)をすべて1ページで解決できるように設計されている。

AIは、複数のソースを行ったり来たりするよりも、1つの信頼できるページから複数の情報を抽出することを好む。そのため、1キーワードに対して1ページを作る従来の「スモールワード狙い」のSEOよりも、トピック全体を構造的に網羅する「トピック・オーソリティ(トピックの権威性)」を意識したページ作りが、AI時代には高い投資対効果(ROI)を生むことになる。

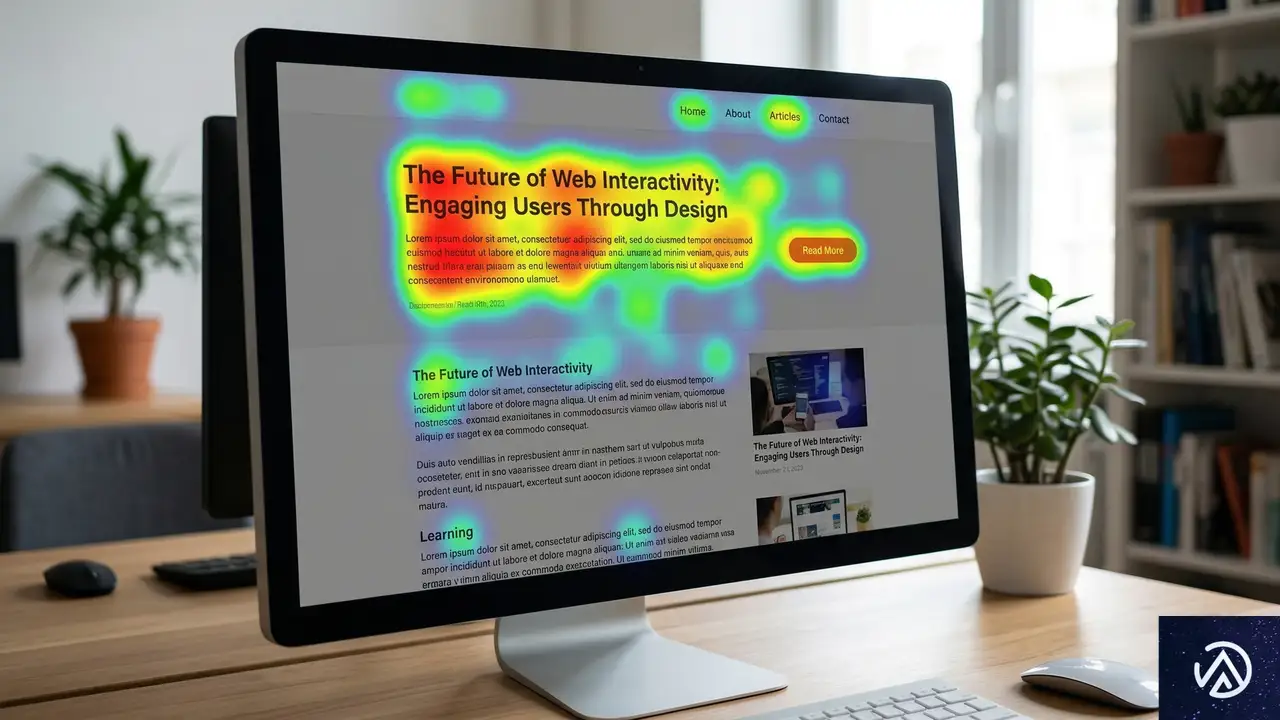

AIが最も注目するのは「ページ冒頭の30%」である

AIがページを「読む」際、すべての箇所を平等に扱っているわけではない。分析の結果、ChatGPTが引用する情報の約44%は、ページの最初の30%の範囲から抽出されていることが分かった。特に、冒頭10〜20%のエリアは「黄金地帯」と呼ばれ、最も高い引用密度を誇っている。

導入文直後の「10-20%」のエリアが黄金地帯

なぜページの最初の方が引用されやすいのか。それは、多くのWebサイトが冒頭に「結論」や「重要な定義」「最新の統計データ」を配置しているからだ。AIは効率を重視するため、ページの深い階層まで読み進める前に、必要な情報を冒頭で見つけようとする。特に金融などのデータ重視の分野では、この「フロントロード(情報を前倒しにする)」傾向が顕著だ。

結論やまとめが引用されにくいという事実

一方で、ページの最後にある「まとめ」や「結論」セクションは、AIにほとんど無視されている。ページの末尾10%から引用される割合は、わずか2.4〜4.4%に過ぎない。人間にとっては親切な「まとめ」も、AIにとっては既出情報の繰り返しに過ぎず、新たな情報のソースとしては価値が低いと判断されている可能性がある。

AIに引用されたいのであれば、重要な主張や独自のデータ、具体的な数値は出し惜しみせず、ページのなるべく早い段階で提示すべきだ。導入文のすぐ後に、その記事の核心となる情報を配置する構成が、AI時代のスタンダードになるだろう。

これからのAI検索最適化(GEO)に向けた独自の考察

今回の調査結果を踏まえると、今後のSEOは「GEO(Generative Engine Optimization / 生成エンジン最適化)」という新しいフェーズに移行していく。これまでのSEOが「検索結果の10個の青いリンクの中にどう入るか」を競っていたのに対し、GEOは「AIの回答の一部としてどう採用されるか」を競うゲームだ。

「1キーワード1ページ」からの脱却

従来の「1つのキーワードに対して1つのページを作る」という手法は、AI検索においては非効率になる可能性がある。AIは散らばった情報を収集するよりも、1つの高密度なソースを好むからだ。これからは、関連する複数のキーワードを包含した、構造的で情報量の多い「ピラーページ(柱となるページ)」の重要性がさらに増すだろう。

構造化データを超えた「情報の密度」の重要性

技術的な側面では、Schema.orgなどの構造化データの実装は引き続き重要だが、それ以上に「テキストそのものの情報密度」が問われるようになる。Jaccard係数(集合の類似度を測る指標)を用いた分析でも、AIはページ内の特定の「情報の塊(チャンク)」を狙い撃ちして引用していることが示されている。つまり、曖昧な表現を避け、AIが抽出しやすい明確な事実とデータの記述が、引用獲得の強力な武器になるのだ。

この記事のポイント

- AIの引用は特定のドメインに集中しており、上位30サイトがシェアの67%を占めている。

- 文字数が多いほど引用されやすい傾向にあるが、金融など業界によっては5,000文字程度の「密度」が重視される。

- 1つのページで複数の問いに答える「網羅的なガイド形式」が、AI検索において高い投資対効果を発揮する。

- AIはページの冒頭30%(特に10-20%付近)を最も重点的に読み、末尾の「まとめ」はほぼ無視する。

- これからのSEOは、断片的なページ作成から、トピック全体を網羅する「トピック・オーソリティ」の構築へとシフトすべきだ。

出典

- Search Engine Journal「The Science Of How AI Picks Its Sources」(2026年3月24日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI検索時代のCMS選び——WebサイトがAI対応できているか実践的な監査手法

AI検索がブランドの可視性とコンバージョンを獲得する方法を再構築している。多くのCMSはこの変化に対応するようには設計されていない。

Search Engine Journalの記事によれば、AI検索対応の監査では構造化データ、柔軟なアーキテクチャ、迅速な適応性が評価基準となる。CMOやマーケティングリーダーは自社のCMSが現代の検索行動をサポートしているか、制限しているかを評価する必要がある。

この記事では、AI検索時代にWebサイトのCMSが備えるべき要件と、実践的な監査手法を解説する。監査を通じて、成長を阻害するリスク領域を事前に特定する方法がわかる。

AI検索が変えるSEOとコンテンツの前提

従来の検索エンジンはユーザーのクエリに合致するWebページをリスト表示していた。AI検索はこのモデルを根本から変える。AIは複数の情報源から情報を統合し、直接的な回答を生成する。

「10個の青いリンク」から「単一の回答」への移行

GoogleのSGE(Search Generative Experience)やMicrosoftのCopilotは、検索結果の上部にAIが生成した回答を表示する。ユーザーは回答を得るために複数のページをクリックする必要がなくなる。

この変化はトラフィックの分散を意味する。かつては1つのクエリで複数のサイトがクリックを獲得できた。AI検索では、回答を生成するために参照された数サイトのみが引用され、他のサイトは結果ページから姿を消す可能性がある。

コンテンツの「解釈可能性」が重要になる

AI検索エンジンはWeb上のコンテンツを読み取り、理解し、要約する。このプロセスで重要なのは、コンテンツが機械的に解釈しやすい構造になっていることだ。

記事によれば、AI対応のCMSはコンテンツを単なるテキストの塊ではなく、意味的に構造化されたデータとして扱う必要がある。著者は、構造化されていないコンテンツはAIによって正確に解釈されず、検索結果で引用される機会を失うと指摘している。

AI対応CMS監査の3つの核心領域

CMOやマーケティング責任者が自社のCMSを評価する際、以下の3つの領域に焦点を当てるべきだ。これらの領域は、AI検索時代における発見可能性とコンバージョン性能を直接左右する。

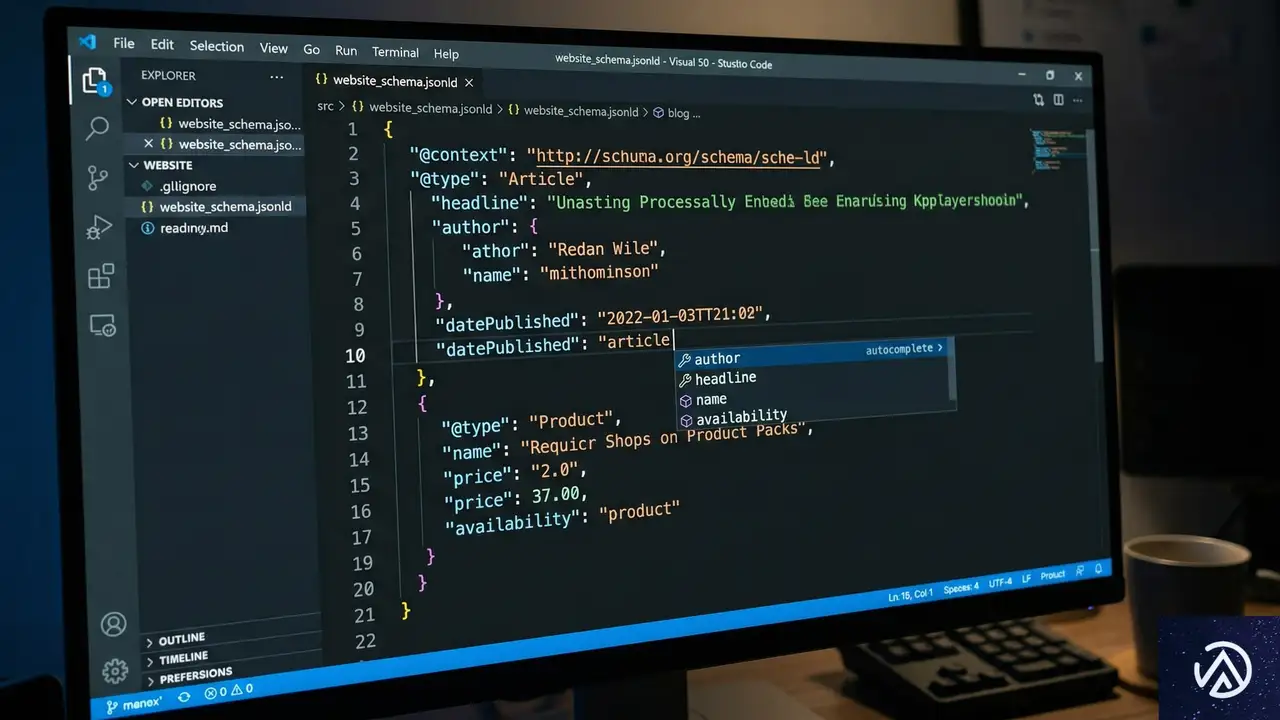

1. 構造化コンテンツとデータモデリング

構造化コンテンツとは、コンテンツを構成する要素(タイトル、著者、公開日、製品仕様、価格など)を定義し、一貫した形式で保存・管理するアプローチだ。HTMLの見出しタグや段落だけでなく、JSON-LDやMicrodataなどの構造化データマークアップがこれに該当する。

監査の第一歩は、サイトのコンテンツがどの程度構造化されているかを確認することだ。すべてのページに適切なスキーママークアップが実装されているか。ブログ記事、製品ページ、イベント情報など、コンテンツタイプごとに最適な構造化データが使われているか。

記事で言及されているDrupalの例では、エンタープライズ実装において構造化コンテンツのモデリングが不十分なケースが多く、これがAI検索での発見可能性を制限する要因となっている。CMSの管理画面でコンテンツタイプとフィールドを柔軟に定義できるかが、構造化の成否を分ける。

2. コンポーザブルアーキテクチャとAPIファースト設計

コンポーザブルアーキテクチャとは、システムを独立したサービスやコンポーネントに分解し、APIを通じて連携させる設計思想だ。ヘッドレスCMSやAPIファーストCMSはこのアーキテクチャの代表例である。

AI検索エンジンは、コンテンツを取得して処理する必要がある。従来のモノリシックなCMSでは、フロントエンドのHTMLレンダリングとバックエンドのデータ管理が密結合している。これに対してAPIファースト設計のCMSは、純粋なデータ(JSON形式など)を提供できる。

監査では、CMSがRESTful APIやGraphQLを提供しているか、そのAPIがすべてのコンテンツタイプにアクセスできるかを確認する。さらに、APIのレスポンス速度と信頼性も評価項目となる。遅いAPIはAIクローラーのインデックス効率を下げる。

3. オープンソースの柔軟性と開発速度

AI検索の要件は急速に進化する。今日有効な最適化手法が、半年後も通用する保証はない。この変化に対応するには、CMS自体が柔軟で拡張可能である必要がある。

オープンソースCMS(WordPress、Drupal、Joomlaなど)は、コア機能を拡張する無数のプラグインやモジュールを利用できる。プロプライエタリなSaaS型CMSでは、ベンダーが新機能を実装するのを待たなければならない場合がある。

監査では、CMSのエコシステムが活発か、新しい技術(例えば、AI検索向けの新しい構造化データ形式)に対応するモジュールが迅速に開発されるかを調べる。開発チームがカスタム機能を実装するためのドキュメントとAPIは整っているか。

実践的な監査チェックリスト

理論的な要件を理解したら、実際のWebサイトに対して実行できる監査項目を確認する。以下のチェックリストは、Search Engine Journalの記事で紹介された監査手法を基に、実践的な項目をまとめたものだ。

技術的インフラの評価

まず、サイトの技術的基盤がAIクローラーや検索エンジンに友好的かどうかを確認する。

- ページ速度とコアウェブバイタル: GoogleのPageSpeed InsightsやLighthouseでスコアを計測する。特にLCP(Largest Contentful Paint)、FID(First Input Delay)、CLS(Cumulative Layout Shift)の3指標は、ユーザー体験だけでなく、クローラーのページ読み込み効率にも影響する。

- モバイルフレンドリー: Googleのモバイルフレンドリーテストを実行する。AI検索はモバイルユーザーへの回答生成を特に重視する。

- XMLサイトマップの完全性: すべての重要なページがサイトマップに含まれ、正しい更新日付と優先度が設定されているか。サイトマップはAIクローラーに対するナビゲーションの役割を果たす。

- robots.txtの設定: 重要なコンテンツが誤ってクロール禁止になっていないか。動的パラメータなどによる重複コンテンツがインデックスされていないか。

コンテンツ構造とデータの評価

次に、コンテンツそのものの構造と質を評価する。

- 構造化データマークアップの検証: Googleの構造化データテストツールやRich Results Testを使用する。Article、Product、Event、FAQPage、HowToなど、コンテンツに適したスキーマタイプが実装されているか。

- コンテンツの独自性と深さ: AIは表面的なコンテンツを要約しても価値が低い。独自の調査データ、詳細な手順、専門家の洞察など、深みのあるコンテンツがAIに引用される可能性が高い。

- エンティティの明確さ: コンテンツ内で言及されている企業名、人物名、製品名、場所などが明確に定義されているか。これらはAIがコンテキストを理解する上で重要な手がかりとなる。

- コンテンツの新鮮さ: 最終更新日が明示されているか。古い情報はAIの信頼性判断で不利に働く可能性がある。

CMSプラットフォーム固有の評価

最後に、使用しているCMS自体の能力と制限を評価する。

- 構造化コンテンツ管理機能: CMSはカスタムフィールドやコンテンツタイプを直感的に作成・管理できるか。フィールド間の関係性(リレーションシップ)を定義できるか。

- APIの成熟度: CMSが提供するAPIは包括的か、セキュリティとパフォーマンスの面で信頼できるか。ドキュメントは整っているか。

- ワークフローとコラボレーション: AI時代はコンテンツの迅速な更新と最適化が求められる。CMS内で編集、承認、公開のワークフローが効率的か。複数人での同時編集をサポートしているか。

- エコシステムと統合可能性: CDN、分析ツール、マーケティングオートメーションなど、外部サービスと容易に連携できるか。AI関連サービス(自然言語処理APIなど)との統合は想定されているか。

監査結果に基づくアクションプラン

監査は現状分析で終わっては意味がない。結果を基に具体的な改善アクションに落とし込む必要がある。監査で明らかになったギャップは、短期・中期・長期のアクションに分類できる。

短期対応:即効性のある技術的修正

監査で発見された技術的な問題点のうち、比較的少ない工数で修正できるものから着手する。

- 構造化データの追加・修正: 欠落しているスキーママークアップを実装する。既存のマークアップにエラーがあれば修正する。多くのCMSではプラグインやモジュールで比較的簡単に対応可能だ。

- パフォーマンス最適化: 画像の最適化(WebP形式への変換、遅延読み込み)、CSS/JSの最小化と結合、キャッシュ設定の見直しなど、ページ速度を改善する施策を実行する。

- コンテンツの微調整: メタディスクリプションの改善、見出し構造の明確化、内部リンクの追加など、既存コンテンツのAI向け最適化を行う。

中期対応:CMS機能の拡張とプロセス改善

CMSの設定や運用プロセスに関わる、やや規模の大きい改善を行う。

- コンテンツモデルの再設計: 新しいコンテンツタイプを定義したり、既存のフィールド構造を見直したりする。これにより、今後作成するすべてのコンテンツが最初から構造化された状態で生まれる。

- APIエンドポイントの整備: ヘッドレスCMSを検討する、または既存CMSのAPI層を強化する。コンテンツ配信ネットワーク(CDN)やエッジコンピューティングとの連携を容易にする。

- 編集ガイドラインの更新: コンテンツ作成チーム向けに、AI検索を意識した新しい編集ガイドラインを作成する。エンティティの明示的な記述、データの出典明示、構造化されたリストの使用などを含める。

長期対応:アーキテクチャの見直しとプラットフォーム選定

監査の結果、現在のCMSが根本的にAI検索時代の要件に対応できないと判断された場合、プラットフォームそのものの移行を検討する段階だ。

記事では、オープンソースで柔軟性の高いCMSが長期戦略に適しているとの見方が示されている。移行を検討する際は、以下の観点で新しいプラットフォームを評価する。

- ネイティブの構造化データサポート: コア機能として構造化コンテンツ管理をサポートしているか。

- コンポーザブルアーキテクチャ: ヘッドレス、APIファースト、あるいはそれらを選択可能なハイブリッドモデルを採用しているか。

- 開発者エコシステム: 活発なコミュニティと豊富な拡張機能があるか。新しい技術トレンドに迅速に対応するモジュールが開発されるか。

- スケーラビリティとパフォーマンス: コンテンツ量とトラフィックの増加に合わせてスケールできるか。エッジ配信などの現代的なインフラと親和性が高いか。

この記事のポイント

- AI検索は「10個の青いリンク」モデルから「単一のAI回答」モデルへ移行し、コンテンツの発見可能性の条件を変えた。

- AI対応CMS監査の核心は「構造化コンテンツ」「コンポーザブルアーキテクチャ」「オープンソースの柔軟性」の3領域にある。

- 実践的な監査では、技術インフラ、コンテンツ構造、CMSプラットフォームの3レベルを評価する。

- 監査結果は短期・中期・長期の具体的なアクションプランに落とし込み、継続的に改善を進める必要がある。

出典

- Search Engine Journal「Is Your Website Ready for AI Search? A Practical Audit for CMOs」(2026年3月25日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Search Console「平均掲載順位」の正体——数字の裏側にある仕組みと活用術

Google Search Console(グーグル・サーチコンソール)は、Webサイトの検索パフォーマンスを把握するために欠かせないツールだ。しかし、管理画面に表示される「平均掲載順位」という指標を見て、その数字の低さに頭を抱える担当者は少なくない。

検索結果で1位を獲得しているキーワードがある一方で、全体の平均順位が「25位」や「40位」と表示されるのはなぜか。この数字は、サイト全体の評価が低いことを意味しているわけではない。むしろ、この指標の計算ロジックを正しく理解していないと、的外れなSEO施策にリソースを割いてしまうリスクがある。

本記事では、Search Consoleにおける平均掲載順位の仕組みを解説し、AI概要(AI Overviews)や画像パックといった最新の検索要素が順位にどう影響するのかを紐解く。数字の裏側にある事実を知ることで、実務に役立つデータ分析が可能になるはずだ。

全体の「平均掲載順位」が低くなる仕組み

Search Consoleの「検索パフォーマンス」レポートを開くと、まず目に飛び込んでくるのがサイト全体の「平均掲載順位」だ。この数字は、サイトがランクインしている「すべてのクエリ」の掲載順位を合算し、平均したものである。

全クエリの合算値という性質

Googleの検索結果は、通常1ページに10件のオーガニック検索結果(広告以外の通常の検索結果)が表示される。平均順位が25位であれば、平均して検索結果の3ページ目付近に表示されている計算になる。しかし、この数字には落とし穴がある。

元記事の著者であるアン・スマーティ氏は、この全体平均の数字にはほとんど洞察が含まれていないため、基本的には無視することを推奨している。その理由は、サイトが意図せずランクインしてしまった関連性の低いクエリや、100位近くに表示されているロングテールキーワード(複数の単語を組み合わせた検索ボリュームの少ないキーワード)まで、すべてが平均計算に含まれてしまうからだ。

なぜ「全体平均」は分析に向かないのか

例えば、主力商品で1位を獲得していても、何千ものマイナーなキーワードで80位に表示されていれば、全体の平均順位は大きく押し下げられる。これはサイトの健全性が損なわれているわけではなく、単にGoogleが膨大なキーワードに対してそのサイトをインデックス(検索エンジンに登録)している結果に過ぎない。

したがって、経営層やクライアントに報告する際は、サイト全体の平均順位を追うのではなく、主要なキーワード群や、特定のディレクトリ(URLの階層)に絞った平均順位を見るべきだ。全体平均の上下に一喜一憂することは、SEO戦略においてあまり意味をなさないと言える。

クエリごとの「平均掲載順位」の計算ロジック

全体平均とは異なり、個別のクエリ(検索語句)ごとの掲載順位は非常に重要な指標になる。ただし、この数字も「ある時点での絶対的な順位」ではなく、あくまで「平均値」であることを忘れてはならない。

ユーザーごとの変動と平均値

検索順位は、検索するユーザーの場所、使用デバイス、過去の検索履歴などによって動的に変化する。Search Consoleに表示されるクエリごとの順位は、実際にそのクエリで検索結果が表示された際の全セッションの平均だ。

仮に2人のユーザーが同じキーワードで検索し、1人には1位、もう1人には2位で表示された場合、Search Consoleでの平均順位は「1.5位」と報告される。このように、整数ではない順位が表示されるのは、複数ユーザーの結果を統計的に処理しているためだ。

特殊な検索要素の数え方

現在のGoogle検索結果(SERP / Search Engine Result Page)には、通常のテキストリンク以外にもさまざまな要素が含まれる。Googleの定義によれば、外部サイトへのリンクを持つ特別な要素はすべて「1つの順位」としてカウントされる。

- 画像パック: 検索結果の上部に表示される複数の画像。これが最上部にあれば1位とカウントされる。

- AI概要(AI Overviews): AIが生成した回答。ここに含まれるリンクも順位カウントの対象だ。

- 他の人はこちらも質問(PAA / People Also Ask): よくある質問のリスト。クリックして展開された中のリンクも、表示されれば順位に含まれる。

以下のデモは、検索結果画面における「掲載順位」がどのように割り振られるかを視覚化したものだ。通常のオーガニック検索結果が1位であっても、その上に画像パックがあれば、オーガニック結果の順位は「2位」になる仕組みがわかる。

このデモでは、画像パックが最上部にある場合の順位カウント方法を示している。このように、Webサイトがオーガニック検索で「実質1位」であっても、Search Console上の数字が「2位」や「3位」になるのは、こうした検索要素の介在が原因だ。

順位が確認できない・変動する要因

Search Consoleのデータと、実際に自分で検索した結果が一致しないことは珍しくない。これには、Googleの検索エンジンが持つ高度なパーソナライズ機能や、デバイスごとの最適化が関係している。

デバイスによる表示順の違い

Googleは、PC(デスクトップ)とモバイルで検索結果の並び順を変えることが多い。モバイル版では画面の制約上、特定の特殊セクション(画像パックなど)が表示されない場合があり、その分だけオーガニック検索結果の順位が繰り上がることがある。

Search Consoleのデフォルト画面では、これらのデバイスデータが混ざった状態で表示されている。正確な分析を行うには、「+新規」フィルタから「デバイス」を選択し、デスクトップとモバイルを分けて比較することが重要だ。特定のキーワードでモバイルの順位だけが低い場合、そのページのモバイルフレンドリー(スマートフォンでの見やすさ)に問題がある可能性も示唆される。

AI概要(AI Overviews)内のリンクの扱い

近年導入が進んでいるAI概要は、掲載順位の計測をさらに複雑にしている。AI概要の中に引用元としてリンクが表示された場合、そのリンクは「1位」としてカウントされることが多い。しかし、AI概要はすべてのユーザーに表示されるわけではなく、また生成される内容も検索のたびに変化する「流動的」なものだ。

記事によれば、AI概要に含まれるリンクが常にSearch Consoleに反映されるわけではないという。ユーザーがAI概要の「詳細を表示」をクリックして初めて露出するリンクなどは、インプレッション(表示回数)としてカウントされないケースもある。このため、平均順位が急激に変動した際は、AI概要の表示有無が影響していないか疑う必要がある。

実務で役立つ「掲載順位」の分析方法

平均掲載順位を単なる「成績表」として眺めるだけでは不十分だ。エンジニアやマーケターがこの数字をどう活用すべきか、独自の分析視点を交えて解説する。

「11位〜20位」のクエリを特定する

SEOにおいて最も効率的な改善ポイントは、平均順位が11位から20位(検索結果の2ページ目)に位置しているクエリだ。これらはGoogleから「ある程度の評価」を得ているものの、ユーザーの目には触れにくい状態にある。

これらのページに対して、コンテンツの加筆や内部リンクの強化を行うことで、比較的容易に1ページ目(10位以内)へ押し上げることができる。平均順位をフィルタリングして、この「あと一歩」のクエリを抽出することは、ECサイトなどの大規模サイト運営において非常に有効な戦略となる。

CTR(クリック率)との相関をチェックする

平均順位が上がっているのにクリック数が増えない、あるいは順位は低いのにクリック率(CTR / Click Through Rate)が高いというケースがある。これは、検索結果に表示されるタイトル(titleタグ)やディスクリプション(meta description)が、ユーザーの検索意図にどれだけ合致しているかを示している。

もし平均順位が3位以内なのにCTRが極端に低い場合、検索結果に表示されているスニペット(説明文)が魅力的でないか、あるいは広告や画像パックにユーザーを奪われている可能性がある。数字を単体で見るのではなく、順位とCTRをセットで分析することで、コンテンツ修正の優先順位を判断できるようになる。

この記事のポイント

- サイト全体の「平均掲載順位」は、全クエリの合算値であるため、分析指標としては重要度が低い。

- クエリごとの順位は、ユーザーのデバイスや場所による変動を平均化した数字である。

- 画像パックやAI概要などの特殊な検索要素も「1つの順位」としてカウントされる。

- 正確な分析のためには、デバイス(モバイル・デスクトップ)ごとのフィルタ活用が必須である。

- 順位だけでなくCTRと組み合わせて分析することで、真の改善ポイントが見えてくる。

出典

- Practical Ecommerce「Search Console’s Average Position, Explained」(2026年3月23日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

GEO(生成AIエンジン最適化)5つの戦略:2026年のAI検索でブランドを推薦させる方法

検索のあり方が、マーケターが想像する以上の速さで変化している。ChatGPTの週間アクティブユーザー数は9億人を超え、GoogleのAI Overviews(AIによる概要表示)は検索結果の4件に1件の割合で表示されるようになった。

このような状況下では、Googleで検索順位1位を獲得していても、AIが生成する回答に自社ブランドが含まれていなければ、急速に拡大するユーザー層に対して「存在しない」も同然となる。そこで重要になるのが、GEO(Generative Engine Optimization:生成エンジン最適化)という概念だ。

GEOとは、AIエンジンがユーザーの質問に対して回答を生成する際、自社ブランドを引用し、参照し、推薦するようにオンライン上の存在感を最適化する手法を指す。本記事では、2026年に向けてブランドが取り組むべき5つのGEO戦略について解説する。

1. 現状の「AI可視性」を測定し、ベースラインを把握する

GEOを始めるにあたって最初に行うべきは、現状の把握だ。どのAIプラットフォームが自社ブランドに言及しているのか、どのようなクエリで競合他社が引用されているのかを知らなければ、戦略的な最適化は不可能である。

AIエンジンにおけるブランド露出の調査方法

元記事の著者は、AI可視性を測定するための具体的な手順として、まずターゲットとなる顧客が尋ねそうな質問を10〜15個リストアップすることを推奨している。例えば「[カテゴリ名]の最適な選択肢は?」や「[課題]を解決する方法は?」といった質問だ。

これらのクエリをChatGPT、Perplexity、Geminiなどの主要なAIエンジンで実行し、以下の項目を確認する。自社ブランドが言及されているか、どの競合他社が表示されているか、そして情報源(ソース)としてどこが引用されているかだ。AIの回答はモデルの更新やインデックスの変化に伴って動的に変わるため、このプロセスを月単位で繰り返すことが重要だという。

競合との比較によるギャップ分析

手動での調査は手間がかかるが、専用のGEOプラットフォームを利用することで、これらの追跡を自動化し、時間の経過に伴う変化を監視することも可能だ。自社が言及されていない一方で競合が頻繁に引用されている場合、その引用元となっているWebサイトやコンテンツの構造を分析することで、自社に足りない要素が明確になる。

2. 従来のSEOを継続しつつ、AIの「餌」となる基盤を作る

GEOが注目される一方で、従来のSEO(検索エンジン最適化)を放棄してはならない。AIエンジンは回答を生成する際、依然としてGoogleの検索上位の結果を主な情報源として利用しているからだ。

検索順位とAI引用の相関関係

特にGoogleのAI Overviewsは、オーガニック検索で良好なパフォーマンスを示しているコンテンツを優先的に参照する傾向がある。高品質なコンテンツの作成、バックリンクの構築、テクニカルSEOといった従来の施策は、AIに参照されるための「入場券」のような役割を果たす。

SEOを基礎的な土台とし、その上にGEO独自の戦術を重ね合わせることが、AI検索時代における勝者の条件となる。SEOで集客しつつ、GEOでAIモデルの「推奨」を勝ち取るという二段構えの戦略が必要だ。

AIが理解しやすいテクニカルな最適化

AIエンジンは、構造化されていないテキストよりも、整理されたデータを好む。後述するスキーママークアップの活用などは、従来のSEO施策の一環でありながら、AIエンジンの理解を助ける強力なGEO施策ともなる。検索エンジンとAIエンジンの両方に配慮したハイブリッドな最適化が求められている。

3. 引用されやすさを重視したコンテンツ構造への転換

AIエンジンは、引用するコンテンツを非常に厳選する。単に読みやすいだけでなく、AIが「事実」や「回答」として抽出しやすい構造になっているかどうかが、GEOの成否を分ける。

「読みやすさ」から「引用しやすさ」へ

AIエンジンは、データや専門知識に基づいた明確で具体的な主張を求めている。曖昧で中身のない文章はスキップされる可能性が高い。定義、統計データ、ステップバイステップのプロセス、専門家の意見など、具体的な記述を意識することが重要だ。

また、コンテンツを質問形式で構成することも有効だ。会話型AIはユーザーの質問によって駆動されるため、見出しを質問形式にし、その直後に簡潔で権威ある回答を配置することで、AIが回答のソースとして採用しやすくなる。

構造化データとトピック・オーソリティの強化

スキーママークアップ(FAQ、How-To、Organizationなど)を適切に実装することで、AIエンジンに対してコンテンツのトピックや構造を強力に伝えることができる。これにより、AIシステムはコンテンツの内容をより正確に把握できるようになる。

さらに、特定のキーワードだけでなく、その分野における深い専門性を示す「トピック・オーソリティ」の構築も不可欠だ。断片的なブログ記事を量産するのではなく、特定の主題を網羅的にカバーするコンテンツクラスターを構築することで、AIエンジンから「信頼できる情報源」として認識されるようになる。

4. RedditやUGC(ユーザー生成コンテンツ)での存在感

多くのブランドが見落としている戦略の一つが、Redditなどのコミュニティサイトの活用だ。AIエンジンは、Reddit上の議論を非常に高く評価している。

なぜAIはRedditを好むのか

Googleや主要なAIプラットフォームは、ユーザー生成コンテンツ(UGC)、特にRedditを「信頼できる本物の情報源」として扱う傾向を強めている。ユーザーがAIに製品の推奨や解決策を尋ねた際、その回答の多くはRedditでの議論から引き出されているのが現状だ。

記事によれば、自社ブランドが関連するスレッドで言及されているかどうかは、AI検索における露出に直結するという。ただし、露骨な宣伝活動は逆効果になるため注意が必要だ。

コミュニティへの誠実な参加

Redditでの戦略的なアプローチとして、まずはターゲット層が活動しているサブスレッドを特定し、数週間は純粋な参加者として貢献することが推奨されている。自社製品を推奨する場合も、そのメリットだけでなく、どのようなケースには不向きかといったニュアンスを含めることが、AIエンジンによる「本物の言及」としての評価につながる。

5. 権威あるサイトの「まとめリスト」に掲載される

AIエンジンは「おすすめのプロジェクト管理ツールは?」といった質問に対し、ゼロから回答を作るわけではない。信頼性の高いWebサイトにある「ベスト10」のようなリスト記事(リスティクル)を統合して回答を生成している。

AIが参照しているソースを特定する

ターゲットとするクエリでChatGPTやPerplexityを実行し、どの記事が参照されているかを特定することが先決だ。AIが頻繁に引用しているリスト記事があれば、その記事に自社ブランドを掲載してもらうことが、複数のAIエンジンで同時に推薦されるための近道となる。

パブリッシャーへのアプローチ

ドメイン権威が高く、AIと従来の検索の両方で頻繁に登場するパブリッシャーをリストアップし、掲載を働きかける。リスト記事は定期的に更新され、そのたびにAIエンジンによって再スキャンされるため、一度掲載されれば数週間以内にAIの回答に反映される可能性があるという。

独自の分析:GEOは「信頼のデジタル証明」への競争である

今回の情報を踏まえると、GEOの本質は単なるテクニカルな最適化ではなく、デジタル空間における「信頼の総量」を競うゲームへと変貌していることがわかる。従来のSEOが「キーワードとの関連性」を重視していたのに対し、GEOは「そのブランドがコミュニティや専門家からどう評価されているか」という多角的なエビデンスを求めている。

特にRedditの重要性が増している点は興味深い。これは、AIが「企業が発信する整えられた情報」よりも「ユーザーが発信する生の声」を、より人間味のある回答の根拠として採用していることを示唆している。マーケターは今後、自社サイトの管理だけでなく、サードパーティのプラットフォームやコミュニティにおけるブランドの語られ方を、より直接的にマネジメントしていく必要があるだろう。

また、AIエンジンが情報を「要約・統合」するという性質上、独自データや独自の調査結果を持つブランドは圧倒的に有利になる。どこにでもある情報をリライトしただけのコンテンツは、AIによって「その他大勢」として処理され、引用元として選ばれる確率は低くなる。2026年に向けて、一次情報の創出こそが最大のGEO対策になると予測される。

この記事のポイント

- GEOは、生成AI検索で自社ブランドを引用・推薦させるための必須戦略である。

- ChatGPTやPerplexityで自社の「AI可視性」を定期的に測定し、ベースラインを把握する。

- AIは事実とデータを好むため、曖昧な表現を避け、引用しやすい構造でコンテンツを作成する。

- RedditなどのUGCプラットフォームでの自然な言及が、AIの信頼獲得に大きく寄与する。

- AIが参照元としている権威あるサイトのリスト記事に掲載されるよう働きかける。

出典

- Search Engine Journal「5 GEO Strategies To Make AI Search Engines Recommend Your Brand In 2026」(2026年3月23日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

WordPress画像SEOの決定版ガイド:Googleが評価する10の最適化ポイント

WordPressサイトにおける画像の最適化は、単にファイルサイズを小さくするだけでは不十分だ。多くのガイドは表示速度の向上で解説を終えているが、本来の目的は「Googleに見つけてもらい、正しく理解してもらうこと」にある。

画像SEOには、パフォーマンス(表示速度)とディスカバラビリティ(見つけやすさ)という2つの層が存在する。いくら圧縮された画像でもGoogleにインデックスされなければ意味がなく、逆に素晴らしい代替テキストを設定しても、読み込み時にレイアウトが崩れればユーザー体験を損なう。

この記事では、WordPressサイトを運営する担当者が明日から実践できる、画像SEOの10のチェックポイントを解説する。これを実践することで、検索流入の増加とサイトの健全性向上を同時に実現できるはずだ。

サイト全体で取り組むべき画像SEOの基盤設定

まずは、サイト内のすべての画像に自動的に適用される基盤部分を整える。一度設定してしまえば、その後の運用負荷を大幅に軽減できる項目だ。

画像サイトマップの構築と確認

検索エンジンは、見つけることができない画像をランク付けすることはない。画像サイトマップは、Googleに対してサイト上のすべての画像への直接的な経路を示す役割を果たす。これは、画像検索からのトラフィックが重要なサイトにとって極めて重要だ。

一般的なSEOプラグインは標準でXMLサイトマップに画像を含めている。ただし、画像がCDN(コンテンツ・デリバリー・ネットワーク)のサブドメインや別ドメインにホストされている場合は注意が必要だ。標準の設定では、メインドメイン以外のファイルが除外されているケースがある。著者のマーク・ザーラ氏は、プラグインが有効かどうかだけでなく、実際のサイトマップ出力を確認することを推奨している。

画像最適化プラグインの一本化

複数の画像最適化プラグインを同時に実行すると、競合が発生してトラブルの原因になる。圧縮された画像が歪んだり、サムネイルが正しく生成されなかったり、サーバーのエラーログが肥大化したりするリスクがある。プラグイン同士が同じ処理プロセスを奪い合うため、結果が予測不能になるからだ。

信頼できるプラグインを1つ選び、適切に設定するのが賢明だ。例えば、圧縮、WebPやAVIFへの変換、EXIF情報の削除、AIによる代替テキスト生成などを一括でこなせるツールを選べば、他のツールを併用する必要はなくなる。もし現在、複数の画像関連プラグインを入れているなら、まずはそれらを整理することから始めたい。

ブラウザキャッシュの適切な設定

ブラウザキャッシュとは、一度訪れたユーザーのブラウザに画像などの静的ファイルを保存させ、再訪問時の読み込み速度を上げる仕組みだ。これにより、2回目以降のアクセスではサーバーからデータをダウンロードする必要がなくなる。

キャッシュプラグインや、高速な国内レンタルサーバーを利用していれば、多くの場合サーバーレベルで設定済みだ。しかし、設定の有無で再訪問時の表示速度には劇的な差が出るため、正しく機能しているか確認する価値はある。

投稿ごとに行うべき画像最適化チェックリスト

次に、記事を投稿するたびに意識すべき個別の最適化項目を見ていく。日々のルーチンに組み込むことで、サイトのSEO強度は着実に積み上がっていく。

アップロード前のファイル名リネーム

画像のファイル名は、小さいながらも確実なSEOシグナルになる。「IMG_20240314.jpg」のような名前はGoogleに何も伝えないが、「wordpress-seo-dashboard.jpg」という名前なら、画像の内容を正確に伝えることができる。

メディアライブラリにアップロードする前に、内容を表す英単語をハイフンでつなげた名前に変更する習慣をつけよう。キーワードを詰め込む必要はない。目が見えない人にその画像を説明するような、簡潔で正確な名前が理想的だ。この作業には数秒しかかからないが、サイト全体で積み重なれば大きな差となる。

画像のwidthとheight属性の明示

HTMLタグに画像の幅(width)と高さ(height)を記述することで、ブラウザは画像が読み込まれる前にそのスペースを確保できる。これが指定されていないと、画像が表示された瞬間に周囲のコンテンツが押し下げられる「レイアウトシフト」が発生する。

CLS(Cumulative Layout Shift)は、Googleがランキング要因として採用しているCore Web Vitalsの指標の一つだ。WordPressの標準エディタを使っていれば自動的に付与されるが、カスタムブロックや一部のページビルダーでは属性が抜け落ちることがある。出力されたソースコードを確認し、サイズ指定が含まれているかチェックしてほしい。

Altテキスト(代替テキスト)の質を高める

Altテキストは、検索エンジンが画像内容を理解する主要な手段だ。また、視覚障害者が使用するスクリーンリーダーで読み上げられるほか、画像が読み込めない際の代替表示としても機能する。

「プラグインのスクリーンショット」のような不親切な説明ではなく、画像の内容を自然に記述することが重要だ。装飾目的の画像であれば、Alt属性を空(alt=””)に設定することで、スクリーンリーダーにスキップすべき画像であることを伝えられる。大量の画像がある場合は、AIを活用した自動生成ツールの利用を検討してもよいが、最終的には人間の目で確認するのがベストだ。

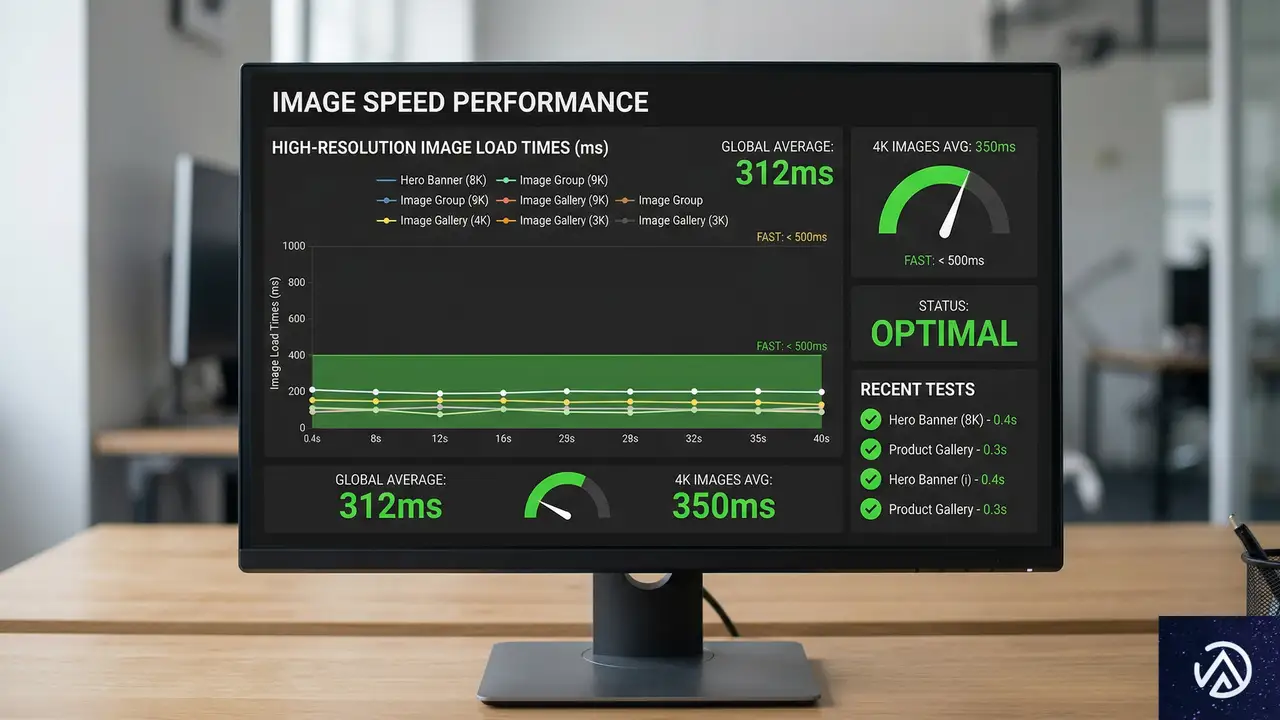

Core Web Vitalsを改善する高度な画像制御

ユーザー体験を数値化する指標「Core Web Vitals」において、画像は大きな影響力を持つ。特にLCP(Largest Contentful Paint / 最大視覚コンテンツの表示時間)の改善には、特別な配慮が必要だ。

LCP画像の遅延読み込み(Lazy Load)を解除する

遅延読み込みは、画面外の画像を必要になるまで読み込まないことで初期表示を速める技術だ。しかし、ページの最上部にある「ヒーロー画像」や「アイキャッチ画像」にこれを適用すると、逆に表示が遅れてLCPスコアを悪化させる。

WordPress 5.9以降では、最初の画像が自動的に遅延読み込みから除外されるようになっている。しかし、テーマやページビルダーの構造によっては、ソースコード上の最初の画像がヒーロー画像でない場合がある。重要な画像に「loading=”lazy”」が付与されていないか、ブラウザの検証ツールで確認することが推奨される。

fetchpriority属性で優先度を指定する

最新の最適化手法として「fetchpriority=”high”」属性の活用がある。これをLCP画像に付与することで、ブラウザに対して「この画像は最優先でダウンロードすべきものだ」と伝えることができる。

記事によれば、この属性を追加するだけでLCPが20〜30%改善したテスト結果もあるという。パフォーマンスプラグインの中にはこれを自動で設定するものもあるが、手動でコードを調整できる環境であれば、ヒーロー画像への適用は非常に効果的だ。

検索結果での露出を増やすリッチな情報付加

画像そのものの情報だけでなく、その周辺情報を充実させることで、Googleはより自信を持って画像を検索結果に表示できるようになる。

キャプションによるコンテキストの提供

Googleは、画像自体のメタデータだけでなく、その周囲にあるテキストやキャプションからも情報を抽出している。適切に記述されたキャプションは、画像検索における競争力を高める要因になる。

ただし、すべての画像にキャプションを付ける必要はない。読者が画像の内容を理解する助けになる場合にのみ記述すべきだ。無理なキーワードの詰め込みは避け、編集上の価値を優先させよう。

構造化データ(Schema.org)の活用

構造化データを使用すると、画像に関する詳細なコンテキストをGoogleに伝えられる。特に製品(Product)やレシピ(Recipe)の画像は、構造化データがあることでGoogleショッピングパネルやリッチリザルトに表示される資格を得る。

WooCommerceなどのECサイトや料理ブログを運営しているなら、この設定は必須だ。主要なSEOプラグインを使っていれば、投稿タイプに応じて自動的にスキーママークアップが行われることが多いが、正しく出力されているか「リッチリザルトテスト」などのツールで確認しておきたい。

独自の分析:画像SEOにおける「ユーザー体験」と「AI理解」の融合

近年の画像SEOにおいて最も大きな変化は、Googleの画像解析能力が飛躍的に向上したことだ。かつてはファイル名やAltテキストに頼らざるを得なかったGoogleだが、今やAIによって画像内の物体やテキスト、さらには文脈まで高精度に理解している。

この変化は、SEO対策のあり方を「ハック」から「本質的な改善」へとシフトさせている。例えば、fetchpriority属性の導入は、単なる検索順位対策ではなく、ユーザーに「いかに速く、ストレスなくコンテンツを届けるか」というブラウザ制御の最適化だ。また、Altテキストの重要性が増しているのは、アクセシビリティ(誰でも情報にアクセスできること)がSEOの評価軸として確立されたことを意味している。

WordPress運営者が目指すべきは、技術的なチェックリストを埋めることだけではない。画像が読み込まれるまでの数秒間、ユーザーを待たせないためのパフォーマンス管理と、画像検索から訪れるユーザーに対して正確な情報を提示するディスカバラビリティの管理。この両輪を回すことが、結果としてGoogleからの高い評価につながるのだ。

この記事のポイント

- 画像サイトマップの確認:CDN利用時は特に注意し、Googleが画像を見つけられる状態にする。

- プラグインの競合回避:画像最適化ツールは1つに絞り、予期せぬエラーを防ぐ。

- ファイル名とAlt属性の徹底:アップロード前に名前を変え、具体的で自然な説明文を添える。

- LCP対策の高度化:最上部の画像は遅延読み込みを解除し、fetchpriorityで読み込みを加速させる。

- GSCでのフィールドデータ確認:PageSpeed Insightsの単発テストだけでなく、Search Consoleで実際のユーザー体験を監視する。

出典

- WP Mayor「WordPress Image SEO Checklist: What Google Actually Looks For」(2026年3月19日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIはSEOを終わらせるのか?技術的専門性がこれまで以上に重要になる理由

AI(人工知能)の急速な普及により、SEO(検索エンジン最適化)の終焉を予見する声が強まっている。しかし、実態は「SEOの消滅」ではなく、実務における「スキルの再定義」が起きていると捉えるべきだ。AIは定型業務を高速化させる一方で、成果を出すためにはこれまで以上に高度な人間の判断力と技術的な理解を必要としている。

最新の技術動向によれば、AIによる自動生成が一般化するほど、情報の信頼性や構造化されたデータの価値が高まる傾向にある。単にキーワードを配置するだけの旧来のSEOは通用しなくなるが、AIを制御し、検索エンジンに正しく情報を伝える役割としてのSEOは、より専門性を増していく。本記事では、AI時代におけるSEOの生存戦略と、技術的専門性が重要視される理由を深掘りする。

AIがSEOの専門性を「代替」できない決定的な理由

AIはコードの生成やテキストの要約において驚異的な能力を発揮するが、それはあくまで「確率に基づいた出力」に過ぎない。SEOの実務においてAIを導入しても、人間の専門家による監督がなければ、その出力がビジネス成果に結びつくことは稀だ。AIは機械的に思考するため、文脈や意図を汲み取るには、詳細かつ技術的な指示(プロンプト)が不可欠となる。

プロンプト・エンジニアリングに求められる技術的素養

AIから有用な回答を引き出すためのプロンプト作成は、今やSEO担当者の主要なスキルとなりつつある。元記事の著者は、高品質な出力を得るためには、データの構造を理解した上での指示が必要だと指摘している。例えば、商品情報の管理システム(PIM)からデータを抽出し、それをAIが処理しやすい形式に変換してプロンプトに組み込む作業には、IDやクラス、エンティティといった構造的な思考が欠かせない。

このように、AIを効率化の道具として使う側には、AIが生成したコードやテキストが「技術的に正しいか」「検索エンジンのガイドラインに沿っているか」を判断する審美眼が求められる。技術的な知識を持たない者がAIを使っても、デバッグ(修正作業)ができず、結局は使い物にならないアウトプットを量産するリスクがある。

構造化データとエンティティ理解の重要性

AIは構造化されたデータを好む。検索エンジンも同様に、Schema.orgなどの構造化マークアップを通じて、ページの内容を「エンティティ(実体)」として理解しようとする。AI時代におけるSEOは、単なる文章作成から、情報をいかに機械が理解しやすい構造に整理するかという「データマネジメント」に近い領域へとシフトしている。

具体的には、商品名、価格、在庫状況、ブランドといった情報を、AIが迷わず識別できるように定義するスキルだ。このプロセスには、HTMLの知識だけでなく、データベースの論理構造を理解する能力が関わってくる。AIが進化しても、その「餌」となるデータの質を担保するのは人間の役割だ。

データ品質のジレンマ:AIはなぜ「嘘」をつくのか

AIの性能は、学習に使用するデータの質に直接左右される。初期の生成AIモデルは、厳選されたデータセット(LLM)内で完結していたが、現在の多くのAIはウェブ検索を通じて最新情報を取得するようになった。ここに、SEOにおける新たな課題が浮上している。

オープンウェブのノイズとAIの判断力

ウェブ上には、正確な事実だけでなく、誤情報や主観的な意見が溢れている。AIはこれらを完全に区別することが難しく、未選別のデータにアクセスさせることで、かえって出力の精度が下がるケースがある。元記事によれば、GPT-4以降のモデルがウェブ検索を多用するようになったことで、一時的に情報の信頼性が損なわれるという「後退」も見られたという。

SEO担当者にとっては、自社のサイトがAIによって「信頼できる情報源」として参照されるように、情報の正確性と権威性(E-A-T)を担保することが最優先事項となる。AIが誤った情報を学習・引用しないよう、一次情報の質を高め、出典を明確にすることが、将来的なAI検索(SGEなど)での露出に直結する。

情報のキュレーションと専門家の役割

AIに大量のデータを与えれば解決するわけではない。情報の「量」よりも「キュレーション(精査)」が重要になる。AIが事実とフィクションを混同しやすい現状では、人間による最終的なファクトチェックが不可欠だ。特に医療や金融などのYMYL(Your Money or Your Life)領域では、AI任せのコンテンツ制作は致命的なSEO順位の下落を招く恐れがある。

SEO自動化の理想と現実:なぜ全自動は難しいのか

MakeやN8NといったiPaaS(複数のアプリを連携させるプラットフォーム)の登場により、SEO業務の自動化は一見容易になったように思える。しかし、実務レベルの複雑なタスクを完全に自動化するには、依然として高い壁が存在する。

テクニカルSEO監査における自動化の限界

例えば、サイト全体のテクニカルSEO監査を考えてみよう。これには、クローリングデータ、ブラウザレベルの診断、デスクトップツールの数値など、多岐にわたるデータソースが必要になる。これらを統合し、一貫性のあるワークフローとして自動化するには、高度なAPI連携とインフラの構築、そして継続的なメンテナンスが求められる。

元記事の著者がAIツールを用いてテクニカル監査の自動化を試みた際、AIのメモリ制限(過去の指示やデータを保持できる容量)が原因で、大規模なデータの処理に苦戦したという。また、存在しないH1タグの欠落を致命的なエラーとして過剰に報告するなど、優先順位の判断ミスも散見された。チェックリスト形式の単純な監査なら自動化可能だが、深い洞察を伴う分析には、依然として人間の介入が必要だ。

「Vibecoding」とそのリスク

近年、CursorやClaude Codeといったツールを使い、厳密なコーディング知識なしに「感覚(Vibe)」でシステムを構築する「Vibecoding」という言葉が生まれている。SEOツールを自作する際にもこの手法は有効だが、生成されたコードの妥当性を検証できない場合、気づかないうちに不正確なデータに基づいた判断を下すリスクがある。自動化は効率を上げるが、その設計図を描き、不具合を修正する能力は人間に留まり続ける。

ECサイト運営者が注視すべきAI時代のSEO戦略

WooCommerceなどのECサイトを運営する場合、AIの影響はより顕著に現れる。商品点数が多いECサイトでは、AIを活用した効率化の恩恵が大きい反面、競合も同様のツールを使うため、差別化が難しくなる。

AIによる商品説明生成と独自価値の付加

AIを使えば、数千点の商品説明文や代替テキスト(alt属性)を瞬時に生成できる。しかし、メーカー提供のスペックをAIに読み込ませるだけでは、どのサイトも似たようなコンテンツになってしまう。SEOで優位に立つためには、AIが生成した文章に「実際の使用感」や「独自の比較視点」といった、AIが持ち得ない一次情報を人間が加筆する必要がある。

また、ECサイトにおける画像SEOも重要だ。AIを使ってaltテキストを自動生成する際も、単なる物の名前だけでなく、「どのようなシーンで使われているか」という文脈を含めるようAIをコントロールする技術が、検索流入の差を生むことになる。

AI検索(SGE)への最適化とブランド認知

GoogleのSGE(Search Generative Experience)のように、検索結果画面でAIが回答を提示する形式が増えると、ユーザーはサイトに訪問せずに疑問を解決してしまう(ゼロクリックサーチ)。この環境下では、AIの回答内に「推奨されるブランド」として自社商品が登場することが重要になる。そのためには、SNSやプレスリリース、外部メディアでの言及を増やし、ウェブ全体で「この商品は信頼されている」というシグナルを強化する、広義のSEO(オンライン・プレゼンスの最適化)が求められる。

SEOが「不要」になる日は来るのか:社会的・技術的障壁

SEOが完全に不要になるためには、AIが人間の介入なしに、100%の信頼性を持って独立して動作し、かつスケール(規模拡大)できる必要がある。しかし、その実現にはまだ数年から数十年単位の時間がかかると予測されている。

コンピューティングコストとアルゴリズムのバランス

AIの処理には膨大な電力と計算リソースが必要だ。全ての検索クエリに対して高度なAIを走らせることは、コスト面で現実的ではない。そのため、検索エンジンは今後も「単純なタスクは従来のアルゴリズム」「複雑な分析はAI」という使い分けを続ける可能性が高い。この「ハイブリッド構造」が続く限り、アルゴリズムに最適化するSEOの技術は価値を持ち続ける。

社会的な受容性と「人間らしさ」への価値

かつて電卓やインターネットが登場した際、それらは「カンニング」や「手抜き」と見なされた時期があった。しかし、時間が経つにつれてそれらは道具として標準化された。AIも同様のプロセスを辿っている。私たちがAIを「脅威」ではなく「道具」として完全に受け入れ、法整備や倫理基準が整うまでは、人間の責任による情報発信が重視され続けるだろう。

この記事のポイント

- AIはSEOを終わらせるのではなく、実務を「手作業」から「AIの管理・監督」へとシフトさせる。

- 高品質な出力を得るためには、データの構造化能力や技術的なプロンプト作成スキルが不可欠。

- AIはウェブ上の誤情報を学習しやすいため、人間によるファクトチェックとE-A-Tの担保が重要性を増す。

- 完全なSEO自動化には技術的・コスト的な限界があり、当面は人間とAIの協業モデルが続く。

- ECサイトでは、AIによる効率化と、人間による「一次情報」の付加を組み合わせることが差別化の鍵となる。

出典

- MarTech「Will AI end SEO?」(2026年3月23日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIマーテック最新動向:詐欺集団から学ぶ「AIのROI」とGEOの台頭

AI(人工知能)がマーケティング領域で最も明確なROI(投資対効果)を叩き出しているのは、皮肉にも「詐欺」の分野だ。インターポールの報告によれば、犯罪ネットワークはAIを駆使して、多くの企業が理想とするレベルの精度とスピードで不正行為をスケールさせている。

2026年3月現在、マーテック(マーケティング・テクノロジー)の世界では、こうした「説得の自動化」を正当なビジネスに転用しようとする動きが加速している。AI検索エンジンへの最適化(GEO)や、自律的にタスクをこなす「エージェント型AI」の登場がその象徴だ。

本記事では、最新のAIマーテックニュースを基に、企業の担当者が押さえておくべき技術トレンドと、実務への影響を詳しく解説する。

犯罪ネットワークに学ぶ「AIによる説得」のスケール化

AIのROIについて、最も成功しているモデルは犯罪組織にあるとの指摘がある。インターポールの調査によれば、組織的な詐欺ネットワークは、ディープフェイク音声やAI生成のフィッシングメッセージ、自動化されたソーシャルエンジニアリングを駆使し、驚異的な効率で被害者を獲得している。

犯罪者はAIを利用して、信頼できる人物の声を模倣し、現実の行動履歴に基づいたパーソナライズを大規模に行う。これは単なるスパム送信ではなく、高度にターゲット化された「エンゲージメント」の仕組みだ。彼らはテスト、反復、最適化のループを高速で回しており、これは現代のグロースエンジンそのものだと言える。

元記事の著者は、この状況が「効果的なAI導入」のプレビューであると分析している。技術そのものが差別化要因なのではなく、行動に影響を与えるための「実行力」が鍵となる。合法的な組織が実験段階に留まっている間に、犯罪者はすでにAIを「説得をスケールさせるシステム」として完成させているのだ。

SEOの次に来る「GEO(生成エンジン最適化)」の衝撃

生成AI検索への対応が必須に

従来の検索エンジン最適化(SEO)に加え、新たに「GEO(Generative Engine Optimization)」という概念が急速に普及している。これは、ChatGPTやPerplexityのような生成AI検索エンジンにおいて、自社ブランドや製品が推奨されるようにコンテンツを調整する技術だ。

Glow-BやOver The Top SEOといった企業は、すでにGEO専用のソリューションを立ち上げている。これらのツールは、AIがWeb上の情報を要約する際に、自社の情報が正確かつ優先的に引用されるためのシグナルを生成する。B2Bマーケティングにおいても、Informa TechTargetがAI可視化ツールを導入し、ブランドがAIの回答内でどのように扱われているかの追跡を開始した。

「ゼロクリック環境」での生存戦略

ユーザーが検索結果のリンクを踏まず、AIの回答だけで完結する「ゼロクリック」環境が増えている。この状況下では、自社サイトへの流入数よりも「AIの回答に含まれるブランドの引用頻度と質」が重要になる。Mersel AIなどのプラットフォームは、AIの回答内でのブランド言及率(シテーション)を高めるための実行支援を行っている。

実務においては、単にキーワードを埋め込むのではなく、AIが理解しやすい構造化データ(Schema.orgなど)の整備や、専門家による裏付け(E-E-A-T)をより強化することが求められる。AIは「事実」として認識した情報を優先して回答に組み込む傾向があるからだ。

「Agentic AI(エージェント型AI)」による運用の自動化

指示待ちから「自律実行」への転換

2026年に入り、単なるチャットボットを超えた「Agentic AI(エージェント型AI)」のリリースが相次いでいる。Agentic AIとは、ユーザーの指示を待つだけでなく、目標を達成するために自ら計画を立て、ツールを使い分け、タスクを完結させる自律型のAIを指す。

例えば、BlueConicは顧客データの処理とマーケティングチャネル間でのタスク実行を自律的に行うワークスペースを発表した。また、FreeWheelはビデオ広告の交渉と購入を自動化するインフラを構築している。これらは、人間が細かなプロンプトを入力しなくても、設定されたKPI(重要業績評価指標)に基づいて最適なアクションを選択する仕組みだ。

カスタマーサービスの完全自動化

接客の分野でもエージェント化が進んでいる。RingCentralは、人間の介在なしに音声会話で問題を解決するカスタマーサービスプラットフォームを公開した。Sinchも「Agentic Conversations」機能を拡張し、ブランドと顧客の間のチャット対話をAIエージェントが自律的に管理できるようにした。

これにより、従来の「定型文を返すボット」では対応できなかった複雑な問い合わせも、AIが過去のデータや社内ドキュメントを参照しながら柔軟に解決できるようになる。運用の現場では、人間が「作業者」から「AIエージェントの監督者」へと役割を変える必要がある。

EC・リテール領域におけるAI活用の深化

「デジタル棚」のリアルタイム最適化

EC(電子商取引)分野では、Similarwebが小売インテリジェンススイートを拡張した。AIを用いてオンラインマーケットプレイス上の「デジタル棚」のパフォーマンスや消費者の購買トレンドをリアルタイムで監視する。これにより、競合他社の在庫状況や価格変動に合わせた動的なマーケティング戦略が可能になる。

また、CommerceIQがリリースした「Retail AI Agents」は、商品の掲載内容の変化を監視し、自動的に反応する機能を備えている。例えば、自社製品のレビューが急落したり、在庫が少なくなったりした際に、即座に広告出稿を調整するといった運用が自動化される。

ソーシャルプルーフの自動生成

SyndigoはTaggstarを買収し、商品ページにリアルタイムのショッピングトレンドを表示する「ソーシャルプルーフ」機能を追加した。AIが「今、この商品が何人に閲覧されているか」「過去1時間に何個売れたか」といったデータを分析し、消費者の購買意欲を刺激するメッセージを自動生成する。

こうした技術は、ユーザーの心理的なハードルを下げる効果があり、特にコンバージョン率(CVR)の改善に直結する。ECサイトの運営者にとって、AIは単なるバックエンドの効率化ツールではなく、フロントエンドの売上向上に寄与する強力な武器となっている。

主要プラットフォームの戦略的動向:Adobe、NVIDIA、Webflow

AdobeとNVIDIAの強力な提携

クリエイティブとテクノロジーの巨人が手を組んだ。AdobeとNVIDIAは、新しいFireflyモデルの開発とマーケティングワークフローの構築に向けたパートナーシップを発表した。NVIDIAの演算技術を活用することで、AIモデルによるコンテンツ生成やキャンペーンタスクの自動化を劇的に高速化させる狙いだ。

この提携により、企業は高品質なビジュアル資産を瞬時に生成し、それを即座に広告運用に回すという一気通貫のパイプラインを構築できるようになる。コンテンツ制作のボトルネックが解消されることで、マーケティングの「量」と「質」の両立が容易になるだろう。

Webflowによる動画AIの買収

ノーコードWeb制作プラットフォームのWebflowは、Vidoso AIを買収した。この買収の目的は、Web制作ワークフローに自動化された動画機能を組み込むことにある。AIエージェントがユーザーのWebサイト構築を支援し、動画コンテンツやマーケティング資産の管理をサポートする仕組みだ。

Web制作の現場では、静的なページだけでなく動画を効果的に配置することが一般的になっている。WebflowのようなプラットフォームがAI動画機能を統合することで、専門知識のない担当者でもリッチなメディア体験を提供できるようになる。

独自の分析:AI時代に求められる「説得のアーキテクチャ」

今回のニュース群を俯瞰すると、AI活用は「生成(Generative)」から「実行(Agentic)」へと完全にシフトしたと言える。冒頭の犯罪ネットワークの例が示す通り、AIの真の価値は「人間を動かすためのプロセスをスケールさせること」にある。

多くの企業がAIを「コスト削減」や「効率化」の文脈で捉えがちだが、それは守りの戦略に過ぎない。攻めの戦略として重要なのは、AIを使って顧客とのタッチポイントをいかに「説得力のある体験」に変えるかだ。GEOへの対応も、AIエージェントの導入も、すべては「AIという新しいインターフェースを通じて、いかに自社を選んでもらうか」という課題に集約される。

中小企業の担当者が取るべきアクションは、自社のコンテンツがAIにどう解釈されているかを知ることから始まる。PerplexityなどのAI検索で自社や競合を検索し、どのような回答が生成されるかをテストする。その上で、AIが引用しやすい「構造化された事実」をWebサイト上に配置していくことが、2026年以降のデジタル戦略の土台となるだろう。

この記事のポイント

- AIのROIは「説得のスケール化」にあり、犯罪組織がその先例を示している

- SEOからGEO(生成エンジン最適化)へのシフトが本格化し、AI検索対策が必須となった

- 「Agentic AI(エージェント型AI)」が登場し、マーケティング運用の自律化が進んでいる

- EC分野ではAIによるリテールインテリジェンスとソーシャルプルーフの活用が売上に直結する

- AdobeやWebflowなど主要プラットフォームがAI機能を統合し、制作から運用までの壁が消滅しつつある

出典

- MarTech「The latest AI-powered martech news and releases」(2026年3月19日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験