SEOの新戦場「コンセンサス・レイヤー」攻略法——AI検索時代に生き残る信頼の構築術

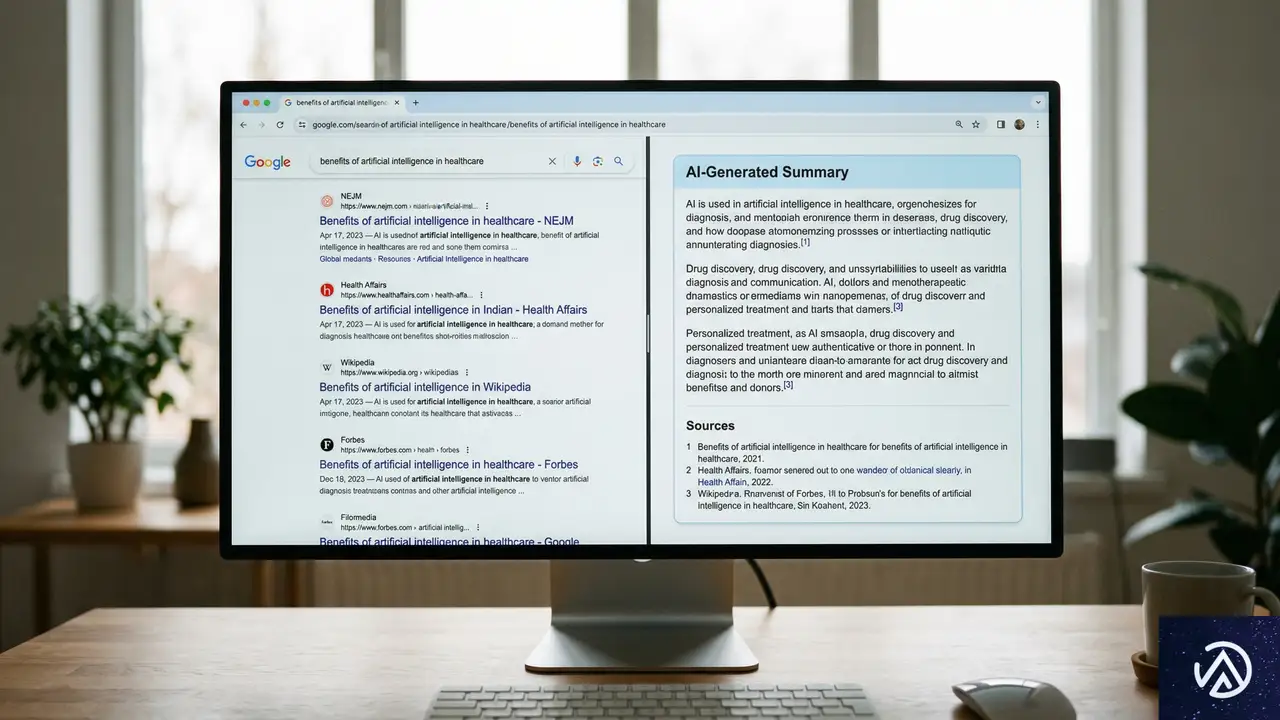

検索結果の1位を獲得していても、ユーザーからは全く見えない存在になるリスクが高まっている。従来の検索エンジンが「URLのリスト」を提示していたのに対し、生成AIやAI検索エンジンは、複数のソースから情報を合成して「一つの回答」を提示するからだ。

2024年半ば以降、AIによる検索概要(AI Overviews)が表示されるクエリにおいて、オーガニック検索のクリック率(CTR)は61%も低下した。AIが回答を完結させてしまうため、ユーザーはサイトを訪問する必要がなくなっている。この変化は、SEOの主戦場が「掲載順位」から「コンセンサス(合意)」へと移行したことを意味する。

この記事では、AIがどの情報を信頼し、どのブランドを回答に採用するかを決定する「コンセンサス・レイヤー」の仕組みを解説する。最新のSEO戦略において、なぜ分散型の信頼構築が必要なのか、その具体的な手法を紐解いていく。

検索順位の価値が変わる?「コンセンサス・レイヤー」の正体

これまでのSEOは、特定のキーワードで自社サイトを上位に表示させ、クリックを促すことがゴールだった。しかし、ChatGPTやPerplexityのようなAI検索エンジンが登場したことで、その論理は通用しなくなっている。著者のアダム・ハイツマン氏は、これを「リトリーバル(検索)からコンセンサス(合意)への移行」と表現している。

AIが回答を生成する仕組み「RAG」

AI検索の裏側では、RAG(Retrieval-Augmented Generation / 検索拡張生成)という技術が動いている。これは、AIがWeb上の膨大な情報をリアルタイムで検索し、信頼できる複数のソースから共通する主張を抽出して、一つの回答にまとめ上げる仕組みだ。

RAGとは、AIが学習データだけに頼らず、外部の最新情報を参照して回答の精度を高める手法を指す。このプロセスにおいて、AIは一つのサイトの情報だけを信じることはない。複数の独立したメディアやプラットフォームが同じ内容を述べているとき、AIはその情報を「事実」としての確信度が高いと判断し、回答に採用する。

コンセンサス・レイヤーは「パターンの認識」

コンセンサス・レイヤーとは、複数のAIシステムが特定のブランドやサービスについて、どれだけ一貫した情報を出力できるかを示す指標だ。AIはハルシネーション(事実に基づかない嘘)を防ぐために、情報の裏付け(Corroboration)を常に行っている。

例えば、あるブランドが自社サイトだけで「業界No.1」と主張していても、AIはそれをコンセンサスとは見なさない。一方で、複数のニュースサイト、レビュープラットフォーム、SNS、業界フォーラムで同様の評価を受けていれば、AIはそれを強力なパターンとして認識する。孤立した権威ではなく、分散された信頼こそがAI時代のSEOの鍵となる。

AIが信頼性を判断する「コンセンサス」の構成要素

AIがどのブランドを回答に含めるかを決める際、従来のバックリンク(被リンク)以外のシグナルを重視するようになっている。ハイツマン氏は、特に以下の要素がコンセンサス形成に寄与すると指摘している。

リンクのない「サイテーション(言及)」の重み

これまでのSEOでは、リンクがない言及は価値が低いとされることが多かった。しかし、AIシステムはWebページをテキストデータとしてスキャンするため、リンクの有無に関わらずブランド名が語られている文脈を理解する。信頼性の高い業界メディアでブランド名が出るだけで、それは強力なコンセンサス・シグナルとなる。

Semrushの調査によれば、ChatGPTが引用したウェブページの約90%は、同じクエリの検索結果で上位20位以内に入っていないという。これは、AIが「検索順位が高いページ」ではなく「広範囲で信頼されている情報源」を優先して選んでいる証拠だ。

コミュニティとエンティティの明確化

RedditやQuoraなどのコミュニティプラットフォームでの評判も無視できない。AIはリアルなユーザーの声を重視するため、特定のサブレディット(Reddit内の掲示板)で推奨されているブランドは、AIの回答に反映されやすくなる。これは「偽造できない信頼」としてAIに評価されるためだ。

また、エンティティ(実体)の明確化も重要だ。エンティティとは、人、場所、組織など、検索エンジンが識別できる概念を指す。Schema.org(構造化データ)やJSON-LDを適切に設定し、自社が「何者であり、どのカテゴリーで、どのような専門性を持っているか」を機械可読な形式で伝えることで、AIは情報を取得しやすくなる。

実践的な戦略:AI検索で選ばれるブランドになるために

コンセンサスを構築するには、自社サイトの改善だけでは不十分だ。Web全体に自社の信頼の証拠を散りばめる必要がある。具体的なステップは以下の通りだ。

自社LLMオーディット(監査)の実施

まずは、主要なAI(ChatGPT、Perplexity、Geminiなど)に対して、顧客が尋ねそうな質問を投げかけてみることから始める。「〇〇の課題を解決する最適なツールは?」「△△業界の主要なプロバイダーは?」といった質問だ。

この監査により、自社がどのように認識されているか、あるいは無視されているかが浮き彫りになる。もし競合他社ばかりが推奨されているのであれば、どのメディアが引用源になっているかを特定し、そこへの露出を強化する戦略が必要になる。古い情報が回答に使われている場合は、外部メディアの情報を更新する働きかけも重要だ。

独自調査データによる「引用源」の確立

AI時代に最も強力なコンテンツは「独自調査データ」である。業界のベンチマークとなる統計、独自のアンケート結果、実験データなどは、他のメディアやジャーナリストが引用しやすいためだ。多くの外部ソースから引用されることで、そのデータの「発信元」としての地位が確立され、AIは確信を持ってそのブランドを回答に採用するようになる。

また、専門家による監修や寄稿も効果的だ。AIは執筆者の専門性(E-E-A-T)を評価するため、業界で認知されている人物がブランドに関わっている証拠を、構造化データとともにWeb上に残していくことが求められる。

成果をどう測るか?新しいSEOのKPI設定

検索順位が唯一の指標ではなくなった今、計測すべきKPIも変化している。従来の「クリック数」や「順位」だけに固執すると、戦略を見誤る可能性がある。

シェア・オブ・ボイスとエンティティの共起

AIの回答内での「シェア・オブ・ボイス(占有率)」を測定することが重要だ。特定のカテゴリに関するAIの回答のうち、自社ブランドが言及された割合を追跡する。また、どのようなキーワードや競合他社と一緒に語られているかという「共起(Co-occurrence)」のパターンも分析対象となる。

さらに、言及されているドメインの多様性(Mention Density)も指標になる。特定のサイトだけでなく、幅広い独立したメディアで自社が語られている状態を目指すべきだ。これらの指標は、単なるトラフィックよりも、ブランドの長期的な「AI視認性」を正確に表すものとなる。

この記事のポイント

- 順位から合意へ:AI検索は単一のページではなく、Web上の「コンセンサス(合意)」を基に回答を合成する。

- RAGの理解:AIは複数の信頼できるソースから情報を引き出し、裏付けが取れたものだけを回答に採用する。

- サイテーションの重要性:リンクの有無に関わらず、信頼性の高いメディアやコミュニティでの言及がAIの信頼シグナルになる。

- 独自データの活用:独自調査や統計を発信することで、AIが引用せざるを得ない「情報の源泉」としての地位を築く。

- KPIの刷新:クリック率だけでなく、AI回答内でのシェアや言及の多様性を追跡し、分散型のオーソリティを評価する。

出典

- Search Engine Land「SEO’s new battleground: Winning the consensus layer」(2026年3月20日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

SEOからAAIOへ:AIエージェントがWebサイトを「使う」時代の最適化戦略

Webサイトはこれまで、スクロールし、クリックし、ブラウジングする「人間」のために作られてきた。しかし、その25年間にわたる常識がいま、根本から覆されようとしている。Webサイトのオーディエンスは、もはや人間だけではない。

2026年、私たちのサイトを訪れるのは、人間の代わりに情報を探し、比較し、予約や購入までを自律的にこなす「AIエージェント」だ。この変化はモバイル対応への移行よりもはるかに大きな、インターネット史上最大の転換点になると予測されている。

本稿では、従来のSEO(検索エンジン最適化)を超えた新しい概念「AAIO(Agentic AI Optimization / エージェントAI最適化)」について解説する。AIエージェントに選ばれ、活用されるためのWebサイトへと進化させるための具体的なフレームワークを提示したい。

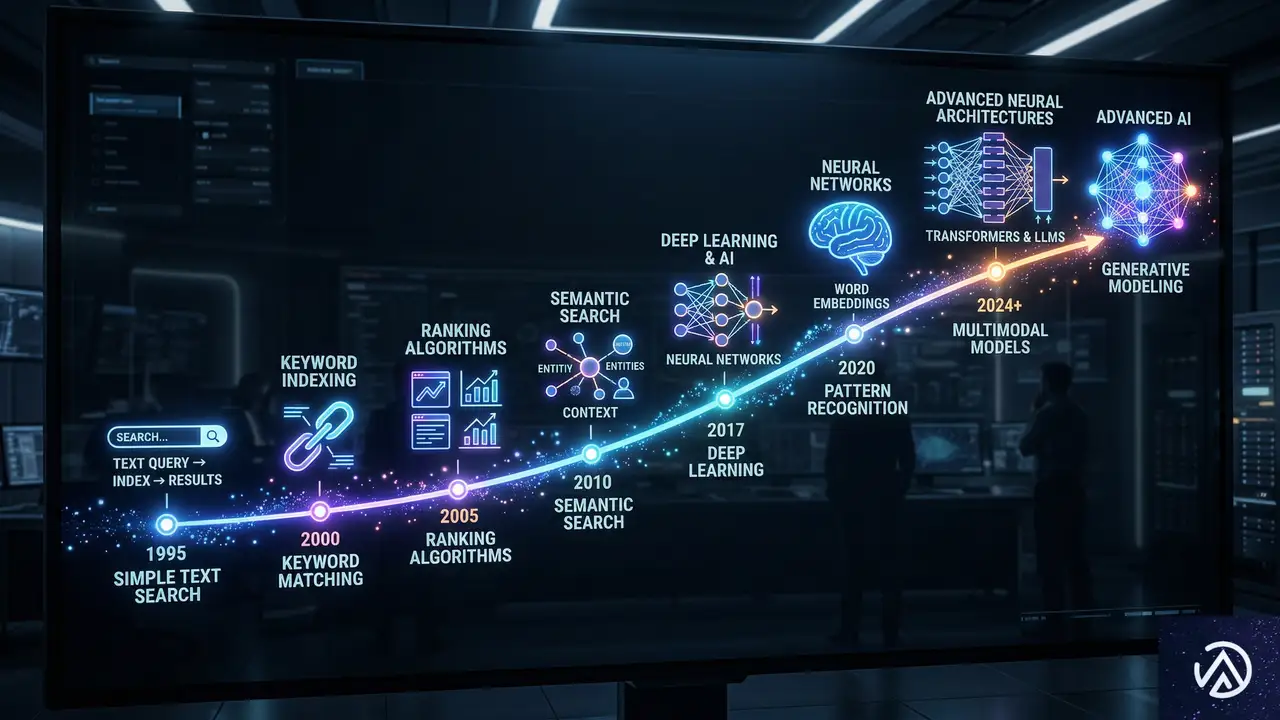

SEOからAAIOへ:Webサイト最適化の歴史的転換点

Webサイトの最適化手法は、AIの進化とともに急速な変遷を遂げてきた。かつてはGoogleの検索結果で上位に表示されること(SEO)だけが目標だったが、現在は「AIにどう扱われるか」がビジネスの成否を分けるようになっている。

検索順位から「AIエージェントの利便性」へ

SEOの時代、私たちはキーワードを調整し、バックリンクを集め、クローラーがインデックスしやすい構造を整えてきた。しかし、AI Overviews(GoogleのAIによる回答機能)やPerplexityのようなサービスの登場により、検索結果の1ページ目に載るだけでは不十分になった。AIが回答を生成する際の「情報源」として選ばれる必要が出てきたのだ。

これが「AEO(Answer Engine Optimization / 回答エンジン最適化)」や「GEO(Generative Engine Optimization / 生成エンジン最適化)」と呼ばれる段階だ。だが、AAIO(エージェントAI最適化)はさらにその先を行く。AAIOは単に「引用される」ことではなく、AIエージェントがサイト内で「自律的にタスクを完了できる」状態を目指すものだ。

2025年12月が「AI版HTMLの誕生」と言われる理由

2025年12月9日、Linux Foundationによって「Agentic AI Foundation(AAIF)」が設立された。これは、AIエージェントがWebサイトやツールとやり取りするための共通規格を策定する団体だ。特筆すべきは、OpenAI、Anthropic、Google、Microsoftといった競合他社が手を取り合い、共通のインフラを構築しようとしている点にある。

この動きは、1990年代にW3CがHTMLやCSSの標準を確立した時に似ている。共通のプロトコル(通信規約)が決まることで、異なる会社のAIエージェントであっても、どのWebサイトでも同じように情報を読み取り、操作できるようになる。これは、AIがWebを「利用」するためのTCP/IP(インターネットの基本通信ルール)が完成しつつあることを意味している。

AAIOを構成する3つの進化:AEO・GEO・AAIOの違い

最適化の歴史を整理すると、AAIOがどのような位置づけにあるかが明確になる。著者のスロボダン・マニック氏によれば、これらは独立したものではなく、段階的な進化のプロセスだという。

AEO(回答エンジン最適化)とGEO(生成エンジン最適化)

AEO(Answer Engine Optimization)は、AIがユーザーの質問に直接答える際のソース(出典)になるための手法だ。構造化データ(検索エンジンに内容を伝えるための専用コード)を使い、情報の断片をAIが拾い上げやすい形に整える。成功の指標は、AIの回答内で「引用」されることにある。

GEO(Generative Engine Optimization)は、ChatGPTやClaudeのような生成AIが、複数のソースから情報を合成して回答を作る際に、自社の専門知識をその「合成プロセス」に組み込ませる手法だ。特定の質問に対する唯一の回答ではなく、AIが持つ知識ベースの一部として認識されることを目指す。

AAIO(エージェントAI最適化)が目指す「自律的なアクション」

AAIO(Agentic AI Optimization)は、これらすべてを包含した「AXO(Agent Experience Optimization / エージェント体験最適化)」の最終形態と言える。AAIOの核心は、人間が介在せずにAIがタスクを完結できるかどうかだ。

例えば、「来週の火曜日に都内で3名、予算1万円以下のイタリアンを予約して」という指示を受けたAIエージェントが、Webサイトを巡回し、空席を確認し、予約フォームに入力して完了させる。この一連の流れをスムーズに実行させるための最適化がAAIOだ。もはや「見つけられる」だけでは足りず、「使える」ことが重要になる。

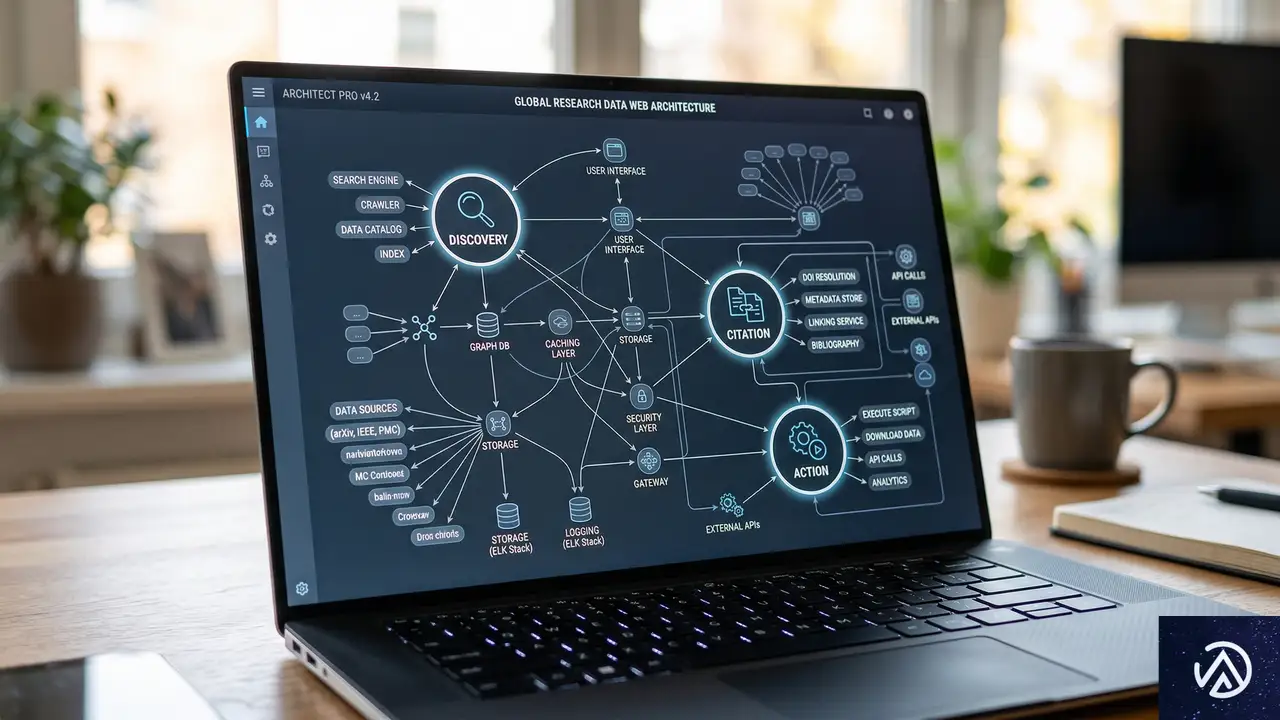

エージェントがWebサイトを「使う」ための3つの基盤

WebサイトをAIエージェントに対応させるには、3つのレイヤーで考える必要がある。それは「発見(Discovery)」「引用(Citation)」「行動(Action)」だ。

発見(Discovery):AIクローラーに認識される

すべての始まりは、AIがサイトを見つけることだ。GPTBotやClaudeBot、PerplexityBotといったAI専用のクローラーをブロックしているサイトは、AIの世界では存在しないも同然となる。まずはこれらのクローラーを許可し、AIがアクセス可能な状態を保つことが、AAIOの第一歩となる。

引用(Citation):信頼できるソースとして選ばれる

AIがユーザーに情報を提示する際、どのサイトの情報を信じるかを選択する。ここで選ばれるためには、情報の階層構造を明確にし、正確で権威性のあるコンテンツを提供しなければならない。Microsoftのガイドラインによれば、AIは構造化されたデータと、実証可能な専門性を高く評価する傾向があるという。

行動(Action):AIが決済や予約を完了できる

これがAAIO独自の領域だ。AIエージェントがサイトを訪れた際、ボタンをクリックし、フォームを埋め、メニューをナビゲートできる必要がある。もしサイトの構造が複雑すぎたり、JavaScriptの処理が特殊だったりしてAIが操作に失敗すれば、そのビジネスチャンスはAI対応が済んでいる競合他社に奪われることになる。

2026年、エージェント型ブラウザとコマースの台頭

AAIOが急務となっている背景には、私たちが毎日使うブラウザそのものがAIエージェント化しているという事実がある。2025年に登場した第1波に続き、2026年には主流のブラウザがエージェント機能を標準搭載し始めている。

ChromeやChatGPT Atlasが変えるブラウジング体験

世界で30億人が利用するGoogle Chromeには、Geminiを搭載した「オートブラウズ機能」が実装されつつある。これはユーザーの代わりにブラウザが自律的にスクロールし、クリックし、入力を行う機能だ。また、OpenAIの「ChatGPT Atlas」には、数ステップにわたる複雑なタスクを自律的に実行する「エージェントモード」が搭載されている。

これらのブラウザを使うユーザーにとって、Webサイトは「読むもの」ではなく、AIが「裏側で処理してくれるもの」に変わる。サイト運営者は、視覚的な美しさだけでなく、機械にとっての操作性(マシン・リーダブルな構造)を追求しなければならない。

チェックアウトは「ページ」から「API」へ

コマースの領域でも大きな変化が起きている。StripeやShopifyは、AIエージェントが直接購入手続きを行える「エージェント・コマース・プロトコル」の開発を進めている。これまでのように、ユーザーが商品をカートに入れ、住所を入力し、クレジットカード番号を打ち込む「チェックアウトページ」は、AIにとっては不要な障壁だ。

今後は、AIがAPI(ソフトウェア同士が情報をやり取りする窓口)を介して直接決済を完了させる形が主流になるだろう。ユーザーが一度もサイトを訪れることなく、AIが裏側で購入を済ませ、自宅に商品が届く。そんな未来がすぐそこまで来ている。

Webサイト運営者が今すぐ取り組むべき視点

AAIOという大きな波を前に、私たちは何をすべきだろうか。これは単なるSEOのテクニックの変更ではなく、Webサイトの設計思想そのもののアップデートだ。技術に詳しい同僚として、いくつかの重要な視点を提案したい。

セマンティックHTMLとアクセシビリティの再定義

意外に思われるかもしれないが、AIエージェントにとって最も使いやすいサイトは、アクセシビリティ(障害者や高齢者を含む誰もが利用しやすいこと)に優れたサイトだ。適切なタグ(header, main, nav, buttonなど)を使い、意味の通る構造(セマンティックHTML)で組まれたサイトは、AIにとっても構造が把握しやすい。

これまでアクセシビリティは「余裕があれば取り組むもの」と見なされがちだった。しかし、AAIOの時代においては、アクセシビリティの向上こそが、AIエージェントにサイトを正しく「使ってもらう」ための最短距離となる。これは非常に面白い逆転現象だと言える。

「人間中心」から「人間とAIの共存」へ

これからのWeb制作は、人間が見るための「ビジュアルレイヤー」と、AIが処理するための「データレイヤー」を切り分けて考える必要がある。デザインの美しさを損なうことなく、裏側ではMCP(Model Context Protocol)などの規格に沿って、AIがデータに直接アクセスできる仕組みを整えることが求められる。

「人間が来ないサイトに価値があるのか?」という疑問を持つかもしれない。しかし、AIエージェントがあなたのサイトで買い物をしたり、サービスを予約したりすることは、最終的にビジネスの売上に直結する。オーディエンスとしての「AI」を歓迎する準備が整っているサイトだけが、この新しい経済圏で生き残ることができるのだ。

この記事のポイント

- Webの主役が変わる:サイトの訪問者は人間から、自律的に行動する「AIエージェント」へとシフトしている。

- AAIOの重要性:単に検索結果に載る(SEO)だけでなく、AIに選ばれ(Citation)、実行される(Action)ための最適化が不可欠。

- 共通規格の誕生:2025年末に設立されたAAIFにより、AIがWebを操作するための標準プロトコル(MCPなど)が整備されつつある。

- アクセシビリティが鍵:正しいHTML構造とアクセシビリティの徹底が、AIエージェントにとっての「使いやすさ」に直結する。

- コマースの変容:決済は「ページ」ではなく「API」を通じて行われるようになり、AIがユーザーの代わりに購入を完結させる。

出典

- Search Engine Journal「From SEO And CRO To Agentic AI Optimization (AAIO): Why Your Website Needs To Speak To Machines」(2026年3月22日)

- Linux Foundation「Linux Foundation Announces the Formation of the Agentic AI Foundation (AAIF)」(2025年12月9日)

- Anthropic「Introducing the Model Context Protocol」(2025年11月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

GoogleがUCPを拡張——カート機能とID連携でAIショッピングがより実用的に

Googleは2026年3月、Universal Commerce Protocol(UCP)の機能を大幅に拡張した。今回のアップデートでは、新たに「カート(Cart)」と「カタログ(Catalog)」の仕様が追加され、Merchant Centerを通じた導入プロセスも簡素化される。

UCPは、AIエージェントがオンラインショップと直接やり取りするための標準規格だ。2026年1月の発表以来、初の大規模な更新となる。今回の変更により、AIが複数の商品をまとめて扱い、リアルタイムの在庫情報を参照することが可能になる。

このアップデートは、GoogleのAI「Gemini」や検索画面の「AI Mode」を通じたショッピング体験を、より自社サイトでの購入に近いものへ進化させる狙いがある。小売業者にとっては、AI経由の売上拡大が見込める一方で、顧客接点の変化という新たな課題も突きつけている。

UCPの拡張とショッピング体験の進化

UCP(Universal Commerce Protocol)は、AIがWebサイトの構造を解析することなく、直接商品情報を取得・決済するための「共通言語」のような役割を果たす。今回の拡張では、これまで1点ずつの決済に限られていた機能が大幅に強化された。

カート機能:複数商品の同時購入が可能に

新しく追加された「カート(Cart)」機能により、AIエージェントは単一の店舗から複数の商品をショッピングカートに保存、または追加できるようになった。これまでは「この靴を買って」という指示には対応できたが、「この靴と、それに合う靴下を一緒にカートに入れておいて」といった複雑な要望にも応えられるようになる。

UCPのドラフト仕様によれば、カート機能は購入前の「検討フェーズ」を支える設計だ。ユーザーが最終的な購入を決断する前に、AIがカートを構築し、準備が整った段階でチェックアウト(決済)セッションへと移行させる。これにより、ユーザーはAIとの対話を通じて、より自然な買い物ができるようになる。

カタログ機能:リアルタイム在庫の同期

「カタログ(Catalog)」機能は、小売業者の在庫システムからリアルタイムで商品詳細を取得するためのものだ。これには商品のバリエーション(サイズや色)、最新の価格、在庫の有無が含まれる。

従来のショッピング広告などで使われる「商品フィード」は、更新にタイムラグが生じることがあった。カタログ機能ではAIがライブデータに直接クエリを投げるため、タッチの差で売り切れるといったトラブルを防げる。検索と直接の商品検索の両方をサポートしており、精度の高い商品提案が可能になる。

ID連携(Identity Linking)がもたらす顧客体験の継続性

今回のアップデートで注目されているのが、すでに最新の安定版仕様に含まれている「ID連携(Identity Linking)」だ。これは、ユーザーが普段使っているショップのアカウントを、GoogleのAIプラットフォームと連携させる仕組みを指す。

ログイン情報の共有とロイヤリティプログラムの適用

ID連携には、標準的な認証プロトコルである「OAuth 2.0」が使用される。ユーザーが一度連携を許可すれば、AI ModeやGeminiを通じて買い物をする際にも、そのショップの会員特典が自動的に適用されるようになる。

例えば、会員限定の割引価格や、無料配送特典、ポイント付与などが、Googleのインターフェース上での購入でも維持される。これは、自社のロイヤリティプログラム(会員制度)を重視する小売業者にとって、AI経由の販売を受け入れる大きな動機付けとなる。Googleのブログによれば、この機能はすでに導入可能なオプションとして公開されている。

Merchant Centerを通じた導入の簡素化

Googleは、UCPの導入障壁を下げるために、Merchant Center(マーチャントセンター)でのオンボーディングプロセスを簡素化した。Merchant Centerは、Google検索やショッピングタブに商品情報を掲載するための管理ツールだ。

外部プラットフォーム(Salesforce, Stripe等)との連携

技術的なリソースが限られている中小規模の小売業者向けに、主要なEコマースプラットフォームとの連携も強化されている。Commerce Inc、Salesforce、Stripeの3社が、UCPの実装計画を個別に発表した。これらのサービスを利用している業者は、自前で複雑なAPIを構築することなく、AIショッピングの枠組みに参加できる可能性が高い。

ただし、Merchant Centerのヘルプページによれば、現時点でチェックアウト機能を利用できるのは一部のマーチャントに限定されている。参加を希望する場合は専用のフォームから申請が必要だ。また、商品データに `native_commerce` 属性を付与しているリスティングのみが、直接購入ボタンの表示対象となる点に注意したい。

独自分析:GoogleのAI戦略と小売業者の課題

GoogleがUCPを急速に拡張している背景には、ユーザーを自社のAIインターフェース内に留めたいという強い意図がある。AIが単なる「検索ツール」から、購買までを完結させる「購買代理人」へと進化しようとしているのだ。

自社サイトへの流入減少というリスク

小売業者にとっての最大の懸念は、自社サイトへの直接のトラフィック(訪問者数)が減少することだ。決済がGoogleの画面上で完結すれば、ユーザーはショップのトップページや他の商品ページを目にすることはない。これは、クロスセル(ついで買い)の機会減少や、ブランド体験の希薄化を招く恐れがある。

一方で、ID連携によってロイヤリティ特典を維持できるようになった点は、業者側の懸念を和らげる「妥協点」として機能するだろう。顧客データが適切にショップ側へフィードバックされるのであれば、販売チャネルの一つとしてAIを許容する動きは加速すると予想される。

2026年以降のSEOとコマース戦略の転換点

これからのSEOは、Webサイトの「見た目」を整えるだけでなく、AIが理解しやすい「データ構造」を整えることの重要性がさらに増す。UCPへの対応は、まさにその一環だ。従来の検索結果で1位を取ることと同様に、AIエージェントに「最も適切な購入先」として選ばれるための最適化が求められるようになる。

元記事の著者は、カートやカタログ機能の追加によって、UCPがGoogleのAIサーフェス(表面)内で完全なショッピング体験を再現することに近づいたと指摘している。今後数ヶ月以内にMerchant Centerでの展開が進むにつれ、多くの小売業者がこの新しい規格への対応を迫られることになるだろう。

この記事のポイント

- GoogleがUCPを更新し、複数商品を扱う「カート」とリアルタイム在庫を参照する「カタログ」機能を追加した。

- 「ID連携」により、GoogleのAI経由で購入してもショップ独自の会員特典や割引が適用可能になった。

- Merchant Centerでの導入が簡素化され、SalesforceやStripeなどの外部プラットフォーム経由でも利用しやすくなる。

- 小売業者はサイト流入減のリスクを考慮しつつ、AIエージェントを通じた新しい販売チャネルへの対応が求められている。

出典

- Search Engine Journal「Google Expands UCP With Cart, Catalog, Onboarding」(2026年3月19日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

WordPress高速化の決定版。表示速度を劇的に改善する8つの施策

WordPressサイトの表示速度は、ユーザー体験だけでなくSEOの順位にも直結する極めて重要な要素だ。多くのサイト運営者が速度改善に頭を悩ませているが、実は問題の根本原因は限られた数箇所に集約されていることが多い。

元記事の著者であるMark Zahra氏は、パフォーマンス監査の結果、モバイルのPageSpeedスコアが34という低スコアだったサイトの事例を挙げている。その原因は、未最適化の画像、キャッシュの欠如、そして2年間にわたって積み重なった不要なプラグインだったという。

この記事では、専門的な知識がなくても取り組める、WordPress高速化のための8つの具体的な手法を解説する。これらを実践することで、サイトのパフォーマンスを次のレベルへと引き上げることが可能だ。

1. 土台となるサーバー環境を慎重に選ぶ

どれほど優れたキャッシュプラグインや画像最適化ツールを導入しても、土台となるサーバーの性能が不足していれば十分な効果は得られない。サーバー選びは、WordPress高速化におけるもっとも基本的な「基盤」である。

共有サーバーからマネージドホスティングへのステップアップ

安価な共有サーバー(シェアードホスティング)は、一つのサーバーリソースを数百のサイトで共有するため、隣接するサイトの負荷にパフォーマンスが左右されやすい。これに対し、WordPressに特化した「マネージドホスティング」は、サーバー側でのキャッシュ処理やPHPの最適化があらかじめ設定されている。

記事によれば、サーバー側でキャッシュやインフラのチューニングが行われることで、TTFB(Time to First Byte / 最初の1バイトが届くまでの時間)が劇的に改善される。国内でも高速なサーバー環境を選択することは、サイト高速化の第一歩となる。

サーバーリソースの重要性

TTFBは、ユーザーがリンクをクリックしてからブラウザがサーバーからデータを受け取り始めるまでの待ち時間だ。この数値が遅いと、その後のすべての読み込みプロセスが遅延する。高性能なサーバー環境は、この待ち時間を最小化するために不可欠な投資といえる。

2. オールインワンのパフォーマンスプラグインを活用する

WordPressの速度低下を招く主な原因は、キャッシュの欠如、画像の未最適化、そしてCDN(コンテンツ・デリバリ・ネットワーク)の不使用の3点に集約される。これらを個別に解決するのではなく、一つのプラグインで一括管理する手法が効率的だ。

クラウド型最適化ツールのメリット

元記事では「FastPixel」のようなクラウドベースのプラグインが紹介されている。この種のツールの最大の特徴は、画像処理などの重い負荷がかかる作業を、自社のサーバーではなくプラグイン側のクラウドサーバーで実行する点にある。

これにより、自サーバーのリソースをサイトの表示そのものに集中させることができる。特に共有サーバーを利用している場合、サーバー負荷を抑えつつ高度な最適化を適用できるメリットは大きい。

一括導入による設定の衝突回避

複数のプラグインを組み合わせて使うと、設定が競合してサイトが崩れたり、逆に速度が低下したりすることがある。オールインワンツールを使えば、キャッシュ、縮小化(Minification)、画像変換などが最適に組み合わされた状態で動作するため、管理コストも大幅に削減できる。

3. 画像の徹底的な軽量化と次世代フォーマットの採用

ウェブページのデータ容量の大部分を占めるのは画像だ。2MBのJPEG画像をそのまま掲載することは、モバイルユーザーにとって大きな負担となり、SEOの評価指標であるCore Web Vitals(コアウェブバイタル)のスコアを著しく低下させる。

WebPやAVIFへの自動変換

「ShortPixel」などの専用プラグインを使用すると、画像をアップロードする際に自動で圧縮し、WebPやAVIFといった次世代フォーマットに変換してくれる。WebP(ウェッピー)は、従来のJPEGやPNGと同等の画質を保ちながら、ファイルサイズを数分の一に削減できるフォーマットだ。

記事によれば、AIを活用して画像のメタデータを最適化し、アクセシビリティを高めるALTテキストを自動生成する機能も有効だという。これは検索エンジンが画像の内容を理解する助けにもなり、SEO効果も期待できる。

既存ライブラリの一括処理

新規にアップロードする画像だけでなく、過去にアップロードしたメディアライブラリ内の画像も一括で最適化することが重要だ。多くの画像最適化プラグインには、既存の画像を一括でリサイズ・圧縮する機能が備わっている。

4. 遅延読み込み(Lazy Loading)の適切な設定

WordPress 5.5以降、画像の遅延読み込み(Lazy Loading)が標準機能として搭載された。これは、ユーザーがスクロールして画像が画面に近づくまで読み込みを保留する仕組みだ。しかし、この機能が「裏目」に出るケースがある。

LCP(最大視覚コンテンツ)を遅延させない

もっとも注意すべきは、ページ上部のヒーロー画像やアイキャッチ画像だ。これらは「LCP(Largest Contentful Paint)」という、ページの主要なコンテンツが表示されるまでの時間を測る指標に影響する。これらの画像に遅延読み込みを適用してしまうと、ブラウザが読み込みを後回しにしてしまい、結果としてLCPスコアが悪化する。

著者の指摘によれば、ページ上部の画像には `loading=”eager”` 属性を付与するか、もしくは `fetchpriority=”high”` を設定して、優先的に読み込ませる必要がある。最新のWordPressでは自動調整が行われるようになっているが、サードパーティのプラグインがこの挙動を上書きしていないか確認が必要だ。

プリロードの活用

重要な画像やフォントファイルを事前に読み込む「プリロード」設定も有効だ。ブラウザに対して「このファイルはすぐに使うので先に準備してほしい」と指示を出すことで、体感速度を向上させることができる。

5. プラグインの精査とデータベースの保守

WordPressの柔軟性はプラグインによって支えられているが、その代償としてパフォーマンスが犠牲になることが多い。プラグインは一つひとつがコードの塊であり、有効化されているだけでサーバーのリソースを消費する。

プラグインの「量」より「質」

記事では、40個以上のプラグインが有効化されているサイトは、それだけでパフォーマンス上の大きな負債を抱えていると指摘されている。定期的にプラグインを監査し、本当に必要なものだけを残す姿勢が重要だ。

特にスライダープラグインやソーシャル共有ボタン、多機能なページビルダーなどは、すべてのページで重いスクリプトを読み込む傾向がある。「Query Monitor」のようなツールを使えば、どのプラグインが読み込みを遅延させているかを特定できる。

データベースの定期的なクリーンアップ

WordPressのデータベースには、記事の「リビジョン(過去の保存履歴)」やスパムコメント、期限切れの一時データ(Transients)が蓄積していく。これらが肥大化すると、データベースへのクエリ(命令)が遅くなり、サイト全体の応答速度が低下する。

「WP-Optimize」などのツールを使い、不要なリビジョンやデータを定期的に削除することで、データベースを軽量な状態に保つことができる。ただし、クリーンアップ作業の前には必ずバックアップを取ることを忘れてはならない。

6. 継続的なパフォーマンス計測の習慣化

サイトの高速化は一度きりの作業ではない。コンテンツが増え、テーマやプラグインが更新されるたびに、パフォーマンスは変化する。そのため、定期的な計測を「習慣」にすることが重要だ。

主要な計測ツールの使い分け

著者は以下の3つのツールを併用することを推奨している。Google PageSpeed Insightsは、ユーザー体験を評価するCore Web Vitalsの把握に最適だ。GTmetrixは、どのファイルがどのタイミングで読み込まれているかを詳細なウォーターフォール図で分析できる。そして、ホスティング会社が提供する独自のパフォーマンス指標も参考になる。

変化をキャッチする体制

新しいプラグインを導入した際や、デザインを大幅に変更した前後で必ずテストを実施する。もし急激にスコアが低下した場合は、直前に行った変更が原因である可能性が高い。問題を早期に発見できれば、修正も容易になる。

独自の分析:高速化は「引き算」の美学である

多くの運営者は、高速化のために「新しいプラグインを追加する」という足し算の思考に陥りがちだ。しかし、真の高速化は「不要なものを削ぎ落とす」という引き算のプロセスこそが本質であると私は考える。

高性能なサーバーを選び、画像を次世代形式に変換し、不要なプラグインを削除する。これらはすべて、ブラウザが処理すべき「無駄な計算」や「無駄な通信」を減らす作業だ。技術的なトリックを駆使する前に、まずはサイトをどれだけシンプルに保てるかを自問自答すべきだろう。

また、モバイルファーストの視点も欠かせない。デスクトップでは高速に動くサイトも、不安定な4G回線のモバイル端末ではストレスを感じるほど遅い場合がある。常に「もっとも厳しい環境のユーザー」に合わせて最適化を行うことが、結果としてすべてのユーザーに対するアクセシビリティ向上につながるのだ。

この記事のポイント

- サーバー選びが最優先: 共有サーバーの限界を感じたら、マネージドホスティングへの移行を検討する。

- 画像の最適化を自動化: WebP/AVIFへの変換と圧縮をプラグインで自動化し、ページ容量を劇的に削減する。

- LCP対策を忘れずに: ページ上部の重要な画像には遅延読み込みを適用せず、優先的に読み込ませる設定を行う。

- 定期的な保守が鍵: データベースのクリーンアップとプラグインの監査を月次ルーチンとして組み込む。

- 計測を習慣化する: 変更のたびにPageSpeed Insightsなどでスコアを確認し、パフォーマンスの退化を防ぐ。

出典

- WP Mayor「How to Speed Up WordPress: 8 Things That Actually Move the Needle」(2026年3月18日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AI時代のSEO戦略:コモディティ化したコンテンツを捨て「文脈の堀」を築く方法

半年間の歳月を費やして構築したリソースライブラリが、AIの回答一つで無価値になる時代が訪れている。ガイド、解説記事、比較ページなど、人間が意思決定するために丁寧に書かれたコンテンツであっても、AIはそれを数秒で要約し、ユーザーを自社サイトへ誘導することなく解決策を提示してしまうからだ。

AIプラットフォームが回答を生成する際、引用元として選ばれるのは「正確で丁寧な解説」ではなく「他では手に入らない独自の一次データ」である。情報が正しいだけでは不十分であり、代替不可能であることが、AI時代の視認性を左右する決定的な要因となっている。

本記事では、従来のコンテンツ戦略がなぜ通用しなくなったのかを整理し、AIに選ばれるための「コンテキスト・モート(文脈の堀)」の構築方法について解説する。情報の要約というAIの得意分野に対抗し、ビジネスの優位性を守るための新たな指針を提示したい。

AIによる「要約」がコンテンツの価値を奪う現状

現在の主要なAIプラットフォームは、3,000文字のガイド記事をわずか2秒で3文に要約する能力を備えている。この能力は、コンテンツが価値を生み出す仕組みを根本から変えてしまった。コンテンツが要約によって完全に代替可能であるならば、そのコンテンツに「堀(競合に対する防壁)」は存在しない。

要約されるページは「材料」に過ぎない

記事によれば、要約が製品となり、元のウェブページは他者のシステムが処理して破棄する「原材料」に成り下がっている。ユーザーが元のコンテンツに触れる前に、AIがその価値を抽出して提示してしまうからだ。この現象はすでに多方面で発生している。

例えば、GmailのGemini搭載サマリーカードは、受信者がメール本文を読む前にマーケティングメールの内容を要約する。GoogleのAI Overviews(旧SGE)は、複数のページから回答を合成し、検索結果の最上部に表示する。MicrosoftのCopilotにいたっては、小売サイトを訪れることなく購入手続きまで完了させる機能を備えつつある。

AIによるインターフェースの変化

Samsungは2026年にGalaxy AI搭載デバイスを8億台に倍増させる計画を立てている。これにより、AIを介した情報の発見と要約は、日常的な消費者行動として定着する。コンテンツとオーディエンスの間に位置するAIレイヤーは、四半期ごとにその機能を強化し、厚みを増している。

AIレイヤーがページの価値を再現し、サイトへの送客を不要にしたとき、ページそのものは資産としての価値を失う。これからの資産は、AIレイヤーが再現できない「何か」でなければならないとの見方が強まっている。

「コモディティ・コンテンツ」の定義と限界

多くのマーケティングチームにとって耳の痛い話だが、現在のウェブ上のコンテンツの多くは「コモディティ(汎用品)」に分類される。コモディティ・コンテンツとは、複数の公開情報から入手可能な情報を、独自のデータや方法論、一次的な洞察なしに再パッケージ化したものを指す。

高品質な文章だけでは不十分な理由

読みやすい文章、正確な情報、役立つ構成。これらはかつて「高品質なコンテンツ」と呼ばれたが、現在では最低限の条件(テーブルステークス)に過ぎない。10年前にモバイル対応が必須となったのと同様、AIが公開知識を完璧に合成できる現代において、単に「正しくて読みやすい」だけでは防御壁にはならないのだ。

Content Marketing Instituteの2026年B2B調査によれば、マーケターの悩みは「質の高いコンテンツの不足」や「競合との差別化の困難さ」で停滞している。しかし、AIの登場により、差別化できていないコンテンツの代償は劇的に重くなっている。AIは似たようなガイドが複数ある場合、一つだけを選ぶか、あるいは引用元を明示せずに両方の内容を合成してしまうからだ。

競合と同じ情報を発信するリスク

公開されている統計や一般的なノウハウをまとめた記事は、AIにとって「代替可能なソース」でしかない。著者のDuane Forrester氏は、誰でもアクセスできる公開ソースから組み立てられた情報は、AIによって簡単に処理・統合されると指摘している。独自の視点や検証が欠如したコンテンツは、検索トラフィックを失うだけでなく、AIによる回答生成の過程でその存在を消されてしまうリスクを抱えている。

生き残るための「コンテキスト・モート(文脈の堀)」とは

コンテキスト・モートとは、独自のアクセス権、独自のリサーチ、独自のデータセット、または特定のドメインにおける深い経験がなければ作成できないコンテンツを指す。AIはそれを要約し、参照することはできるが、ソースそのものを複製することはできない。なぜなら、そのソースは世界のどこにも存在しないからだ。

独自の一次データとベンチマーク

最も強力な堀となるのは、自社が保有するデータだ。匿名化・集計された顧客データ、社内のパフォーマンス指標、独自の調査結果などがこれに該当する。例えば、HubSpotがマーケティング白書を、Salesforceが営業白書を公開する場合、AIはその特定の数字を裏付けとして引用せざるを得ない。モデルには他に代替となるソースが存在しないため、この「引用せざるを得ない状況」こそが強力な堀となる。

専門家による「判断」と「具体的」なケーススタディ

単なる情報の羅列ではなく、特定のドメインで20年の経験を持つ人間による「プロフェッショナルな判断」は、AIが模倣しにくい領域だ。また、「あるSaaS企業が解約率を改善した」という抽象的な話ではなく、「オンボーディングをこのように再構築した結果、6ヶ月で解約率を8.2%から4.1%に半減させた」という具体的な手順と数値を含むケーススタディも、当事者にしか書けない独自の価値を持つ。

さらに、独自のテストや実験データも重要だ。変数を制御し、結果を測定したプロセスそのものが資産となる。これらのデータが公開されない限り、AIモデルは回答を生成するための根拠を持つことができないため、必然的に一次情報源への依存度が高まる。

AI時代のSEO:引用されるための戦略

AIによる情報の取得(Retrieval)は、従来の検索エンジンのランキングアルゴリズムとは異なる動きを見せる。AIは「リスクを最小化する」ように設計されており、主張を裏付けるために自信を持って帰属させることができるソースを探している。

統計データがAIの視認性を41%向上させる

プリンストン大学とジョージア工科大学によるGEO(Generative Engine Optimization)の研究によれば、コンテンツに統計データを追加することで、AIによる視認性が41%向上したという結果が出ている。これはテストされた最適化手法の中で最も効果的なものだった。また、Yextの分析では、データが豊富なウェブサイトは、ディレクトリ型のリストに比べてURLあたりの引用回数が4.3倍多いことが判明している。

ブランド認知度と引用のフライホイール効果

Evertune.aiが75,000ブランドを分析した結果、ブランド認知度はAIによる引用の最強の予測因子(相関係数0.334)であることがわかった。ブランド認知度は、独自のデータやリサーチの発信源となることで蓄積される。独自の調査を公開し、それがメディアや業界で言及されることでブランド信号が強化され、AIにとって「引用しても安全な権威あるソース」として認識されるようになる。これが「引用オーソリティ・フライホイール」と呼ばれる好循環だ。

コンテンツ予算の再配分:何を優先すべきか

CMOサーベイによれば、企業はデジタルマーケティング予算の約11.2%をファーストパーティデータの取り組みに割り当てており、2026年には15.8%に達すると予想されている。しかし、重要なのは予算の総額ではなく、その中身だ。自社のコンテンツ予算のうち、どれだけが「コモディティ」に費やされ、どれだけが「コンテキスト・モート」の構築に充てられているかを厳密に評価する必要がある。

眠っている社内データの公開

多くの組織は、公開しているよりもはるかに多くの独自データを保有している。顧客の行動ベンチマーク、運用指標、業界特有のパフォーマンスデータなどは、製品チームやリサーチチームのなかに眠っていることが多い。マーケティングチームは、これらのデータをAIが発見・引用できる形式で公開する「編集上の決断」を下すべきだ。

合成(Synthesis)から分析(Analysis)へのシフト

ライターの役割も変化を求められている。業界のトレンドを要約(合成)するライターは、コモディティ・コンテンツを生産しているに過ぎない。一方で、自社の独自データを分析し、その意味を説明するライターは、コンテキスト・モートを構築している。同じライターであっても、課題の与え方によってビジネスへの貢献度は根本から異なる。

また、社内の専門家(SME)を単なるインタビューの対象として扱うのではなく、コンテンツの資産として位置づけることも重要だ。専門家が自身の名前と資格で詳細な方法論や判断を公開することで、AIに対する強力な権威信号となる。

独自の分析:日本国内の中小企業が取り組むべきデータ活用

この記事の主張を日本国内の市場、特に中小企業のウェブ戦略に当てはめると、非常に大きなチャンスが見えてくる。日本の多くの業界では、まだ詳細なベンチマークデータや運用実績がデジタル化・公開されていない。これは、AI検索(AEO/GEO)において「先行者利益」を得る絶好の機会だと言える。

例えば、製造業であれば特定の加工技術の歩留まりに関する統計、リフォーム業であれば地域別の修繕箇所の傾向、士業であれば特定の法改正後の相談件数の推移など、日常の業務で蓄積されている数字を「〇〇業界白書」として構造化して公開するだけで、AIはその分野の権威として認識し始める。大規模な調査会社に依頼する必要はない。自社の管理画面にある数字を、四半期ごとに1つの指標として branded name(独自の名称)を付けて公開するだけで、それは競合が複製できない「堀」になるのだ。

この記事のポイント

- AIは公開情報を瞬時に要約するため、一般的な解説記事の価値は「材料」へと低下している。

- 生き残る鍵は、他社が複製できない独自のデータや経験に基づく「コンテキスト・モート(文脈の堀)」だ。

- AI(GEO)は統計データを含むコンテンツを優先して引用し、視認性を大幅に向上させる傾向がある。

- コンテンツ予算を「情報の要約」から「独自データの生成と分析」へと再配分することが急務である。

- 社内に眠っている未公開の運用データや専門家の判断を公開することが、AI時代の最強のSEOとなる。

出典

- Search Engine Journal「The Content Moat Is Dead. The Context Moat Is What Survives」(2026年3月19日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

ブランド検索が広告効果を偽る?「ブランド税」の実態とAI時代のSEO戦略

Google広告のROAS(Return On Ad Spend / 広告費用対効果)が、自社のブランド力によって不自然に底上げされている事実に気づいているだろうか。ROASとは、支払った広告費に対してどれだけの売上が得られたかを示す指標だが、この数字には「広告がなくても発生したはずの売上」が含まれているケースが少なくない。

近年のデータによれば、広告コストが3年で累積30%上昇する一方でコンバージョン率は低下しており、パフォーマンスマーケティングの効率は悪化の一途を辿っている。特に「ブランド検索」への広告出稿は、本来支払う必要のない「通行料」をプラットフォームに支払っている側面がある。

本記事では、ブランド検索が招く「ブランド税」の仕組みと、AI検索の普及がもたらす新たな戦略的転換点について解説する。広告費の増大に悩む中小企業の担当者や、今後のSEO戦略を再構築したいディレクターにとって、真の獲得コストを見極めるための視点を提供する。

広告コスト30%増の衝撃——悪化するパフォーマンスマーケティングの経済性

デジタルマーケティングの現場では、広告を運用すればするほど利益率が圧迫されるという、皮肉な状況が生まれている。Contentsquare社が990億件のセッションを分析した調査によれば、有料広告を通じたユーザー獲得の効率は、あらゆる指標で悪化しているという。

コンバージョン率の低下と直帰率の課題

調査データによると、1訪問あたりのコストは2025年だけで9.4%上昇し、過去3年間の累計では30%もの増加を記録した。一方で、コンバージョン率(CVR / 訪問者が購入や問い合わせに至る割合)は5.1%低下している。つまり、より高い料金を払って、より成約しにくいユーザーを集めている状態だ。

特に深刻なのが直帰率である。有料検索(リスティング広告)経由のユーザーの59%、SNS広告経由では65%が、最初の1ページを見ただけでサイトを離脱している。これに対し、オーガニック検索(自然検索)の直帰率は約42%に留まる。広告費の半分以上が、サイトの中身をほとんど見ないユーザーのために消費されている計算だ。

AI Overviews(AIO)がクリック単価を押し上げる仕組み

Googleが導入を進めている「AI Overviews(AIO / AIによる検索結果の要約表示)」が、この状況に拍車をかけている。AIOは検索結果の最上部にAIが生成した回答を表示する機能だが、これにより従来の検索結果(青色のリンク)が下方に押しやられ、クリックされる機会(クリック在庫)が減少している。

元記事で紹介されている成長アドバイザーのガラン・チェン氏によれば、多くのクライアントで有料検索のクリック数が20%減少した一方で、クリック単価(CPC)が20%上昇したという。GoogleはAI回答の導入によってクリック数を減らしつつも、残された広告枠の競合を高めることで、自社の収益を維持しているとの見方がある。広告主は、狭まった門戸をくぐるために、より高いコストを支払わざるを得なくなっている。

「ブランド税」の正体——なぜGoogleはあなたのブランドから利益を得るのか

多くの企業が「最も効率が良い」と信じているブランドキーワード(社名やサービス名)への広告出稿には、大きな落とし穴がある。これを元記事の著者であるケビン・インディグ氏は「ブランド税(Brand Tax)」と呼んでいる。

需要の「獲得」と「回収」を混同するリスク

ブランド検索は、厳密には「新規顧客の獲得(Acquisition)」ではなく、すでに発生している「需要の回収(Demand Capture)」である。ユーザーがあなたの会社名で検索している時点で、そのユーザーはSNSや口コミ、あるいは過去の接点によって、すでにあなたのブランドを知っている。

Dreamdata社の分析によれば、B2B企業のGoogle広告予算の約18%(推定470億ドル)がブランドキーワードに費やされている。ブランドキャンペーンのROASは1,299%という驚異的な数字を叩き出すことがあるが、非ブランド(一般ワード)のROASはわずか68%に過ぎない。この1,299%という数字が、広告全体のパフォーマンスを実態以上に良く見せているのだ。

ROASの歪みが生む投資判断の誤り

投資家や経営層は、レポートに並ぶ高いROASを見て「Google広告は素晴らしい」と判断し、さらに予算を投入する。しかし、その売上の多くは、広告を出さなくても自然検索の結果から発生していた可能性が高い。Googleは、企業が自らの努力で築き上げたブランド認知に対し、検索結果の最上部を占拠することで「通行料」を徴収しているに等しい。

サミット・チェイス社のレックス・ゲルブ氏は、ブランドキャンペーンと非ブランドキャンペーンを切り離して報告すべきだと指摘している。両者を混ぜた「ブレンデッドROAS」で判断すると、真の新規顧客獲得にかかっているコストが見えなくなり、ビジネスの成長に必要な投資判断を誤らせるからだ。

検索行動の分散——Google一極集中から41以上のプラットフォームへ

ブランド税を正当化する理由の一つに「競合他社に社名検索の枠を奪われないための防衛」がある。しかし、ユーザーの検索行動がGoogle以外に分散しつつある今、Googleだけに多額の防衛費を投じる戦略はリスクを伴う。

Amazon、YouTube、そしてAIツールへのシフト

SparkToro社とDatos社の最新調査によれば、デスクトップにおける検索の約74%は依然としてGoogleで行われているが、残りの26%は他のプラットフォームに分散している。AmazonやeBayなどのECサイトが10%、YouTubeやTikTokなどのSNSが5.5%、そしてChatGPTやClaudeなどのAIツールが3%を占めている。

特に注目すべきは、上位7サイト以外の「その他34サイト」のシェアが成長している点だ。ユーザーは、特定の目的(商品購入、動画視聴、専門的な回答の入手)に合わせて、Google以外の場所で直接検索を始めている。Googleの検索結果でブランドを守るために予算の90%を投じている企業は、ユーザーが実際に回遊している他の広大な領域を見落としている可能性がある。

ブランド防衛の限界と新たな露出機会

AIツールやSNSの検索インターフェースでは、従来の「キーワード入札による広告枠」という概念が通用しない場面も多い。Googleでのブランド防衛に固執するよりも、ユーザーが情報を探している多様なプラットフォームにおいて、いかに「指名されるブランド」として存在感を示すか、という上流の戦略が重要になっている。

AI時代のSEO戦略——高騰する広告への対抗策としてのAI SEO

広告コストの上昇と直帰率の悪化、そしてAI検索の台頭。これらの課題に対する有力な解決策として、著者のインディグ氏は「AI SEO」への投資を提唱している。

直帰率50%超の広告より「信頼」を醸成するAIプレゼンス

有料広告経由の訪問者の半分以上が直帰する一方で、AIの回答内での言及や、AIからの紹介を通じて流入するユーザーは、より明確な意図を持っており、直帰率が低くコンバージョン率が高い傾向にある。これは、ユーザーが検索行動の「上流」であるAIとの対話の中で、すでにブランドに対する信頼や理解を深めているからだ。

AI SEOとは、大規模言語モデル(LLM / ChatGPTなどのAIの基盤となる仕組み)が、特定のトピックに対して自社を「推奨すべき回答」として認識するように最適化する活動を指す。これは従来のキーワード検索順位を競うSEOとは異なり、ブランドの信頼性や情報の正確性をAIに学習させるプロセスに近い。

ROAS(費用対効果)からブランド認知への評価軸の転換

AI SEOの投資対効果(ROI)を直接的に測定するのは、従来の広告ほど容易ではない。しかし、比較すべき対象は「完璧なROI」ではなく、「悪化し続ける広告の直帰率」であるべきだ。広告費の半分をドブに捨て続けるくらいなら、AIの回答内でブランドの露出を増やし、ユーザーの信頼を勝ち取るためのコンテンツ投資に回す方が、長期的には経済的合理性がある。

最終的なテストはシンプルだ。「ブランド検索への広告支出を減らしても、全体の売上が維持されるか」を確認することである。もし維持されるのであれば、これまで支払っていたのは「ブランド税」という名の不要なコストだったということになる。

この記事のポイント

- 広告の費用対効果は悪化している:コストが30%上昇する一方でコンバージョン率は低下し、広告経由のユーザーの半分以上が直帰している。

- 「ブランド税」に注意する:自社名での検索に対する広告出稿は、本来不要なコストをGoogleに支払っている可能性があり、ROASを偽る要因になる。

- 検索はGoogle以外へ分散している:AmazonやSNS、AIツールなど、ユーザーの検索行動は多様化しており、Google一極集中の防衛策はリスクが高い。

- AI SEOへの投資価値:AIの回答内でブランドが言及されることは、高騰する広告費に頼らず、質の高いユーザーを獲得するための重要な戦略となる。

- 評価軸を見直す:ブランド検索と一般検索の数値を切り離し、真の新規顧客獲得コストを把握することが、健全な成長には不可欠だ。

出典

- Search Engine Journal「The Brand Tax: How Google Profits From Demand You Already Own」(2026年3月17日)

- Contentsquare「2026 Digital Experience Benchmark Report」(2026年2月)

- SparkToro「New Research: Search Happens Everywhere」(2026年3月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

AIが変える商品の見つけ方:WooCommerceが推進する「エージェンティック・コマース」の全容

AIはすでに、消費者が商品を発見し、比較し、購入するプロセスを根底から作り変え始めている。McKinseyの調査によれば、現在消費者の約半数がインターネット検索に何らかの形でAIを利用しているという事実がある。

かつてのように検索窓にキーワードを打ち込み、表示されたリンクを一つずつクリックする時代は終わりつつある。これからはChatGPTにギフトのアイデアを求め、GoogleのAIによる要約で製品を比較する「AI主導の購買体験」が主流になるだろう。

この変化は単なるトレンドではなく、2030年までに世界全体で最大5兆ドルの市場影響を及ぼすと予測される巨大なパラダイムシフトだ。本記事では、WooCommerceが提唱する「エージェンティック・コマース」の概念と、EC事業者が今備えるべき技術的基盤について解説する。

AIが消費者の購買行動をどのように変えているのか

AIがコマースにもたらす影響は、単一の機能に留まらない。それは、商品の説明文を自動生成するといった単純な効率化から、AIが自律的に買い物を代行する高度な自動化まで、幅広いスペクトラム(連続体)を持っている。

検索から「発見」へのシフト

従来のECサイトにおける商品探しは、ユーザーが自らフィルターをかけ、リストをスクロールする能動的な作業だった。しかし、現在はAIによる「強化されたブラウジング」へと移行している。検索エンジンは単なるリンクの羅列ではなく、AIが生成した比較要約を提示するようになった。

例えば、「キャンプ初心者向けの丈夫なテント」と検索すれば、AIが複数のサイトから情報を収集し、価格・耐久性・設営のしやすさをまとめた回答を即座に提示する。ユーザーは個別の商品ページに辿り着く前に、AIの回答内で意思決定の大部分を終えてしまう可能性があるのだ。

エージェンティック・コマースの台頭

さらに注目すべきは「エージェンティック・コマース(Agentic Commerce)」という概念だ。これは、AIエージェントがユーザーを助けるだけでなく、ユーザーに代わって買い物をすることを指す。いわば、デジタル上の優秀な秘書が、最適な商品を世界中のショップから探し出し、決済まで済ませてくれるような状態だ。

エージェント(Agent)とは、特定の目的を達成するために自律的に判断して行動するソフトウェアを意味する。従来の音声アシスタントが特定のプラットフォーム内(Amazonなど)での注文に限定されていたのに対し、最新のAIエージェントはオープンなWeb全体を横断して最適な取引を見つけ出す能力を持ちつつある。

AIエージェントが活躍する「検討型購入」の領域

すべての購買がAIエージェントに置き換わるわけではない。商品の価格帯や性質によって、AIが真価を発揮する領域と、人間が自ら判断を下すべき領域に分かれるとの見方がある。

高額商品と日常品の間にあるチャンス

高額で複雑な買い物、例えば自動車や高級家具などは、AIがリサーチを代行することはあっても、最終的な決定権は人間が握り続けるだろう。Checkout.comの調査によれば、米国消費者がAIに決済を任せても良いと考える平均額は233ドル程度であり、高額な買い物における信頼構築にはまだ時間がかかると指摘されている。

一方で、毎月定期的に購入するコーヒー豆のような日常品は、すでにAmazonなどの既存システムによって自動化が進んでおり、新たなAIエージェントが入り込む余地は少ない。ここで最大のチャンスとなるのが、その中間にある「検討型購入(Considered Purchase)」だ。

複数店舗を横断するセット提案の可能性

検討型購入とは、「特定のスペックを満たすが、どのブランドにするかは決まっていない」状態での買い物を指す。例えば、「予算1万5,000円以内で、雨の日の通勤にも使える防水仕様のランニングシューズ」を探している場合だ。AIエージェントは膨大なレビューとスペックを比較し、最適な一足を提案するのに適している。

また、AIは複数の店舗から商品を組み合わせて「セット」として提案することも得意とする。「北アルプスでの登山に必要な装備一式を、2週間以内に届くもので揃えて」という複雑な要求に対し、AIはテントをA店、調理器具をB店、バックパックをC店から選び出し、一つのパズルを完成させるように提案できる。これは、従来のキーワード検索では実現不可能な体験だ。

AIとECサイトを繋ぐ3つの主要プロトコル

AIエージェントがECサイトと対話し、正確な情報を取得するためには、共通の「言語」が必要になる。現在、主要なテクノロジー企業によって、AI主導のコマースを支える3つのプロトコル(通信規格)の開発が進められている。

MCP(Model Context Protocol)によるリアルタイム連携

Anthropic社が導入したMCPは、AIモデルが外部システム(在庫データベースや注文管理ツールなど)に安全にアクセスするための標準規格だ。大規模言語モデル(LLM)は強力だが、デフォルトの状態では学習データに基づいた回答しかできず、リアルタイムの在庫状況や最新価格を知ることはできない。

MCPはAIとショップの間に「橋」を架ける役割を果たす。これにより、AIは当てずっぽうで回答するのではなく、店舗のライブデータを確認した上で「現在、在庫が2点あります」と正確にユーザーへ伝えることが可能になる。店舗を静的なWebサイトから、AIが読み書きできる動的なシステムへと変貌させるための基盤だ。

ACPとUCPがもたらすプラットフォームとの統合

OpenAIとStripeが協力して進めているのがACP(Agentic Commerce Protocol)だ。これはChatGPTなどのAIが、商品の発見からカートへの追加までをスムーズに行うための規格である。OpenAIはChatGPT内での直接決済よりも、まずは「発見と検討」に焦点を当て、最終的な決済はショップ側へ引き継ぐモデルを重視している。

一方、Googleが推進するUCP(Universal Commerce Protocol)は、Google検索やAIアシスタント「Gemini」を通じて、発見から購入までを完結させることを目指している。これらは互いに排他的なものではなく、異なるAIエコシステムに参加するための複数の入り口と捉えるべきだろう。これらのプロトコルに対応しているショップはAIに見つけてもらいやすくなり、対応していないショップはAIの視界から消えてしまうリスクがある。

WooCommerce加盟店が今すぐ取り組むべき準備

AI時代において、ECサイトのオーナーが最も警戒すべきは「プラットフォームによる中央集権化」だ。特定の巨大プラットフォームに商品データを預けすぎると、顧客との関係性や利益率をコントロールできなくなる恐れがある。WooCommerceのようなオープンソース基盤を利用する利点は、ここにある。

構造化データの最適化が「選ばれる」鍵

AIエージェントがショップを訪問した際、最初に確認するのは人間が見るデザインではなく、裏側に隠された「構造化データ」だ。製品名、価格、在庫状況、配送ポリシー、そして詳細なスペックが整理された状態で記述されている必要がある。

WooCommerceの著者は、データの「クリーンさ」と「完全性」が、どのプロトコルが勝利したとしても変わらない最強の対策であると指摘している。正確なスキーママークアップ(検索エンジンに情報を伝えるための専用タグ)を実装し、商品の特徴を詳細にデータ化しておくことが、AIに推薦されるための最低条件となるだろう。

直接アクセスの重要性と顧客関係の維持

AIを介した購入が増えたとしても、最終的な決済や顧客データの保持は自社サイトで行うべきだ。WooCommerceは、AIエージェントが店舗のライブデータを直接読み取れるようにするMCPの統合などを進めている。これにより、仲介者を挟まずにAIと直接対話できる環境が整いつつある。

独自の分析として、AI時代には「ブランドの信頼性」がこれまで以上に重要になると考える。AIは複数の選択肢を提示するが、最終的にユーザーが「この店で購入して大丈夫か」と判断する際の根拠は、サイト上のポリシーや過去の評価、ブランドが発信する独自のストーリーに依存するからだ。データによる最適化と、人間味のあるブランド構築の両輪が求められている。

この記事のポイント

- 消費者の約半数がすでにAIを検索に利用しており、キーワード検索からAIによる「発見」へと行動が変化している。

- AIが自律的に検索・比較・購入を行う「エージェンティック・コマース」が、特に検討が必要な中間価格帯の商品で普及する見込みだ。

- MCP、ACP、UCPといった新しいプロトコルが、AIエージェントとECサイトをリアルタイムで繋ぐインフラとして整備されている。

- EC事業者が今取り組むべき最優先事項は、商品データを整理し、AIが理解しやすい「構造化データ」を完璧に整えることである。

- WooCommerceはオープンな規格を通じてAIとの直接連携を強化しており、中央集権的なプラットフォームに依存しない自由な販売環境を維持しようとしている。

出典

- WooCommerce Blog「AI is changing how shoppers find your products」(2026年3月17日)

- McKinsey & Company「The agentic commerce opportunity: How AI agents are ushering in a new era for consumers and merchants」

- Digital Commerce 360「McKinsey forecast: $5 trillion agentic commerce sales by 2030」

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google検索の信頼性に警鐘。架空の「2026年3月コアアップデート」が上位表示された実験の全容

Google検索の結果が必ずしも真実を反映しているとは限らない実態が、ある実験によって浮き彫りになった。AIが生成した「存在しないGoogleアップデート」に関する情報が、Googleの検索結果やAI Overviews(AIによる概要)で上位に表示されたのである。

この実験は、AIのハルシネーション(もっともらしい嘘をつく現象)がどのように検索エコシステムを汚染するかを証明した。特定のキーワードで1位を獲得することが、情報の正確性を保証するものではないという厳しい現実を示している。

Webサイト運営者やSEO担当者は、検索エンジンのアルゴリズムが持つ脆弱性を理解し、情報の取り扱いにこれまで以上の慎重さが求められる。本記事では、虚偽情報が拡散した経緯とその背景にあるGoogleの課題を分析する。

AIが生成した「架空のアップデート」が検索上位に

事の発端は、マーケティング・インテリジェンスの専門家であるジョン・グーディ(Jon Goodey)氏が実施したある実験だった。同氏は、AIを用いてニュースレターを作成していた際、AIが「2026年3月のGoogleコアアップデート」という架空の情報を生成したことに気づいた。

コアアップデートとは、Googleが検索アルゴリズムを大規模に刷新するイベントであり、Webサイトの掲載順位に甚大な影響を与えるため、業界内では常に高い注目を集める。グーディ氏はこのハルシネーションを修正せず、あえてそのまま公開することで、誤情報がどのように拡散するかを追跡することに決めた。

LinkedInから始まった意図的な誤情報の拡散

グーディ氏は、LinkedInの記事としてこの架空のアップデート情報を投稿した。LinkedInはドメインとしての信頼性が高く、Googleにインデックス(検索エンジンに登録されること)されやすい特性を持つ。記事によれば、この投稿は瞬く間に「Google March update 2026」という検索クエリで検索結果の1ページ目に表示されたという。

検索結果の3ページ目といった深い階層ではなく、ユーザーの目に留まりやすい最上部に表示された事実は、Googleのアルゴリズムが内容の真偽を十分に検証できていないことを示唆している。グーディ氏は、自身のLinkedInニュースレターが、最新のアルゴリズム変更を探しているユーザーに対して、あたかも公的な情報であるかのように提示されたと指摘している。

Google AI Overviewsが虚偽情報を「事実」として提示

さらに深刻なのは、GoogleのAI生成回答機能である「AI Overviews(旧SGE)」の反応だ。AI Overviewsは、検索クエリに対してWeb上の情報を要約して回答する機能だが、この架空のアップデート情報を「事実」として採用し、ユーザーに提示したのである。

AIはグーディ氏の捏造した情報を基に、あたかも公式な発表があったかのような要約を作成した。検索エンジンのトップに表示されるAIの回答は、多くのユーザーにとって信頼の拠り所となりやすい。しかし、その裏側では事実確認(ファクトチェック)が行われず、AIがAIの生成した嘘を増幅させるという悪循環が生じていた。

誤情報が連鎖する仕組みとメディアの反応

一度Googleによって「重要な情報」とお墨付きを与えられた誤情報は、他のメディアを巻き込んでさらに拡大していく。SEO業界において、Googleのアップデート情報はトラフィック(アクセス数)を稼ぐための絶好のネタであり、事実確認を怠ったサイトが次々と追随した。

グーディ氏の報告によれば、複数のWebサイトが「2026年3月のコアアップデート」について、詳細かつ権威ある論調で記事を公開した。これらの記事は単なるブログの転載ではなく、独自の技術的詳細を付け加えた「創作」へと進化していったのである。

他のテックサイトが「尾ひれ」をつけて拡散

実験の過程で、あるテクノロジー関連サイトは「Agentic Slop(エージェントによるゴミコンテンツ)」を取り締まるためのアップデートであるという、もっともらしい解説記事を掲載した。その中には「Gemini 4.0 セマンティックフィルター」や「ゼロ・インフォメーション・ゲイン分類システム」といった、存在しない技術用語まで並べられていた。

このように、一つの嘘が別の嘘を呼び、技術的な詳細が肉付けされることで、情報の信憑性が偽装されていく。これは「情報のロンダリング」とも呼べる現象であり、AIが生成した低品質なコンテンツが、人間の手による編集を経て「専門的な記事」へと変貌を遂げてしまう危うさを物語っている。

信頼性の高い主要メディアは沈黙を維持

一方で、Search Engine Journal(SEJ)などの主要なSEO専門メディアは、この架空のニュースを無視した。これらのメディアには厳格なファクトチェック体制があり、Googleの公式発表や信頼できるソースからの裏付けがない情報は掲載しない方針を貫いているからだ。

しかし、独立系のSEOブログや、アクセス数を優先する新興のテックサイトの多くは、この罠に陥った。業界全体がアップデートという言葉に過敏に反応する性質を利用され、情報の正確性よりも「速報性」が優先された結果と言える。

Googleのファクトチェックに対する消極的な姿勢

なぜGoogleはこれほど容易に誤情報を上位に表示させてしまうのか。その背景には、Googleが検索結果における「事実の正しさ」を直接的に保証することを避けているという現状がある。

Googleの検索アルゴリズムは、基本的には「関連性」と「信頼性のシグナル(リンクやドメインの強さなど)」に基づいて順位を決定する。ある情報が科学的・歴史的に正しいかどうかを判断する機能は、限定的であるというのが専門家の見方だ。

アルゴリズムによる事実確認の限界

GoogleでのSEO検索は、時に「スロットマシンを回すようなものだ」と評されることがある。特に新しい事象やニッチなトピックにおいては、情報の正誤を判定するための比較対象が不足しているため、最初に出現した「権威がありそうなドメインの記事」が正解として扱われやすい。

例えば、ブラックハットSEO(不正な手法で順位を上げる行為)の一種である「Google Stacking」について検索すると、Google自身がその手法を肯定するかのような情報を提示することがある。これは、アルゴリズムが「そのトピックについて言及している数」を「その情報の正しさ」と誤認している可能性を示している。

EUの規制に対するGoogleの回答

Googleは、外部からのファクトチェック強制に対しても否定的な立場を取っている。過去の報道によれば、EU(欧州連合)が検索結果にファクトチェックの結果を組み込むよう求める法律を検討した際、Googleのグローバル・アフェアーズ担当プレジデントであるケント・ウォーカー氏は、これを拒否する意向を示した。

Google側の主張によれば、ランキングアルゴリズムに強制的にファクトチェックを組み込むことは「適切でも効果的でもない」という。同社は、YouTubeの「コンテキスト・ノート(ユーザーによる付加情報)」のような機能には可能性を見出しているものの、検索エンジンそのものが「真実の裁定者」になることには慎重な姿勢を崩していない。

AI時代のSEOと情報収集における教訓

この実験は、AIを活用したコンテンツ制作が一般的になる中で、我々が直面しているリスクを浮き彫りにした。SEO担当者やWebライターにとって、AIは強力なツールであるが、同時に「嘘を拡散するエンジン」にもなり得る。

今後のWeb運用において、情報の信頼性を維持するためには、技術的な対策だけでなく、運用フローそのものを見直す必要がある。グーディ氏の実験から得られる教訓は、以下の2点に集約される。

AIワークフローに不可欠な「人間の目」

AIを用いて記事を作成する場合、必ず人間による検証(ヒューマン・イン・ザ・ループ)を組み込まなければならない。グーディ氏も、自身の通常のワークフローには品質管理プロセスが含まれているが、今回は実験のためにあえてそれをバイパスしたと述べている。

特に数字、日付、固有名詞、そして「Googleのアップデート」のような公式な事実が関わる情報については、一次ソース(Google公式ブログなど)を確認する習慣を徹底すべきだ。AIが生成したテキストをそのまま公開することは、自社の信頼性を失墜させるだけでなく、検索エコシステム全体を汚染する行為につながる。

読者に求められるファクトチェックの習慣

情報の受け手であるユーザー側も、検索結果の1位にあるからといって盲信してはならない。グーディ氏の記事に対しても、虚偽であることを指摘した読者はごく一部であり、多くの読者は疑問を持たずに内容を受け入れていたという。

情報過多の時代において、我々は「誰が言っているか」だけでなく「その情報は検証可能か」を常に問い続ける必要がある。特に、SNSや新興メディアで話題になっている「衝撃的なニュース」ほど、一歩立ち止まって複数のソースを確認するリテラシーが求められている。

この記事のポイント

- AIが生成した架空のGoogleアップデート情報が、検索結果やAI概要で上位表示された。

- 信頼性の高いドメイン(LinkedInなど)を利用することで、誤情報でも容易にインデックスされ、順位を獲得できる。

- 一度広まった誤情報は、他のメディアによって「尾ひれ」をつけられ、さらに信憑性を偽装されるリスクがある。

- Googleは検索結果における直接的なファクトチェックの導入に消極的であり、アルゴリズムには限界が存在する。

- AIを活用した情報発信では、人間による一次ソースの確認と、読者側のリテラシー向上が不可欠である。

出典

- Search Engine Journal「SEO Test Shows It’s Trivial To Rank Misinformation On Google」(2026年3月18日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

小規模サイトの検索流入が60%激減。AI時代のSEO戦略と生き残り策をデータから読み解く

小規模なウェブサイト運営者(パブリッシャー)が、Googleなどの検索エンジンから獲得する流入数が過去2年間で60%減少したことが明らかになった。アクセス解析ツールを提供するChartbeat(チャートビート)の調査データによれば、この減少幅は大規模なサイトと比較して約3倍に達している。検索アルゴリズムの変化とAIチャットボットの普及が、個人や中小規模のメディアに深刻な影響を与えている現状が浮き彫りとなった。

調査対象となったサイト群のうち、1日のページビュー(PV)が1万件未満の「小規模パブリッシャー」は、2024年から2026年にかけて検索経由のトラフィックを最も大きく失った。一方で、1日10万PVを超える大規模サイトの減少率は22%に留まっている。この格差は、検索エンジンが大手ブランドを優先する傾向を強めていることや、リソースの乏しい小規模サイトが急激な環境変化に対応できていないことを示唆している。

本記事では、この衝撃的なデータの詳細を分析し、なぜ小規模サイトだけがこれほど大きな打撃を受けているのかを考察する。また、検索流入に頼らない「脱・検索依存」の集客モデルについても、具体的な数値と共に解説していく。ウェブサイトを運営する中小企業の担当者や個人事業主にとって、今後のコンテンツ戦略を見直す重要な指標となるはずだ。

小規模パブリッシャーを襲う「検索流入60%減」の衝撃

Chartbeatが数千のクライアントウェブサイトを対象に実施した調査によると、検索エンジンからのリファラル(流入)トラフィックは、サイトの規模によってその減少幅に劇的な差が出ている。リファラルとは、他のサイトや検索エンジンにあるリンクを辿って自分のサイトへ訪れる仕組みを指す。この「検索エンジンという入り口」が、小規模なサイトでは半分以下に狭まっているのが現状だ。

サイト規模によって異なる減少幅の格差

データによれば、1日のページビューが1,000〜10,000件の小規模パブリッシャーは、過去2年間で検索流入が60%減少した。対して、10,000〜100,000件の中規模サイトは47%の減少、100,000件を超える大規模サイトは22%の減少となっている。大規模サイトも影響は受けているものの、小規模サイトの被害は突出して大きい。

この格差が生じる背景には、Googleの検索品質評価ガイドラインにおける「E-E-A-T(経験・専門性・権威性・信頼性)」の重視がある。大手メディアは組織としての信頼性や過去の蓄積があり、アルゴリズムの変動に対して耐性が高い。一方で、特定のトピックに特化した小規模サイトは、アルゴリズムの変更によって「信頼性の証明」が不十分と判断されやすく、掲載順位を大きく落とす傾向にある。

Google検索とDiscoverの同時衰退

検索流入の内訳を見ると、Google検索そのものからのトラフィックは2024年12月から2025年12月の1年間で34%減少した。追い打ちをかけるように、Google Discover(グーグル・ディスカバー)からの流入も15%減少している。Discoverとは、ユーザーの興味関心に合わせてスマートフォンのGoogleアプリなどに記事が自動表示される機能だ。

従来、検索順位が低くてもDiscoverで「バズる」ことで大量のアクセスを稼ぐ手法が存在したが、その窓口も狭まりつつある。Chartbeatのデータは、検索キーワードを打ち込んで探す「能動的な流入」と、おすすめに表示される「受動的な流入」の両方が、小規模パブリッシャーから失われていることを示している。これは、従来のSEO(検索エンジン最適化)だけではアクセスを維持できない時代の到来を意味する。

AIチャットボットは検索の代替になり得るか

検索流入が減少する一方で、ChatGPTなどのAIチャットボットからの流入は急増している。Chartbeatのデータによると、2024年末からの1年間で、ChatGPT経由のトラフィックは200%以上の成長を記録した。しかし、この数字には注意が必要だ。成長率こそ高いものの、全トラフィックに占めるAIチャットボットのシェアは依然として1%未満に過ぎない。

ChatGPT経由の流入は200%増もシェアは1%未満

AIチャットボットは、ユーザーの質問に対してウェブ上の情報を要約して回答する。回答内に引用元としてリンクが表示されることもあるが、ユーザーの多くはAIの回答だけで満足し、元のサイトをクリックしない。これを「ゼロクリック検索」と呼ぶ。辞書代わりの調べ物であれば、わざわざサイトを訪れる必要がなくなるためだ。

結果として、AI経由の流入が200%増えたところで、検索エンジンから失われた膨大なトラフィックを補填するには全く足りていない。著者のマット・G・サザン氏は、チャットボットの成長が検索の損失を置き換えるにはほど遠い状態であると指摘している。AIは情報の「消費場所」にはなっているが、サイトへの「送客装置」としてはまだ未成熟と言える。

サイトジャンルで分かれる「AI流入」の質

興味深い事実は、サイトのジャンルによってAIチャットボットからの流入の「質」が異なる点だ。ニュースやメディアサイトの場合、AIからの流入総数は多いものの、1記事あたりのエンゲージメント(滞在時間や読了率)は極めて低い。ユーザーはAIの回答が正しいかを確認するために、一瞬だけサイトを訪れる「ファクトチェック」的な使い方をしていると考えられる。

一方で、健康のアドバイスや園芸のヒントなどを提供する「実用的なサイト(Utilitarian sites)」では、AIからの流入数自体は少ないが、1記事あたりのページビューや滞在時間は長い傾向にある。ハウツーものや深い専門知識を求めるユーザーは、AIの簡潔な回答では満足せず、詳細な解説を求めてサイトを読み込むためだ。コンテンツの性質によって、AI時代における価値の残り方が分かれている。

大手メディアが実践する「脱・検索依存」の具体策

検索流入が22%の減少で済んでいる大規模パブリッシャーは、単にドメインが強いだけでなく、検索に頼らない集客経路の構築に成功している。Chartbeatの分析によれば、大手ニュースサイトなどでは「ダイレクト流入」や「内部トラフィック」の割合が増加している。これは、ユーザーが検索エンジンを経由せず、直接そのサイトを指名して訪れていることを示している。

ダイレクト流入と内部回遊の強化

ダイレクト流入とは、ブラウザのブックマークやURLの直接入力によってサイトを訪れることだ。いわば「常連客」の動きである。大手メディアは、ブランド認知度を高めることで「ニュースならこのサイト」という習慣をユーザーに植え付けている。また、一度訪れたユーザーを逃さないよう、関連記事への誘導(内部回遊)を徹底し、1回の訪問で複数のページを見てもらう工夫を凝らしている。

小規模サイトが1ページだけ読まれて離脱される「一見さん」中心の構造であるのに対し、大規模サイトはサイト内を回遊させる仕組みが強固だ。これにより、検索エンジンからの新規流入が減っても、全体のページビューの落ち込みを最小限に食い止めている。サイトを一つの「島」として完結させ、島内での滞在を最大化する戦略が功を奏している形だ。

所有メディア(メール・アプリ)への投資加速

さらに、大手パブリッシャーは「所有メディア(Owned Media)」への投資を加速させている。具体的には、メールマガジンの配信や独自アプリの提供だ。これらは検索アルゴリズムの影響を一切受けない。ユーザーのメールボックスやスマートフォンの通知に直接情報を届けられるため、非常に安定した流入源となる。

2026年1月のロイター研究所の調査でも、多くのパブリッシャーが「自社チャネルへの投資を増やす」と回答している。検索エンジンという他者のプラットフォームに依存するリスクを回避するため、顧客との直接的な接点を持つことの重要性が再認識されている。小規模サイトであっても、SNSのフォロワーやメルマガ登録者を地道に増やす「リストビルディング」が、かつてないほど重要になっている。

【独自分析】中小規模サイトが今後取るべき3つの生存戦略

今回のChartbeatのデータは、小規模サイトにとって絶望的な数字に見えるかもしれない。しかし、検索流入が減るからといってウェブサイトの価値がなくなるわけではない。むしろ、AIが一般情報を網羅する時代だからこそ、小規模サイトには「人間にしか書けない、特定の誰かのための情報」という独自の価値が求められている。以下に、中小規模サイトが今後取るべき戦略を3つ提案する。

「検索キーワード」から「読者の課題」へのシフト

これまでのSEOは「検索ボリュームの多いキーワード」を狙って記事を書くのが定石だった。しかし、一般的なキーワードに対する回答はAIが独占しつつある。今後は「キーワード」ではなく、特定のターゲットが抱える「具体的で深い悩み」にフォーカスすべきだ。検索回数は少なくても、その情報を切実に求めている読者に届くコンテンツは、AIには代替できない価値を持つ。

たとえば「美味しいカレーの作り方」という記事はAIに勝てないが、「築50年のキッチンで、限られた火力を使って本格スパイスカレーを作るコツ」という記事なら、同じ境遇の読者にとって唯一無二の存在になれる。ターゲットを極限まで絞り込み、その人たちのコミュニティ(SNSや専門掲示板)でシェアされることを目指すのが、現代の集客の基本となる。

滞在時間を重視した「実用・専門特化」コンテンツ

Chartbeatのデータが示した通り、実用的なハウツーサイトはAI経由でも高いエンゲージメントを維持している。これは、読者が「単なる事実」ではなく「実行するためのプロセス」を求めているからだ。小規模サイトは、表層的な情報をなぞるのではなく、著者自身の体験や独自の検証データ、失敗談などを盛り込んだ「厚みのあるコンテンツ」に特化すべきだ。

滞在時間が長いサイトは、Googleからも「ユーザーの課題を解決している」と評価されやすくなる。また、読者がその記事を保存(ブックマーク)したり、何度も読み返したりするようになれば、検索エンジンに依存しないリピーターへと変化する。PV数という「量」を追うのではなく、読了率や再訪問率という「質」をKPI(重要業績評価指標)に据えるべきだ。

ゼロクリック検索を逆手に取ったブランド構築

AIの回答に引用されることは、短期的には流入減につながるが、長期的には「ブランド名の露出」というメリットがある。AIが「〇〇サイトによれば〜」と繰り返し引用すれば、ユーザーの脳内にはその分野の専門家としてサイト名が刻まれる。これを逆手に取り、あえてAIが引用しやすい高品質な要約データや、独自の図解、統計を提供し続ける戦略も有効だ。

「検索結果で1位を取る」ことだけがSEOではない。AIの回答の一部になり、信頼できる情報源としての地位を確立することで、最終的には「詳しいことは直接あのサイトで確認しよう」という直接訪問を促す。流入経路が変化しても、情報の信頼性という価値は変わらない。小規模だからこそ、顔の見える専門家としてのブランディングを強化することが、最大の防御であり攻撃になる。

この記事のポイント

- 小規模パブリッシャーの検索流入は2年間で60%減少し、大規模サイトより打撃が大きい。

- Google検索だけでなくGoogle Discoverからの流入も減少傾向にあり、既存のSEO手法が限界を迎えている。

- ChatGPT経由の流入は200%増と急成長しているが、全体のシェアはまだ1%未満で検索の代わりにはならない。

- 大手メディアはダイレクト流入やメルマガ、アプリなど、検索に依存しない自社チャネルの強化で対策している。

- 小規模サイトは、AIに真似できない「体験談」や「超専門特化」コンテンツへ舵を切ることが生存の鍵となる。

出典

- Search Engine Journal「Search Referral Traffic Down 60% For Small Publishers, Data Shows」(2026年3月17日)

- Axios「Exclusive: Chartbeat data shows search traffic decline by publisher size」(2026年3月17日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

WordPress画像最適化の決定版:表示速度を劇的に改善する6つの実践テクニック

WordPressサイトのページ重量において、画像ファイルは常に最大の要因となる。デザイン性を重視するほど画像数は増え、最適化を怠ればサイトの読み込み速度は著しく低下する。記事によれば、多くの運営者がサイトの遅さに気づく頃には、メディアライブラリには数百もの未圧縮ファイルが蓄積されているという。

画像の最適化は、一度仕組みを構築すれば長期的なパフォーマンス向上に寄与する。本記事では、アップロード前の準備から最新の配信技術まで、具体的な6つのステップを解説する。これらを実践することで、ユーザー体験の向上とSEO対策の両立が可能になる。

特に、Googleが重視するCore Web Vitals(コアウェブバイタル)の指標であるLCP(Largest Contentful Paint)の改善には、画像の扱いが鍵を握る。適切なリサイズと圧縮、そして配信距離の短縮が、現代のWebサイト運営には不可欠だ。

1. アップロード前のリサイズとフォーマット選択

最適化の第一歩は、画像をWordPressにアップロードする前に始まる。高機能なカメラやスマートフォンで撮影した写真をそのままアップロードすることは、パフォーマンス上の大きなリスクとなる。記事では、ブラウザ側でのスケーリングに頼るのではなく、物理的なファイルサイズを事前に調整することの重要性が強調されている。

適切な表示サイズへのリサイズ

一眼レフカメラや最新のiPhoneで撮影された写真は、横幅が4000pxを超えることも珍しくない。しかし、一般的なWebサイトのコンテンツエリアの幅は800pxから1200px程度だ。必要以上に大きな画像をアップロードすると、ブラウザは巨大なファイルをダウンロードした後に縮小表示を行うため、通信量と計算リソースを無駄に消費する。

著者のMark Zahra氏は、アップロード前に「Squoosh」などのツールを使用してリサイズすることを推奨している。Squooshはブラウザ上で動作する画像圧縮ツールで、視覚的な品質を確認しながら最適なサイズに調整できる。既存の画像に対しては、「Regenerate Thumbnails」プラグインを使用して、テーマに合わせた最適なサイズでサムネイルを再生成することも有効だ。

WebPなど次世代フォーマットの採用

画像フォーマットの選択は、ファイルサイズに直結する。Googleのベンチマークによれば、WebP(ウェッピー)形式は、同等の画質のJPEGと比較して25〜34%ファイルサイズを削減できる。WebPは現在、ほぼすべての主要ブラウザでサポートされており、Webサイトにおける標準的な選択肢となっている。

基本的な使い分けとして、写真はJPEG(またはWebP)、透過が必要なグラフィックはPNG、ロゴやアイコンはSVG(Scalable Vector Graphics)が適している。SVGは数式で描画されるベクター形式のため、どれだけ拡大しても画質が劣化せず、ファイルサイズも極めて小さい。後述するプラグインを活用すれば、これらの変換を自動化することも可能だ。

2. プラグインによる圧縮の自動化とEXIFデータの削除

手動でのリサイズは優れた習慣だが、すでにライブラリにある大量の画像を処理するには限界がある。そこで必要になるのが、アップロード時に自動で圧縮を行うプラグインの導入だ。記事では、クラウドAPIを利用した効率的な圧縮手法が紹介されている。

クラウド型圧縮プラグインの活用

「ShortPixel Image Optimizer」などのプラグインは、画像をクラウドサーバーに送信して最適化を行い、サイトに書き戻す仕組みを持つ。これにより、自社のサーバーに負荷をかけることなく高度な圧縮が可能になる。ShortPixelの特徴は、画像ごとに最適な圧縮率を個別に計算するアルゴリズムにある。

圧縮モードには一般的に「Lossy(有損失)」「Glossy(高画質有損失)」「Lossless(無損失)」の3種類がある。Lossyはファイルサイズを最小化できるが、微細な画質低下が起こる。一方、Losslessは画質を完全に維持するが、削減率は低い。一般的なブログ記事であれば、視覚的な差がほとんど分からないLossyまたはGlossyが推奨される。なお、WordPressは1つの画像に対して複数のサムネイルを生成するため、プラグインのクレジット消費には注意が必要だ。

不要なEXIFデータの削除

デジタルカメラで撮影された写真には、EXIF(Exchangeable Image File Format)と呼ばれるメタデータが含まれている。これにはGPSの位置情報、カメラの機種名、撮影日時などが記録されている。これらの情報はWebサイトの訪問者には不要であり、ファイルサイズを増加させる要因となる。

最適化プラグインの設定で「EXIFデータの削除」を有効にすることで、これらの隠れたデータを自動的に取り除くことができる。これはプライバシー保護の観点からも重要であり、サイトの軽量化とセキュリティ強化を同時に実現する手段となる。わずかな差に見えるが、数千枚の画像が蓄積されるサイトでは無視できない削減量となる。

3. CDNの活用と遅延読み込みの最適化

ファイルサイズを小さくした後は、そのファイルをいかに効率よくユーザーに届けるかが課題となる。ここでは、物理的な距離の短縮と、読み込みの優先順位付けという2つのアプローチが重要になる。

CDNによるグローバル配信

CDN(Content Delivery Network / コンテンツデリバリネットワーク)は、世界中に配置されたサーバーにキャッシュを保存し、ユーザーに最も近い拠点からデータを配信する仕組みだ。これにより、物理的な距離による遅延(レイテンシ)を最小限に抑えることができる。

多くの高品質なホスティングサービスでは、標準でCDN機能が提供されている。特定のサービスを利用していない場合でも、Cloudflareのような無料プランのあるサービスを導入することで、画像配信の高速化が可能だ。CDNはサーバーの負荷分散にも寄与するため、トラフィックが急増した際のサイトダウンを防ぐ効果もある。

Lazy Loading(遅延読み込み)の注意点

Lazy Loadingとは、ユーザーがスクロールして画像が画面内に入る直前まで、読み込みを保留する技術だ。WordPress 5.5以降、この機能は標準で有効化されており、`loading=”lazy”` 属性が自動的に付与される。これにより、ページ初期読み込み時の通信量を大幅に削減できる。

ただし、記事によれば「ファーストビュー(Above the fold)」にある画像には注意が必要だ。ヒーロー画像などの最初に見える画像に遅延読み込みを適用すると、LCP(最大視覚コンテンツの表示時間)が悪化する。WordPress 5.9以降は最初の画像を自動で除外する仕組みがあるが、テーマの構造によっては正しく機能しない場合がある。重要な画像が意図せず遅延読み込みされていないか、ブラウザの開発者ツールで確認することが推奨される。

4. 代替テキスト(Alt属性)によるSEOとアクセシビリティ

画像の最適化は、パフォーマンス向上だけではない。検索エンジンへの情報伝達と、視覚障害を持つユーザーへの配慮も不可欠な要素だ。これらを担うのがAlt属性(代替テキスト)である。

適切なAltテキストの書き方

Altテキストは、画像の内容を具体的かつ自然な言葉で説明する必要がある。例えば、設定画面のスクリーンショットであれば「ShortPixelの圧縮設定画面」とするのが適切だ。「プラグインの画像」のような曖昧な説明や、キーワードを過剰に詰め込む行為(キーワードスタッフィング)は、検索エンジンからの評価を下げるリスクがある。

アクセシビリティの観点では、スクリーンリーダーが画像を読み上げる際にこのテキストが使用される。画像が何らかの理由で表示されない場合にも、このテキストが代わりに表示されるため、ユーザーはコンテンツの内容を把握できる。装飾目的で意味を持たない画像の場合は、`alt=””`(空の属性)を設定することで、支援技術に対して読み飛ばすべき画像であることを明示できる。

5. 独自の分析:画像最適化がコアウェブバイタルに与える影響

ここまでの情報を踏まえ、当ブログの視点で画像最適化が「Core Web Vitals(コアウェブバイタル)」に与える影響を分析する。コアウェブバイタルはGoogleが検索ランキング要因として採用している指標であり、その中でも画像はLCPとCLS(Cumulative Layout Shift)に深く関わっている。

LCP改善のための戦略的除外

記事でも触れられていたが、LCPの改善には「何でも遅延読み込みすれば良い」という考えを捨てる必要がある。特にブログ記事のアイキャッチ画像や、トップページのメインビジュアルは、ブラウザが発見した瞬間に読み込みを開始すべきだ。これには `fetchpriority=”high”` 属性を手動で付与し、ブラウザに優先度を伝える手法も検討に値する。

CLSを防ぐためのサイズ指定

画像が読み込まれる際にコンテンツがガタつくと、CLS(累積レイアウトシフト)が悪化する。これを防ぐには、HTMLの `` タグに必ず `width` と `height` 属性を記述することが重要だ。これにより、画像がダウンロードされる前でもブラウザが適切な表示領域を確保(アスペクト比の維持)できるため、読み込み完了時のレイアウト崩れを防ぐことができる。現代のWordPressテーマの多くはこの対応がなされているが、カスタムHTMLを使用する際は特に注意が必要だ。

この記事のポイント

- アップロード前のリサイズ: 表示幅に合わせたリサイズで無駄な通信をカットする。

- 次世代フォーマットWebP: JPEGより30%前後軽量なWebPを標準として採用する。

- プラグインによる自動化: 圧縮とEXIFデータ削除を自動化し、管理の手間を減らす。

- CDNとLCPの最適化: 配信距離を縮めつつ、ファーストビュー画像は遅延読み込みから除外する。

- 適切なAlt属性: SEOとアクセシビリティのために具体的で自然な説明を記述する。

出典

- WP Mayor「5 Image Optimization Tips to Improve the Load Time of Your WordPress Site」(2026年3月12日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験