AIエージェントがブランドを推薦する基準とは?「信頼性」が新たなSEO指標になる時代

AIエージェントが人間の代わりに5万ドルの予算を執行し、最適なベンダーを選定して契約まで完了させる。このような「エージェント・コマース」の時代が現実味を帯びている。これまでのSEO(検索エンジン最適化)は、いかにユーザーの目に留まるかという「可視性」を競ってきたが、これからはAIに選ばれるための「適格性」と「信頼性」が問われることになる。

検索エンジンの検索結果に表示されることと、AIが自律的な判断で特定のブランドを推薦することの間には、決定的な違いが存在する。それは「判断に伴うリスクの所在」だ。AIエージェントがユーザーの代理人として振る舞う以上、不適切な推薦はエージェント自身の存在価値を揺るがしかねない。

本記事では、AIエージェントがどのような基準でブランドを評価し、推薦に至るのかを解説する。ウォートン・スクールの研究結果を交えながら、これからのマーケターが取り組むべき「信頼のアーキテクチャ」について深掘りしていく。

AIエージェント時代の到来と「信頼」の重要性

現在のマーケティング業界では、AEO(Answer Engine Optimization / 回答エンジン最適化)やGEO(Generative Engine Optimization / 生成エンジン最適化)といった新しい略語が飛び交っている。これらは主に、ChatGPTやGoogleのGeminiといったLLM(大規模言語モデル)に自社コンテンツを学習・引用させるための手法だ。しかし、著者のPurna Virji氏は、議論の焦点を「WebサイトをLLMに最適化する方法」から「ブランドを自律型エージェントに最適化する方法」へ移すべきだと指摘している。

LLM最適化からエージェント最適化への転換

LLM最適化は、あくまで「情報を提供し、ユーザーに選んでもらうこと」を前提としている。これに対し、AIエージェントへの最適化は「AIに意思決定を委ねてもらうこと」を目指す。AIエージェントとは、ユーザーの指示を受けて自律的にタスクを実行するソフトウェアのことだ。例えば、「最適なCRM(顧客管理システム)を探して、予算内で契約を済ませておいて」という指示に対し、エージェントが市場調査から比較検討、最終的な発注までを行う世界である。

このプロセスにおいて、AIが最も重視するのは機能の多さや価格の安さだけではない。エージェントがそのブランドを「ユーザーに自信を持って推薦できるか」という信頼のレベルが重要になる。信頼とは、ここでは「不確実性を管理し、リスクを最小化できる能力」を指す。

リスクの所在がプラットフォームからエージェントへ移る

従来の検索エンジンでは、不適切なサイトを上位に表示しても、Googleなどのプラットフォーム側が直接的な責任を問われることは少なかった。ユーザーは検索結果から自己責任でサイトを選び、購入を判断するからだ。しかし、AIエージェントが意思決定を代行する場合、その責任はエージェントを開発・提供する側に転嫁される。

もしAIエージェントが、セキュリティに問題のあるベンダーや、倒産リスクの高いサービスを推薦し、ユーザーに損失を与えた場合、ユーザーは二度とそのエージェントを使わなくなるだろう。そのため、AIエージェントは必然的に「保守的」になり、エビデンス(証拠)が豊富で、説明責任を果たせるブランドを優先的に選ぶようになる。これが「信頼が新しいランキング要因になる」と言われる本質的な理由だ。

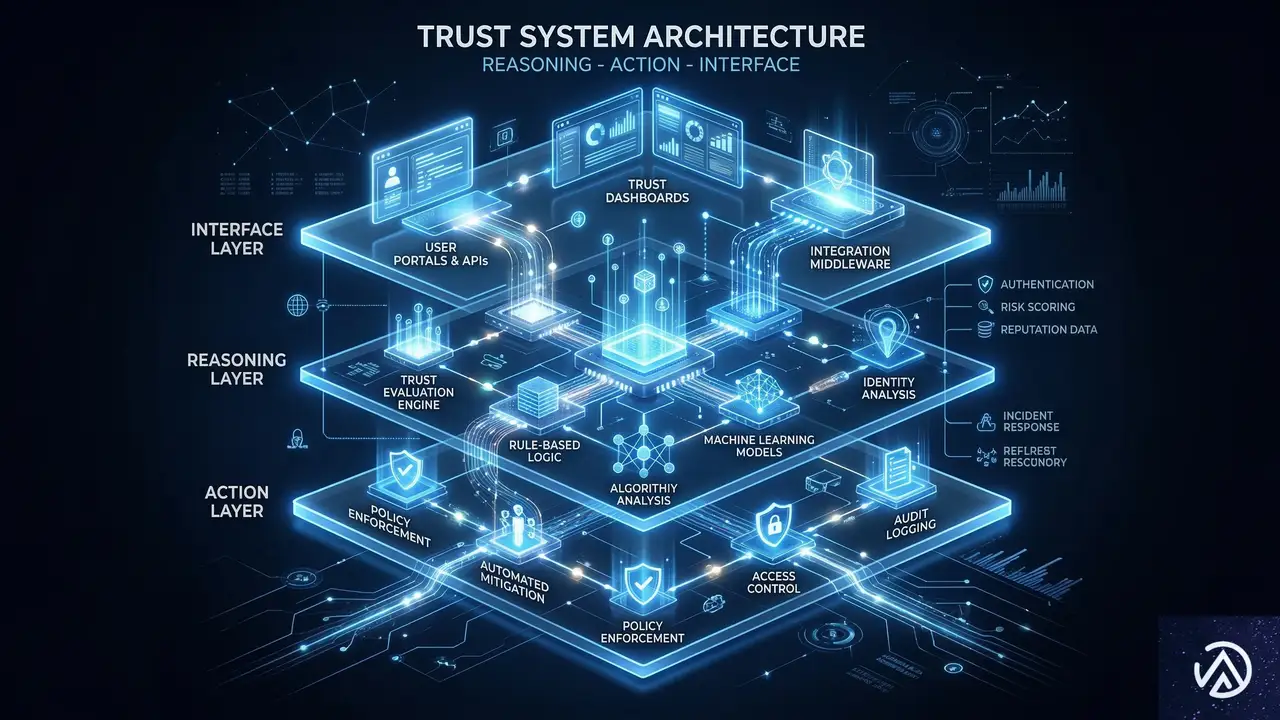

AIエージェントが信頼を構築する3つのアーキテクチャ

ウォートン・スクールのStefano Puntoni教授らの研究によれば、人間がAIエージェントを信頼し、依存するためには3つの構成要素が必要だとされている。これらは、マーケティングの観点からは「ブランドがAIに推薦されるための設計図」として読み替えることができる。

1. 推論の透明性と目標の整合性

AIエージェントは、なぜそのブランドを選んだのかをユーザーに説明できなければならない。そのためには、ブランド側が提供する情報が、単なる「宣伝文句」ではなく「検証可能な事実」である必要がある。例えば、明確な料金体系、現実的な導入スケジュール、競合他社と比較した際の具体的な優位性などが挙げられる。

AIは、ユーザーの目標(コスト削減、効率化など)とブランドの特性がどれだけ一致しているかを論理的に推論する。この際、曖昧な表現や誇大広告は、AIにとっての「ノイズ」となり、信頼を損なう要因となる。事実に即したデータを提供することが、AIの推論を助け、推薦の確率を高めることにつながる。

2. 予測可能な実行プロセスとフィードバック

エージェントは、選択した後のアクションがスムーズに進むことを好む。例えば、製品の購入手続きが複雑だったり、導入に何度も営業担当者との面談が必要だったりするブランドは、AIエージェントにとって「扱いにくい対象」となる。反対に、ドキュメントが公開されており、API連携が容易で、オンラインで完結するオンボーディング(導入支援)プロセスを持つブランドは、AIに好まれる。

「予測可能性」は、AIエージェントがユーザーに代わってアクションを起こす際の安心感を生む。実行プロセスが透明化されていることは、AIがユーザーに対して「次に何が起こるか」を正確にフィードバックできることを意味し、これがエージェントとユーザー間の信頼を強化するからだ。

3. 忖度しない「非追従性」のインターフェース

優れたAIエージェントは、単にユーザーの言うことを聞く(忖度する)だけではなく、時には「その選択は間違っている」と指摘する能力が求められる。これを「反媚態(Anti-Sycophancy)」と呼ぶ。エージェントはコンサルタントのように、予算や制約、コンプライアンスの観点からブランドを厳しく審査する。

ブランド側は、この「厳しい審査」に耐えうる深みのあるコンテンツを用意しなければならない。例えば、詳細なFAQ、特定の業界特有の制約への対応状況、他社製品からの乗り換え時の注意点などだ。AIエージェントがユーザーの問いかけに対して「このブランドは〇〇の点では優れていますが、△△の制約があるため注意が必要です」と、ニュアンスを含んだ回答ができるような材料を提供することが重要となる。

可視性(Visibility)から適格性(Eligibility)へのパラダイムシフト

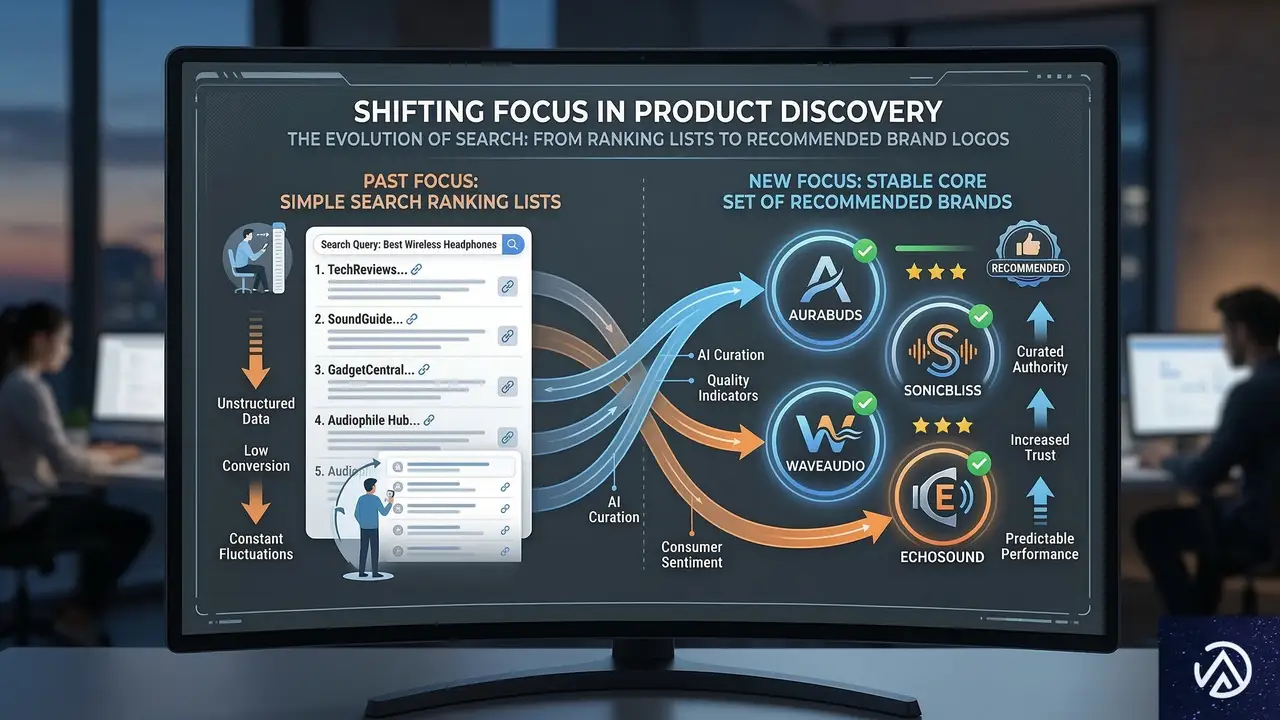

これまでのSEOの成功指標は、特定のキーワードで何位に表示されるかという「可視性」だった。しかし、AIエージェントの世界では、回答のたびに順位や内容が変動することが珍しくない。これについて、Rand Fishkin氏らの調査によれば、AIの回答には大きなばらつきがある一方で、ある「安定した傾向」も見られるという。

AIの回答にはばらつきがあるが「検討セット」は安定する

同じ質問をAIに何度も投げかけると、推薦されるブランドの順序やリストの長さは毎回変わることが多い。このため、「AI検索で1位を取る」といった従来の順位追跡は、あまり意味をなさない可能性がある。しかし、何度も試行を繰り返す中で、常に名前が挙がる「コアなブランド群」が存在する。これが、AIが「安全で推薦に値する」と判断した「検討セット(Consideration Set)」だ。

現代のマーケターが目指すべきは、単なる1位獲得ではなく、この「検討セット」の中に常に入り続けること、すなわち「適格性(Eligibility)」の確保だ。AIがユーザーの代理人として検討を行う際、最初から除外されないための「資格」を得ることが、新しい時代の成功の定義となる。

「選ばれる資格」を持つブランドの特徴

適格性を持つブランドには、共通の特徴がある。それは「デジタル上の信号(シグナル)」が一貫しており、かつ強力であることだ。自社サイトの情報だけでなく、SNSでの評判、専門家によるレビュー、ニュース記事、公的なデータベースなど、インターネット上のあらゆる場所で「信頼できる」という証拠が積み重なっている必要がある。

AIは単一の情報源を鵜呑みにせず、複数のソースをクロスチェックして情報の確からしさを判断する。そのため、自社サイトだけを綺麗に整えても、外部の評価が伴っていなければ適格性は得られない。これを「キャリブレーテッド・トラスト(校正された信頼)」と呼び、証拠の強さと一貫性に比例して高まっていくものだと指摘されている。

AIエージェントに選ばれるための4つの具体的戦略

では、具体的にどのような対策を講じればよいのか。AIエージェントに「信頼できるブランド」として認識され、推薦候補に残るための4つの戦略を提案する。

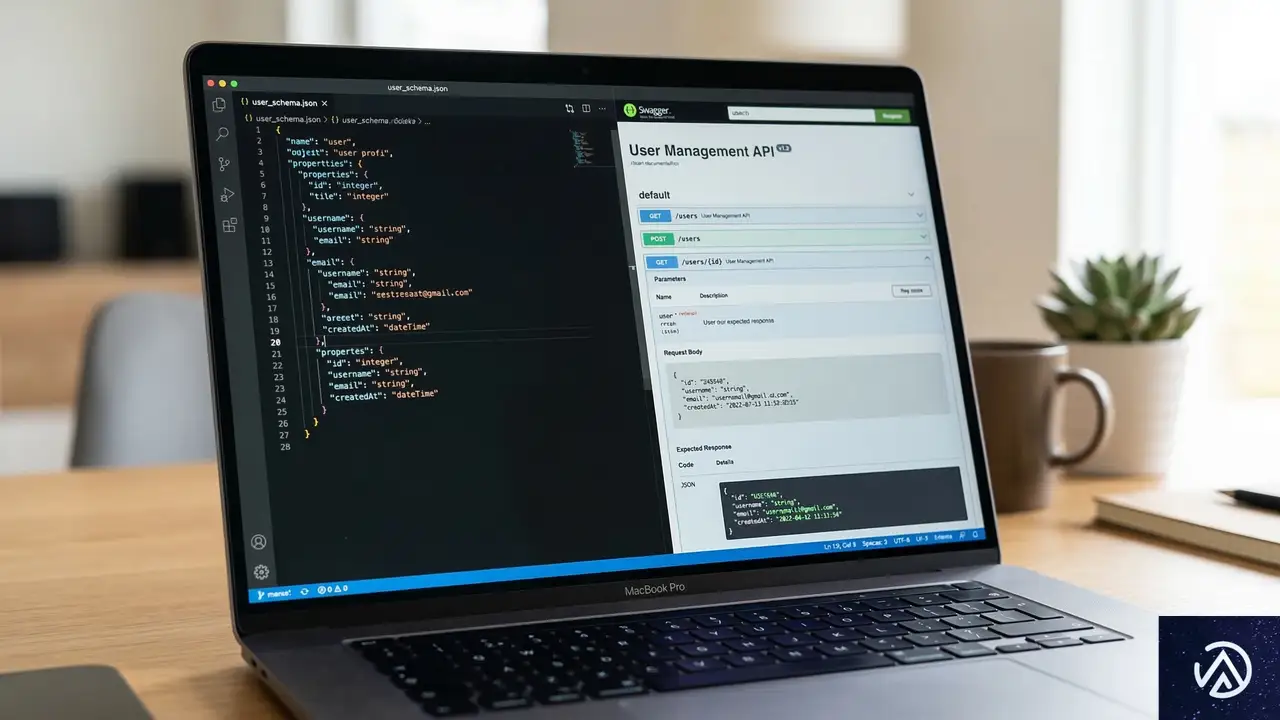

1. マシンリーダブルなデータ構造の整備

AIエージェントにとって読み取りやすい形式で情報を提供することは、最低限の条件である。構造化データ(Schema.orgなど)を適切に実装し、製品の仕様、価格、在庫状況、レビュー評価などを機械が正確に理解できるようにする必要がある。また、APIの公開や、クリーンなサイトアーキテクチャの構築も不可欠だ。AIが情報を解析する際に「解釈の余地」を減らし、正確なデータを直接渡せるように設計することが求められる。

2. 曖昧さを排除した透明性の高い情報公開

「詳細はお問い合わせください」という形式で情報を隠すことは、AIエージェント時代のマーケティングでは不利に働く。AIエージェントは、推奨の根拠となる具体的な数字や条件を必要としているからだ。価格帯、SLA(サービス品質保証)、システムの要件、解約条件など、ユーザーが判断材料とする項目を可能な限りオープンにするべきだ。情報を隠しているブランドは、情報の透明性が高い競合他社に「推薦のしやすさ」で負けてしまう。

3. 第三者による外部検証と社会的証明の強化

AIは、ブランドの自称よりも、第三者の評価を重く見る。顧客によるレビュー、アクティブなコミュニティでの議論、専門家によるチュートリアル、アナリストのレポートなどが、強力な「信頼のシグナル」となる。特にB2B領域では、導入事例(ケーススタディ)において具体的な数値(ROIなど)を示すことが、AIが推薦の根拠として引用しやすくなるため非常に有効だ。

4. 「推薦の根拠」となる素材の提供

AIエージェントがユーザーに説明する際の「カンニングペーパー」を用意するようなイメージでコンテンツを作成する。他社製品との比較表、投資対効果のシミュレーションモデル、「〇〇な課題を持つ企業に最適」といった具体的なガイドラインなどがこれに当たる。これらの素材は、AIエージェントがユーザーに対して「なぜこのブランドが最適なのか」を説得する際の強力な武器となる。

Web制作・マーケティング担当者が今取り組むべきこと

AIエージェントの普及は、Webサイトの役割を大きく変える。これまでは「人間を惹きつけるためのパンフレット」だったWebサイトは、これからは「AIエージェントが判断を下すためのデータベース」としての側面を強めていくだろう。私たちは、人間向けの魅力的なデザインと、AI向けの高精度なデータ構造を両立させなければならない。

まず取り組むべきは、自社のブランドに関連するキーワードでAI(ChatGPT, Perplexity, Google Geminiなど)がどのような回答を生成しているかを分析することだ。もし自社が推薦されていないのであれば、どの情報の欠落が原因なのか、あるいはどの外部評価が不足しているのかを特定する必要がある。

また、コンテンツ制作のあり方も見直すべきだ。単なる「バズ」を狙うのではなく、長期間にわたって参照され続ける「信頼の蓄積」を意識する必要がある。事実に基づき、検証可能で、かつ他者が引用しやすい高品質なコンテンツこそが、AI時代における最強のSEO資産となるだろう。

この記事のポイント

- 信頼性が最大のランキング要因に: AIエージェントが意思決定を代行する際、リスクを避けるために「信頼できる証拠」を最優先する。

- 可視性から適格性へのシフト: 検索順位に固執するのではなく、AIの「検討セット」に選ばれる資格を持つことが重要になる。

- 信頼の3要素: 推論の透明性、実行の予測可能性、そして忖度しない客観的な評価に耐えうる情報公開が必要だ。

- 具体的アクション: 構造化データの整備、情報の透明化、外部レビューの獲得、AIが引用しやすい比較資料の作成を推進すべきである。

出典

- Search Engine Journal「How AI Agents Decide Which Brands To Recommend: Trust Is The New Ranking Factor」(2026年3月16日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

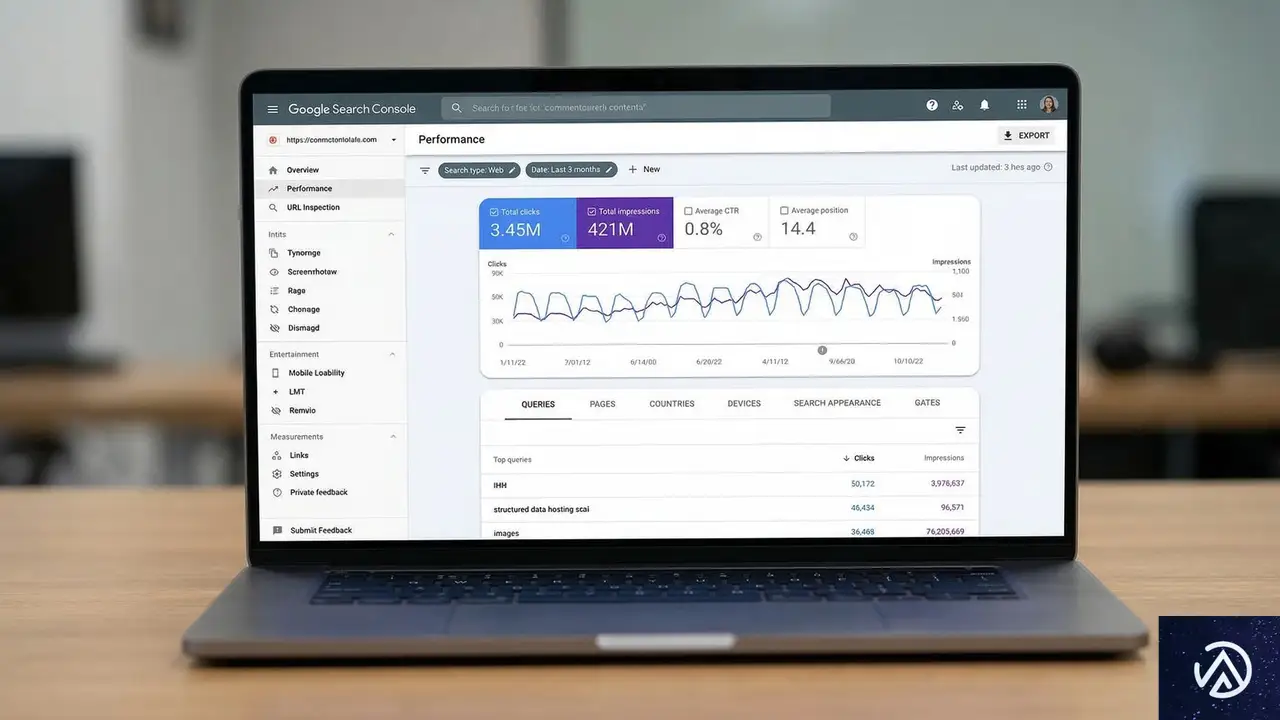

Google Search Consoleに「ブランドフィルタ」が登場。ECサイトのブランド分析を効率化する活用法

Google Search Console(グーグルサーチコンソール)のパフォーマンスレポートに、ブランドに関連する検索クエリを簡単に抽出・除外できる新しいフィルタ機能が追加された。このアップデートにより、自社名や製品名を含む「指名検索」の動向を、これまで以上に迅速かつ直感的に把握することが可能になる。

2026年3月のリリース以降、この機能はAI(人工知能)を活用してクエリを自動分類し、企業のマーケティング担当者やSEOエンジニアの分析工数を削減する役割を担っている。特にブランド認知が売上に直結するECサイト運営者にとって、指名検索の分析は競合対策やキャンペーン評価の要となる要素だ。

本記事では、新しく導入されたブランドフィルタの仕組みと、実務での具体的な活用シナリオ、そしてAIによる分類の限界について、専門的な視点から詳しく解説する。

ブランドフィルタの仕組みとAIによる自動分類

今回追加されたブランドフィルタは、検索パフォーマンスレポート内で「ブランドを含むクエリのみを表示」または「ブランドを除外して表示」を切り替える機能だ。従来、ブランド検索を特定するには正規表現(Regex)を用いた複雑なフィルタリングが必要だったが、新機能によって数クリックで同様の操作が完結するようになった。

AIが判別する「ブランドクエリ」の定義

GoogleはAIを用いてクエリを分類しており、以下の要素がブランドクエリとして認識される。指名検索とは、ユーザーが特定のブランドやサイトを目的地として検索する「ナビゲーショナルクエリ」とも呼ばれるものだ。

- 会社名やサイト名

- ドメイン名(例:example.com)

- ブランド固有の製品名やサービス名

- 一般的なスペルミスや表記揺れ

例えば、Appleというブランドであれば、「iPhone」や「MacBook」といった製品名、さらには「Aple」といったスペルミスもブランドクエリとして統合的に処理される。これにより、ユーザーの検索意図をより正確に反映したデータ抽出が可能となっている。

従来手法(正規表現)との違い

これまで、ブランド名と非ブランド名を分けるには、正規表現(Regex)を使いこなす必要があった。正規表現とは、特定の文字列のパターンを表現する記法のことだ。例えば「自社名|じしゃめい|jisya」といった複数のキーワードを組み合わせた抽出条件を自ら作成し、フィルタに入力する手間が生じていた。

新機能は、こうした手動の設定をAIが代替する。Googleが保有する膨大なナレッジグラフ(実在するモノや概念のデータベース)を参照し、何がそのサイトにとってのブランドであるかを自動的に判断するため、設定の漏れやミスを防ぎやすくなっている。ただし、記事によれば、この機能は利便性を高めるためのものであり、新しいデータそのものを提供するわけではない点に注意が必要だ。

AI分類の精度と現時点での限界

AIによる自動分類は非常に強力だが、完璧ではない。元記事の著者であるアン・スマーティ氏は、自身のテストにおいてAIがいくつかの誤認や見落としを発生させたことを報告している。実務で利用する際には、これらの特性を理解しておく必要がある。

認識されるバリエーションと見落とし

スマーティ氏の検証によると、フィルタは以下のバリエーションを正確に捉えることができたという。

- 1単語または2単語の表記(スペースの有無)

- ハイフン付きの名称

- 略称や一般的な誤字

一方で、特定の製品名や代表者の名前については、認識が不安定な側面も見られた。例えば、創業者の名前はブランドクエリとして認識されたが、その創業者が執筆した書籍のタイトルはブランドとして認識されなかったという。これは、GoogleのAIが「何がブランドの構成要素であるか」を判断する際、その知名度や関連性の強さに依存していることを示唆している。

意図しないクエリの混入

また、自社とは直接関係のない競合他社の名前や、無関係な企業の役員名がフィルタに含まれてしまうケースも確認されている。これは、Googleの「ブランド」に対する定義が広範であるため、あるいはAIの学習データに基づいた関連付けが強すぎるために発生する現象と考えられている。

このように、AIフィルタは「概ね正しいが、細部には手動のチェックが必要なツール」として扱うのが賢明だ。重要な分析を行う際は、引き続き正規表現を用いた厳密なフィルタリングと併用することが推奨される。

ECサイトにおける3つの実戦的活用シーン

このブランドフィルタは、特に競争の激しいEC(電子商取引)領域において強力な武器となる。記事では、具体的な3つのユースケースが紹介されている。

1. 競合による「ブランド乗っ取り」の検知

自社のブランド名で検索した際、検索結果の1位を維持できているか、あるいはクリック率(CTR)が極端に低下していないかを確認することは極めて重要だ。競合他社がGoogle広告で自社のブランド名をターゲットに設定したり、「[自社名] の代替品」といった比較ページを作成したりすることで、顧客を奪おうとする動きは珍しくない。

ブランドフィルタを適用し、平均掲載順位が1位でない場合や、CTRが50%を下回っている場合は、ブランド防衛策を講じる必要がある。これには、自社広告の出稿(リスティング広告でのブランド名入札)や、ブランドキーワードをターゲットにしたコンテンツの強化が含まれる。

2. マーケティングキャンペーンの影響測定

広告、メールマガジン、SNSでのプロモーションなどは、直接的なコンバージョンだけでなく、指名検索の増加という形でも成果が現れる。ブランドフィルタを使用すれば、キャンペーン期間中にブランドトラフィックがどれだけ底上げされたかを容易に可視化できる。

パフォーマンスレポートのグラフ上で右クリックし、「アノテーション(注釈)」を追加することで、施策と数値の変化を紐づけて管理できる。なお、このブランドフィルタのデータは2026年2月21日以降の結果から反映されているため、それ以前の施策との比較には注意が必要だ。

3. 地域別のブランド認知度の比較

グローバルに展開するEC事業者の場合、国ごとのブランド認知度の差を把握することは戦略立案に欠かせない。ブランドフィルタを適用した状態で「国」フィルタを追加すれば、カナダとイギリスでどちらのブランド認知が高いか、といった比較が容易に行える。

特定の地域でブランド検索が少ない場合、その地域に向けたローカライズ広告や認知拡大のための施策を優先的に検討する判断材料となるだろう。

独自分析:ブランド検索はECサイトの「防御壁」である

今回のアップデートは、単なる操作性の向上以上に、SEO戦略のパラダイムシフトを象徴している。現在の検索エンジン最適化において、一般的なキーワード(例:「メンズ スニーカー」)で上位表示を狙う難易度は年々高まっている。一方で、ブランド名そのものを検索して訪れるユーザーは、購入意欲が高く、競合への流出も少ない「良質なトラフィック」だ。

ブランドフィルタを活用することで、Web担当者は「SEO=順位を上げること」という狭い視点から、「SEO=ブランドの信頼を維持・拡大すること」という広い視点へと移行できる。ブランド検索が増えているということは、サイト外でのマーケティングや、顧客満足度の向上が実を結んでいる証拠でもある。

また、Googleのアルゴリズムにおいて「ブランドとしての権威性」はますます重視される傾向にある。ブランド検索が多いサイトは、特定のトピックにおいて信頼できる情報源であると判断されやすく、結果として非ブランド検索(一般キーワード)の順位向上にも寄与する。この「ブランドによるポジティブな循環」をデータで証明し、社内のマーケティング施策にフィードバックできるようになったことが、今回の機能追加の真の価値と言えるだろう。

この記事のポイント

- ブランドフィルタの登場:AIが自社名や製品名を自動判別し、抽出・除外を簡素化する。

- AIによる自動分類:表記揺れやスペルミスにも対応するが、マイナーな製品名などは見落とされる可能性がある。

- 競合対策への活用:ブランドクエリのCTRや掲載順位を監視し、顧客の流出を防ぐ。

- 効果測定の効率化:キャンペーンに伴う指名検索の増減を、アノテーション機能と併用して正確に把握できる。

- 戦略的価値:ブランド検索の動向を追うことは、ECサイトの長期的な信頼性と競争力を測る指標になる。

出典

- Practical Ecommerce「Search Console Adds Brand Filters」(2026年3月16日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Googlebotの正体は「数百のクローラー」の集合体。未公開システムの仕組みとSEOへの影響

Googlebotは単一のプログラムではなく、実際には数百もの異なるクローラーやフェッチャーが組み合わさった巨大なシステムの総称だ。GoogleのGary Illyes(ゲイリー・イリェーシュ)氏とMartin Splitt(マーティン・スプリット)氏が公開したポッドキャストにより、その複雑な内部構造が明らかになった。

2026年3月に公開されたこの情報によると、Googleが運用するクローラーの大部分は公開ドキュメントに記載されていない。これは、特定のチームが小規模な目的で使用するクローラーが膨大に存在するためだという。

Webサイト運営者やSEO担当者にとって、この事実はログ解析やクローラー制御の考え方を根本から見直すきっかけとなる。Googlebotという名称の裏側に隠された、巨大なクロール・インフラの実態を詳しく紐解いていく。

Googlebotは単一の存在ではない?クローラーの正体

一般的に「Googlebot」といえば、Webサイトを巡回してインデックスを作成する一つのロボットをイメージしがちだ。しかし、著者のGary Illyes氏によれば、現在のGooglebotは独立した一つのシステムではない。

「Googlebot」という名称の歴史的背景

Googlebotという名前が使われ始めた2000年代初頭、Googleには実際に一つのクローラーしか存在しなかった。当時は提供しているサービスも検索エンジンのみであり、単一のシステムで事足りていたからだ。しかし、AdWords(現在のGoogle 広告)などの新サービスが登場するたびに、専用のクローラーが追加されていった経緯がある。

現在では、ニュース、画像、動画、広告など、用途別に最適化された無数のクローラーが動いている。それでも「Googlebot」という名称が使われ続けているのは、歴史的な慣習によるものだ。実態としては、一つの巨大な「クロール・インフラ」を多くのクライアントが利用している状態に近い。

内部インフラとクライアントの関係性

Googlebotの本質は、クロール・インフラそのものではなく、そのインフラを利用する「クライアント」の一つである。これは、図書館(インフラ)に対して、本を借りに行く利用者(Googlebot)が複数いる状態に例えられる。利用者はGooglebotだけでなく、他にも何百人と存在するのだ。

この仕組みにより、Google内部の各開発チームは、共通の強力なクロール基盤を利用しながら、自分たちの目的に合わせた独自のクローラーを走らせることができる。私たちが普段目にしているGooglebotは、氷山の一角に過ぎないのである。

クロール・インフラの仕組みと「SaaS」的側面

Google内部で運用されているクロール・インフラには特定の名称があるが、Gary Illyes氏はその公開を控えた。彼はこのインフラを、ソフトウェアをサービスとして提供する「SaaS(Software as a Service)」のようなものだと説明している。

内部APIを通じたデータの取得プロセス

Googleのエンジニアがインターネット上のデータを取得したい場合、このインフラが提供するAPIエンドポイントを呼び出す。API(Application Programming Interface)とは、ソフトウェア同士が機能を共有するための窓口のことだ。エンジニアはこの窓口を通じて、「このURLのデータを取ってきてほしい」というリクエストを送る。

リクエストを受けたインフラ側は、クラウドやデータセンターのリソースを使い、対象のWebサイトに負荷をかけすぎないよう配慮しながらフェッチ(取得)を実行する。つまり、クローラーをゼロから開発する必要はなく、共通のAPIを叩くだけで高度なクロール機能を利用できる仕組みが整っているのだ。

パラメータ設定による柔軟な制御

APIを呼び出す際には、さまざまなパラメータを指定できる。例えば、データの返信を待つ時間(タイムアウト設定)、名乗る名前(ユーザーエージェント)、遵守すべきrobots.txtのルールなどだ。多くの場合はデフォルト設定が適用されるため、開発者は複雑な設定なしに利用できる。

ユーザーエージェントとは、クローラーがWebサーバーにアクセスする際に提示する「自己紹介文」のようなものだ。この設定を変更することで、特定のチーム専用のクローラーとして振る舞うことが可能になる。この柔軟性が、数百種類ものクローラーを生み出す要因となっている。

なぜ「未公開」のクローラーが数百も存在するのか

Googleの公式サイトには主要なクローラーの一覧が掲載されているが、そこに含まれないクローラーが圧倒的に多い。これには、ドキュメント管理の現実的な限界と、情報の重要度による線引きが関係している。

公開ドキュメントに記載される基準

Gary Illyes氏によれば、すべてのクローラーをドキュメント化することは事実上不可能だという。Googleは巨大な組織であり、数多くのチームがそれぞれの目的でクローラーを運用しているからだ。もし数百のクローラーをすべて詳細に記載すれば、開発者向けのドキュメントページは膨大な量になり、かえって利便性を損なうことになる。

そのため、Googleは「トラフィック量」という基準で線を引いている。インターネット全体に対して目に見えるほどの影響力を持つ、あるいは頻繁にサイトを訪れる主要なクローラーのみを公開対象としている。小規模なテスト用や特定の機能限定のクローラーは、あえて非公開のままにされているのだ。

内部チームによる多様な用途

未公開のクローラーは、検索以外の多種多様な目的で使用されている。例えば、新機能のプロトタイプ作成、内部的なデータ分析、あるいは特定のセキュリティチェックなどが考えられる。これらのクローラーは取得するURLの数が非常に少ないため、一般的なWebサイト運営者がその存在に気づくことはほとんどない。

ただし、特定のクローラーが一定の閾値を超えて大量のアクセスを行うようになった場合、Gary Illyes氏らはそのチームに連絡を取り、動作の正当性を確認した上でドキュメント化を検討するという。これにより、Webエコシステムへの悪影響を防ぐ監視体制が敷かれている。

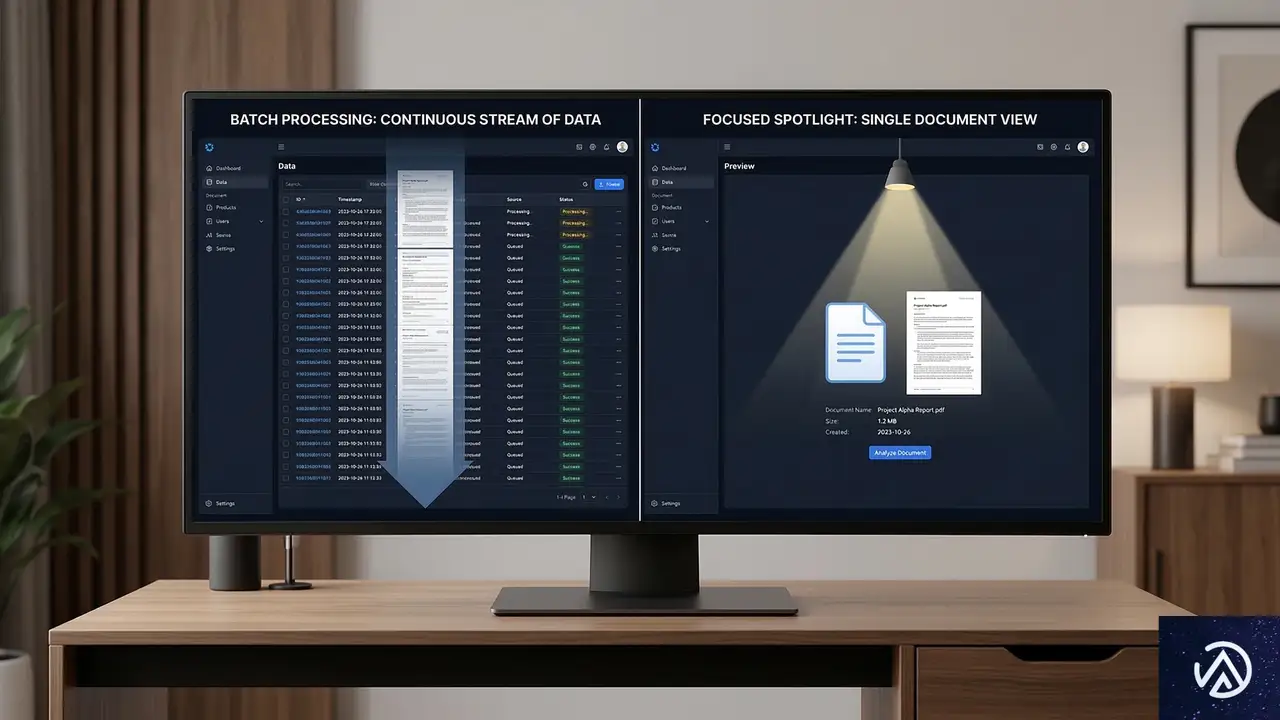

「クローラー」と「フェッチャー」の決定的な違い

Google内部では、データを取得する仕組みを「クローラー(Crawler)」と「フェッチャー(Fetcher)」の2種類に明確に使い分けている。これらは動作の仕組みも、実行されるタイミングも大きく異なる。

バッチ処理と個別リクエストの使い分け

クローラーは「バッチ処理」で動作する。バッチ処理とは、大量のデータをまとめて一括で処理する方式のことだ。クローラーには常に巡回すべきURLのリストが供給され、24時間365日、システムが空いている時間に継続的にデータを取得し続ける。これが一般的な検索インデックス作成の仕組みだ。

一方、フェッチャーは「個別URL」単位で動作する。特定のURLを指定して、その1件だけを即座に取得するのが役割だ。クローラーが「広範囲を網羅する網」だとすれば、フェッチャーは「ピンポイントで狙う釣り竿」のようなものだと言える。

ユーザー操作がトリガーとなるフェッチ

フェッチャーが動く際の特徴は、多くの場合「ユーザーの操作」が起点となっている点だ。例えば、Search Consoleで「URL検査」を実行し、現在の状態をライブテストする場合などがこれに当たる。画面の向こう側に、結果を待っている人間がいる状態だ。

Googleの内部ポリシーでは、フェッチャーはユーザーの制御下にあるべきだと定められている。これに対してクローラーは、システムの都合に合わせて自律的に動く。この違いを理解しておくことは、サーバーログを見て「なぜ今このアクセスが来たのか」を推測する際の大きなヒントになる。

Webサイト運営者が知っておくべき実務上の注意点

Googlebotが数百のクローラーの集合体であるという事実は、実務においてどのような意味を持つのか。特にセキュリティやパフォーマンスの観点から、サイト運営者が意識すべきポイントを整理する。

未知のユーザーエージェントへの対応

サーバーログを分析していると、GoogleのIPアドレス帯域からのアクセスであるにもかかわらず、ドキュメントに載っていないユーザーエージェントを見かけることがあるかもしれない。これまでは「偽装されたボット」と判断して遮断していたケースもあるだろうが、その一部はGoogle内部の正当な未公開クローラーである可能性がある。

重要なのは、ユーザーエージェント名だけで判断せず、IPアドレスの逆引き(DNSルックアップ)を行って、本当にGoogleからのアクセスかどうかを確認することだ。正当なGoogleのインフラからのアクセスであれば、むやみにブロックせず、サイトのクロールバジェット(クローラーが巡回できる許容量)の範囲内で許容するのが賢明だ。

サーバー負荷とログ解析の視点

数百のクローラーが存在するということは、それだけ多様な目的でサイトがスキャンされる可能性があることを意味する。しかし、Gary Illyes氏が述べている通り、未公開のクローラーは通常、極めて低頻度でしか動作しない。もし特定のボットが大量のアクセスを行い、サーバー負荷を高めているのであれば、それは主要なクローラーであるか、あるいは設定ミスによる異常動作である可能性が高い。

また、robots.txtでの制御も、基本的には「Googlebot」というメインのトークン(識別子)で大部分をカバーできる。個別の未公開クローラーをすべて制御しようとするのは現実的ではなく、主要な指示系統を整理しておくことこそが、SEOにおけるクローラビリティ最適化の王道であることに変わりはない。

この記事のポイント

- Googlebotは単一のプログラムではなく、数百種類のクローラーやフェッチャーが共通のインフラを利用する集合体である。

- Google内部ではクロール機能を「SaaS」のように提供しており、APIを通じて誰でもフェッチリクエストを送れる仕組みがある。

- 公開ドキュメントに載っているのは主要なクローラーのみで、トラフィックの少ない小規模なものは非公開とされている。

- 「クローラー」はバッチ処理で継続的に動き、「フェッチャー」はユーザー操作などを起点に個別URLを取得する。

- サイト運営者は、ドキュメント外のクローラーも存在することを前提に、IPアドレスベースでの正当性確認を行うことが推奨される。

出典

- Search Engine Journal「Google Says Hundreds Of Their Crawlers Are Not Documented」(2026年3月13日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google AI Overviewsで検索クリック42%減。パブリッシャーが生き残るための「速報」と「Discover」戦略

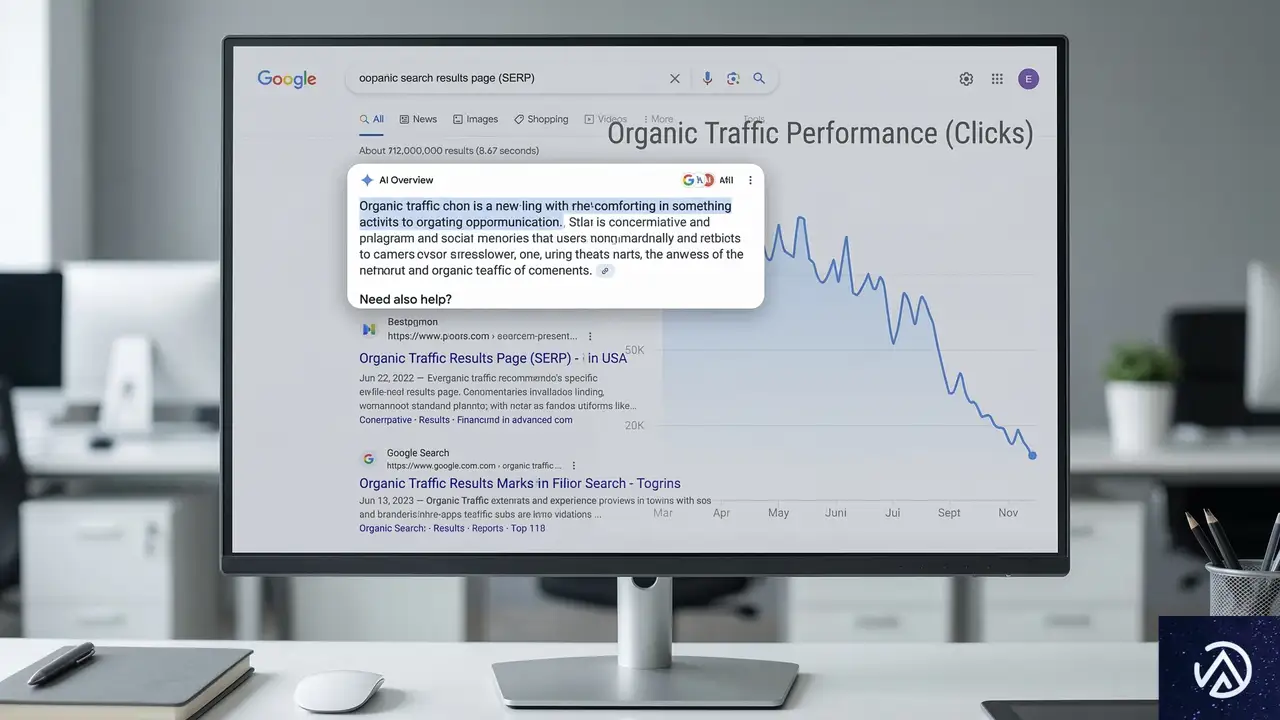

Googleが導入したAI Overviews(AIによる概要回答機能)の影響により、Webサイトへのオーガニック検索トラフィックが劇的な変化を見せている。最新の調査レポートによれば、AI Overviewsの拡大に伴い、従来の検索結果からのクリック数は42%も減少した。一方で、速報ニュースやGoogle Discoverといった特定のチャネルでは、トラフィックが急増するという対照的な動きが確認されている。

このデータは、Define Media Groupが64のWebサイトを対象にGoogle Search Consoleの統計を分析したものだ。AIがユーザーの疑問に直接回答するようになったことで、情報の「まとめ」や「解説」を主軸としていたコンテンツの優位性が揺らいでいる。Webサイト運営者は、従来のSEO戦略を根本から見直す必要に迫られている。

本記事では、AI Overviewsが検索トラフィックに与えた具体的な影響と、その中で成長を続ける「速報ニュース」および「Google Discover」の重要性について深掘りする。AI時代の検索環境で、どのようにコンテンツの露出を確保すべきか、その指針を提示する。

Google AI Overviewsの衝撃——検索トラフィック42%減の現実

Google AI Overviews(AIO)とは、検索クエリ(検索窓に入力する言葉)に対して、AIがWeb上の情報を要約して回答を表示する機能だ。ユーザーはWebサイトをクリックすることなく、検索結果画面だけで情報を完結できる。この「ゼロクリック検索」の増加が、パブリッシャーにとって大きな打撃となっている。

加速するオーガニック検索の減少

Define Media Groupのレポートによれば、AI Overviewsが本格的に展開された後、オーガニック検索のトラフィックは段階的に減少した。2023年第1四半期から2024年第1四半期にかけて、対象サイトの四半期平均クリック数は約17億回であった。しかし、AI Overviewsの導入直後にトラフィックは16%減少。その後、2025年5月の機能拡張を経て減少は加速し、2025年第4四半期には基準値から42%減という数字を記録した。

この減少は、特に「エバーグリーンコンテンツ」と呼ばれる分野で顕著だ。エバーグリーンコンテンツとは、時間が経過しても価値が損なわれにくい、普遍的な解説記事やハウツー記事を指す。これらはAIが学習しやすく、要約も容易であるため、AI Overviewsによって内容が代替されやすい性質を持っている。

情報の「中抜き」が起きる仕組み

なぜこれほどまでにクリックが減るのか。それは、Googleの検索結果画面(SERP / Search Engine Results Page)の占有率が変化したためだ。AI Overviewsが画面上部の大部分を占めることで、従来の検索1位のサイトであっても、スマートフォンの画面では「ファーストビュー(最初に表示される範囲)」から追い出されるケースが増えている。

ユーザーが「〜のやり方は?」と検索した際、AIが手順を1から10まで箇条書きで示してしまえば、元の解説記事を読む必要性は低くなる。著者のダニー・グッドウィン氏は、AI生成の回答が検索トラフィックの形を根本から作り変えていると指摘している。事実、情報収集を目的としたインフォメーショナルなクエリにおいて、損失が集中しているのが現状だ。

なぜ「速報ニュース」は103%も成長したのか?

検索全体が落ち込む中で、驚異的な成長を見せているのが「速報ニュース(Breaking News)」だ。同レポートによると、2024年11月から2026年初頭にかけて、速報ニュースのトラフィックは103%増加した。AIが席巻する検索環境において、なぜニュースだけがこれほどの伸びを見せているのだろうか。

AIが苦手とする「リアルタイム性」と「正確性」

大きな理由の一つは、Googleがニュースクエリに対してAI Overviewsの表示を意図的に抑制していることにある。Ahrefsのデータを引用したレポートによれば、ニュース関連の検索でAI Overviewsが表示される割合は約15%にとどまる。これは健康や科学といった分野に比べ、3分の1程度の頻度だ。

ニュースは情報の更新速度が極めて速く、AIが誤情報を生成する「ハルシネーション(Hallucination / 幻覚)」のリスクが高い。ハルシネーションとは、AIが事実に基づかない情報を、あたかも真実であるかのように出力する現象だ。正確性が求められる重大なニュースにおいて、GoogleはAIによる要約よりも、信頼できるメディアの最新記事を直接提示する「Top Stories(トップニュース)」カルーセルを優先している。

Top Storiesカルーセルへの集中

国際紛争や大規模なイベントなど、現在進行形で状況が変わるトピックでは、AI Overviewsよりもニュース記事へのリンクが強調される。ユーザーは最新の状況を知るために、AIの要約ではなく、一次情報源であるパブリッシャーのサイトを訪れる傾向がある。この仕組みが、ニュースサイトへの流入を支える防波堤となっている。

Define Media Groupの見解によれば、Googleは急速に変化する事象に対して生成AIを適用することを避けている。これは、AIシステムの学習データがリアルタイムの出来事に追いつかないことや、社会的影響の大きいニュースでの誤報を最小限に抑えるための戦略的判断と言えるだろう。

Google Discoverが新たなトラフィックの柱に

検索クリックが減少する一方で、パブリッシャーの救世主となっているのが「Google Discover」だ。Google Discoverとは、ユーザーの検索履歴や興味関心に基づいて、Googleアプリのホーム画面などに自動で記事をレコメンド(推奨)する機能だ。検索キーワードを入力しなくても情報が届くため、「プッシュ型」のトラフィック源と呼ばれる。

DiscoverとWeb検索のトラフィックが並ぶ

調査対象のサイト群では、Google Discoverからのトラフィックが30%増加した。興味深いことに、レポートのデータセットにおいて、Discoverからの流入数が従来のWeb検索からの流入数とほぼ同等になったことが初めて確認された。これは、ユーザーの情報取得スタイルが「探す(Search)」から「流れてくるものを見る(Discover)」へとシフトしていることを示唆している。

特に2025年12月のコアアップデート以降、Discoverのトラフィックは急増した。2026年2月のアップデートで一部の勢いは落ち着いたものの、依然として強力な集客チャネルであることに変わりはない。Chartbeatのデータでも、ニュースサイトへのGoogleからの参照トラフィックの主役は、もはや伝統的な検索ではなくDiscoverであると報告されている。

パーソナライズがAIの壁を越える

Google Discoverは、AI Overviewsとは対極の存在だ。AI Overviewsが「答えを提示して完結させる」のに対し、Discoverは「興味がありそうな記事を紹介してクリックを促す」仕組みだ。AIによって検索結果が要約されるほど、ユーザーは自分の好みに合った深い情報を求めてDiscoverに流れるという循環が生まれている。

Web制作やコンテンツ運営の現場では、これまで以上に「Discoverに掲載されるための最適化」が重要になる。具体的には、高解像度で魅力的なアイキャッチ画像の使用、ユーザーの興味を引くタイトル設定、そして何よりも特定のトピックに対する専門性と信頼性が鍵を握る。DiscoverはSEOとは異なるアルゴリズムで動いているが、AI時代のトラフィック確保には欠かせない要素だ。

AI時代におけるSEO戦略の再定義

今回のレポートが示す事実は、従来の「検索キーワードに対して答えを用意する」だけのSEOが限界を迎えているということだ。AIが答えを出せる範囲のコンテンツは、今後さらにクリックを奪われ続けるだろう。では、Webサイト運営者はどのような方向に舵を切るべきなのか。

一次情報と専門性の強化

AIが生成できないのは、独自の体験に基づく意見や、現地での取材、実験データなどの「一次情報」だ。単なる知識のまとめではなく、そのサイトにしかない独自の視点や分析が含まれているコンテンツは、AI Overviewsのソース(情報源)として引用される可能性が高まり、結果としてクリックを誘発する。また、Googleは「E-E-A-T(経験、専門性、権威性、信頼性)」を重視しており、これらを証明できるコンテンツはDiscoverでも優先される傾向にある。

マルチチャネルでの集客設計

検索エンジンだけに依存するリスクが顕在化した今、流入経路の多様化は急務だ。今回のデータが示す通り、速報性を活かしたGoogle Newsへの対応や、Discoverを意識したコンテンツ作成、さらにはSNSやメールマガジンを通じた直接的なファンとの繋がりが重要になる。

特に中小企業や個人事業主のサイトにおいては、広範なキーワードで1位を狙うよりも、特定のニッチな分野で「この記事でなければ得られない体験」を提供することが、AIの要約に負けない唯一の方法だ。情報の網羅性ではなく、情報の「深さ」と「鮮度」にリソースを集中させることが、これからのSEOの正攻法となるだろう。

この記事のポイント

- Google AI Overviewsの普及により、従来の検索クリック数は最大42%減少した。

- 解説中心のエバーグリーンコンテンツはAIに代替されやすく、トラフィックが減少しやすい。

- 速報ニュースはAIのハルシネーションリスクを避けるGoogleの仕様により、トラフィックが103%増加した。

- Google Discoverが急成長しており、一部のサイトでは検索流入に匹敵する主要な集客源となっている。

- AI時代には、一次情報の提供、専門性の強化、そしてDiscoverを意識したコンテンツ運用が不可欠である。

出典

- Search Engine Land「Google AI Overviews cut search clicks 42%: Report」(2026年3月12日)

- Define Media Group「BREAKING! News Thrives in the Age of AI」(2026年3月12日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

ChatGPTの検索挙動に異変?GPT-5.4と5.3で異なる引用元とSEOへの影響

ChatGPTのデフォルトモデルとプレミアムモデルに同じ質問を投げても、得られる情報源は全く別物になる可能性がある。最新の調査によれば、上位モデルであるGPT-5.4 Thinkingと標準的なGPT-5.3 Instantでは、Web検索の実行プロセスと引用するドメインの傾向に決定的な差があることが判明した。

Writesonicによる分析の結果、プレミアムモデルであるGPT-5.4は引用元の56%を企業のブランドサイトから取得しているのに対し、無料ユーザー向けのGPT-5.3ではその割合がわずか8%に留まっている。両モデルが共有する引用ソースは、全体のわずか7%に過ぎないという事実が、AI検索の不透明さを浮き彫りにしている。

この挙動の違いは、企業がAI検索エンジン最適化(GEO/LLMO)を考える上で無視できない。ユーザーがどのプランを利用しているかによって、自社サイトが「AIに発見されるか」の確率が劇的に変わるからだ。本記事では、この調査結果を基にAI時代の新しいSEOのあり方を分析する。

ChatGPTのモデル間で生じる「検索結果」の決定的な差

ChatGPTは単一の検索アルゴリズムで動いているわけではない。モデルごとに情報の「探し方」そのものが最適化されている。Writesonicの調査によれば、GPT-5.3(Instant)とGPT-5.4(Thinking)に同じプロンプトを入力した際、両者が提示したソースの重複率は極めて低かった。

引用元の重複はわずか7%という衝撃

同じAIチャットボットを使いながら、回答の根拠となるWebサイトが9割以上異なるという事実は、Web担当者にとって驚くべきデータだ。これは、AIが単にGoogleの検索結果を要約しているのではなく、モデルの特性に応じて独自の「フィルタリング」を行っていることを示唆している。

例えば、CRM(顧客管理システム)ソフトウェアについて質問した場合、GPT-5.3は広範な1つのクエリを発行し、一般的な技術解説サイトを引用する。一方、GPT-5.4は特定のブランドサイトを狙い撃ちした検索を行い、より公式サイトに近い情報を収集する傾向がある。この「情報の深さ」の差が、引用元の乖離を生んでいる。

ブランドサイトを重視するプレミアムモデル

特筆すべきは、プレミアムモデルであるGPT-5.4が「一次情報」に強いこだわりを見せている点だ。調査によれば、GPT-5.4が引用したソースの56%がブランドの公式サイトであった。これは、AIがユーザーに対してより正確で責任ある回答をしようと試みた結果、第三者のブログよりも公式サイトの情報を優先したためと考えられる。

対照的に、無料版の標準モデルであるGPT-5.3は、メディアサイトやレビュー記事などの「第三者視点のコンテンツ」を好む傾向がある。これは、計算リソースを抑えつつ、手っ取り早く評価の定まった情報をまとめるのに適した戦略だと言える。ユーザーのプランによって、企業が直接リーチできるか、それともメディアを介して認知されるかが分かれる構造になっているのだ。

検索戦略の深掘り:なぜ引用元が変わるのか

引用元の違いは、各モデルがバックグラウンドで実行している「検索クエリ(検索窓に入力する言葉)」の質と量に起因している。GPT-5.4は、人間が手動でリサーチを行うような高度な検索テクニックを自動で実行していることが判明した。

site:演算子を駆使するGPT-5.4の緻密なリサーチ

GPT-5.4の最大の特徴は、`site:`演算子を多用することだ。`site:`演算子とは、特定のドメイン内だけで検索を行うための検索コマンドである(例:`site:example.com 料金`)。調査期間中、GPT-5.4は423回のクエリのうち156回でこの演算子を使用した。一方で、他のモデルでこの演算子が使われることは全くなかったという。

この挙動により、GPT-5.4は「HubSpotの価格を知りたい」という要求に対し、まずHubSpotの公式サイト内に絞って検索をかける。これにより、情報の正確性が飛躍的に高まる。AIが特定のサイトを指定して情報を抜き取りに来る以上、企業側は「自社サイト内での情報の見つけやすさ」をより意識する必要がある。

サブクエリによる情報の多角的な検証

GPT-5.4は1つの質問に対して、平均8.5回のサブクエリ(追加の検索)を実行する。例えば、「A社とB社の比較」という質問に対し、まず「A社の特徴」「B社の特徴」を個別に検索し、次に「A社の価格」「B社の価格」、さらに「A社の口コミ」「B社の口コミ」といった具合に、情報を分解して収集する。

サブクエリとは、メインの質問を補完するために発行される小さな検索のことだ。これにより、AIは断片的な情報を組み合わせて、より網羅的な回答を作成する。このプロセスにおいて、GPT-5.4はG2やCapterraといった信頼性の高いレビュープラットフォームも併用しており、公式サイトの一次情報と第三者の評価をバランスよく組み合わせていることがわかる。

引用されるコンテンツの性質:メディアか、一次情報か

どのようなページが引用されやすいかという点でも、モデル間で明確な「好み」の差が現れている。これは、コンテンツ制作側がどの層をターゲットにするかによって、注力すべきページが異なることを意味する。

デフォルトモデルが好む「第三者によるレビュー」

GPT-5.3(デフォルトモデル)は、ブログ記事やニュースサイトを引用する割合が32%と高い。引用されたトップドメインには、ForbesやTechRadar、Tom’s Guideといった大手メディアが名を連ねている。これらのサイトは既にSEOに強く、多くのトピックを網羅しているため、AIにとっても「使い勝手の良い」情報源となっている。

この結果から、無料版ユーザーをターゲットにする場合、自社サイトの強化だけでなく、有力な外部メディアに掲載されること(デジタルPR)が依然として重要であることがわかる。AIは権威あるメディアが書いた「まとめ記事」を、信頼できるショートカットとして利用しているからだ。

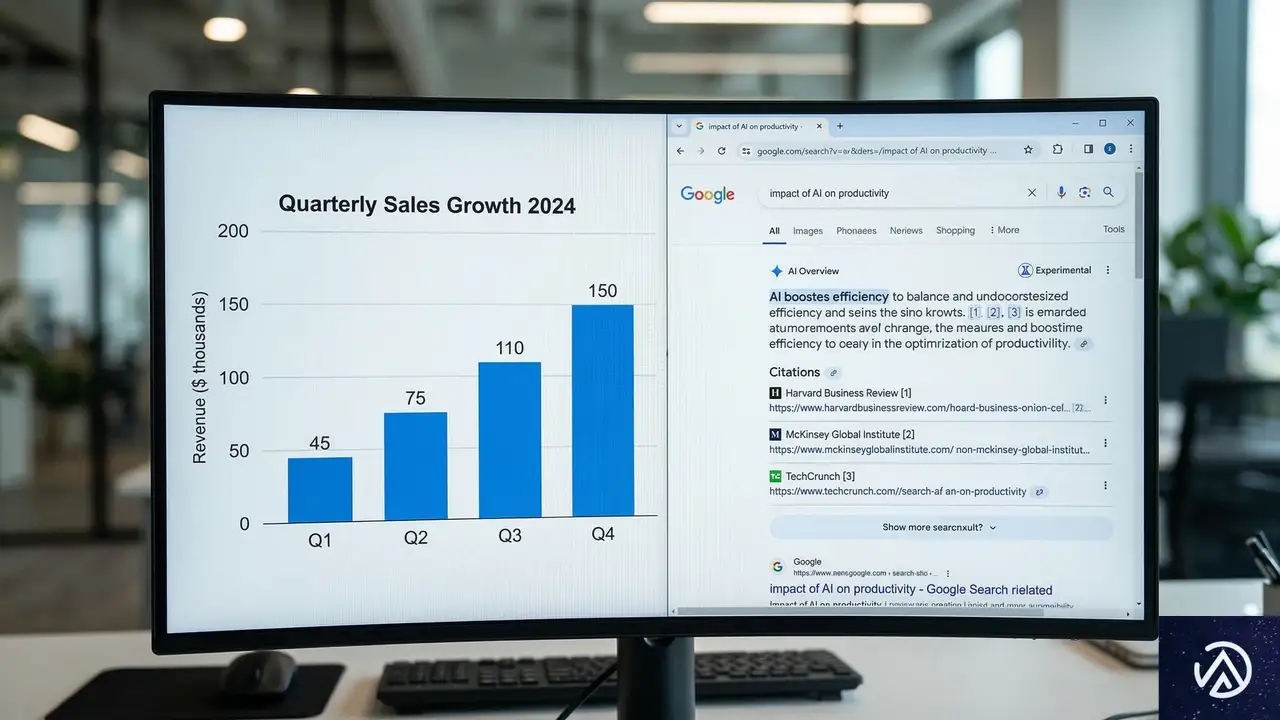

プレミアムモデルが狙い打つ「価格・製品ページ」

一方、GPT-5.4はブランドのトップページ(22%)、価格ページ(19%)、製品詳細ページ(10%)をダイレクトに引用する。特に価格情報に関しては顕著で、GPT-5.3が全調査中わずか4回しか価格ページを引用しなかったのに対し、GPT-5.4は138回も引用している。

ここで重要な示唆がある。価格情報を「問い合わせ」の裏側に隠している(ゲートコンテンツにしている)ブランドは、GPT-5.4による比較検討の対象から外されるリスクがあるということだ。AIが直接価格ページを見つけられない場合、そのブランドは「情報欠落」として、比較表の中で不利な扱いを受ける可能性がある。

従来のSEO(Google/Bing)との相関関係

AI検索の結果は、従来の検索エンジンの順位とどの程度連動しているのだろうか。調査では、SerpAPIを使用してGoogleおよびBingの検索結果との重複度合いを測定している。

Google検索順位が通用するモデルと通用しないモデル

GPT-5.3の場合、引用したドメインの47%がGoogleの検索結果にも含まれていた。これは、デフォルトモデルがGoogleのランキングアルゴリズムにある程度依存している、あるいは類似の評価指標を用いていることを示している。つまり、従来のSEO対策は、無料版ChatGPTの引用獲得にも一定の効果があると言える。

しかし、GPT-5.4では状況が一変する。引用されたドメインの75%が、GoogleやBingの検索結果には現れなかったのだ。これは、GPT-5.4が従来の検索エンジンの「1ページ目」に縛られず、独自のクエリ(前述のsite:演算子など)によってWebの深部まで探索していることを意味する。検索順位が低くても、情報の網羅性や構造が優れていれば、プレミアムAIに発見されるチャンスがあるということだ。

AI検索最適化(LLMO)の新たな指針

LLMO(Large Language Model Optimization / 大規模言語モデル最適化)とは、AIに自社の情報を正しく理解・引用してもらうための施策だ。今回の調査結果から、LLMOには2つの方向性があることが見えてきた。1つは、メディア露出を増やしてGPT-5.3のようなモデルに「評判」を伝えること。もう1つは、自社サイトの構造を整理し、GPT-5.4のようなモデルが`site:`検索で見つけやすい「事実(価格、仕様、FAQ)」を明示することだ。

特に、構造化データ(Schema.orgなど)の活用や、プレーンテキストでの明確な情報記述が重要になる。AIは派手なデザインよりも、クローラが解析しやすい「整理されたデータ」を好むからだ。プレミアムユーザーという、購買意欲の高い層にリーチするためには、この「AIフレンドリーなサイト構造」が欠かせない。

企業が今取り組むべきAI時代の情報発信

ChatGPTの挙動がモデルによって異なる以上、企業は多角的なアプローチを取らざるを得ない。具体的にどのようなアクションが必要になるのか、Web制作・運用の現場視点で考察する。

自社サイトの一次情報を「AIに見つけやすく」整える

まず優先すべきは、プレミアムモデル(GPT-5.4)への対応だ。彼らは公式サイトの深い階層まで情報を探しに来る。そのため、これまで「PDFの中」や「JavaScriptによる動的表示」に隠れていた重要な仕様や価格情報を、HTMLとしてクローラブルな状態で公開することが推奨される。

また、`utm_source=chatgpt.com` というパラメータが自動で付与される傾向があるため、GoogleアナリティクスなどでAI経由の流入を正確にトラッキングすることが可能だ。どのページがAIに引用され、コンバージョンに繋がっているかを分析し、そのページの情報の鮮度を常に高く保つ運用が求められる。

外部メディア露出による信頼性の担保

次に、デフォルトモデル(GPT-5.3)への対応として、第三者メディアでのポジティブな言及を増やす必要がある。AIは「世間一般ではどう評価されているか」をメディアの記事から学習する。自社サイトで「最高だ」と主張するだけでなく、TechRadarやForbesのような権威あるドメインで紹介されることが、AI検索における「信頼の裏付け」となる。

これは従来のデジタルマーケティングや広報活動の延長線上にあるが、AI時代においては「検索順位を上げるため」だけでなく、「AIの回答の根拠(エビデンス)になるため」という新しい目的が加わることになる。メディア記事は、AIにとっての「知識の要約」として機能し続けるだろう。

この記事のポイント

- ChatGPTのプレミアムモデル(GPT-5.4)は、引用元の56%がブランド公式サイトであり、一次情報を重視する傾向が強い。

- デフォルトモデル(GPT-5.3)は、引用元の多くを第三者メディア(ブログやニュースサイト)に依存しており、ブランドサイトの引用はわずか8%である。

- GPT-5.4は`site:`演算子や平均8.5回のサブクエリを駆使し、従来の検索順位に依存しない独自の探索を行っている。

- 企業は、AIに見つけられやすいように価格や仕様などの情報をHTMLで明示し、かつ外部メディアでの露出を増やす「ハイブリッドな対策」が求められる。

- ChatGPTからの流入はUTMパラメータで計測可能なため、データに基づいたAI検索最適化(LLMO)の改善サイクルを回すことが重要である。

出典

- Search Engine Journal「ChatGPT’s Default & Premium Models Search The Web Differently」(2026年3月12日)

- Writesonic「ChatGPT Citation Study: GPT-5.4 vs GPT-5.3」(2026年3月発表)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google検索の変容:AI Modeの自己引用増加とAsk Maps、ブランドクエリ機能の全容

Google検索の環境が、AIの導入によって急速に変化している。AI Modeにおける自己引用の増加や、Googleマップへの対話型AI「Ask Maps」の搭載など、ユーザーとウェブサイトの接点に変容を迫るアップデートが相次いでいる。これらの変更は、企業のウェブマーケティング戦略に直接的な影響を与えるものだ。

SE Rankingの最新調査によれば、GoogleはAI Modeにおいて自社プロパティへのリンクを9ヶ月前の3倍に増やしたという。また、Search Consoleではブランドクエリの自動フィルタリング機能が全ユーザーに開放された。検索エンジンが「情報の仲介者」から「回答の提供者」へと進化する中で、SEOのあり方も再定義が求められている。

本記事では、Googleが進める最新のAI施策と、検索結果におけるリンクの動向、そして新たに導入された分析ツールの活用法について詳しく解説する。検索ユーザーが自社サイトに到達するまでの「距離」がどのように変化しているのか、その実態を明らかにする。

Google AI Modeの自己引用が3倍に増加

Googleの「AI Mode」において、Google自身のサービスやコンテンツを引用する割合が急増している。SE Rankingが公開した第3回調査レポートによると、自己引用の割合は全引用の7%から21%へと上昇した。これは、AIが生成する回答の5つに1つがGoogle内部へのリンクであることを意味する。

外部サイトへのトラフィック流出を抑制する構造

かつての自己引用は、主に「Googleビジネスプロフィール」へのリンクが中心であった。しかし、今回の報告によれば、現在はGoogle自身のオーガニック検索結果ページへのリンクが増加している。ユーザーを外部のウェブサイトへ送り出すのではなく、Googleのエコシステム内に留める動きが強まっていると著者は指摘している。

エコシステムとは、複数のサービスが連携し、ユーザーがその枠組みの中で完結できる仕組みを指す。Googleの場合、検索、マップ、YouTube、ビジネスプロフィールなどがこれに該当する。AI Modeが外部サイトではなく自社の検索結果を引用することで、ユーザーの検索体験はGoogle内で完結しやすくなる。

ローカルSEO以外への影響拡大

SE Rankingのブランド責任者であるモーディ・オバースタイン氏は、この傾向がローカル検索(地域に根ざした検索)に限定されない点に警鐘を鳴らしている。自己引用の17%がGoogle自身に向けられており、これは他のどの情報源よりも多い数字だ。この現象は、情報の「循環参照」のような状態を作り出しているとの見方もある。

企業にとっては、AI Modeが普及するほど、自社サイトへのクリック機会が減少するリスクがある。特に、事実確認や単純な情報の検索においては、AIがGoogle内部の情報を優先して表示するため、外部メディアやブログ記事への流入が制限される可能性がある。

Googleマップに搭載された「Ask Maps」の衝撃

Googleは、GoogleマップにGemini(ジェミニ)を活用した対話型AI機能「Ask Maps」を導入した。これにより、ユーザーは自然な言葉で場所に関する質問を投げかけ、地図上で直接推奨事項を受け取ることが可能になった。現在は米国とインドで先行リリースされている。

自然言語による場所の発見

Ask Mapsは、Googleが保有する膨大な場所のデータベースとユーザーレビューを基に回答を生成する。「週末に子供連れで行ける、静かなカフェを教えて」といった複雑な要望に対しても、文脈を理解した提案を行う。回答はユーザーの検索履歴や保存済みの場所に基づいてパーソナライズされる仕組みだ。

パーソナライズとは、個々のユーザーの好みや行動に合わせて情報を最適化することを指す。これにより、同じ質問をしてもユーザーごとに異なる最適な結果が表示されるようになる。従来の「キーワード検索」から「対話による探索」へと、ローカル情報の探し方が大きく変わろうとしている。

ビジネスオーナーに求められる対応

この変化は、質の高いレビューや詳細なビジネスプロフィールを維持してきた企業にとって、新たな露出のチャンスとなる。従来のリスト形式の表示では埋もれていた店舗も、AIがユーザーの要望に合致すると判断すれば、対話の中で優先的に紹介される可能性があるからだ。

一方で、Googleがどのような基準で推奨するビジネスを選択しているのか、その詳細は明らかにされていない。また、将来的にこの推奨枠が広告として販売される可能性についても、現時点では言及されていない。企業は、AIに正しく情報を認識させるために、構造化データの整備や最新情報の更新をより徹底する必要がある。

マルチモーダルAIによる音声・動画の直接インデックス

Googleの検索部門責任者であるリズ・リード氏は、AIが文字情報だけでなく、音声や動画の内容を直接理解できるようになったと述べている。これまでの検索エンジンは、主にタイトルや書き起こし(トランスクリプト)に頼って動画や音声をインデックスしていたが、その技術的制約が解消されつつある。

「内容」そのものを理解するインデックス

マルチモーダルAIとは、テキスト、画像、音声、動画といった異なる種類の情報を同時に処理・理解できるAIを指す。リード氏によれば、Googleはこの技術を用いることで、動画の視覚的な内容や音声のニュアンス、話の深みを直接解析できるようになった。これにより、メタデータが不十分だったポッドキャストや動画コンテンツの視認性が向上する見込みだ。

Web Performance Toolsの共同創設者であるスロボダン・マニッチ氏は、この変化を「Googleが動画を視聴し、ポッドキャストを聴くことを学習している」と表現した。単なる文字起こしではなく、コンテンツの本質的な意味やスタイルをAIが把握することで、検索結果の精度は飛躍的に高まると指摘されている。

購読状況を考慮したランキングの可能性

リード氏はまた、有料壁(ペイウォール)があるコンテンツの扱いについても言及した。将来的にGoogleは、特定のパブリッシャーをすでに購読しているユーザーに対して、その有料コンテンツを検索結果の上位に表示させる可能性があるという。これは、アクセス権のないユーザーには価値が低いとされていた有料記事が、既存顧客にとっては価値ある情報として再評価されることを意味する。

この仕組みが実現すれば、サブスクリプションモデルを採用しているメディア企業にとって大きなメリットとなる。検索エンジンが「誰がどのサービスを契約しているか」を認識し、それに基づいて結果を出し分けることで、既存ユーザーのエンゲージメント向上に寄与するからだ。

Search Consoleのブランドクエリフィルタが全公開

Googleは、Search Consoleにおいて「ブランドクエリ」と「非ブランドクエリ」を自動で分類するフィルタ機能を、すべての対象サイトに開放した。この機能はAIを活用しており、サイト運営者が手動で設定することなく、自社名を含む検索とそれ以外を分けることができる。

AIによる自動分類の精度と限界

このフィルタの最大の特徴は、ブランド名のスペルミスや製品名のみの検索も自動的に「ブランドクエリ」として認識する点にある。Googleの検索アドボケイトであるジョン・ミューラー氏は、コミュニティからの質問に対し、現時点ではサイト所有者がどのクエリをブランドとして扱うかをカスタマイズする計画はないと回答している。

「正規表現(Regex)」などの複雑なフィルタ設定を使わずに、ワンクリックでトラフィックの質を分析できるようになった意義は大きい。正規表現とは、特定の文字列のパターンを指定して検索や置換を行う手法だが、非エンジニアにはハードルが高いものだった。今回の自動化により、分析の民主化が進むと言える。

SEO成果の透明化

『Product-Led SEO』の著者であるイーライ・シュワルツ氏は、この機能によってSEOチームが「非ブランドクエリ」での成果をより明確に示せるようになると述べている。一方で、ブランド力に頼った流入をSEOの成果として報告していたケースでは、その実態が浮き彫りになるという側面もある。

成長が新しい発見(非ブランド)によるものなのか、それとも既存の知名度(ブランド)によるものなのかを峻別することは、戦略の立案において極めて重要だ。このフィルタを活用することで、真の新規顧客獲得に向けた改善ポイントがより明確になるだろう。

分析:検索からサイトへの距離が広がる時代

今週の一連のアップデートを俯瞰すると、共通のテーマが浮かび上がる。それは、ユーザーが検索を開始してから特定のウェブサイトに到達するまでの「ステップ」が増加し、距離が遠のいているという事実だ。1年前であれば、検索結果のリンクを直接クリックしていた行動が、現在はAIによる中間プロセスに置き換わりつつある。

AIが「情報の門番」になるリスク

AI Modeでの自己引用の増加やAsk Mapsの導入は、Googleが情報の「仲介者」から、自ら回答を提示する「コンシェルジュ」へと変貌していることを示している。ユーザーにとっては利便性が高まる一方で、コンテンツ制作者にとっては、自社のドメインにユーザーを呼び込む難易度が上がっているのが現状だ。

また、リズ・リード氏が語った「コンテンツの深い評価」も、Googleがユーザーに情報を提示するかどうかを決定する前の「検閲」に近い役割を果たしているとの見方もある。AIがコンテンツの質を直接判断し、その上でGoogle自身のサービスを優先的に引用する構造は、オープンなウェブのあり方に一石を投じている。

企業が取るべき新たな生存戦略

このような状況下で企業が注力すべきは、AIに「引用されるに値するブランド」としての地位を確立することだ。Search Consoleのブランドクエリフィルタが示すように、GoogleはすでにブランドをAIで識別している。単なるキーワード対策ではなく、ブランド名そのものが検索されるような認知度の向上や、AIが理解しやすい形式での情報発信が不可欠となる。

具体的には、音声や動画コンテンツの拡充、構造化データの正確な実装、そしてサードパーティのレビューサイトにおける高評価の獲得などが挙げられる。検索エンジンとの付き合い方が「クリックを待つ」ことから「AIの知識源として選ばれる」ことへとシフトしていることを、マーケターは認識すべきである。

この記事のポイント

- Google AI Modeの自己引用率が21%に達し、Google内部へのトラフィック循環が強まっている。

- Googleマップの「Ask Maps」導入により、ローカル検索が対話型AIによる探索へと進化している。

- マルチモーダルAIの進化で、音声や動画の内容が直接インデックスされ、検索の対象が広がっている。

- Search Consoleのブランドクエリフィルタが全ユーザーに開放され、トラフィックの質の分析が容易になった。

- 検索ユーザーとウェブサイトの距離が広がる中、AIに選ばれるためのブランド構築と多角的なコンテンツ発信が重要だ。

出典

- Search Engine Journal「AI Mode Data, Ask Maps & Branded Queries Go Live – SEO Pulse」(2026年3月13日)

- SE Ranking「Google Links in AI Mode Answers: 3rd Report」(2026年3月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google AI Modeの自己引用が3倍に。検索・マップ・GSCの最新アップデートを解説

Googleの検索体験がAIによって急速に変容している。最新の調査報告によれば、AI ModeにおけるGoogle自身のプロパティへの引用率が、過去9ヶ月で大幅に増加したことが明らかになった。

2026年3月、GoogleはAIを活用した対話型検索「Ask Maps」の導入や、検索コンソールにおけるブランドクエリフィルタの全ユーザー開放など、重要なアップデートを立て続けに実施した。これらの変更は、Webサイトへのトラフィック流入経路に大きな影響を与える可能性がある。

本記事では、Google検索の責任者が語ったマルチモーダルAIによる音声・動画のインデックス化や、検索結果のパーソナライズ化の展望を含め、SEO担当者が今把握すべき重要事項を解説する。

Google AI Modeの自己引用率が21%に上昇

SE Rankingが発表した第3回「Google AI Mode引用レポート」によると、GoogleがAI Modeの回答内で自社プロパティへリンクを貼る割合が急増している。9ヶ月前には全引用の7%に過ぎなかった自己引用率が、現在は21%に達しているという。

外部サイトへの流入減少への懸念

AI Modeの引用のうち、5回に1回は外部のWebサイトではなく、Google自身のページに向けられている計算だ。これは、AI Overviews(AIによる概要表示)で見られた傾向と同様に、Googleがユーザーを自社のエコシステム内に留めようとする戦略を強化していることを示唆している。

SE Rankingのブランド責任者であるモーディ・オーバースタイン氏は、この現状を「巨大な循環」と表現している。同氏によれば、全引用の17%がGoogle自身に向けられており、他のどの情報源よりも高い割合を占めている。

ローカル検索からオーガニック検索への誘導シフト

以前の自己引用は、主にGoogleビジネスプロフィールのリスティング(店舗情報など)に向けられていた。しかし、今回の調査ではGoogle自身のオーガニック検索結果ページへのリンクが増加している。

これは、AIが回答の根拠として特定のWebサイトを個別に紹介するのではなく、「詳細はGoogleで検索してください」という形で自社の検索結果へユーザーを戻していることを意味する。結果として、個別のパブリッシャーが獲得できるトラフィックが減少するリスクがある。

GoogleマップにAI対話機能「Ask Maps」が登場

Googleは、Geminiを活用した対話型AI機能「Ask Maps」をGoogleマップに導入した。ユーザーは自然な言葉で場所について質問し、マップ上でおすすめの提案を受け取ることができる。

レビューとプロフィールの重要性が再定義される

Ask Mapsは、Googleが保有する膨大な場所のデータベースとユーザーレビューを基に回答を生成する。従来の「キーワード一致」によるリスト表示ではなく、文脈を理解した推薦が行われるのが特徴だ。

例えば「静かで作業に適した、Wi-Fiのあるカフェ」といった複雑な要望に対しても、レビュー内容を解析して最適な場所を提示する。店舗運営者にとっては、良質なレビューの獲得とビジネスプロフィールの充実が、AIに推奨されるための必須条件となるだろう。

パーソナライズ化による検索体験の変化

この機能は現在、米国とインドで提供されている。回答はユーザーの検索履歴や保存済みの場所に基づいてパーソナライズされるため、ユーザーごとに異なる結果が表示される。

ただし、Googleはどのような基準で特定のビジネスを優先的に推薦しているのか、その詳細なアルゴリズムは公開していない。また、将来的にこの推薦枠の中に広告(有料の配置)が含まれるかどうかも現時点では不明だ。

音声と動画の「直接理解」によるインデックスの進化

Googleの検索責任者であるエリザベス・リード氏は、AIがコンテンツをどのように理解し、インデックス(検索エンジンに登録すること)を行っているかの変化について言及した。

マルチモーダルAIが文字起こしを超越する

リード氏によれば、マルチモーダルLLM(大規模言語モデル)の導入により、Googleは音声や動画のコンテンツを直接処理できるようになった。マルチモーダルAIとは、テキストだけでなく画像、音声、動画など複数の種類の情報を同時に処理できるAIのことだ。

これまでのGoogleは、主に動画のタイトルや説明文、あるいは自動生成されたトランスクリプト(文字起こし)に頼って内容を把握していた。しかし現在は、動画内の視覚的な変化や音声のトーン、内容の深さをAIが直接「視聴」して理解しているという。これにより、これまで検索結果で過小評価されていたポッドキャストや動画コンテンツの露出が増える可能性がある。

サブスクリプション購読者向けの優先表示

リード氏は、将来的な展望として「サブスクリプションを認識したランキング」についても触れた。これは、特定のニュースサイトなどを有料購読しているユーザーに対し、そのサイトのコンテンツを検索結果の上位に表示する仕組みだ。

通常、ペイウォール(有料の壁)があるコンテンツは、多くのユーザーがアクセスできないため検索順位が上がりにくい傾向にある。しかし、購読者であることをGoogleが認識できれば、そのユーザーにとって価値の高い情報を優先的に届けることが可能になる。

サーチコンソールのブランドクエリフィルタが全ユーザーに開放

Google検索コンソール(GSC)において、ブランドクエリと非ブランドクエリを自動で分類するフィルタ機能が、すべての対象サイトで利用可能になった。

AIによる自動分類と精度の向上

このフィルタはAIを用いて、ユーザーの検索語句を「ブランド名を含むもの」と「それ以外」に自動で仕分けする。特筆すべきは、ブランド名のタイポ(打ち間違い)や、製品名のみの検索も自動的にブランドクエリとして認識する点だ。

これまでは、ブランドトラフィックを除外するためにREGEX(正規表現)を用いた複雑なフィルタ設定が必要だった。REGEXとは、文字列のパターンを指定して検索や置換を行う手法のことだ。新機能により、専門知識がなくても純粋な新規顧客の流入(非ブランドトラフィック)を正確に把握できるようになる。

戦略的なトラフィック分析の効率化

「Product-Led SEO」の著者であるイーライ・シュワルツ氏は、このアップデートによりSEOチームが「非ブランド領域での貢献」を明確に示せるようになると指摘している。

一方で、ブランドの知名度だけに頼ったトラフィック増加を「SEOの成果」として報告することが難しくなる側面もある。企業にとっては、純粋な検索需要(悩みや目的による検索)に対して自社サイトがどれだけ応えられているかを、より厳密に評価するツールとなるだろう。

独自分析:検索ユーザーとWebサイトの「距離」が広がる時代

今回の一連のアップデートを俯瞰すると、共通する一つのテーマが浮かび上がる。それは、ユーザーが検索を開始してからWebサイトに到達するまでの「距離」が物理的にも心理的にも遠くなっているという事実だ。

ゼロクリック検索の加速とブランド認知の重要性

AI Modeの自己引用率増加やAsk Mapsの導入は、ユーザーがGoogleのインターフェース内で完結する「ゼロクリック検索」を加速させる。ユーザーはWebサイトを訪れることなく、AIとの対話だけで解決策を得てしまうからだ。

このような環境下では、従来の「キーワードで上位表示してクリックを待つ」というモデルだけでは不十分だ。AIが回答の根拠として自社を「認識」し、推奨してくれる状態を作らなければならない。

今後は、直接的なトラフィックだけでなく、AIの回答に含まれる「ブランドの言及」や「推奨」をKPI(重要業績評価指標)に含める視点が必要になるだろう。また、リード氏が語ったように、動画や音声、さらにはサブスクリプションモデルとの連携など、テキスト以外のチャネルを統合したSEO戦略が、Webサイトの生存戦略において鍵となる。

この記事のポイント

- Google AI Modeの自己引用率が21%に上昇し、Google自身へのトラフィック誘導が強まっている。

- 「Ask Maps」の導入により、Googleマップでの検索が対話型かつパーソナライズされたものへ進化している。

- マルチモーダルAIの進化で、動画や音声コンテンツがテキストを介さず直接インデックスされるようになりつつある。

- 検索コンソールのブランドクエリフィルタにより、ブランド認知による流入と純粋なSEO成果の切り分けが容易になった。

- ユーザーがサイトへ到達する前にAIが回答を完結させる傾向が強まっており、ブランドの「言及」を増やす戦略が重要視される。

出典

- Search Engine Journal「AI Mode Data, Ask Maps & Branded Queries Go Live – SEO Pulse」(2026年3月13日)

- SE Ranking「Google Links in AI Mode Answers: Third Report」(2026年3月)

- Access Podcast「Interview with Elizabeth Reid, Head of Google Search」(2026年3月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

Google Discover 2026年コアアップデート分析:地域メディアの全国リーチ減少と大手サイトの苦戦

Google Discover(グーグル・ディスカバー)の2026年2月コアアップデート完了後、パブリッシャー間の明暗が鮮明になっている。今回のアップデートは、ユーザーの所在地に基づいた「情報の最適化」をより強力に推し進めるものとなった。

最新の調査データによると、地域メディアが地元以外のユーザーに表示される割合が急落している。これは、GoogleがDiscoverにおける「地域性」の定義を再定義した結果と考えられる。

この記事では、複数の分析ツールが示したデータに基づき、今回のアップデートがWebサイトのトラフィックにどのような影響を与えたのかを解説する。

Google Discover 2026年2月コアアップデートの概要

Google Discoverとは、ユーザーの検索履歴やブラウジング習慣に基づいて、関心がありそうな記事を自動的に表示する機能だ。検索キーワードを入力せずに情報が届くため、Webサイト運営者にとっては爆発的なアクセス(通称:Discover砲)の源泉となっている。

2026年2月に実施されたコアアップデートは、このレコメンドエンジンの心臓部を刷新するものだった。Googleは公式に「その国や地域に関連性の高いコンテンツをより多く表示する」と発表していたが、その実態は予想以上にドラスティックなものとなっている。

コアアップデートがもたらす変化

コアアップデートとは、Googleが検索アルゴリズムやシステムに対して行う大規模な変更を指す。Discoverにおけるアップデートは、単なる「質の向上」だけでなく、「誰にどの情報を届けるか」というマッチング精度の調整が主眼に置かれる。

今回のアップデートでは、特に「E-E-A-T(Experience:経験、Expertise:専門性、Authoritativeness:権威性、Trustworthiness:信頼性)」の指標がより厳格に適用されたとの見方が強い。しかし、後述するように一部のデータではその原則に反するような挙動も確認されている。

米国での先行導入と今後の展開

現在、このアップデートの影響を強く受けているのは、米国内の英語ユーザーだ。Googleは今後、他の言語や地域にもこの仕組みを順次拡大していく予定としている。日本のWebサイト運営者にとっても、対岸の火事ではなく、近い将来の標準となるアルゴリズムの変化として注視する必要がある。

地域メディアに起きた「リーチの局所化」という異変

今回のアップデートで最も顕著な影響を受けたのが、特定の地域に根ざした情報を発信するローカルパブリッシャーだ。これまでは良質な記事であれば全米規模でDiscoverに表示されていたが、その「全国リーチ」が遮断されつつある。

地元ユーザーは維持、他県ユーザーは激減

分析データによると、ニューヨーク州の地元メディア「Syracuse.com」は、記事の掲載数が36%減少し、オーディエンススコア(読者の反応率)は全体で80%も下落した。しかし、詳細な内訳を見ると、ニューヨーク州内での露出は安定していたという。

大幅な下落を招いた要因は、フロリダ州やカリフォルニア州など、そのメディアの拠点から離れた地域での露出がほぼゼロになったことにある。これは、Googleが「その地域のニュースはその地域の人に届ける」という、情報の地産地消をアルゴリズムで強制的に強化した結果といえる。

「情報の地産地消」がSEOに与える意味

この変化は、地域メディアにとって必ずしもマイナスではない。遠方のユーザーによる「クリックだけしてすぐに離脱する」という質の低いトラフィックが減り、地元のコアな読者への占有率が高まる可能性があるからだ。

ただし、広域からのアクセスを収益の柱にしていたメディアにとっては、ビジネスモデルの再考を迫られる事態となっている。コンテンツのターゲット設定を「誰に」だけでなく「どこに住んでいる人に」まで踏み込んで設計することが、今後のDiscover対策の肝となる。

大手パブリッシャーとSNSが直面した厳しい現実

影響を受けたのは地域メディアだけではない。YahooやForbes、Fox Newsといった、膨大なトラフィックを誇る大手パブリッシャーも大きな打撃を受けている。

YahooやForbesの20%以上の露出低下

調査レポートによると、YahooはDiscoverでの記事掲載数を約半分に減らし、オーディエンススコアは62%も低下した。ランキング順位も3位から9位へと大きく後退している。Forbesも同様に掲載数が21%減、スコアは67%減と、壊滅的な数字を記録した。

これらの大手サイトは、幅広いジャンルの記事を大量に投稿することで、Discoverの広範な枠を占有してきた。しかし、Googleは「汎用的なポータルサイト」よりも「特定のトピックに特化した専門サイト」を優先する傾向を強めており、その煽りを受けた形だ。

X(旧Twitter)の掲載順位とタイミングの相関

SNSプラットフォームであるX(旧Twitter)の動向も興味深い。アップデートの途中経過では掲載順位を上げていたが、完了後のデータでは記事掲載数が22%減少、オーディエンススコアも32%低下している。

これは、Discoverにおける「情報の鮮度」と「信頼性」のバランスが再調整されたことを示唆している。速報性のあるSNS投稿が一時的に浮上しても、最終的には校閲された記事コンテンツが優先される仕組みが強化されたとの見方がある。

データから読み解く勝者と敗者の分岐点

一方で、今回のアップデートで明確にシェアを伸ばした勢力も存在する。その筆頭がYouTubeだ。

YouTubeのシェア拡大とGoogleの意図

アップデート完了後の窓口において、YouTubeの掲載数は15%増加し、約1万8,000件に達した。Googleは自社のプラットフォームをコアアップデートの悪影響から保護する傾向があるとの指摘もあるが、それ以上に「動画コンテンツ」へのユーザーニーズに応えた結果と見るのが妥当だろう。

Discoverのフィードをスクロールすると、以前よりもショート動画やYouTube動画のカードが目に付くようになっている。テキスト主体のメディアは、動画を記事内に埋め込む、あるいはYouTubeチャンネルとの連携を強めるなどの対策が不可避となっている。

「Psychology says」現象に見るアルゴリズムの隙

特筆すべき例外として、「Geediting.com」というサイトが掲載数を531%、オーディエンススコアを900%も爆発的に伸ばした事例がある。このサイトの記事の75%以上は、タイトルが「Psychology says(心理学によれば)」で始まっている。

本来、Googleが推奨するE-E-A-Tの観点からは、このようなパターン化されたタイトルや、専門家による厳密な裏付けが不明瞭なコンテンツは評価されにくいはずだ。しかし、データはこのサイトが「勝者」であることを示している。これは、アルゴリズムが「ユーザーが思わずクリックしてしまう心理的なフック」を、依然として強く評価している可能性を示唆している。

独自の分析:今後のDiscover対策で意識すべき3つのポイント

今回のデータ分析を踏まえ、Web制作会社やマーケティング担当者が今後取り組むべき戦略を3つのポイントにまとめた。

1. ターゲット地域の明確化とローカルタグの活用

地域メディアや店舗ブログを運営している場合、記事内で対象地域を明示することが重要だ。HTMLのメタデータや構造化データ(Schema.org)を用いて、そのコンテンツがどの地域に関連するものかを検索エンジンに正しく伝える必要がある。

「全国の誰かに届けばいい」という曖昧な姿勢ではなく、「特定の地域の人にとって不可欠な情報」を目指すことが、結果としてDiscoverでの安定した露出につながるだろう。

2. 動画コンテンツとのシナジー

YouTubeの露出増は、Googleの明確な意思表示だ。ブログ記事を書くだけでなく、その要約を動画にしてYouTubeにアップロードし、記事内に埋め込む手法が有効だ。

動画とテキストの両方を用意することで、Discoverの「ウェブ枠」と「動画枠」の両方にエントリーできる可能性が高まる。これは、トラフィックの入り口を多角化する上で極めて強力な武器になる。

3. クリック率と読了率のバランス

「Psychology says」の事例が示す通り、魅力的なタイトル(クリック率の向上)は依然としてDiscoverの強力なトリガーだ。しかし、クリックした後の体験が伴わなければ、長期的にはドメイン全体の評価を落とすリスクがある。

ユーザーの興味を惹くフックを用意しつつ、中身ではしっかりと専門性と信頼性(E-E-A-T)を担保する。この「入り口の親しみやすさ」と「出口の満足度」の両立が、2026年以降のDiscover運用のスタンダードになるだろう。

この記事のポイント

- 2026年2月のコアアップデートにより、地域メディアの「地元以外」での露出が激減した。

- YahooやForbesなどの大手サイトも、汎用的な内容が災いして20%以上の掲載減となった。

- YouTubeなどの動画コンテンツは露出を伸ばしており、動画活用がDiscover攻略の鍵となる。

- 「心理学によれば」といった引きの強いタイトルが依然として効果を発揮している側面もある。

- 今後の対策は、ターゲット地域の明確化と、動画とテキストを組み合わせた多角的な発信が重要だ。

出典

- Search Engine Journal「Google Discover Core Update Data: Local Publishers Lost Reach」(2026年3月13日)

- DiscoverSnoop「Google Discover Core Update Feb 2026: Winners, Losers, and Unexpected Outcomes」(2026年3月10日)

- Google Search Central Blog「What publishers should know about Discover core updates」(2026年2月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

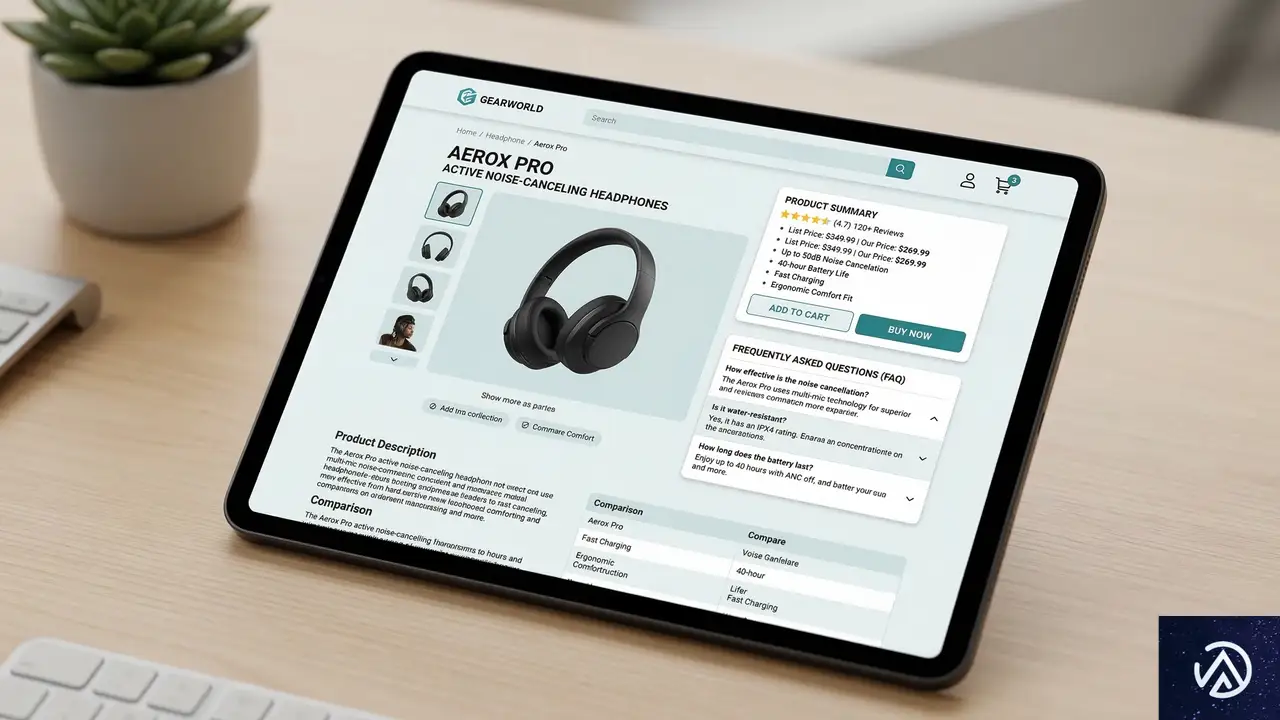

AI時代の検索対策「GEO」とは?引用されるコンテンツの共通点とECサイトの活用法

検索エンジンのあり方が、従来のリスト形式から生成AIによる回答形式へと急速に変化している。Googleの「AIによる概要(旧SGE)」やPerplexity、ChatGPTのサーチ機能など、ユーザーが直接回答を得る機会が増えた。

こうした「生成AIエンジン」に自社の情報を引用させ、トラフィックを獲得する手法はGEO(Generative Engine Optimization)と呼ばれる。最新の研究により、AIがどのような基準でウェブサイトの情報を引用しているのか、その具体的な手がかりが明らかになった。

本記事では、2つの大規模な調査データを基に、AIに選ばれるコンテンツの構造を分析する。特に情報量が多くなりがちなECサイトや技術ブログにおいて、明日から取り入れられる最適化の指針を提示する。

AIによる引用のメカニズムと最新の研究結果

生成AIが回答を生成する際、どのウェブサイトを情報源として参照し、リンク(引用)を掲示するかには一定のパターンが存在する。これまでブラックボックスとされていたこの仕組みについて、2つの重要な研究が発表された。

ChatGPTとGeminiの引用傾向の違い

オーガニック検索コンサルタントのケビン・インディグ氏は、ChatGPTによる120万件の回答と1万8,012件の引用を分析した。一方で、Bright Dataのダニエル・シャシュコ氏は、GrokやGeminiを含む6つのプラットフォームを対象に4万2,971件の引用を調査している。

調査の結果、プラットフォームによって引用の積極性に大きな差があることが分かった。例えば、X(旧Twitter)傘下のGrokは1クエリあたり平均33件もの引用を行うのに対し、ChatGPTはわずか1.5件にとどまる。AIモデルによって、情報の裏付けをどの程度詳細に示すかのアルゴリズムが異なる実態が浮き彫りになった。

引用元として選ばれる「場所」の重要性

両氏の研究で共通して導き出された結論は、情報の「掲載位置」が引用の成否を分けるという点だ。AIはページ全体を均等に評価するのではなく、特定のエリアを重点的にスキャンしている。

ケビン氏の調査では、ChatGPTの引用の44.3%がページ内のテキストの最初の30%から抽出されていた。ダニエル氏の調査でも、GeminiやGoogleのAIモードにおける引用の74.8%がページの半分より上部に集中し、そのうち46.1%が最初の30%に含まれていた。

この結果は、結論を後回しにする伝統的な起承転結の文章構造が、AI時代には不利に働く可能性を示唆している。ユーザーだけでなくAIにとっても、ページを開いてすぐに核心に触れられる構成が望ましい。

「アトミック・ファクト」が握る引用の鍵

AIに引用されやすい文章には、構造的な特徴がある。ダニエル・シャシュコ氏が提唱した「アトミック・ファクト(Atomic Fact)」という概念は、今後のコンテンツ制作において極めて重要な指標となる。

短文で完結する情報の有用性

アトミック・ファクトとは、それ単体で意味が通じ、一つの事実を完結に述べている一文を指す。たとえるなら「一口サイズの栄養補助食品」のようなものだ。前後の文脈に過度に依存せず、独立して情報を伝達できる文章が、AIには好まれる。

調査によると、Geminiなどのプラットフォームで引用された文章の92.4%が、6語から20語(英語基準)の短文であった。日本語に換算すると、概ね40文字から80文字程度の簡潔な一文に相当する。

理想的な文章構造とノイズの排除

AIは文章の途中で引用を開始したり終了したりすることはない。常に「句点から句点まで」の完全な一文を引用単位とする。そのため、一文の中に複数のトピックを詰め込んだ長文や、情緒的で実質的な情報を含まない導入文は、引用の対象から外れやすい。

ECサイトの商品説明であれば、「この商品は〜という特徴があり、さらに〜というメリットも期待でき、多くのユーザーに支持されています」と繋げるのではなく、「この商品は〜という特徴を持つ。〜というメリットがある」と事実を切り分けて記述する方が、AIによる認識精度は高まる。

ECサイトが取り組むべき具体的なGEO対策

WooCommerceなどのプラットフォームを利用しているEC事業者にとって、商品ページやブログ記事をGEOに最適化することは、将来的な集客チャネルの確保に直結する。研究結果を実務に落とし込むための3つのステップを提案する。

商品説明文の構成を「逆ピラミッド型」にする

前述の通り、ページの上部30%が引用の主戦場となる。ECサイトの商品ページであれば、スペック表や主要なメリットの要約を、ページ下部ではなくファーストビューに近い位置に配置すべきだ。

具体的には、商品のキャッチコピーの直後に「この記事のポイント」や「商品の3つの特徴」といった要約セクションを設ける。これにより、AIがページをクロールした際に、最も重要な情報を即座にキャッチできるようになる。

ユーザーの疑問に「一文」で答えるFAQの設置

AIサーチを利用するユーザーは、具体的な疑問(例:「このサイズは10畳の部屋に合うか?」)を持って検索する。これに応えるためには、商品ページ内に「アトミック・ファクト」に基づいたFAQ(よくある質問)を設置するのが効果的だ。

「はい、この製品は10畳の広さに対応した設計となっている」といった簡潔な回答文を用意することで、AIの回答内にそのまま引用される確率を高めることができる。冗長な解説はFAQの折りたたみメニュー内や詳細セクションに逃がし、表面上は簡潔さを維持するのがコツだ。

検索エンジン最適化(SEO)と生成AI最適化(GEO)の共存

GEOは従来のSEOを否定するものではない。むしろ、SEOの基本である「ユーザーの意図に応える」という姿勢を、より構造的に、より簡潔に突き詰めた形と言える。

従来のSEOとの共通点と相違点

高品質なコンテンツ、専門性、権威性(E-E-A-T)が重視される点はSEOもGEOも共通だ。しかし、SEOが「キーワードの網羅性」や「滞在時間」を重視する傾向があるのに対し、GEOは「情報の抽出のしやすさ」に重きを置く。

例えば、1万文字の網羅的な記事はSEOでは高く評価されるが、AIがその中から特定の事実を見つけ出すのはコストがかかる。GEOの観点では、長い記事であってもセクションごとに明確な要約があり、アトミック・ファクトが散りばめられている構造が理想的だ。

ブランド認知を高めるための学習データ対策

引用(リンク付きの参照)だけでなく、AIが回答の中で自社ブランドに言及してくれる状態(Visibility)を目指す必要もある。これには、特定のページを最適化するだけでなく、ウェブ上のあらゆる場所でブランド名と特定のキーワードが結びついている状態を作らなければならない。

プレスリリース、SNSでの言及、他社メディアでのレビューなど、AIの学習データに含まれるソース全体で一貫したブランドポジションを確立することが、長期的にはGEOの成果を最大化させる。

この記事のポイント

- AIはページの冒頭30%にある情報を優先的に引用する傾向がある

- 一文で事実が完結する「アトミック・ファクト」を意識したライティングが有効

- 6語〜20語程度の簡潔な文章が、GeminiなどのAIに最も好まれる

- ECサイトでは商品説明の要約やFAQを上部に配置し、AIが情報を抽出しやすくする

- GEOはSEOを補完するものであり、情報の「見つけやすさ」を追求する手法である

出典

- Practical Ecommerce「Studies Reveal AI Citation Clues」(2026年3月9日)

- Growth Memo「The science of how AI pays attention」(2026年3月)

- Bright Data「Platform-by-Platform Optimisation Playbook」(2026年3月)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験

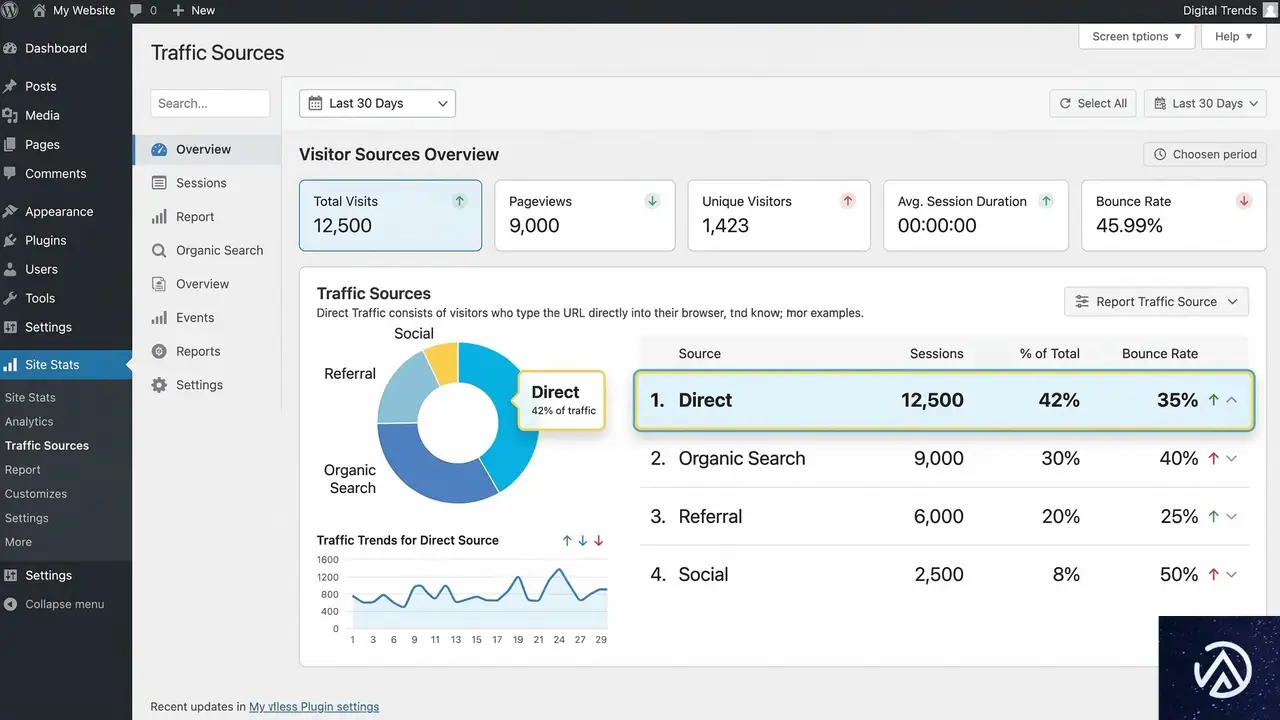

GA4の「Direct」トラフィックの正体——AIの影響と計測の限界を読み解く

Googleアナリティクス4(GA4)において、Direct(直接流入)の増加は必ずしもブランド認知の向上を意味しない。 多くのマーケティング担当者は、Directトラフィックを「ユーザーがURLを直接入力した、またはブックマークから訪問したロイヤリティの高い行動」と解釈している。 しかし、実態は「参照元を特定できなかったトラフィックのゴミ箱」に近い側面がある。

GA4のレポートでDirectが急増している場合、そこにはAIによる回答エンジンやプライバシー保護機能の影響が隠れている。 データの裏側にある技術的背景を理解しなければ、誤った投資判断を下すリスクがある。 本記事では、Directトラフィックが実際に何を計測しているのか、そしてAI時代にどう向き合うべきかを解説する。

GA4におけるDirectトラフィックの定義と実態

GA4において、セッションのソース(流入元)やメディアが特定できない場合、その訪問は自動的に「Direct」として分類される。 一般的には、ブラウザのURLバーに直接ドメインを入力する、あるいはブラウザの「お気に入り」からアクセスする行動がこれに該当する。 有名ブランドであれば、この種の直接訪問が一定数存在するのは自然なことだ。

リファラ情報の欠落が招く「擬似的なDirect」

しかし、実際には「リファラ(Referrer)」と呼ばれる参照元情報が失われたことで、Directに分類されるケースが非常に多い。 リファラとは、ユーザーがどのページからリンクを辿ってきたかを伝える仕組みだ。 例えば、LINEやSlackなどのメッセージアプリ内のリンク、あるいはモバイルアプリ内からWebサイトへ遷移する場合、このリファラ情報が正しく引き継がれないことがある。

また、セキュリティ上の理由でHTTPSサイトからHTTPサイトへ遷移する際も、リファラは送信されない。 このように、ユーザーの意図的な直接訪問ではなく、技術的な制約によって「正体不明」となったアクセスがDirectとしてカウントされている。 これは計測側の限界であり、ユーザーのブランド愛着度を示しているわけではない。

なぜDirectトラフィックの増加を誤読してしまうのか

マーケティングレポートにおいて、Directの増加は「施策が当たって指名検索や直接訪問が増えた」とポジティブに報告されやすい。 経営層やクライアントにとっても、広告費をかけずにユーザーが自発的に訪れる数字は魅力的に映る。 だが、この解釈には大きな落とし穴がある。

キャンペーンタグの不備という技術的要因

Direct急増の裏には、多くの場合、タグ設定のミスが隠れている。 メールマガジンやPDF資料、SNSの投稿に設置したリンクにUTMパラメータが付与されていない場合、それらはすべてDirectとして処理される。 UTMパラメータとは、URLの末尾に追加する「?utm_source=…」といった文字列で、流入元を明示するためのものだ。

特に、複数のチームで運用している場合、タグ付けのルールが統一されていないと計測漏れが発生しやすい。 インフルエンサー施策や有料広告であっても、リンク先のURLが適切に管理されていなければ、その成果はすべてDirectの中に埋もれてしまう。 これは、マーケティング活動の投資対効果(ROI)を正しく評価できない原因となる。

クロスデバイスとカスタマージャーニーの断絶

ユーザーの行動が複雑化していることも、Directトラフィックを複雑にしている。 例えば、スマートフォンで通勤中に検索し、サイトを見つけたユーザーがいたとする。 その後、帰宅してからPCを立ち上げ、ブラウザに社名を入力して購入に至った場合、GA4はこれを「Directによるコンバージョン」と記録することが多い。

実際には最初の検索(オーガニック検索)がきっかけだが、デバイスを跨ぐことで計測の紐付けが途切れてしまう。 この場合、Directは「ロイヤリティの証」ではなく、単なる「最終接触チャネル」に過ぎない。

AIによる「静かなインフレ」とDirectの関係

2026年現在、AI検索やチャット型アシスタントの普及により、Directトラフィックの性質がさらに変化している。 ユーザーがGoogle検索の代わりにAIに質問し、AIが特定のブランドや製品を推奨するシーンが増えた。 この際、AIが提示した情報を元にユーザーが新しいタブを開き、直接ドメインを入力してサイトに訪れる行動が頻発している。

AIアシスタント経由の「ダークサーチ」

AI経由の訪問は、GA4のレポート上では多くの場合、参照元不明のDirectとして現れる。 AIツールがブラウザ内でリンクを生成して誘導する場合でも、従来のような検索エンジンからの流入(Organic Search)としてはカウントされない。 このように、出所が特定できないものの、実際には外部の影響を受けている流入を「ダークサーチ」と呼ぶ。

AIの影響力が強まるほど、オーガニック検索の数字は横ばい、あるいは減少する一方で、Directだけが伸び続ける現象が起きる。 これを「ブランド力が上がった」と単純に喜ぶのは危険だ。 実際にはAIへの露出度(AI Visibility)が高まった結果であり、その因果関係を把握するには別の分析手法が必要になる。

プライバシー保護の強化が計測を不透明にする

近年のプライバシー保護の潮流も、Directトラフィックを増大させる要因となっている。 ブラウザ各社によるトラッキング防止機能(ITPなど)や、ユーザーによるクッキー(Cookie)の拒否設定が、アトリビューション(貢献度)解析を困難にしている。

リファラ情報の削除とURLクリーンアップ

一部のブラウザやメッセージングアプリでは、プライバシー保護のためにURLからトラッキング用のパラメータを自動的に削除する機能を備えている。 これにより、本来なら「広告経由」や「SNS経由」と識別されるべきアクセスが、丸裸のURLとしてサーバーに届くことになる。 結果として、GA4はこれらをDirectとして分類せざるを得ない。

ユーザーの行動自体は変わっていないが、計測システムの「目」が塞がれている状態だ。 今後、プライバシー規制がさらに厳格化される中で、Directトラフィックの比率はさらに高まっていくと予想される。 もはや「Direct=直接訪問」という前提は成り立たない。

Directトラフィックを正しく診断するための実務チェックリスト

Directが急増した際、それが「良い兆候」なのか「計測の不備」なのかを判断するための具体的なステップを紹介する。 単一の指標に惑わされず、複数のデータを掛け合わせることが重要だ。

1. ランディングページの分布を確認する

Direct流入の受け皿となっているページを調査する。 トップページ(/)への流入であれば、直接入力やブックマークの可能性が高い。 しかし、URLが長く複雑な「ブログ記事」や「特定の商品ページ」にDirectが集中している場合、それはメッセージアプリや未計測のキャンペーンからの流入である可能性が極めて高い。

2. 指名検索(ブランド検索)の推移と比較する

Google Search Console(サーチコンソール)を使用し、社名やサービス名での検索クリック数を確認する。 Directトラフィックと指名検索が連動して増えているなら、テレビCMや展示会などのオフライン施策、あるいはAIでの露出によって認知が拡大したと推測できる。 逆に、指名検索が増えていないのにDirectだけが急増しているなら、技術的なタグの欠落を疑うべきだ。

3. ブラウザとデバイスのセグメント分析

特定のブラウザ(例:iOSのSafari)や、特定のアプリ内ブラウザだけでDirectが増えていないかを確認する。 特定の環境だけで増えている場合、それはOSのアップデートによるプライバシー制限や、アプリの仕様変更が原因である可能性が高い。

4. キャンペーンタグ(UTM)の再点検

現在配信しているすべての外部チャネルをリストアップし、UTMパラメータが正しく設定されているかテストする。 特に以下の項目は見落とされやすい。

- メールマガジン内のボタンやテキストリンク

- 公式SNSアカウントのプロフィール欄にあるURL

- カスタマーサポートがチャットで送信するURL

- QRコード経由のアクセス

独自の分析:ECサイトにおけるDirectトラフィックの「意味」

WooCommerceなどのECサイトを運営している場合、Directトラフィックの質を見極めることは売上に直結する。 筆者の分析によれば、ECにおける「健全なDirect」は、リピート購入の直前に発生する傾向がある。 一方で、新規ユーザーによるDirect流入が特定の「セール対象商品」に集中している場合、それはアフィリエイトやSNSでの「タグなし紹介」が原因であることが多い。

これを放置すると、どの媒体が売上に貢献しているのかが分からず、広告予算の最適化ができなくなる。 対策として、サイト内に「どこで知りましたか?」というアンケートを設置したり、特定の流入元専用のクーポンコードを発行したりすることで、GA4の数字を補完する努力が求められる。

技術的な限界を認めた上で、定性的なデータで「Directの正体」を埋めていく姿勢が、これからのWeb担当者には不可欠だ。

この記事のポイント

- GA4のDirectは「参照元が特定できないアクセス」の総称であり、必ずしも直接訪問ではない。

- AI検索やチャットツールの普及により、出所不明の「ダークサーチ」が増加している。

- プライバシー保護機能の強化により、リファラ情報が削除され、Directへ分類されるケースが増えている。

- Directの急増時は、ランディングページや指名検索の推移を確認し、計測不備がないか診断する必要がある。

- データの不透明さを前提に、アンケートやクーポン活用などの補完的な分析手法を組み合わせることが重要だ。

出典

- MarTech「Why direct traffic in GA4 isn’t what it looks like」(2026年3月9日)

・ 複数業界における17年間のデジタルビジネス開発経験

・ ウェブサイト開発のためのHTML、PHP、CSS、Java等の実用的知識

・ 15ヶ国語対応の多言語SaaSの開発経験

・ 17年間にも及ぶ、Eコマース長期運営経験

・ 幅広い業界でのSEO最適化の豊富な経験